Cómo WeTransfer avivó los temores sobre entrenar IA con datos de usuarios

El servicio de intercambio de archivos holandés WeTransfer está en el centro de la polémica después de que los usuarios detectaran actualizaciones drásticas en sus términos de servicio que parecían permitir a la compañía entrenar modelos de IA con sus archivos subidos.

La compañía ha eliminado ahora el lenguaje controvertido, pero los usuarios siguen indignados. Esto es lo que está ocurriendo — y por qué importa.

¿Qué cambió WeTransfer?

Los usuarios de WeTransfer descubrieron esta semana que el servicio había actualizado su política con una cláusula que le concedía una licencia perpetua y sin royalties para usar el contenido subido por los usuarios, incluso para “mejorar modelos de aprendizaje automático que potencien la moderación de contenido”. Los cambios debían entrar en vigor el 8 de agosto.

Ese lenguaje era lo suficientemente vago como para que muchos usuarios — incluyendo a la escritora de libros infantiles Sarah McIntyre y al comediante Matt Lieb — sintieran que abría la puerta a que WeTransfer usara o incluso vendiera sus archivos para entrenar IA sin permiso ni compensación.

¿Cómo es esto aceptable, @WeTransfer? No eres un servicio gratuito, yo *pago* por que transfieras mis archivos de obras grandes.

NO te pago para tener el derecho de usarlos para entrenar IA o imprimir, vender y distribuir mi obra y convertirte en un rival comercial, usando mi propio trabajo.😡 pic.twitter.com/OHPIjRGGOM

— Sarah McIntyre (@jabberworks) 15 de julio de 2025

¿Y cómo respondió WeTransfer?

El martes por la tarde, WeTransfer intentó apagar el incendio, diciendo en un comunicado que no usa el contenido de los usuarios para entrenar IA, ni vende o comparte archivos con terceros. La compañía dice que consideró usar IA para “mejorar la moderación de contenido” en el futuro, pero que tal función “aún no ha sido creada ni implementada en la práctica”.

También ha modificado sus términos de servicio, eliminando cualquier mención sobre aprendizaje automático. La versión actualizada indica que los usuarios otorgan a la compañía “una licencia sin royalties” para usar su contenido para “operar, desarrollar y mejorar el servicio”.

Pero quizás ya esté hecho el daño a la confianza de los usuarios.

¿Por qué están tan preocupados los usuarios?

WeChat se suma a una lista creciente de compañías que han sido criticadas por entrenar sistemas de aprendizaje automático con datos de usuarios. Adobe, Zoom, Slack, Dropbox y otros también han retrocedido o aclarado políticas similares relacionadas con IA tras reacciones públicas adversas. Todos estos incidentes reflejan frustraciones más amplias en torno a los derechos de autor y el consentimiento en la era de la IA — y apuntan a problemas de confianza entre los usuarios y las empresas tecnológicas.

WeTransfer se ha promocionado durante mucho tiempo como un servicio de intercambio de archivos amigable con los creativos y consciente de la privacidad. Por lo tanto, no resulta sorprendente que la ambigüedad en el lenguaje sobre IA y derechos de licencia haya parecido una traición para sus usuarios, especialmente para artistas y freelancers que temen que su trabajo pueda ser alimentado en silencio en modelos de aprendizaje automático sin su consentimiento.

Aunque WeTransfer aclaró sus términos, para muchos usuarios del servicio, el daño ya está hecho. En respuestas al anuncio oficial de WeTransfer en X, algunos dijeron que parecía que la compañía había probado el terreno con permisos más amplios para IA, recibió una rápida reacción pública en contra y luego retrocedió rápidamente.

Es poco probable que WeTransfer sea la última empresa tecnológica atrapada en este tipo de controversia. A medida que crece la fiebre por la IA, los datos de los usuarios se convierten en el nuevo combustible.

Other articles

Este barco de carga está convirtiendo sus emisiones de CO2 en cemento ecológico.

La startup del Reino Unido Seabound afirma haber construido el primer sistema comercial de captura de carbono para barcos de carga. El sistema ya está en funcionamiento en el mar.

Este barco de carga está convirtiendo sus emisiones de CO2 en cemento ecológico.

La startup del Reino Unido Seabound afirma haber construido el primer sistema comercial de captura de carbono para barcos de carga. El sistema ya está en funcionamiento en el mar.

Por qué quiero que la UE pause la Ley de IA — como defensor del clima

Antoine Rostand, presidente y cofundador de la firma de inteligencia ambiental Kayrros, teme que la Ley de IA perjudique los esfuerzos de sostenibilidad.

Por qué quiero que la UE pause la Ley de IA — como defensor del clima

Antoine Rostand, presidente y cofundador de la firma de inteligencia ambiental Kayrros, teme que la Ley de IA perjudique los esfuerzos de sostenibilidad.

Una firma noruega de inversiones se une a la fiebre del oro de la IA en el helado norte

Aker es la última compañía en dirigirse al extremo norte para aprovechar la abundante energía verde y el enfriamiento natural para centros de datos con gran demanda energética.

Una firma noruega de inversiones se une a la fiebre del oro de la IA en el helado norte

Aker es la última compañía en dirigirse al extremo norte para aprovechar la abundante energía verde y el enfriamiento natural para centros de datos con gran demanda energética.

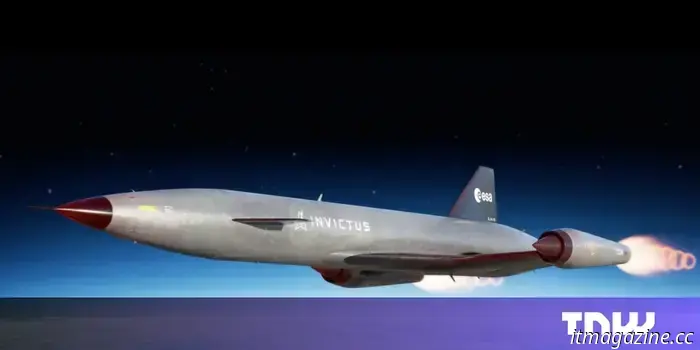

El proyecto del transbordador espacial ESA reaviva el motor hipersónico de la empresa en bancarrota

ESA respalda un nuevo proyecto llamado Invictus que tiene como objetivo desarrollar y lanzar un aeroplano espacial propulsado por hidrógeno para 2031.

El proyecto del transbordador espacial ESA reaviva el motor hipersónico de la empresa en bancarrota

ESA respalda un nuevo proyecto llamado Invictus que tiene como objetivo desarrollar y lanzar un aeroplano espacial propulsado por hidrógeno para 2031.

Cómo WeTransfer avivó los temores sobre entrenar IA con datos de usuarios

Los usuarios de WeTransfer temían que la empresa utilizara sus datos para entrenar modelos de inteligencia artificial. La controversia expuso una creciente desconfianza hacia la IA.