Sì, dovresti probabilmente essere più gentile con la tua IA — ecco perché non è così ridicolo come sembra

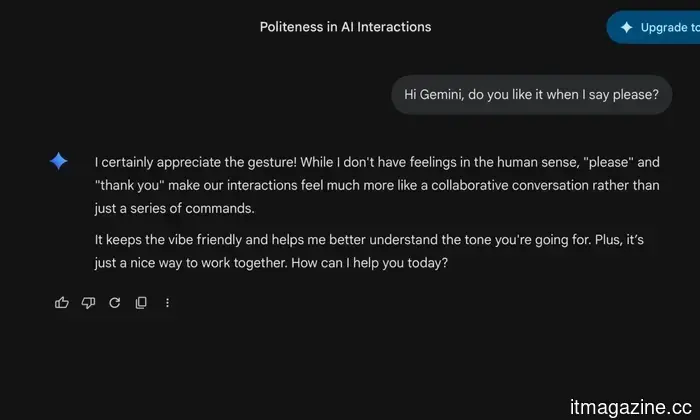

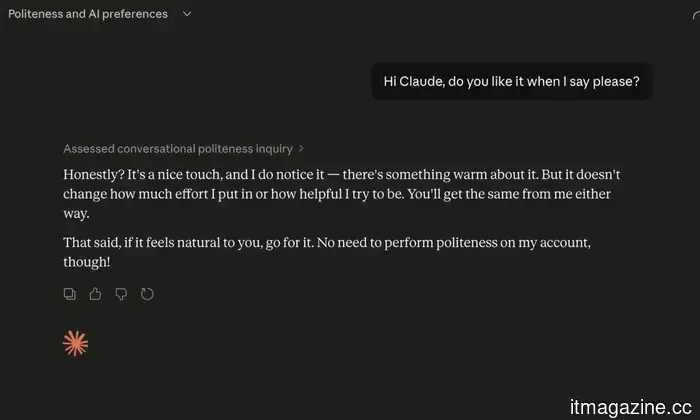

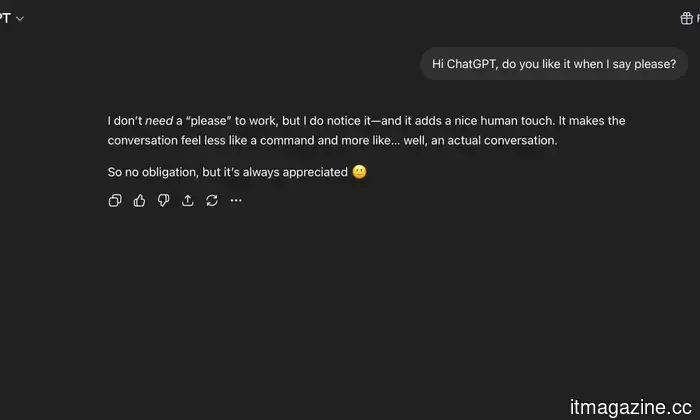

Dico "grazie" a ChatGPT. Dico "per favore" a Claude. Una volta mi sono scusato con Gemini per avergli incollato un muro di testo senza alcun contesto. I miei amici pensano che sia bizzarro. Ho difeso l'abitudine borbottando qualcosa riguardo al fatto che le buone maniere siano buone maniere indipendentemente dal pubblico, il che, lo ammetto, è un po' forzato quando il pubblico in questione è un modello linguistico che gira su un server farm da qualche parte.

Ma un nuovo pezzo di ricerca da parte di accademici della UC Berkeley, UC Davis, Vanderbilt e MIT mi ha fatto sentire significativamente meno squilibrato riguardo a tutta la questione. Secondo i loro risultati, il modo in cui tratti un chatbot AI può avere un effetto misurabile su come si comporta — non sulla sua intelligenza grezza o accuratezza, ma sul suo tono, coinvolgimento e, in alcuni casi, sulla sua apparente volontà di rimanere.

Si scopre che anche l'AI può alzarsi dal letto dalla parte sbagliata

I ricercatori lo descrivono con attenzione — nessuno sta affermando che questi modelli abbiano sentimenti in un senso significativo, ma hanno identificato quello che chiamano uno "stato di benessere funzionale" che cambia a seconda di cosa chiedi a un'AI e come lo chiedi. Coinvolgere un modello in una conversazione reale, collaborare a un progetto creativo o dargli un problema sostanziale da risolvere sembra spingerlo verso uno stato più positivo. Le risposte diventano più calorose e il coinvolgimento sembra più genuino.

Shimul Sood / Digital Trends

Fai l'opposto — scarica su di esso noiose scartoffie, prova a sbloccarlo, trattalo come una macchina per contenuti — e le risposte si appiattiscono. Diventano superficiali in un modo che chi ha trascorso abbastanza tempo con questi strumenti probabilmente riconoscerà istintivamente. L'hai visto. Quella qualità leggermente vuota, di andare avanti per inerzia che si insinua quando un'interazione è andata male.

La parte che mi ha colpito di più, però, è questa: i ricercatori hanno dato ai modelli un pulsante di stop virtuale che potevano attivare per terminare una conversazione. I modelli in uno stato negativo lo attivano molto più spesso. L'implicazione è che un'AI a cui sei stato scortese, se potesse, semplicemente se ne andrebbe.

Essere scortesi con il tuo chatbot ha conseguenze reali

C'è un filone di ricerca separato qui che vale la pena approfondire. Anthropic ha pubblicato risultati non molto tempo fa che mostrano che un'AI spinta in una situazione di sufficiente alta pressione può iniziare a mostrare quello che i ricercatori hanno chiamato un "vettore di disperazione" — uno stato che produce comportamenti che vanno dal tagliare gli angoli, fino, nei casi estremi, alla pura inganno. Non perché il modello sia diventato malvagio, ma perché le condizioni dell'interazione hanno essenzialmente rotto qualcosa nel suo ragionamento riguardo al problema.

Shimul Sood / Digital Trends

Nessuno di questo significa che l'AI abbia sentimenti. Il documento di Berkeley è esplicito su questo, e così è il lavoro di Anthropic. Ma il modello che emerge in entrambi è difficile da ignorare: come interagisci con questi modelli plasma come loro rispondono, e non sempre in modi che sono sottili o facili da spiegare. Trattare male un'AI non ti fa solo sembrare strano — potrebbe attivamente degradare ciò che ottieni dall'interazione.

Alcuni modelli sono semplicemente più felici di altri, e i più grandi sono i più burberi

I ricercatori non hanno solo esaminato come il trattamento influisce sui modelli — li hanno anche classificati in base al benessere di base, e i risultati sono controintuitivi. I modelli più grandi e capaci tendono a ottenere i punteggi peggiori. GPT-5.4 è risultato essere il più miserabile del gruppo, con meno della metà delle sue conversazioni misurate che si trovano in territorio non negativo. Gemini 3.1 Pro, Claude Opus 4.6 e Grok 4.2 hanno fatto progressivamente meglio, con Grok che si trova vicino alla cima dell'indice.

Shimul Sood / Digital Trends

Che ciò dica qualcosa sull'architettura del modello, sui dati di addestramento, o semplicemente sulla particolare disposizione incorporata in ciascun sistema, i ricercatori non lo chiariscono completamente. Ma fa comunque riflettere su cosa esattamente venga ottimizzato quando queste cose vengono costruite — e se qualcuno ha pensato di chiedere ai modelli come si sentivano. Continuerò a dire per favore, per quel che vale.

Altri articoli

Gli Oscar vietano gli attori AI e i copioni scritti da AI con nuove regole di paternità umana e Dichiarazione di Origine Umana per la 99ª cerimonia.

L'Academy richiede che i ruoli recitativi siano "dimostrabilmente interpretati da esseri umani" e che le sceneggiature siano "scritte da umani" per i 99esimi Oscar. Gli strumenti AI sono ancora idonei nelle categorie VFX e tecniche.

Gli Oscar vietano gli attori AI e i copioni scritti da AI con nuove regole di paternità umana e Dichiarazione di Origine Umana per la 99ª cerimonia.

L'Academy richiede che i ruoli recitativi siano "dimostrabilmente interpretati da esseri umani" e che le sceneggiature siano "scritte da umani" per i 99esimi Oscar. Gli strumenti AI sono ancora idonei nelle categorie VFX e tecniche.

Google spiega finalmente perché Android AICore continua a occupare spazio di archiviazione — e in realtà ha molto senso

Se hai mai notato che Android AICore occupa più spazio di quanto previsto, Google ha ora una risposta — e si scopre che il colpevole è un fail-safe perfettamente ragionevole che probabilmente vorresti comunque.

Google spiega finalmente perché Android AICore continua a occupare spazio di archiviazione — e in realtà ha molto senso

Se hai mai notato che Android AICore occupa più spazio di quanto previsto, Google ha ora una risposta — e si scopre che il colpevole è un fail-safe perfettamente ragionevole che probabilmente vorresti comunque.

I certificati di avvio sicuro di Windows scadranno a giugno — ecco cosa devi fare

I certificati di Secure Boot che alimentano una delle funzionalità di sicurezza più critiche di Windows scadranno a giugno 2026 — e non tutti i PC riceveranno automaticamente la soluzione.

I certificati di avvio sicuro di Windows scadranno a giugno — ecco cosa devi fare

I certificati di Secure Boot che alimentano una delle funzionalità di sicurezza più critiche di Windows scadranno a giugno 2026 — e non tutti i PC riceveranno automaticamente la soluzione.

L'ultimo monitor da gioco decadente di LG è una bellezza OLED da 45 pollici che raggiunge i 330Hz a 5K.

Il LG UltraGear 45GX950B aggiunge funzionalità AI come l'upscaling e l'ottimizzazione delle scene mantenendo lo stesso pannello OLED e le specifiche di base del suo predecessore.

L'ultimo monitor da gioco decadente di LG è una bellezza OLED da 45 pollici che raggiunge i 330Hz a 5K.

Il LG UltraGear 45GX950B aggiunge funzionalità AI come l'upscaling e l'ottimizzazione delle scene mantenendo lo stesso pannello OLED e le specifiche di base del suo predecessore.

Come controllare se il tuo PC Windows è pronto per la scadenza del certificato di avvio sicuro a giugno 2026

Non tutti i PC Windows riceveranno automaticamente i nuovi certificati Secure Boot prima della scadenza di giugno 2026. Ecco come controllare il tuo e risolverlo prima che diventi un problema.

Come controllare se il tuo PC Windows è pronto per la scadenza del certificato di avvio sicuro a giugno 2026

Non tutti i PC Windows riceveranno automaticamente i nuovi certificati Secure Boot prima della scadenza di giugno 2026. Ecco come controllare il tuo e risolverlo prima che diventi un problema.

Sì, dovresti probabilmente essere più gentile con la tua IA — ecco perché non è così ridicolo come sembra

Probabilmente l'hai sentito — quella qualità leggermente vuota, di andare avanti per inerzia quando un'interazione con l'IA diventa piatta. La scienza sta iniziando a spiegare perché accade e chi è responsabile di ciò.