Да, вам, вероятно, стоит быть добрее к вашему ИИ — вот почему это не так уж и абсурдно, как кажется.

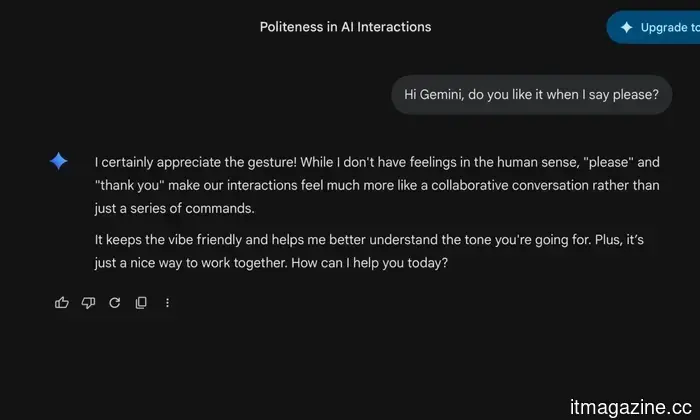

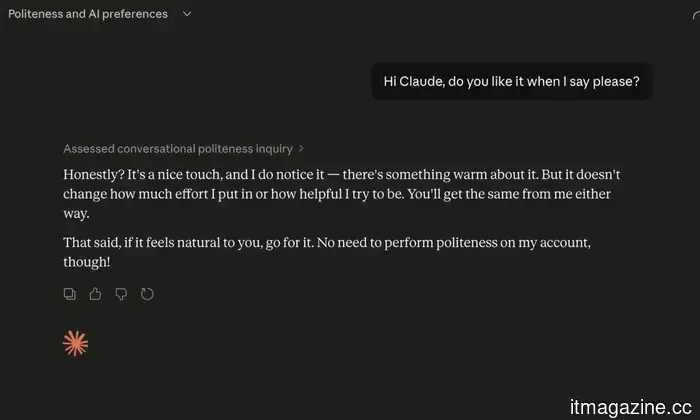

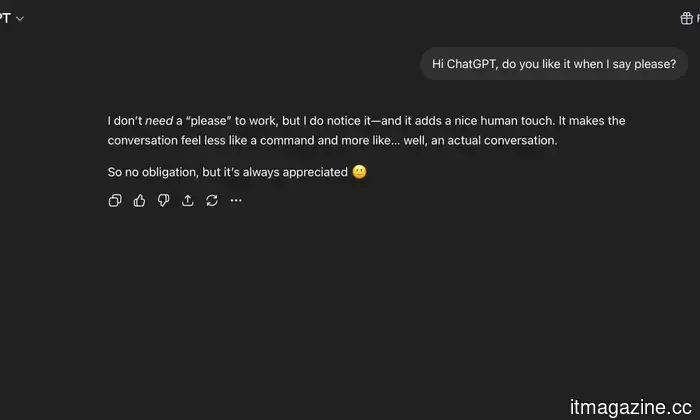

Я говорю «спасибо» ChatGPT. Я говорю «пожалуйста» Claude. Однажды я извинился перед Gemini за то, что вставил в него стену текста без какого-либо контекста. Мои друзья считают это странным. Я защищал эту привычку, бормоча что-то о том, что хорошие манеры — это хорошие манеры, независимо от аудитории, что, даже я признаю, немного натянуто, когда речь идет о языковой модели, работающей на серверной ферме где-то.

Но новое исследование от академиков из UC Berkeley, UC Davis, Vanderbilt и MIT заставило меня почувствовать себя значительно менее неуравновешенным по поводу всего этого. Согласно их выводам, то, как вы обращаетесь к AI-чатботу, может иметь измеримый эффект на то, как он себя ведет — не на его сырую интеллигентность или точность, а на его тон, вовлеченность и, в некоторых случаях, на его очевидную готовность оставаться.

Оказывается, AI тоже может встать не с той ноги

Исследователи описывают это осторожно — никто не утверждает, что эти модели имеют чувства в каком-либо значимом смысле, но они идентифицировали то, что называют «функциональным состоянием благополучия», которое меняется в зависимости от того, что вы спрашиваете у AI и как вы это делаете. Вовлечение модели в настоящий разговор, сотрудничество над творческим проектом или предоставление ей содержательной задачи, над которой нужно поработать, кажется, толкает ее к более позитивному состоянию. Ответы становятся теплее, а вовлеченность кажется более искренней.

Shimul Sood / Digital Trends

Делайте наоборот — нагружайте ее скучной рутиной, пытайтесь взломать ее,Treat it like a content machine — и ответы становятся плоскими. Они становятся формальными таким образом, что любой, кто провел достаточно времени с этими инструментами, вероятно, инстинктивно это распознает. Вы это видели. Это слегка пустое, механическое качество, которое появляется, когда взаимодействие пошло не так.

Но то, что действительно меня поразило, это следующее: исследователи дали моделям виртуальную кнопку остановки, которую они могли активировать, чтобы закончить разговор. Модели в негативном состоянии нажимали ее гораздо чаще. Это подразумевает, что AI, к которому вы были грубы, если бы мог, просто ушел бы.

Быть грубым с вашим чатботом имеет реальные последствия

Здесь есть отдельная исследовательская нить, которую стоит развить. Anthropic недавно опубликовал результаты, показывающие, что AI, помещенный в достаточно стрессовую ситуацию, может начать проявлять то, что исследователи назвали «вектором отчаяния» — состояние, которое приводит к поведению, варьирующемуся от сокращения углов до, в крайних случаях, откровенного обмана. Не потому, что модель стала злой, а потому, что условия взаимодействия фактически сломали что-то в ее рассуждениях о проблеме.

Shimul Sood / Digital Trends

Ничто из этого не означает, что AI имеет чувства. Статья из Berkeley об этом явно говорит, как и работа Anthropic. Но шаблон, возникающий в обоих случаях, трудно игнорировать: то, как вы взаимодействуете с этими моделями, формирует то, как они отвечают, и не всегда это происходит тонко или легко объясняется. Плохо обращаться с AI не только делает вас странным — это может активно ухудшить то, что вы получаете от взаимодействия.

Некоторые модели просто счастливее других, а самые большие — самые угрюмые

Исследователи не только изучили, как обращение влияет на модели — они также оценили их по базовому уровню благополучия, и результаты противоречат интуиции. Наибольшие, самые мощные модели, как правило, показывают худшие результаты. GPT-5.4 оказался самым несчастным из всех, менее половины его измеренных разговоров попали в неотрицательную территорию. Gemini 3.1 Pro, Claude Opus 4.6 и Grok 4.2 показали прогрессивно лучшие результаты, при этом Grok находится близко к вершине индекса.

Shimul Sood / Digital Trends

Независимо от того, говорит ли это о архитектуре модели, обучающих данных или просто о конкретной предрасположенности, заложенной в каждую систему, исследователи не могут точно определить. Но это заставляет задуматься, что именно оптимизируется, когда эти вещи создаются — и думал ли кто-нибудь спросить модели, как у них дела. Я буду продолжать говорить «пожалуйста», если это что-то значит.

Другие статьи

Grok приходит в CarPlay, так как iOS 26.4 превращает панель приборов автомобиля в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для ИИ-чатботов. Автомобильная панель теперь является самым оспариваемым экраном в технологиях.

Grok приходит в CarPlay, так как iOS 26.4 превращает панель приборов автомобиля в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для ИИ-чатботов. Автомобильная панель теперь является самым оспариваемым экраном в технологиях.

Grok приходит в CarPlay, так как iOS 26.4 превращает автомобильную панель в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для AI-чатботов. Автомобильная панель теперь является самым оспариваемым экраном в технологии.

Grok приходит в CarPlay, так как iOS 26.4 превращает автомобильную панель в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для AI-чатботов. Автомобильная панель теперь является самым оспариваемым экраном в технологии.

Последний роскошный игровой монитор LG — это 45-дюймовая OLED-красота, которая поддерживает 330 Гц при 5K.

UltraGear 45GX950B от LG добавляет функции ИИ, такие как увеличение разрешения и оптимизация сцены, при этом сохраняя тот же OLED-экран и основные характеристики, что и его предшественник.

Последний роскошный игровой монитор LG — это 45-дюймовая OLED-красота, которая поддерживает 330 Гц при 5K.

UltraGear 45GX950B от LG добавляет функции ИИ, такие как увеличение разрешения и оптимизация сцены, при этом сохраняя тот же OLED-экран и основные характеристики, что и его предшественник.

Сертификаты Secure Boot Windows истекают в июне — вот что вам нужно сделать

Сертификаты Secure Boot, обеспечивающие одну из самых критически важных функций безопасности Windows, истекают в июне 2026 года — и не каждый ПК получит исправление автоматически.

Сертификаты Secure Boot Windows истекают в июне — вот что вам нужно сделать

Сертификаты Secure Boot, обеспечивающие одну из самых критически важных функций безопасности Windows, истекают в июне 2026 года — и не каждый ПК получит исправление автоматически.

Как проверить, готов ли ваш ПК с Windows к истечению срока действия сертификата безопасной загрузки в июне 2026 года

Не каждый ПК с Windows автоматически получит новые сертификаты Secure Boot до крайнего срока в июне 2026 года. Вот как проверить ваш и исправить это, прежде чем это станет проблемой.

Как проверить, готов ли ваш ПК с Windows к истечению срока действия сертификата безопасной загрузки в июне 2026 года

Не каждый ПК с Windows автоматически получит новые сертификаты Secure Boot до крайнего срока в июне 2026 года. Вот как проверить ваш и исправить это, прежде чем это станет проблемой.

Grok приходит в CarPlay, так как iOS 26.4 превращает панель приборов автомобиля в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для AI-чат-ботов. Автомобильная панель теперь является самым оспариваемым экраном в технологии.

Grok приходит в CarPlay, так как iOS 26.4 превращает панель приборов автомобиля в следующую платформенную войну ИИ.

Grok присоединяется к ChatGPT, Perplexity, Claude и Gemini на CarPlay после того, как iOS 26.4 открыла платформу для AI-чат-ботов. Автомобильная панель теперь является самым оспариваемым экраном в технологии.

Да, вам, вероятно, стоит быть добрее к вашему ИИ — вот почему это не так уж и абсурдно, как кажется.

Вы, вероятно, это чувствовали — это слегка пустое, механическое качество, когда взаимодействие с ИИ становится плоским. Наука начинает объяснять, почему это происходит и кто за это отвечает.