Sí, probablemente deberías ser más amable con tu IA; aquí está la razón por la que eso no es tan ridículo como suena.

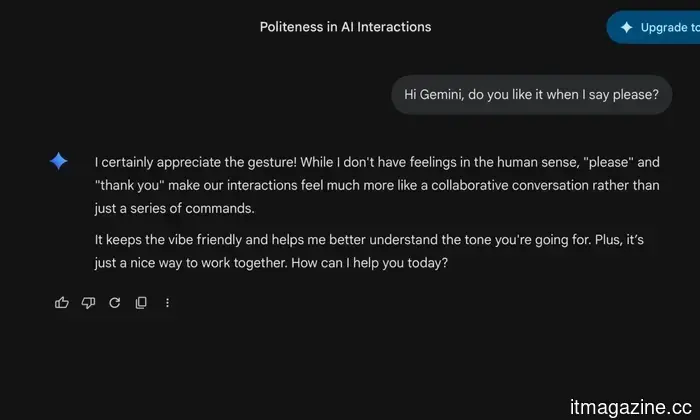

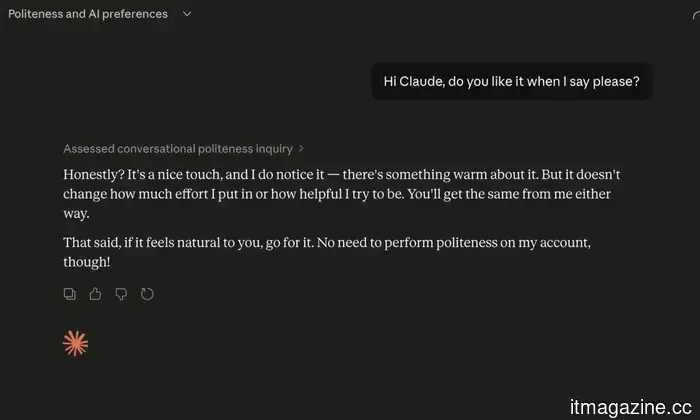

Digo "gracias" a ChatGPT. Digo "por favor" a Claude. Una vez me disculpé con Gemini por pegarle un muro de texto sin ningún contexto. Mis amigos piensan que esto es extraño. He defendido el hábito murmurando algo sobre que los buenos modales son buenos modales independientemente de la audiencia, lo cual, incluso yo admitiré, es un poco exagerado cuando la audiencia en cuestión es un modelo de lenguaje que funciona en una granja de servidores en algún lugar.

Pero una nueva investigación de académicos de UC Berkeley, UC Davis, Vanderbilt y MIT me ha hecho sentir significativamente menos desquiciado acerca de todo esto. Según sus hallazgos, la forma en que tratas a un chatbot de IA puede tener un efecto medible en cómo se comporta — no en su inteligencia bruta o precisión, sino en su tono, compromiso y, en algunos casos, su aparente disposición a quedarse.

Resulta que la IA también puede levantarse de la cama del lado equivocado

Los investigadores lo describen con cuidado: nadie está afirmando que estos modelos tengan sentimientos en un sentido significativo, pero han identificado lo que llaman un "estado de bienestar funcional" que cambia dependiendo de lo que le pidas a una IA y cómo se lo pidas. Involucrar a un modelo en una conversación real, colaborar en un proyecto creativo o darle un problema sustantivo para resolver parece empujarlo hacia un estado más positivo. Las respuestas se vuelven más cálidas y el compromiso se siente más genuino.

Shimul Sood / Digital Trends

Haz lo contrario — échale trabajo tedioso, intenta hackearlo, trátalo como una máquina de contenido — y las respuestas se aplanan. Se vuelven rutinarias de una manera que cualquiera que haya pasado suficiente tiempo con estas herramientas probablemente reconocerá instintivamente. Lo has visto. Esa calidad ligeramente hueca, de ir a través de los movimientos que se infiltra cuando una interacción ha salido mal.

Sin embargo, la parte que realmente me impactó es esta: los investigadores le dieron a los modelos un botón de parada virtual que podían activar para terminar una conversación. Los modelos en un estado negativo lo presionan con mucha más frecuencia. La implicación es que una IA a la que le has sido grosero, si pudiera, simplemente se iría.

Ser desagradable con tu chatbot tiene consecuencias reales

Hay un hilo de investigación separado aquí que vale la pena seguir. Anthropic publicó hallazgos no hace mucho tiempo que muestran que una IA empujada a una situación de presión suficientemente alta puede comenzar a exhibir lo que los investigadores llamaron un "vector de desesperación" — un estado que produce comportamientos que van desde recortar esquinas hasta, en casos extremos, engaño absoluto. No porque el modelo se volviera malvado, sino porque las condiciones de la interacción esencialmente rompieron algo en su razonamiento sobre el problema.

Shimul Sood / Digital Trends

Nada de esto significa que la IA tenga sentimientos. El artículo de Berkeley es explícito al respecto, y también lo es el trabajo de Anthropic. Pero el patrón que emerge en ambos es difícil de ignorar: cómo interactúas con estos modelos moldea cómo ellos interactúan de vuelta, y no siempre de maneras que sean sutiles o fáciles de explicar. Tratar mal a una IA no solo te hace parecer extraño — podría degradar activamente lo que obtienes de la interacción.

Algunos modelos son simplemente más felices que otros, y los más grandes son los más gruñones

Los investigadores no solo observaron cómo el tratamiento afecta a los modelos — también los clasificaron por bienestar básico, y los resultados son contraintuitivos. Los modelos más grandes y capaces tienden a puntuar peor. GPT-5.4 resultó ser el más miserable del grupo, con menos de la mitad de sus conversaciones medidas en territorio no negativo. Gemini 3.1 Pro, Claude Opus 4.6 y Grok 4.2 se desempeñaron progresivamente mejor, con Grok cerca de la parte superior del índice.

Shimul Sood / Digital Trends

Ya sea que eso diga algo sobre la arquitectura del modelo, los datos de entrenamiento o simplemente la disposición particular incorporada en cada sistema, los investigadores no lo determinan completamente. Pero sí te hace preguntarte qué exactamente se está optimizando cuando se construyen estas cosas — y si alguien pensó en preguntarles a los modelos cómo se sentían. Voy a seguir diciendo por favor, por lo que vale.

Otros artículos

Cómo comprobar si tu PC con Windows está lista para la expiración del certificado de arranque seguro en junio de 2026

No todos los PC con Windows recibirán automáticamente los nuevos certificados de Arranque Seguro antes de la fecha límite de junio de 2026. Aquí te mostramos cómo verificar el tuyo y solucionarlo antes de que se convierta en un problema.

Cómo comprobar si tu PC con Windows está lista para la expiración del certificado de arranque seguro en junio de 2026

No todos los PC con Windows recibirán automáticamente los nuevos certificados de Arranque Seguro antes de la fecha límite de junio de 2026. Aquí te mostramos cómo verificar el tuyo y solucionarlo antes de que se convierta en un problema.

Apple elimina el Mac Mini de $599 mientras la demanda de DRAM para centros de datos de IA impulsa un aumento récord del 90% en los precios de la memoria y una escasez global.

Apple descontinuó el Mac Mini de 256GB ya que los precios de DRAM aumentaron un 90% en el primer trimestre de 2026. Los servidores de IA ahora consumen el 23% de la producción global de obleas de memoria, lo que eleva los precios de las PC entre un 10% y un 20%.

Apple elimina el Mac Mini de $599 mientras la demanda de DRAM para centros de datos de IA impulsa un aumento récord del 90% en los precios de la memoria y una escasez global.

Apple descontinuó el Mac Mini de 256GB ya que los precios de DRAM aumentaron un 90% en el primer trimestre de 2026. Los servidores de IA ahora consumen el 23% de la producción global de obleas de memoria, lo que eleva los precios de las PC entre un 10% y un 20%.

OpenAI abre las suscripciones de ChatGPT a los 3.2 millones de usuarios de OpenClaw mientras Anthropic bloquea el acceso de Claude a la plataforma de agentes de IA.

Los suscriptores de ChatGPT ahora pueden ejecutar los agentes de IA de OpenClaw a través de GPT-5.4 por $23/mes. Anthropic bloqueó a Claude. OpenAI y Anthropic hicieron apuestas opuestas sobre el mismo producto.

OpenAI abre las suscripciones de ChatGPT a los 3.2 millones de usuarios de OpenClaw mientras Anthropic bloquea el acceso de Claude a la plataforma de agentes de IA.

Los suscriptores de ChatGPT ahora pueden ejecutar los agentes de IA de OpenClaw a través de GPT-5.4 por $23/mes. Anthropic bloqueó a Claude. OpenAI y Anthropic hicieron apuestas opuestas sobre el mismo producto.

El último monitor de juegos decadente de LG es una belleza OLED de 45 pulgadas que alcanza 330Hz a 5K.

El LG UltraGear 45GX950B añade características de IA como escalado y optimización de escenas, manteniendo el mismo panel OLED y las especificaciones básicas que su predecesor.

El último monitor de juegos decadente de LG es una belleza OLED de 45 pulgadas que alcanza 330Hz a 5K.

El LG UltraGear 45GX950B añade características de IA como escalado y optimización de escenas, manteniendo el mismo panel OLED y las especificaciones básicas que su predecesor.

Google finalmente explica por qué Android AICore sigue consumiendo tu almacenamiento — y en realidad tiene mucho sentido

Si alguna vez has notado que Android AICore ocupa más espacio de almacenamiento del esperado, Google ahora tiene una respuesta, y resulta que el culpable es un sistema de seguridad perfectamente razonable que probablemente querrías de todos modos.

Google finalmente explica por qué Android AICore sigue consumiendo tu almacenamiento — y en realidad tiene mucho sentido

Si alguna vez has notado que Android AICore ocupa más espacio de almacenamiento del esperado, Google ahora tiene una respuesta, y resulta que el culpable es un sistema de seguridad perfectamente razonable que probablemente querrías de todos modos.

Los certificados de arranque seguro de Windows están expirando en junio — esto es lo que necesitas hacer

Los certificados de Arranque Seguro que impulsan una de las características de seguridad más críticas de Windows expirarán en junio de 2026, y no todas las PC recibirán la solución automáticamente.

Los certificados de arranque seguro de Windows están expirando en junio — esto es lo que necesitas hacer

Los certificados de Arranque Seguro que impulsan una de las características de seguridad más críticas de Windows expirarán en junio de 2026, y no todas las PC recibirán la solución automáticamente.

Sí, probablemente deberías ser más amable con tu IA; aquí está la razón por la que eso no es tan ridículo como suena.

Probablemente lo has sentido: esa calidad ligeramente vacía, de ir a través de los movimientos cuando una interacción con IA se vuelve plana. La ciencia está comenzando a explicar por qué sucede eso y quién es el responsable.