AI-голосовые чаты все еще кажутся неловкими, потому что ассистенты не знают, когда говорить.

Лаборатория Thinking Machines сообщает, что она разрабатывает полно дуплексный ИИ, что означает, что ИИ-система может воспринимать то, что говорит человек, одновременно генерируя ответ. Проще говоря, это ближе к телефонному разговору, чем к рации.

Стартап, основанный в прошлом году бывшим техническим директором OpenAI Мирой Муратой, объявил о моделях взаимодействия, начиная с TML-Interaction-Small. Он утверждает, что система может отвечать за 0,40 секунды, что ставит её на уровень обычного человеческого общения.

Есть одно «но» для тех, кто надеется попробовать это сегодня. Это всё ещё предварительный просмотр исследования, с ограниченным доступом, запланированным на ближайшие несколько месяцев, и более широким релизом, ожидаемым позже в этом году.

Более быстрый обмен ИИ

Основная идея проста для понимания, и изменения имеют значение. Вместо того чтобы ждать, пока кто-то закончит говорить, прежде чем работать над ответом, модель обрабатывает входную речь, пока готовит свой ответ.

Unsplash

Эта задержка важна, потому что паузы заставляют ИИ-ассистентов звучать искусственно. Лаборатория Thinking Machines рассматривает время ответа TML-Interaction-Small в 0,40 секунды как близкое к естественной скорости разговора, что будет заметным изменением для голосовых инструментов.

Она также утверждает, что эта скорость быстрее, чем у сопоставимых моделей от OpenAI и Google. Этот ориентир придаёт объявлению вес, но пользователи всё равно должны протестировать, работает ли опыт так же гладко, как предполагает число.

Когда скорость становится поведением

Ассистент, который отвечает, пока всё ещё принимает информацию, меняет ожидания пользователей от голосового чата. Разговор может двигаться быстрее, но системе также нужно управлять временем с гораздо большей осторожностью.

Этот компромисс важен, когда кто-то хочет быстрое разъяснение, а не длинный сгенерированный ответ. Более быстрые ответы не помогут, если ассистент вмешивается слишком рано, неправильно понимает говорящего или нарушает поток, который он должен улучшить.

Gemini на смартфоне Unsplash

Пока что архитектура является новостью. Настоящее испытание продукта заключается в том, сможет ли модель взаимодействия сделать лучшее время отклика автоматическим.

На что обратить внимание перед запуском

Сроки выпуска — это ключевая деталь сейчас. Лаборатория Thinking Machines сообщает, что ограниченный предварительный просмотр исследования появится в ближайшие несколько месяцев, за которым последует более широкий доступ позже в этом году.

Доступность, цены, поддерживаемые платформы и производительность вне контролируемого тестирования всё ещё неясны. Эти недостающие элементы важны, потому что более быстрая модель поможет только в том случае, если люди смогут использовать её в повседневных голосовых инструментах.

Для всех, кто использует голосовых ассистентов ИИ, практическим шагом будет внимательно следить за предварительным просмотром. Полно дуплексный ИИ имеет потенциал, но практическое тестирование должно показать, действительно ли более быстрые ответы облегчают повседневные разговоры с ИИ.

Другие статьи

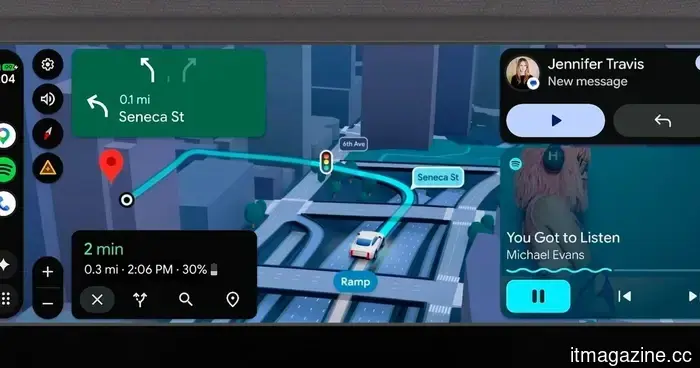

Это обновление Android Auto пытается изменить то, как вы водите и используете свой автомобиль.

Android Auto получает значительное обновление, которое выходит за рамки простых изменений дизайна, предлагая более умную навигацию, более разнообразные развлечения и более полезный опыт вождения.

Это обновление Android Auto пытается изменить то, как вы водите и используете свой автомобиль.

Android Auto получает значительное обновление, которое выходит за рамки простых изменений дизайна, предлагая более умную навигацию, более разнообразные развлечения и более полезный опыт вождения.

Waymo отзывает 3,791 роботакси после того, как одно из транспортных средств заехало на затопленную дорогу

Waymo отзывает 3,791 роботакси после того, как ошибка в программном обеспечении позволила одному из них заехать на затопленную дорогу в Сан-Антонио, и в подаче раскрывается размер его флота в США.

Waymo отзывает 3,791 роботакси после того, как одно из транспортных средств заехало на затопленную дорогу

Waymo отзывает 3,791 роботакси после того, как ошибка в программном обеспечении позволила одному из них заехать на затопленную дорогу в Сан-Антонио, и в подаче раскрывается размер его флота в США.

Google выявил первую уязвимость нулевого дня, разработанную ИИ, и предотвратил запланированное массовое использование.

GTIG Google выявила первую уязвимость нулевого дня, разработанную с использованием ИИ, и остановила массовое событие эксплуатации. В отчете документируются действия государственных акторов, использующих ИИ для исследования уязвимостей и автономного вредоносного ПО.

Google выявил первую уязвимость нулевого дня, разработанную ИИ, и предотвратил запланированное массовое использование.

GTIG Google выявила первую уязвимость нулевого дня, разработанную с использованием ИИ, и остановила массовое событие эксплуатации. В отчете документируются действия государственных акторов, использующих ИИ для исследования уязвимостей и автономного вредоносного ПО.

Google только что значительно улучшил Gemini для дома, чтобы он лучше управлял вашим умным домом.

Google выпустил новое обновление Gemini для Home с более умным поиском по камере, более быстрым управлением устройствами, улучшенной настройкой и новыми улучшениями приложения Google Home.

Google только что значительно улучшил Gemini для дома, чтобы он лучше управлял вашим умным домом.

Google выпустил новое обновление Gemini для Home с более умным поиском по камере, более быстрым управлением устройствами, улучшенной настройкой и новыми улучшениями приложения Google Home.

Согласно сообщениям, Huawei тестирует новые технологии для своей самой большой батареи телефона на сегодняшний день.

Новая утечка утверждает, что Huawei экспериментирует с новыми материалами и дизайнами батарей, которые могут увеличить емкость смартфонов более чем на 10 000 мАч.

Согласно сообщениям, Huawei тестирует новые технологии для своей самой большой батареи телефона на сегодняшний день.

Новая утечка утверждает, что Huawei экспериментирует с новыми материалами и дизайнами батарей, которые могут увеличить емкость смартфонов более чем на 10 000 мАч.

eBay отклоняет предложение GameStop в 56 миллиардов долларов как

Совет директоров eBay отклонил предложение о поглощении GameStop на сумму 56 миллиардов долларов как недостоверное и непривлекательное, ссылаясь на неопределенность финансирования и долговую нагрузку.

eBay отклоняет предложение GameStop в 56 миллиардов долларов как

Совет директоров eBay отклонил предложение о поглощении GameStop на сумму 56 миллиардов долларов как недостоверное и непривлекательное, ссылаясь на неопределенность финансирования и долговую нагрузку.

AI-голосовые чаты все еще кажутся неловкими, потому что ассистенты не знают, когда говорить.

Лаборатория мыслящих машин тестирует полный дуплекс ИИ, который может слушать и отвечать одновременно, но настоящим испытанием станет то, будут ли более быстрые голосовые чаты полезными, когда люди смогут их попробовать.