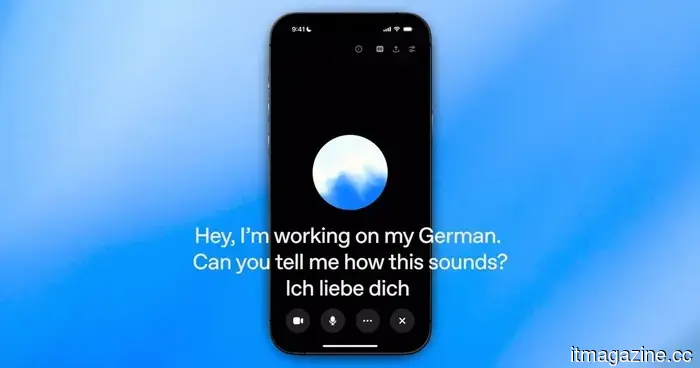

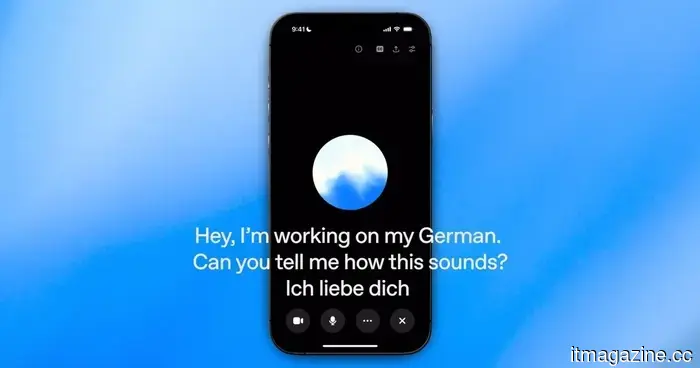

Las conversaciones de voz con IA todavía se sienten incómodas porque los asistentes no saben cuándo hablar.

Thinking Machines Lab dice que está construyendo IA de dúplex completo, lo que significa que un sistema de IA puede recibir lo que alguien está diciendo mientras genera una respuesta. En inglés sencillo, está más cerca de una llamada telefónica que de un walkie-talkie.

La startup, fundada el año pasado por la ex-CTO de OpenAI Mira Murati, anunció modelos de interacción, comenzando con TML-Interaction-Small. Dice que el sistema puede responder en 0.40 segundos, un ritmo que lo coloca cerca del intercambio humano ordinario.

Hay un inconveniente para cualquiera que espere probarlo hoy. Esto sigue siendo una vista previa de investigación, con acceso limitado planeado en los próximos meses y un lanzamiento más amplio esperado más adelante este año.

Un tipo de intercambio de IA más rápido

La idea central es fácil de entender, y el cambio es significativo. En lugar de esperar a que alguien termine de hablar antes de trabajar en una respuesta, el modelo procesa el habla entrante mientras prepara su respuesta.

Unsplash

Esa demora importa porque las pausas hacen que los asistentes de IA suenen artificiales. Thinking Machines Lab enmarca el tiempo de respuesta de 0.40 segundos de TML-Interaction-Small como cercano a la velocidad de conversación natural, lo que sería un cambio notable para las herramientas de voz.

También afirma que ese ritmo es más rápido que los modelos comparables de OpenAI y Google. La referencia le da peso al anuncio, pero los usuarios externos aún necesitan probar si la experiencia funciona tan suavemente como sugiere el número.

Cuando la velocidad se convierte en comportamiento

Un asistente que responde mientras aún está recibiendo información cambia lo que los usuarios esperan de un chat de voz. La conversación puede avanzar más rápido, pero el sistema también tiene que gestionar el tiempo con mucho más cuidado.

Ese compromiso importa cuando alguien quiere una aclaración rápida en lugar de una larga respuesta generada. Las respuestas más rápidas no ayudarán mucho si el asistente interviene demasiado pronto, malinterpreta al hablante o interrumpe el flujo que se supone que debe mejorar.

Gemini en un smartphone Unsplash

Por ahora, la arquitectura es la noticia. La verdadera prueba del producto es si el modelo de interacción puede hacer que un mejor tiempo se sienta automático.

Qué observar antes del lanzamiento

La línea de tiempo de lanzamiento es el detalle clave ahora. Thinking Machines Lab dice que una vista previa de investigación limitada llegará en los próximos meses, seguida de un acceso más amplio más adelante este año.

La disponibilidad, los precios, las plataformas compatibles y el rendimiento fuera de pruebas controladas aún no están claros. Esas piezas faltantes importan porque un modelo más rápido solo ayuda si las personas pueden usarlo en herramientas de voz cotidianas.

Para cualquiera que use asistentes de voz de IA, el movimiento práctico es observar la vista previa de cerca. La IA de dúplex completo tiene potencial, pero las pruebas prácticas deberían mostrar si las respuestas más rápidas realmente facilitan las conversaciones diarias de IA.

Other articles

Google acaba de mejorar mucho Gemini para el hogar en la gestión de tu hogar inteligente.

Google ha lanzado una nueva actualización de Gemini para el hogar con una búsqueda de cámara más inteligente, controles de dispositivo más rápidos, mejor incorporación y nuevas mejoras en la aplicación Google Home.

Google acaba de mejorar mucho Gemini para el hogar en la gestión de tu hogar inteligente.

Google ha lanzado una nueva actualización de Gemini para el hogar con una búsqueda de cámara más inteligente, controles de dispositivo más rápidos, mejor incorporación y nuevas mejoras en la aplicación Google Home.

Las conversaciones de voz con IA todavía se sienten incómodas porque los asistentes no saben cuándo hablar.

El Laboratorio de Máquinas Pensantes está probando IA de dúplex completo que puede escuchar y responder al mismo tiempo, pero la verdadera prueba es si los chats de voz más rápidos se sienten útiles una vez que las personas pueden probarlos.

Las conversaciones de voz con IA todavía se sienten incómodas porque los asistentes no saben cuándo hablar.

El Laboratorio de Máquinas Pensantes está probando IA de dúplex completo que puede escuchar y responder al mismo tiempo, pero la verdadera prueba es si los chats de voz más rápidos se sienten útiles una vez que las personas pueden probarlos.

Huawei supuestamente está probando nueva tecnología para su batería de teléfono más grande hasta ahora.

Una nueva filtración afirma que Huawei está experimentando con nuevos materiales y diseños de baterías que podrían llevar la capacidad de los smartphones más allá de 10,000mAh.

Huawei supuestamente está probando nueva tecnología para su batería de teléfono más grande hasta ahora.

Una nueva filtración afirma que Huawei está experimentando con nuevos materiales y diseños de baterías que podrían llevar la capacidad de los smartphones más allá de 10,000mAh.

Signal messenger quiere protegerte de phishing con estos nuevos cambios en la aplicación.

Signal ha lanzado nuevas funciones de seguridad en la aplicación para ayudar a los usuarios a detectar y evitar ataques de phishing y ingeniería social, incluidos los estafadores que se hacen pasar por Signal mismo.

Signal messenger quiere protegerte de phishing con estos nuevos cambios en la aplicación.

Signal ha lanzado nuevas funciones de seguridad en la aplicación para ayudar a los usuarios a detectar y evitar ataques de phishing y ingeniería social, incluidos los estafadores que se hacen pasar por Signal mismo.

El A* de Kevin Hartz adopta un enfoque de 'menos es más' con un nuevo fondo de $450 millones.

El A* de Kevin Hartz ha cerrado un fondo de 450 millones de dólares, presentado como una respuesta a los megafondos de IA que persiguen valoraciones de mil millones de dólares en cada etapa.

El A* de Kevin Hartz adopta un enfoque de 'menos es más' con un nuevo fondo de $450 millones.

El A* de Kevin Hartz ha cerrado un fondo de 450 millones de dólares, presentado como una respuesta a los megafondos de IA que persiguen valoraciones de mil millones de dólares en cada etapa.

La fecha de lanzamiento de la temporada 3 de Los Anillos de Poder está fijada, y el Anillo Único llegará antes de lo esperado.

Prime Video ha confirmado una fecha de lanzamiento para la temporada 3 de Rings of Power, con nuevos miembros del reparto y el Anillo Único finalmente entrando en la historia.

La fecha de lanzamiento de la temporada 3 de Los Anillos de Poder está fijada, y el Anillo Único llegará antes de lo esperado.

Prime Video ha confirmado una fecha de lanzamiento para la temporada 3 de Rings of Power, con nuevos miembros del reparto y el Anillo Único finalmente entrando en la historia.

Las conversaciones de voz con IA todavía se sienten incómodas porque los asistentes no saben cuándo hablar.

El Laboratorio de Máquinas Pensantes está probando IA de dúplex completo que puede escuchar y responder al mismo tiempo, pero la verdadera prueba es si los chats de voz más rápidos se sienten útiles una vez que las personas pueden probarlos.