ТурбоКвант от Google сжимает память ИИ в 6 раз, потрясая акции чипов

Google опубликовал исследовательский блог во вторник о новом алгоритме сжатия для ИИ-моделей. В течение нескольких часов акции компаний, занимающихся памятью, начали падать. Акции Micron упали на 3 процента, Western Digital потеряла 4,7 процента, а SanDisk упала на 5,7 процента, так как инвесторы пересчитали, сколько физической памяти на самом деле может понадобиться индустрии ИИ.

Алгоритм называется TurboQuant, и он решает одну из самых дорогих узких мест в работе крупных языковых моделей: кеш ключ-значение, высокоскоростное хранилище данных, которое хранит контекстную информацию, чтобы модель не должна была пересчитывать её с каждым новым токеном, который она генерирует. Поскольку модели обрабатывают более длинные входные данные, кеш быстро растет, потребляя память GPU, которая в противном случае могла бы быть использована для обслуживания большего числа пользователей или запуска более крупных моделей. TurboQuant сжимает кеш до всего лишь 3 бит на значение, по сравнению со стандартными 16, уменьшая его объем памяти как минимум в шесть раз без, согласно бенчмаркам Google, какой-либо измеримой потери в точности.

Статья, которая будет представлена на ICLR 2026, была написана Амиром Занди, научным сотрудником Google, и Вахабом Миррокни, вице-президентом и научным сотрудником Google, вместе с сотрудниками Google DeepMind, KAIST и Нью-Йоркского университета. Она основывается на двух предыдущих статьях той же группы: QJL, опубликованной на AAAI 2025, и PolarQuant, которая появится на AISTATS 2026.

Как это работает

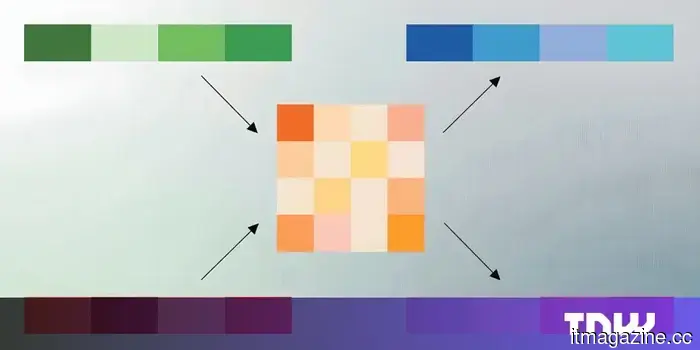

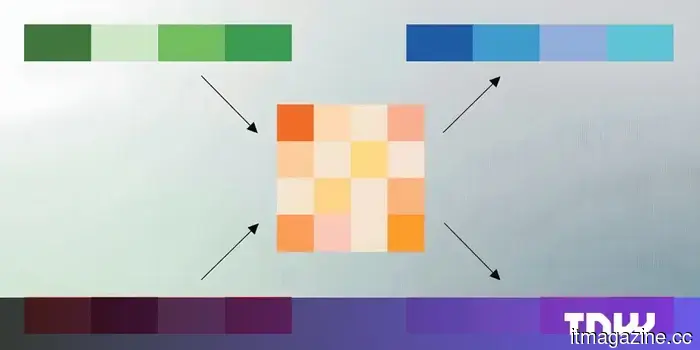

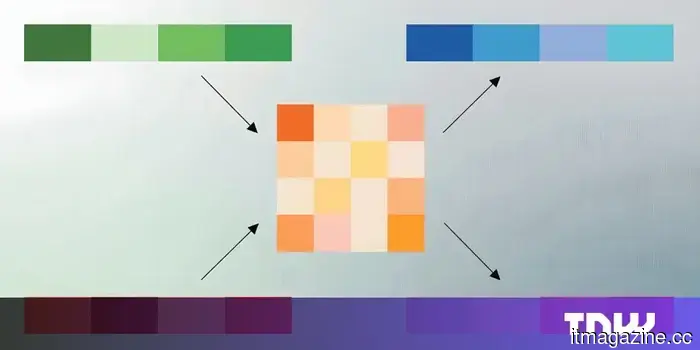

Основная инновация TurboQuant заключается в устранении накладных расходов, которые делают большинство методов сжатия менее эффективными, чем предполагают их заголовочные цифры. Традиционные методы квантизации уменьшают размер векторных данных, но должны хранить дополнительные константы, значения нормализации, которые системе нужны для точного декомпрессирования данных. Эти константы обычно добавляют одну или две дополнительные бита на число, частично отменяя сжатие.

💜 технологий ЕС Последние новости из технологической сцены ЕС, история от нашего мудрого основателя Бориса и немного сомнительного ИИ-арта. Это бесплатно, каждую неделю, в вашем почтовом ящике. Подпишитесь сейчас! TurboQuant избегает этого с помощью двухступенчатого процесса. Первая стадия, называемая PolarQuant, преобразует векторные данные из стандартных декартовых координат в полярные координаты, разделяя каждый вектор на величину и набор углов. Поскольку угловые распределения следуют предсказуемым, концентрированным паттернам, система может полностью пропустить дорогой шаг нормализации на блоке. Вторая стадия применяет QJL, технику, основанную на преобразовании Джонсона-Линденштрауса, которая уменьшает небольшую остаточную ошибку с первой стадии до одного знакового бита на размерность. Совокупный результат — это представление, которое использует большую часть своего бюджета на сжатие для захвата смысла оригинальных данных и минимального остаточного бюджета на коррекцию ошибок, без накладных расходов на константы нормализации.

Google протестировал TurboQuant по пяти стандартным бенчмаркам для языковых моделей с длинным контекстом, включая LongBench, Needle in a Haystack и ZeroSCROLLS, используя открытые модели из семейств Gemma, Mistral и Llama. При 3 битах TurboQuant соответствовал или превосходил KIVI, текущую стандартную базу для квантизации кеша ключ-значение, которая была опубликована на ICML 2024. В задачах извлечения needle-in-a-haystack, которые проверяют, может ли модель найти единственный кусок информации, зарытый в длинном отрывке, TurboQuant достиг идеальных результатов, сжимая кеш в шесть раз. При 4-битной точности алгоритм обеспечивал до восьми раз ускорение в вычислении внимания на GPU Nvidia H100 по сравнению с неконпрессированной 32-битной базой.

Что услышал рынок

Реакция акций была быстрой и, по мнению нескольких аналитиков, несоразмерной. Аналитик Wells Fargo Эндрю Роча отметил, что TurboQuant напрямую атакует кривую затрат на память в системах ИИ. Если его широко примут, сказал он, это быстро поднимает вопрос о том, сколько памяти на самом деле нужно индустрии. Но Роча и другие также предостерегли, что картина спроса на память для ИИ остается сильной, и что алгоритмы сжатия существуют уже много лет, не изменяя объемы закупок.

Тем не менее, беспокойство не безосновательно. Расходы на инфраструктуру ИИ растут необычайными темпами, при этом только Meta обязалась потратить до 27 миллиардов долларов в недавней сделке с Nebius на выделенные вычислительные мощности, а Google, Microsoft и Amazon в совокупности планируют сотни миллиардов на капитальные расходы на дата-центры до 2026 года. Технология, которая снижает требования к памяти в шесть раз, не снижает расходы в шесть раз, потому что память — это только один компонент стоимости дата-центра. Но она меняет соотношение, и в индустрии, тратящей средства в таких масштабах, даже незначительные приросты эффективности быстро складываются.

Вопрос эффективности

TurboQuant появляется в момент, когда индустрия ИИ вынуждена столкнуться с экономикой вывода. Обучение модели — это одноразовая стоимость, как бы огромна она ни была. Запуск её, обслуживание миллионов запросов в день с приемлемой задержкой и точностью — это повторяющиеся расходы, которые определяют, являются ли продукты ИИ финансово жизнеспособными в больших масштабах. Кеш ключ-значение является центральным в этом расчете: это узкое место, которое ограничивает, сколько одновременно пользователей может обслуживать один GPU и насколько долго окно контекста модель может практически поддерживать.

Методы сжатия, такие как TurboQuant, являются частью более широкого стремления сделать выводы дешевле, наряду с улучшениями аппаратного обеспечения, такими как архитектура Vera Rubin от Nvidia и собственные TPU Ironwood от Google. Вопрос в том, снизят ли эти приросты эффективности общее количество аппаратного обеспечения, которое индустрия покупает, или они просто позволят более амбициозные развертывания примерно за ту же цену. История вычислений предполагает последнее: когда хранение становится дешевле, люди хранят больше; когда пропускная способность увеличивается, приложения потребляют её.

Для Google TurboQuant также имеет прямое коммерческое применение за пределами языковых моделей. В блоге отмечается, что алгоритм улучшает векторный поиск, технологию, которая обеспечивает семантические сопоставления по миллиардам элементов. Google протестировал его по сравнению с существующими методами на наборе данных бенчмарка GloVe и обнаружил, что он достиг лучших коэффициентов полноты, не требуя больших кодовых книг или настройки под конкретные наборы данных, которые требуют конкурирующие подходы. Это важно, потому что векторный поиск лежит в основе всего, от поиска Google до рекомендаций YouTube и таргетинга рекламы, что означает, что он лежит в основе доходов Google.

Вклад статьи реален: метод сжатия без обучения, который достигает измеримо лучших результатов, чем существующее состояние искусства, с сильными теоретическими основами и практической реализацией на производственном оборудовании. Будет ли он переосмыслять экономику инфраструктуры ИИ или просто станет еще одной оптимизацией, поглощенной ненасытным аппетитом индустрии к вычислениям — вопрос, на который рынок ответит в течение месяцев, а не часов.

Другие статьи

Это может быть наш первый взгляд на предстоящий Galaxy Z Fold 8 от Samsung.

Слившиеся CAD-рендеры Galaxy Z Fold 8 Wide показывают более широкий и короткий складной телефон, который Samsung разрабатывает специально для конкуренции с первым складным iPhone от Apple.

Это может быть наш первый взгляд на предстоящий Galaxy Z Fold 8 от Samsung.

Слившиеся CAD-рендеры Galaxy Z Fold 8 Wide показывают более широкий и короткий складной телефон, который Samsung разрабатывает специально для конкуренции с первым складным iPhone от Apple.

Samsung Galaxy A57 и A37 здесь с новыми чипами и более умными камерами

Официально представлены Samsung Galaxy A57 и A37, которые предлагают новые процессоры Exynos, улучшенную ночную фотографию и знакомые основы среднего сегмента.

Samsung Galaxy A57 и A37 здесь с новыми чипами и более умными камерами

Официально представлены Samsung Galaxy A57 и A37, которые предлагают новые процессоры Exynos, улучшенную ночную фотографию и знакомые основы среднего сегмента.

ТурбоКвант от Google сжимает память ИИ в 6 раз, потрясая акции чипов

Алгоритм TurboQuant от Google сжимает кэши ключ-значение LLM до 3 бит без потери точности. Акции памяти упали в течение нескольких часов после объявления.

ТурбоКвант от Google сжимает память ИИ в 6 раз, потрясая акции чипов

Алгоритм TurboQuant от Google сжимает кэши ключ-значение LLM до 3 бит без потери точности. Акции памяти упали в течение нескольких часов после объявления.

Гемини на Google TV теперь может отвечать на ваши вопросы, обучать концепциям и предоставлять спортивные сводки.

Google добавляет функции Gemini в Google TV, которые позволяют вам задавать вопросы, исследовать темы и оставаться в курсе спортивных новостей, все в одном месте.

Гемини на Google TV теперь может отвечать на ваши вопросы, обучать концепциям и предоставлять спортивные сводки.

Google добавляет функции Gemini в Google TV, которые позволяют вам задавать вопросы, исследовать темы и оставаться в курсе спортивных новостей, все в одном месте.

Новое приложение хочет излечить одиночество, заставив людей оторваться от телефонов и собраться в одной комнате.

Стартап под названием Friending запустил социальную платформу, основанную на предпосылке, которая звучит почти устарело в 2026 году: помощь людям в заведении друзей через личные встречи. Приложение, основанное в Роли, Северная Каролина, соединяет пользователей по общим интересам.

Новое приложение хочет излечить одиночество, заставив людей оторваться от телефонов и собраться в одной комнате.

Стартап под названием Friending запустил социальную платформу, основанную на предпосылке, которая звучит почти устарело в 2026 году: помощь людям в заведении друзей через личные встречи. Приложение, основанное в Роли, Северная Каролина, соединяет пользователей по общим интересам.

Meta и YouTube признаны ответственными в знаковом судебном процессе по зависимости от социальных сетей

Жюри Лос-Анджелеса признало, что Meta и YouTube намеренно создали зависимые платформы, которые нанесли вред молодому пользователю, в первом вердикте из 1,500 ожидающих дел.

Meta и YouTube признаны ответственными в знаковом судебном процессе по зависимости от социальных сетей

Жюри Лос-Анджелеса признало, что Meta и YouTube намеренно создали зависимые платформы, которые нанесли вред молодому пользователю, в первом вердикте из 1,500 ожидающих дел.

ТурбоКвант от Google сжимает память ИИ в 6 раз, потрясая акции чипов

Алгоритм TurboQuant от Google сжимает кэши ключ-значение LLM до 3 бит без потери точности. Акции памяти упали в течение нескольких часов после объявления.