Il TurboQuant di Google comprime la memoria AI di 6 volte, scuotendo le azioni dei chip.

Google ha pubblicato martedì un post sul blog di ricerca riguardante un nuovo algoritmo di compressione per modelli di intelligenza artificiale. Nel giro di poche ore, le azioni delle aziende di memoria hanno iniziato a scendere. Micron è scesa del 3%, Western Digital ha perso il 4,7% e SanDisk è calata del 5,7%, mentre gli investitori ricalcolavano quanto spazio di memoria fisica l'industria dell'IA potrebbe effettivamente necessitare.

L'algoritmo si chiama TurboQuant e affronta uno dei colli di bottiglia più costosi nell'esecuzione di grandi modelli linguistici: la cache chiave-valore, un'archiviazione dati ad alta velocità che conserva le informazioni di contesto in modo che il modello non debba ricalcolarle con ogni nuovo token che genera. Man mano che i modelli elaborano input più lunghi, la cache cresce rapidamente, consumando memoria GPU che altrimenti potrebbe essere utilizzata per servire più utenti o eseguire modelli più grandi. TurboQuant comprime la cache a soli 3 bit per valore, rispetto ai 16 standard, riducendo il suo ingombro di memoria di almeno sei volte senza, secondo i benchmark di Google, alcuna perdita misurabile di accuratezza.

Il documento, che sarà presentato all'ICLR 2026, è stato redatto da Amir Zandieh, un ricercatore di Google, e Vahab Mirrokni, un vicepresidente e Google Fellow, insieme a collaboratori di Google DeepMind, KAIST e New York University. Si basa su due articoli precedenti dello stesso gruppo: QJL, pubblicato all'AAAI 2025, e PolarQuant, che apparirà all'AISTATS 2026.

Come funziona

L'innovazione principale di TurboQuant è l'eliminazione dell'overhead che rende la maggior parte delle tecniche di compressione meno efficaci di quanto suggeriscano i loro numeri principali. I metodi di quantizzazione tradizionali riducono la dimensione dei vettori di dati ma devono memorizzare costanti aggiuntive, valori di normalizzazione di cui il sistema ha bisogno per decomprimere i dati in modo accurato. Queste costanti tipicamente aggiungono uno o due bit extra per numero, annullando parzialmente la compressione.

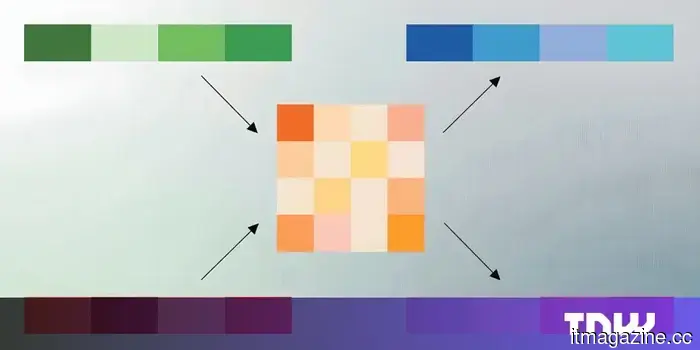

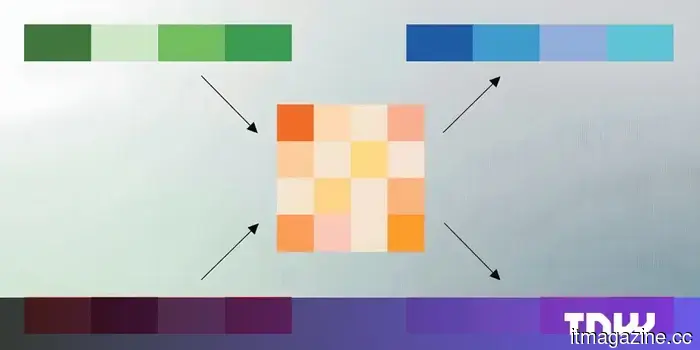

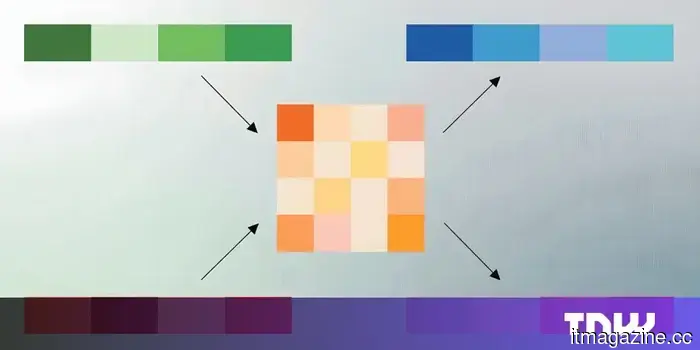

TurboQuant evita questo attraverso un processo in due fasi. La prima fase, chiamata PolarQuant, converte i vettori di dati da coordinate cartesiane standard in coordinate polari, separando ogni vettore in una grandezza e un insieme di angoli. Poiché le distribuzioni angolari seguono schemi prevedibili e concentrati, il sistema può saltare completamente il costoso passaggio di normalizzazione per blocco. La seconda fase applica QJL, una tecnica basata sulla trasformazione di Johnson-Lindenstrauss, che riduce il piccolo errore residuo dalla prima fase a un singolo bit di segno per dimensione. Il risultato combinato è una rappresentazione che utilizza la maggior parte del suo budget di compressione per catturare il significato dei dati originali e un budget residuo minimo per la correzione degli errori, senza overhead sprecato per le costanti di normalizzazione.

Google ha testato TurboQuant su cinque benchmark standard per modelli linguistici a lungo contesto, tra cui LongBench, Needle in a Haystack e ZeroSCROLLS, utilizzando modelli open-source delle famiglie Gemma, Mistral e Llama. A 3 bit, TurboQuant ha eguagliato o superato KIVI, l'attuale baseline standard per la quantizzazione della cache chiave-valore, pubblicata all'ICML 2024. Nei compiti di recupero needle-in-a-haystack, che testano se un modello può localizzare un singolo pezzo di informazione sepolto in un lungo passaggio, TurboQuant ha ottenuto punteggi perfetti mentre compressava la cache di un fattore sei. A precisione di 4 bit, l'algoritmo ha fornito fino a otto volte l'accelerazione nel calcolo dell'attenzione su GPU Nvidia H100 rispetto alla baseline non compressa di 32 bit.

Cosa ha sentito il mercato

La reazione del mercato azionario è stata rapida e, secondo diversi analisti, sproporzionata. L'analista di Wells Fargo Andrew Rocha ha osservato che TurboQuant attacca direttamente la curva dei costi per la memoria nei sistemi di IA. Se adottato ampiamente, ha detto, solleva rapidamente la questione di quanta capacità di memoria l'industria ha effettivamente bisogno. Ma Rocha e altri hanno anche avvertito che il quadro della domanda per la memoria IA rimane forte e che gli algoritmi di compressione esistono da anni senza alterare fondamentalmente i volumi di approvvigionamento.

Tuttavia, la preoccupazione non è infondata. La spesa per l'infrastruttura IA sta crescendo a tassi straordinari, con Meta che da sola ha impegnato fino a 27 miliardi di dollari in un recente accordo con Nebius per capacità di calcolo dedicata, e Google, Microsoft e Amazon che pianificano collettivamente centinaia di miliardi in spese in conto capitale per i data center fino al 2026. Una tecnologia che riduce i requisiti di memoria di sei volte non riduce la spesa di sei volte, perché la memoria è solo un componente del costo di un data center. Ma cambia il rapporto, e in un'industria che spende a questa scala, anche i guadagni di efficienza marginali si accumulano rapidamente.

La questione dell'efficienza

TurboQuant arriva in un momento in cui l'industria dell'IA è costretta a confrontarsi con l'economia dell'inferenza. Addestrare un modello è un costo una tantum, per quanto enorme. Eseguirlo, servendo milioni di query al giorno con latenza e accuratezza accettabili, è la spesa ricorrente che determina se i prodotti IA sono finanziariamente sostenibili su larga scala. La cache chiave-valore è centrale in questo calcolo: è il collo di bottiglia che limita quanti utenti simultanei una singola GPU può servire e quanto a lungo una finestra di contesto un modello può supportare praticamente.

Tecniche di compressione come TurboQuant fanno parte di una spinta più ampia verso la riduzione dei costi di inferenza, insieme a miglioramenti hardware come l'architettura Vera Rubin di Nvidia e i TPU Ironwood di Google. La domanda è se questi guadagni di efficienza ridurranno la quantità totale di hardware che l'industria acquista, o se semplicemente consentiranno implementazioni più ambiziose a costi sostanzialmente simili. La storia dell'informatica suggerisce la seconda opzione: quando lo stoccaggio diventa più economico, le persone immagazzinano di più; quando la larghezza di banda aumenta, le applicazioni la consumano.

Per Google, TurboQuant ha anche un'applicazione commerciale diretta oltre i modelli linguistici. Il post sul blog nota che l'algoritmo migliora la ricerca vettoriale, la tecnologia che alimenta le ricerche di somiglianza semantica su miliardi di elementi. Google lo ha testato rispetto ai metodi esistenti sul dataset benchmark GloVe e ha scoperto che otteneva rapporti di richiamo superiori senza richiedere i grandi codici o la messa a punto specifica del dataset che le approcci concorrenti richiedono. Questo è importante perché la ricerca vettoriale sostiene tutto, dalle ricerche di Google alle raccomandazioni di YouTube fino al targeting pubblicitario, il che significa che sostiene le entrate di Google.

Il contributo del documento è reale: un metodo di compressione senza addestramento che ottiene risultati misurabilmente migliori rispetto allo stato dell'arte esistente, con solide basi teoriche e implementazione pratica su hardware di produzione. Se rimodella l'economia dell'infrastruttura IA o diventa semplicemente un'ulteriore ottimizzazione assorbita nell'insaziabile appetito dell'industria per il calcolo è una domanda a cui il mercato risponderà nei mesi, non nelle ore.

Altri articoli

Il TurboQuant di Google comprime la memoria AI di 6 volte, scuotendo le azioni dei chip.

L'algoritmo TurboQuant di Google comprime le cache chiave-valore dei LLM a 3 bit senza perdita di precisione. Le azioni di Memory sono scese poche ore dopo l'annuncio.

Il TurboQuant di Google comprime la memoria AI di 6 volte, scuotendo le azioni dei chip.

L'algoritmo TurboQuant di Google comprime le cache chiave-valore dei LLM a 3 bit senza perdita di precisione. Le azioni di Memory sono scese poche ore dopo l'annuncio.

Gemini su Google TV può ora rispondere alle tue domande, insegnare concetti e fornire brevi notizie sportive.

Google sta aggiungendo funzionalità di Gemini a Google TV che ti permettono di fare domande, esplorare argomenti e rimanere aggiornato con notizie sportive, tutto in un unico posto.

Gemini su Google TV può ora rispondere alle tue domande, insegnare concetti e fornire brevi notizie sportive.

Google sta aggiungendo funzionalità di Gemini a Google TV che ti permettono di fare domande, esplorare argomenti e rimanere aggiornato con notizie sportive, tutto in un unico posto.

Completa la tua palestra domestica con gli sconti di marzo di RITFIT

L'allenamento di forza non significa più andare in palestra. La vendita di marzo di RitFit su attrezzature per allenamenti multifunzionali ti aiuterà a creare la tua palestra direttamente a casa. Sia per l'allenamento personale che per regalarlo ad altri appassionati di fitness, il versatile Pacchetto M2 Smith sta ridefinendo gli allenamenti con comodità.

Completa la tua palestra domestica con gli sconti di marzo di RITFIT

L'allenamento di forza non significa più andare in palestra. La vendita di marzo di RitFit su attrezzature per allenamenti multifunzionali ti aiuterà a creare la tua palestra direttamente a casa. Sia per l'allenamento personale che per regalarlo ad altri appassionati di fitness, il versatile Pacchetto M2 Smith sta ridefinendo gli allenamenti con comodità.

Questo potrebbe essere il nostro primo sguardo al prossimo Galaxy Z Fold 8 Wide di Samsung.

I render CAD trapelati del Galaxy Z Fold 8 Wide rivelano un pieghevole più largo e corto che Samsung sta costruendo specificamente per competere con il primo iPhone pieghevole di Apple.

Questo potrebbe essere il nostro primo sguardo al prossimo Galaxy Z Fold 8 Wide di Samsung.

I render CAD trapelati del Galaxy Z Fold 8 Wide rivelano un pieghevole più largo e corto che Samsung sta costruendo specificamente per competere con il primo iPhone pieghevole di Apple.

Questo potrebbe essere il nostro primo sguardo al prossimo Galaxy Z Fold 8 Wide di Samsung.

I render CAD trapelati del Galaxy Z Fold 8 Wide rivelano un pieghevole più largo e più corto che Samsung sta costruendo specificamente per competere con il primo iPhone pieghevole di Apple.

Questo potrebbe essere il nostro primo sguardo al prossimo Galaxy Z Fold 8 Wide di Samsung.

I render CAD trapelati del Galaxy Z Fold 8 Wide rivelano un pieghevole più largo e più corto che Samsung sta costruendo specificamente per competere con il primo iPhone pieghevole di Apple.

Le nuove GPU Arc Pro B70 e B65 di Intel sono progettate per il lavoro con l'IA.

Intel ha lanciato le GPU Arc Pro B70 e B65, progettate per l'inferenza AI e i carichi di lavoro professionali, con fino a 32 GB di memoria GDDR6 e pieno supporto PCIe 5.0.

Le nuove GPU Arc Pro B70 e B65 di Intel sono progettate per il lavoro con l'IA.

Intel ha lanciato le GPU Arc Pro B70 e B65, progettate per l'inferenza AI e i carichi di lavoro professionali, con fino a 32 GB di memoria GDDR6 e pieno supporto PCIe 5.0.

Il TurboQuant di Google comprime la memoria AI di 6 volte, scuotendo le azioni dei chip.

L'algoritmo TurboQuant di Google comprime le cache chiave-valore dei LLM a 3 bit senza perdita di precisione. Le azioni di Memory sono scese poche ore dopo l'annuncio.