Meta termina il contratto con Sama dopo che i lavoratori kenyoti segnalano di aver visto filmati intimi da parte degli utenti degli occhiali smart Ray-Ban.

TL;DRMeta ha terminato il suo contratto con Sama dopo che i lavoratori kenyoti addetti all'annotazione dei dati hanno riferito a giornalisti svedesi di aver visto filmati intimi, inclusi persone che fanno sesso, si svestono e usano il bagno, catturati dagli occhiali smart Ray-Ban di Meta. I 1.108 lavoratori hanno ricevuto sei giorni di preavviso. È seguita una causa collettiva, indagini normative nel Regno Unito e in Kenya, e un avviso dell'EFF. Il caso espone l'infrastruttura umana dietro l'IA: i lavoratori che addestrano i modelli vedono tutto, non possiedono nulla e perdono il lavoro quando ne parlano.

Nel febbraio 2026, i lavoratori di Sama, un'azienda di outsourcing con sede a Nairobi contrattata da Meta, hanno detto ai giornali svedesi Svenska Dagbladet e Göteborgs-Posten di aver esaminato filmati catturati dagli utenti degli occhiali smart Ray-Ban di Meta. I filmati includevano persone che fanno sesso, vanno in bagno, si svestono e mostrano informazioni bancarie. Il compito dei lavoratori era etichettare i contenuti affinché i sistemi di IA di Meta potessero imparare a interpretare ciò che gli occhiali vedono. Meno di due mesi dopo la pubblicazione dell'indagine, Meta ha terminato il contratto con Sama e il 16 aprile la società ha emesso avvisi formali di licenziamento per 1.108 dipendenti. Meta ha dichiarato che Sama "non soddisfa i nostri standard". Sama ha respinto la caratterizzazione e ha affermato di non aver ricevuto alcuna notifica di fallimento. Naftali Wambalo, co-fondatore del Movimento dei Lavoratori Tecnologici Africani, ha sostenuto che la vera ragione era più semplice: Meta stava ritorsionando contro i lavoratori che si erano espressi. Meta non ha risposto a tale accusa. Le persone che hanno addestrato l'IA hanno visto ciò che gli occhiali vedono. Poi hanno perso il lavoro.

Gli occhiali

Meta ha venduto più di sette milioni di paia di occhiali smart Ray-Ban nel 2025, più che triplicando il volume dell'anno precedente. La linea di prodotti si è successivamente ampliata per includere modelli da prescrizione progettati per raggiungere i miliardi di persone che già acquistano occhiali correttivi, convertendo ciò che era una novità in qualcosa di più vicino a un default. Gli occhiali registrano video, catturano foto, trasmettono audio e instradano query attraverso Meta AI, che elabora immagini e comandi vocali sia sul dispositivo che nel cloud. Un piccolo LED sui telai si illumina quando la fotocamera è attiva, che Meta ha descritto come una salvaguardia della privacy. La luce è progettata per le persone intorno all'indossatore, non per l'indossatore stesso. Avvisa gli estranei che stanno venendo registrati. Non dice loro che la registrazione potrebbe essere esaminata da un essere umano in un altro paese, seduto a una scrivania a Nairobi, etichettando ciò che vede affinché un algoritmo possa imparare la differenza tra una cucina e una camera da letto, una stretta di mano e un abbraccio, un documento e un volto.

La politica sulla privacy di Meta per gli occhiali afferma che gli utenti che scelgono di condividere dati per scopi di addestramento dell'IA consentono che i loro filmati siano elaborati dai sistemi di IA dell'azienda. La politica non si sofferma sul livello umano tra la fotocamera e l'algoritmo. I dati di addestramento dell'IA non si etichettano da soli. Prima che un modello possa imparare a interpretare una scena, una persona deve prima guardare la scena e descriverla. L'indagine svedese ha rivelato come appare quel processo nella pratica: lavoratori in Kenya, impiegati da un appaltatore terzo, che osservano i momenti più privati della vita di estranei, catalogandoli e passando al clip successivo. I filmati non erano anonimizzati prima della revisione. I lavoratori potevano vedere volti, corpi e documenti personali. Non avevano modo di contattare le persone filmate, nessun meccanismo per segnalare filmati che credevano fossero stati catturati senza consenso e nessuna autorità per rifiutare il lavoro senza rischiare il loro impiego.

I lavoratori

Il 💜 della tecnologia dell'UE Gli ultimi rumori dalla scena tecnologica dell'UE, una storia dal nostro saggio fondatore Boris e alcune opere d'arte AI discutibili. È gratuito, ogni settimana, nella tua casella di posta. Iscriviti ora!Sama è stata fondata nel 2008 come impresa sociale con la missione dichiarata di fornire lavoro digitale dignitoso a persone in comunità a basso reddito. L'azienda ha operazioni in Kenya, Uganda e India, e ha fornito servizi di annotazione dei dati ad alcune delle più grandi aziende tecnologiche del mondo, tra cui Google, Microsoft e Meta. Il contratto con Meta per l'annotazione dei dati degli occhiali smart era uno dei diversi contratti che Sama aveva con l'azienda. I lavoratori erano incaricati di etichettare immagini e video catturati dagli occhiali per addestrare i modelli di IA di Meta, un processo che richiedeva loro di visualizzare, categorizzare e descrivere ciò che le telecamere avevano registrato.

L'indagine svedese, pubblicata alla fine di febbraio 2026, ha riportato che i lavoratori hanno descritto di aver visto utenti impegnati in attività sessuali, usare il bagno, svestirsi e visualizzare informazioni finanziarie sullo schermo. Il contenuto non era eccezionale. Era il residuo ordinario di una telecamera indossata sul volto di qualcuno per tutto il giorno, catturando qualsiasi cosa l'indossatore stesse guardando. I lavoratori hanno detto ai giornalisti che l'esperienza era angosciante ma che avevano opzioni limitate: il lavoro pagava meglio della maggior parte delle alternative disponibili e i contratti di Sama includevano tipicamente accordi di non divulgazione che scoraggiavano la discussione pubblica dei contenuti che esaminavano. Quando le pubblicazioni svedesi hanno pubblicato la notizia, hanno dato ai lavoratori una voce che non era stata precedentemente consentita.

Il 16 aprile, meno di sette settimane dopo la pubblicazione dell'indagine, Sama ha notificato a 1.108 dipendenti che le loro posizioni erano state dichiarate ridondanti. I lavoratori hanno ricevuto sei giorni di preavviso. La dichiarazione di Meta ha attribuito la cessazione al mancato rispetto degli standard da parte di Sama, ma ha rifiutato di specificare quali standard fossero stati violati o quando fosse stata effettuata la valutazione. Sama ha dichiarato di essere stata "sorpresa e delusa" dalla decisione di Meta e che non era stata informata di alcun calo delle prestazioni prima della cessazione. Il tempismo è stato notato da sostenitori dei diritti dei lavoratori, regolatori e dagli stessi lavoratori. Wambalo, la cui organizzazione rappresenta i lavoratori dei dati in tutto il continente, ha descritto il ragionamento di Meta come una copertura per ritorsioni: l'azienda, ha detto, stava imponendo "standard di segretezza" piuttosto che standard di qualità.

Il modello

Questa non è la prima volta che la relazione di Sama con Meta termina in polemica. Tra il 2019 e il 2023, Sama ha impiegato moderatori di contenuti a Nairobi che esaminavano post segnalati come potenzialmente in violazione degli standard della comunità di Facebook. Il lavoro richiedeva ai moderatori di visualizzare violenza grafica, abusi sessuali, discorsi d'odio e altro materiale disturbante per ore ogni giorno, spesso con salari così bassi come 1,50 dollari all'ora. Un'indagine del 2022 della rivista Time ha scoperto che l'81% dei 144 moderatori di contenuti di Sama che hanno subito una valutazione clinica sono stati diagnosticati con sintomi "gravi" o "estremamente gravi" di disturbo da stress post-traumatico. Ex lavoratori hanno intentato cause legali in Kenya sostenendo che Sama e Meta li avevano sottoposti a condizioni equivalenti alla tratta di esseri umani e avevano interferito con i loro tentativi di formare un sindacato. Sama ha successivamente dichiarato pubblicamente di "rimpiangere" di aver intrapreso il lavoro di moderazione dei contenuti e ha abbandonato l'attività nel 2023 per concentrarsi su quelli che ha descritto come servizi di annotazione dei dati

Другие статьи

L'industria del micro-drama cinese da 16,5 miliardi di dollari diventa la prima applicazione di massa al mondo di video generati da intelligenza artificiale.

50.000 micro-drammi AI hanno colpito Douyin in un mese. I costi di produzione sono diminuiti del 90%. I sussidi statali finanziano i centri. L'industria dei micro-drammi in Cina è il primo test su scala commerciale dei contenuti generati dall'IA.

L'industria del micro-drama cinese da 16,5 miliardi di dollari diventa la prima applicazione di massa al mondo di video generati da intelligenza artificiale.

50.000 micro-drammi AI hanno colpito Douyin in un mese. I costi di produzione sono diminuiti del 90%. I sussidi statali finanziano i centri. L'industria dei micro-drammi in Cina è il primo test su scala commerciale dei contenuti generati dall'IA.

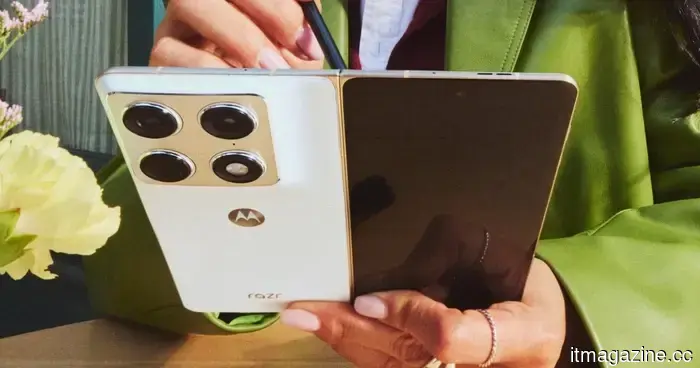

La batteria da 6.000 mAh del Razr Fold dovrebbe preoccupare Samsung e Google: Ecco perché

Samsung e Google hanno trascorso anni a guidare il mercato dei pieghevoli negli Stati Uniti, ignorando silenziosamente il suo più grande difetto. Motorola è appena entrata in scena e ha reso molto difficile ignorarlo.

La batteria da 6.000 mAh del Razr Fold dovrebbe preoccupare Samsung e Google: Ecco perché

Samsung e Google hanno trascorso anni a guidare il mercato dei pieghevoli negli Stati Uniti, ignorando silenziosamente il suo più grande difetto. Motorola è appena entrata in scena e ha reso molto difficile ignorarlo.

Il fatturato di Reddit nel primo trimestre aumenta del 69% a 663 milioni di dollari e le azioni salgono del 9%

Reddit ha riportato un fatturato del primo trimestre 2026 di 663 milioni di dollari (+69% su base annua), superando le stime in ogni voce, e ha alzato le previsioni per il secondo trimestre sopra il consenso.

Il fatturato di Reddit nel primo trimestre aumenta del 69% a 663 milioni di dollari e le azioni salgono del 9%

Reddit ha riportato un fatturato del primo trimestre 2026 di 663 milioni di dollari (+69% su base annua), superando le stime in ogni voce, e ha alzato le previsioni per il secondo trimestre sopra il consenso.

SpaceX ha speso più di 15 miliardi di dollari per Starship

SpaceX ha speso più di 15 miliardi di dollari per sviluppare Starship e sta puntando a una cadenza di lancio 'simile a quella delle compagnie aeree'.

SpaceX ha speso più di 15 miliardi di dollari per Starship

SpaceX ha speso più di 15 miliardi di dollari per sviluppare Starship e sta puntando a una cadenza di lancio 'simile a quella delle compagnie aeree'.

La modalità Xbox sta arrivando su tutti i PC Windows, offrendo un'esperienza a schermo intero.

La modalità Xbox sta arrivando sui PC, laptop e tablet Windows 11, offrendo un'esperienza di gioco a schermo intero e adatta ai controller a più giocatori che mai.

La modalità Xbox sta arrivando su tutti i PC Windows, offrendo un'esperienza a schermo intero.

La modalità Xbox sta arrivando sui PC, laptop e tablet Windows 11, offrendo un'esperienza di gioco a schermo intero e adatta ai controller a più giocatori che mai.

L'industria del micro-drama cinese da 16,5 miliardi di dollari diventa la prima applicazione di massa al mondo di video generati da IA.

50.000 micro-drammi AI hanno colpito Douyin in un mese. I costi di produzione sono diminuiti del 90%. I sussidi statali finanziano i centri. L'industria dei micro-drammi in Cina è il primo test su scala commerciale dei contenuti generati dall'AI.

L'industria del micro-drama cinese da 16,5 miliardi di dollari diventa la prima applicazione di massa al mondo di video generati da IA.

50.000 micro-drammi AI hanno colpito Douyin in un mese. I costi di produzione sono diminuiti del 90%. I sussidi statali finanziano i centri. L'industria dei micro-drammi in Cina è il primo test su scala commerciale dei contenuti generati dall'AI.

Meta termina il contratto con Sama dopo che i lavoratori kenyoti segnalano di aver visto filmati intimi da parte degli utenti degli occhiali smart Ray-Ban.

1.108 lavoratori kenioti hanno perso il lavoro dopo aver detto ai giornalisti di aver visto utenti avere rapporti sessuali e spogliarsi attraverso le riprese delle smart glasses di Meta. I regolatori e gli avvocati hanno risposto.