Эксперт предупреждает, что OpenAI демонстрирует ‘очень опасный менталитет" в отношении безопасности

Пекселс

Эксперт по искусственному интеллекту обвинил OpenAI в том, что она переписывает свою историю и чрезмерно пренебрегает вопросами безопасности.

Бывший исследователь политики OpenAI Майлз Брандейдж раскритиковал недавний документ компании по безопасности и согласованию, опубликованный на этой неделе. В документе OpenAI описывается как стремящийся к созданию искусственного интеллекта общего назначения (AGI) многими маленькими шагами, а не совершающий “один гигантский скачок”, говорится, что процесс итеративного развертывания позволит ему выявлять проблемы безопасности и изучать потенциал неправильного использования ИИ на каждом этапе.

Среди многочисленных критических замечаний в адрес технологий искусственного интеллекта, таких как ChatGPT, эксперты обеспокоены тем, что чат-боты будут предоставлять неточную информацию о здоровье и безопасности (например, печально известная проблема с функцией искусственного поиска Google, которая заставляла людей есть камни) и что они могут быть использованы для политических манипуляций, дезинформации и мошенничества. OpenAI, в частности, подверглась критике за отсутствие прозрачности в разработке своих моделей искусственного интеллекта, которые могут содержать конфиденциальные персональные данные.

Публикация документа OpenAI на этой неделе, по-видимому, является ответом на эти опасения, и в документе подразумевается, что разработка предыдущей модели GPT-2 была “прерывистой” и что изначально она не была выпущена из-за “опасений по поводу вредоносных приложений”, но теперь компания будет продвигаться к более эффективной разработке. вместо этого используется принцип итеративной разработки. Но Брандейдж утверждает, что документ изменяет повествование и не является точным описанием истории развития искусственного интеллекта в OpenAI.

“Выпуск OpenAI GPT-2, в котором я принимал участие, был на 100% последовательным и предвосхитил текущую философию OpenAI, основанную на итеративном развертывании”, - написал Брандейдж на X. “Модель выпускалась поэтапно, на каждом этапе делились уроками. Многие эксперты по безопасности в то время благодарили нас за это предостережение”.

Брандейдж также раскритиковал очевидный подход компании к оценке рисков, основанный на этом документе, написав, что “Создается впечатление, что в этом разделе, где проблемы носят панический характер, налагается бремя доказывания + вам нужны неопровержимые доказательства неминуемой опасности, чтобы принять меры в отношении них – в противном случае просто продолжайте поставки. Это очень опасный образ мышления для продвинутых систем искусственного интеллекта”.

Это происходит в то время, когда OpenAI подвергается все более пристальному вниманию из-за обвинений в том, что он отдает приоритет “блестящим продуктам”, а не безопасности.

Джорджина уже шесть лет работает в Digital Trends space writer, освещая исследования человеком космоса, планетарную безопасность.…

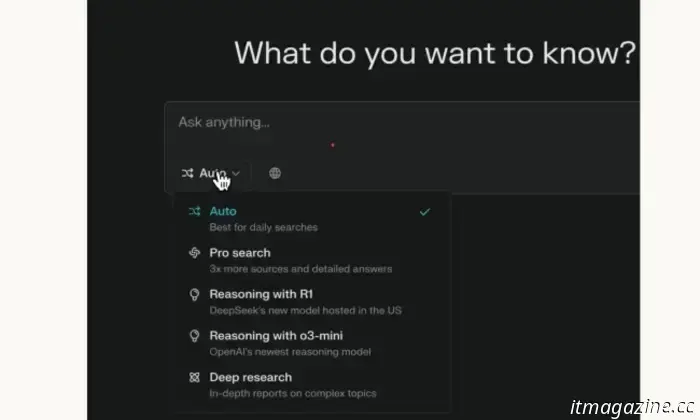

Компания Perplexity предлагает Gemini и ChatGPT фантастическую бесплатную услугу для чат-бота с искусственным интеллектом

Что, если вы попросите чат-бота с искусственным интеллектом выполнить поиск в Интернете, найти определенный источник, а затем создать подробный отчет на основе всей собранной информации? Что ж, Gemini может делать это за 20 долларов в месяц. Или за 200 долларов в месяц, если вы предпочитаете общаться в чате.

Perplexity будет делать это бесплатно. То есть несколько раз в день. Perplexity называет свой новейший инструмент "Глубокое исследование". Так же, как OpenAI. И Google Gemini перед этим.

Подробнее

Маск не будет гоняться за OpenAI со своими миллиардами, пока он остается некоммерческим.

Илон Маск был одним из основателей OpenAI, но ушел из него еще до того, как ChatGPT стал популярным. Миллиардер утверждает, что его не устраивал поворот некоммерческой организации к бизнес-модели, ориентированной на получение прибыли. Несколько дней назад Маск подал заявку на покупку некоммерческого подразделения OpenAI за 97,4 миллиарда долларов, но теперь говорит, что откажется от этого предложения, если гигант искусственного интеллекта откажется от своих коммерческих амбиций.

“Если правление OpenAI будет готово сохранить миссию благотворительной организации и согласится снять со своих активов гриф "продается", приостановив их конвертацию, Маск отзовет заявку”, - говорится в судебном иске, представленном адвокатом миллиардера, сообщает Reuters.

Подробнее

OpenAI прекращает выпуск своей модели o3 и заменит ее на "GPT-5’

Генеральный директор OpenAI Сэм Альтман объявил в среду в X post, что компания фактически отказывается от модели o3 в пользу "упрощенной" GPT-5, которая будет выпущена в ближайшие месяцы.

https://x.com/sama/status/1889755723078443244

Подробнее

Другие статьи

-Max-movies-you-should-watch-this-weekend-(March-7-9).jpg) 3 самых недооцененных фильма (HBO), которые вам стоит посмотреть в эти выходные (7-9 марта)

С 7 по 9 марта смотрите на Max эти три недооцененных фильма: романтическую комедию с участием ансамбля, трагический спортивный байопик и захватывающую драму от недавнего лауреата премии "Оскар".

3 самых недооцененных фильма (HBO), которые вам стоит посмотреть в эти выходные (7-9 марта)

С 7 по 9 марта смотрите на Max эти три недооцененных фильма: романтическую комедию с участием ансамбля, трагический спортивный байопик и захватывающую драму от недавнего лауреата премии "Оскар".

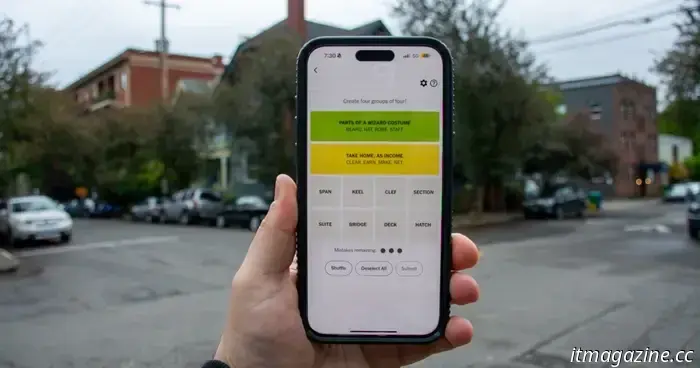

NYT Connections: советы и ответы на вопросы в пятницу, 7 марта

"Связи" - это новая игра-головоломка от New York Times, и она может быть довольно сложной. Если вам нужна помощь в решении сегодняшней головоломки, мы всегда готовы помочь.

NYT Connections: советы и ответы на вопросы в пятницу, 7 марта

"Связи" - это новая игра-головоломка от New York Times, и она может быть довольно сложной. Если вам нужна помощь в решении сегодняшней головоломки, мы всегда готовы помочь.

.jpg) 3 недооцененных фильма Amazon Prime Video, которые вам стоит посмотреть в эти выходные (7-9 марта)

Все эти три фильма превосходны, но представляют собой все то разнообразие, которое вы можете найти на Amazon Prime Video, если захотите посмотреть.

3 недооцененных фильма Amazon Prime Video, которые вам стоит посмотреть в эти выходные (7-9 марта)

Все эти три фильма превосходны, но представляют собой все то разнообразие, которое вы можете найти на Amazon Prime Video, если захотите посмотреть.

Концовка "Микки 17", объясненная

Вышел научно-фантастический комедийный фильм Пон Чжун Хо "Микки 17", представляющий собой вдумчивую историю, которая намекает на мрачное будущее человечества и будущее Бонга вместе с франшизой.

Концовка "Микки 17", объясненная

Вышел научно-фантастический комедийный фильм Пон Чжун Хо "Микки 17", представляющий собой вдумчивую историю, которая намекает на мрачное будущее человечества и будущее Бонга вместе с франшизой.

.jpg) 3 недооцененных фильма Netflix, которые вам стоит посмотреть в эти выходные (7-9 марта)

Хотите посмотреть недооцененные фильмы в эти выходные? У Netflix есть множество интересных предложений, в том числе инди-драмы, уникальные антологии и захватывающие фильмы.

3 недооцененных фильма Netflix, которые вам стоит посмотреть в эти выходные (7-9 марта)

Хотите посмотреть недооцененные фильмы в эти выходные? У Netflix есть множество интересных предложений, в том числе инди-драмы, уникальные антологии и захватывающие фильмы.

Прямо сейчас этот игровой монитор Samsung с частотой 144 Гц продается со скидкой в 400 долларов

43-дюймовый игровой монитор Samsung Odyssey Neo G7 smart с частотой обновления 144 Гц и временем отклика 1 мс поступил в продажу от Samsung по более доступной цене - 600 долларов.

Прямо сейчас этот игровой монитор Samsung с частотой 144 Гц продается со скидкой в 400 долларов

43-дюймовый игровой монитор Samsung Odyssey Neo G7 smart с частотой обновления 144 Гц и временем отклика 1 мс поступил в продажу от Samsung по более доступной цене - 600 долларов.

Эксперт предупреждает, что OpenAI демонстрирует ‘очень опасный менталитет" в отношении безопасности

Бывший исследователь политики OpenAI Майлз Брандейдж раскритиковал OpenAI за то, что она переписала свою историю и чрезмерно пренебрегла соображениями безопасности.