OpenAI mostra una "mentalità molto pericolosa" in materia di sicurezza, avverte l'esperto

Pexel

Un esperto di IA ha accusato OpenAI di riscrivere la sua storia e di essere eccessivamente sprezzante dei problemi di sicurezza.

L'ex ricercatore di politica OpenAI Miles Brundage ha criticato il recente documento di sicurezza e allineamento della società pubblicato questa settimana. Il documento descrive OpenAI come uno sforzo per l'intelligenza artificiale generale (AGI) in molti piccoli passi, piuttosto che fare “un salto da gigante”, dicendo che il processo di implementazione iterativa consentirà di cogliere i problemi di sicurezza ed esaminare il potenziale uso improprio dell'IA in ogni fase.

Tra le molte critiche alla tecnologia AI come ChatGPT, gli esperti sono preoccupati che i chatbot forniscano informazioni inaccurate in materia di salute e sicurezza (come il famigerato problema con la funzione di ricerca AI di Google che istruiva le persone a mangiare rocce) e che potrebbero essere utilizzati per manipolazioni politiche, disinformazione e truffe. OpenAI in particolare ha attirato critiche per la mancanza di trasparenza nel modo in cui sviluppa i suoi modelli di intelligenza artificiale, che possono contenere dati personali sensibili.

Il rilascio del documento OpenAI questa settimana sembra essere una risposta a queste preoccupazioni, e il documento implica che lo sviluppo del precedente modello GPT-2 era “discontinuo” e che non è stato inizialmente rilasciato a causa di “preoccupazioni per le applicazioni dannose”, ma ora l'azienda si muoverà verso un principio di sviluppo iterativo. Ma Brundage sostiene che il documento sta alterando la narrazione e non è una rappresentazione accurata della storia dello sviluppo dell'IA presso OpenAI.

"Il rilascio di OpenAI di GPT-2, in cui ero coinvolto, era coerente al 100% + prefigurava l'attuale filosofia di OpenAI di implementazione iterativa”, ha scritto Brundage su X. “Il modello è stato rilasciato in modo incrementale, con lezioni condivise ad ogni passo. Molti esperti di sicurezza al momento ci hanno ringraziato per questa cautela.”

Brundage ha anche criticato l'approccio apparente della società al rischio basato su questo documento, scrivendo che " Sembra che ci sia un onere della prova in questa sezione in cui le preoccupazioni sono allarmistiche + hai bisogno di prove schiaccianti di pericoli imminenti per agire su di loro – altrimenti, continua a spedire. Questa è una mentalità molto pericolosa per i sistemi di intelligenza artificiale avanzati.”

Ciò avviene in un momento in cui OpenAI è sempre più sotto controllo con accuse che danno priorità ai “prodotti lucidi” rispetto alla sicurezza.

Georgina è stata la scrittrice spaziale di Digital Trends space writer per sei anni, coprendo l'esplorazione spaziale umana, planetaria…

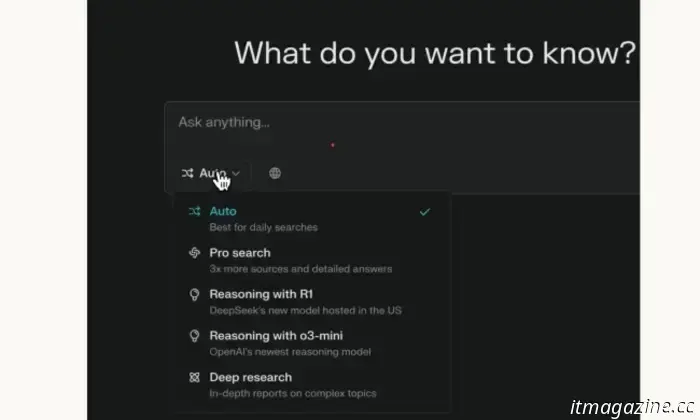

Perplessità one-up Gemini e ChatGPT con un fantastico omaggio AI

Cosa succede se dici a un chatbot AI di cercare sul Web, cercare un certo tipo di fonte e quindi creare un rapporto dettagliato basato su tutte le informazioni che ha raccolto? Bene, Gemini può farlo, per $20 al mese. O $200 ogni mese, se si preferisce ChatGPT.

Perplessità lo farà gratuitamente. Un paio di volte al giorno, cioè. Perplessità sta chiamando il suo ultimo strumento, Ricerca profonda. Proprio come OpenAI. E Google Gemini prima di esso.

Leggi di più

Musk non inseguirà OpenAI con i suoi miliardi finché rimarrà senza scopo di lucro

Elon Musk è stato uno dei membri fondatori di OpenAI, ma ha fatto un'uscita acida prima che ChatGPT diventasse una cosa. Il miliardario afferma di non essere contento del perno del non-profit verso un modello di business a caccia di profitti. Pochi giorni fa, Musk ha presentato un'offerta per acquistare il braccio no-profit di OpenAI per 97,4 miliardi di dollari, ma ora dice che ritirerà l'offerta se il gigante dell'IA abbandonerà le sue ambizioni for-profit.

"Se (il) consiglio di OpenAI è pronto a preservare la missione della carità e stipulare di togliere il segno" per la vendita” dai suoi beni fermando la sua conversione, Musk ritirerà l'offerta", dice un deposito giudiziario presentato dall'avvocato del miliardario, secondo Reuters.

Leggi di più

OpenAI nixes la sua versione del modello o3, lo sostituirà con’GPT-5'

Il CEO di OpenAI Sam Altman ha annunciato tramite un post X mercoledì che il modello o3 della società viene effettivamente messo da parte a favore di un GPT-5 "semplificato" che verrà rilasciato nei prossimi mesi.

https://x.com/sama/status/1889755723078443244

Leggi di più

Altri articoli

Honor Magic V4 camera leak suggerisce un altro pieghevole di riferimento

Un leaker ha rivelato le specifiche della fotocamera per l'imminente Honor Magic V4, e sembrano piuttosto folli.

Honor Magic V4 camera leak suggerisce un altro pieghevole di riferimento

Un leaker ha rivelato le specifiche della fotocamera per l'imminente Honor Magic V4, e sembrano piuttosto folli.

Graftech ha sviluppato il proprio convertitore di file Microsoft Visio

Graftech ha presentato una nuova versione dell'editor di schemi tecnici e aziendali Autograph standard 3.0.0. L'innovazione più importante è stata il proprio motore grafico e convertitore, che consente di aprire e modificare i file Microsoft Visio (VSDX) senza perdita di qualità. Questo è stato un significativo passo avanti, poiché in precedenza il lavoro con tali formati era limitato.

Graftech ha sviluppato il proprio convertitore di file Microsoft Visio

Graftech ha presentato una nuova versione dell'editor di schemi tecnici e aziendali Autograph standard 3.0.0. L'innovazione più importante è stata il proprio motore grafico e convertitore, che consente di aprire e modificare i file Microsoft Visio (VSDX) senza perdita di qualità. Questo è stato un significativo passo avanti, poiché in precedenza il lavoro con tali formati era limitato.

AMD RX 9070 XT potrebbe presto costare molto di più di quanto non faccia ora

La serie RX 9000 di AMD potrebbe attualmente vendere a MSRP, ma non durerà a lungo, afferma il rivenditore.

AMD RX 9070 XT potrebbe presto costare molto di più di quanto non faccia ora

La serie RX 9000 di AMD potrebbe attualmente vendere a MSRP, ma non durerà a lungo, afferma il rivenditore.

NYT Cruciverba: risposte per venerdì 7 marzo

Il cruciverba del New York Times può essere difficile, anche se non è il numero di domenica! Se sei bloccato, siamo qui per aiutarti con gli indizi e le risposte di oggi.

NYT Cruciverba: risposte per venerdì 7 marzo

Il cruciverba del New York Times può essere difficile, anche se non è il numero di domenica! Se sei bloccato, siamo qui per aiutarti con gli indizi e le risposte di oggi.

.jpg) 3 grandi film di Hulu che devi trasmettere in streaming questo fine settimana (7-9 marzo)

Una storia dell'antico passato di Hollywood, un dramma oscuro e una commedia esilarante e stupida sono le nostre scelte per i 3 grandi film di Hulu che devi trasmettere questo fine settimana.

3 grandi film di Hulu che devi trasmettere in streaming questo fine settimana (7-9 marzo)

Una storia dell'antico passato di Hollywood, un dramma oscuro e una commedia esilarante e stupida sono le nostre scelte per i 3 grandi film di Hulu che devi trasmettere questo fine settimana.

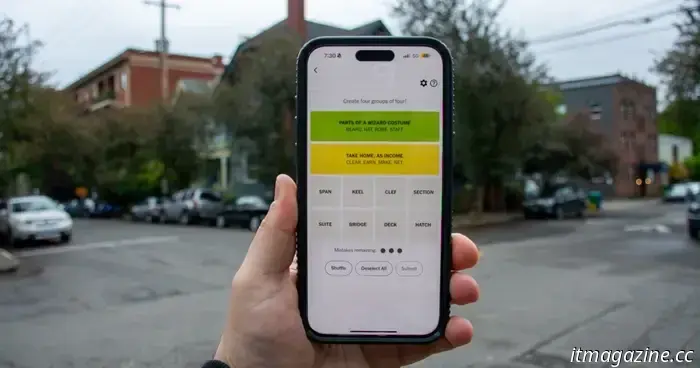

Connessioni NYT: suggerimenti e risposte per venerdì 7 marzo

Connessioni è il nuovo gioco di puzzle dal New York Times, e può essere abbastanza difficile. Se hai bisogno di una mano per risolvere il puzzle di oggi, siamo qui per aiutarti.

Connessioni NYT: suggerimenti e risposte per venerdì 7 marzo

Connessioni è il nuovo gioco di puzzle dal New York Times, e può essere abbastanza difficile. Se hai bisogno di una mano per risolvere il puzzle di oggi, siamo qui per aiutarti.

OpenAI mostra una "mentalità molto pericolosa" in materia di sicurezza, avverte l'esperto

L'ex ricercatore politico di OpenAI Miles Brundage ha criticato OpenAI per aver riscritto la sua storia e per essere eccessivamente sprezzante nei confronti dei problemi di sicurezza.