OpenAI muestra una 'mentalidad muy peligrosa' en materia de seguridad, advierte un experto

Pexeles

Un experto en IA ha acusado a OpenAI de reescribir su historia y de despreciar demasiado las preocupaciones de seguridad.

El exinvestigador de políticas de OpenAI, Miles Brundage, criticó el reciente documento de seguridad y alineación de la compañía publicado esta semana. El documento describe a OpenAI luchando por la inteligencia general artificial (AGI) en muchos pequeños pasos, en lugar de dar "un gran salto", diciendo que el proceso de implementación iterativa le permitirá detectar problemas de seguridad y examinar el potencial de mal uso de la IA en cada etapa..

Entre las muchas críticas a la tecnología de IA como ChatGPT, a los expertos les preocupa que los chatbots brinden información inexacta sobre salud y seguridad (como el infame problema con la función de búsqueda de IA de Google que instruía a las personas a comer piedras) y que puedan usarse para manipulación política, desinformación y estafas. OpenAI, en particular, ha recibido críticas por la falta de transparencia en la forma en que desarrolla sus modelos de IA, que pueden contener datos personales confidenciales.

El lanzamiento del documento OpenAI esta semana parece ser una respuesta a estas preocupaciones, y el documento implica que el desarrollo del modelo GPT-2 anterior fue "discontinuo" y que inicialmente no se lanzó debido a "preocupaciones sobre aplicaciones maliciosas", pero ahora la compañía se moverá hacia un principio de desarrollo iterativo. Pero Brundage sostiene que el documento está alterando la narrativa y no es una descripción precisa de la historia del desarrollo de la IA en OpenAI.

"El lanzamiento de GPT-2 por parte de OpenAI, en el que estuve involucrado, fue 100% consistente + presagió la filosofía actual de implementación iterativa de OpenAI", escribió Brundage en X. " El modelo se lanzó de forma incremental, con lecciones compartidas en cada paso. Muchos expertos en seguridad en ese momento nos agradecieron por esta precaución.”

Brundage también criticó el aparente enfoque de riesgo de la compañía basado en este documento, escribiendo que " Parece que se está estableciendo una carga de la prueba en esta sección donde las preocupaciones son alarmistas + necesita evidencia abrumadora de peligros inminentes para actuar en consecuencia; de lo contrario, simplemente continúe enviando. Esa es una mentalidad muy peligrosa para los sistemas avanzados de IA.”

Esto llega en un momento en que OpenAI está bajo un creciente escrutinio con acusaciones de que prioriza los "productos brillantes" sobre la seguridad.

Georgina ha sido escritora espacial en Digital Trends space writer durante seis años, cubriendo la exploración espacial humana, planetaria…

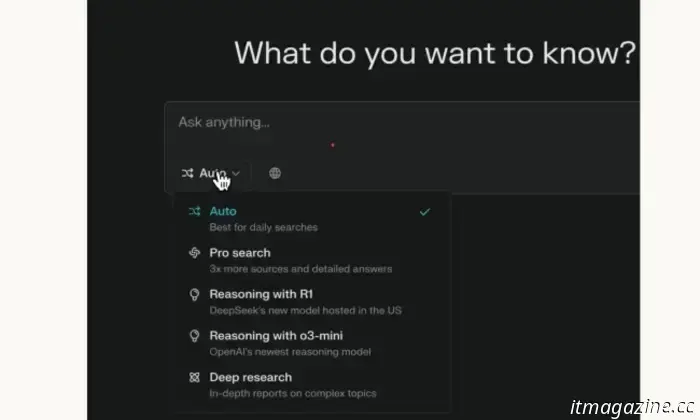

La perplejidad supera a Géminis y ChatGPT con un fantástico obsequio de IA

¿Qué pasa si le dices a un chatbot de IA que busque en la web, busque un determinado tipo de fuente y luego cree un informe detallado basado en toda la información que ha recopilado? Bueno, Géminis puede hacerlo, por0 20 al mes. O $200 cada mes, si prefiere ChatGPT.

La perplejidad lo hará gratis. Un par de veces al día, eso es. La perplejidad llama a su última herramienta, Investigación Profunda. Al igual que OpenAI. Y Google Gemini antes.

Leer más

Musk no perseguirá a OpenAI con sus miles de millones mientras siga sin fines de lucro

Elon Musk fue uno de los miembros fundadores de OpenAI, pero hizo una salida amarga antes de que ChatGPT se convirtiera en una cosa. El multimillonario afirma que no estaba contento con el giro de la organización sin fines de lucro hacia un modelo de negocio que persigue ganancias. Hace unos días, Musk presentó una oferta para comprar el brazo sin fines de lucro de OpenAI por $97.4 mil millones, pero ahora dice que retirará la oferta si el gigante de la inteligencia artificial abandona sus ambiciones con fines de lucro.

"Si (la) junta directiva de OpenAI está preparada para preservar la misión de la organización benéfica y estipula retirar la firma 'a la venta' de sus activos al detener su conversión, Musk retirará la oferta", dice una presentación judicial presentada por el abogado del multimillonario, según Reuters.

Leer más

OpenAI rechaza su lanzamiento del modelo o3, lo reemplazará con 'GPT-5'

El CEO de OpenAI, Sam Altman, anunció a través de una publicación X el miércoles que el modelo o3 de la compañía está siendo marginado efectivamente a favor de un GPT-5 "simplificado" que se lanzará en los próximos meses.

https://x.com/sama/status/1889755723078443244

Leer más

Otros artículos

Reseña de Mickey 17: Una odisea espacial salvaje e ingeniosa

El director de cine Bong Joon-ho ha hecho un regreso espectacular con Mickey 17 gracias a su historia oscura y satírica, comentarios sociales e increíbles actuaciones.

Reseña de Mickey 17: Una odisea espacial salvaje e ingeniosa

El director de cine Bong Joon-ho ha hecho un regreso espectacular con Mickey 17 gracias a su historia oscura y satírica, comentarios sociales e increíbles actuaciones.

Este monitor para juegos Samsung de 144 Hz tiene un descuento de 4 400 en este momento

El monitor inteligente para juegos Samsung Odyssey Neo G7 de 43 pulgadas con una frecuencia de actualización de 144 Hz y un tiempo de respuesta de 1 ms está a la venta en Samsung por $600 más asequibles.

Este monitor para juegos Samsung de 144 Hz tiene un descuento de 4 400 en este momento

El monitor inteligente para juegos Samsung Odyssey Neo G7 de 43 pulgadas con una frecuencia de actualización de 144 Hz y un tiempo de respuesta de 1 ms está a la venta en Samsung por $600 más asequibles.

Crucigrama del NYT: respuestas para el viernes 7 de marzo

¡El crucigrama del New York Times puede ser difícil, incluso si no es el número del domingo! Si estás atascado, estamos aquí para ayudarte con las pistas y respuestas de hoy.

Crucigrama del NYT: respuestas para el viernes 7 de marzo

¡El crucigrama del New York Times puede ser difícil, incluso si no es el número del domingo! Si estás atascado, estamos aquí para ayudarte con las pistas y respuestas de hoy.

-Max-movies-you-should-watch-this-weekend-(March-7-9).jpg) 3 películas subestimadas (HBO) Max que deberías ver este fin de semana (del 7 al 9 de marzo)

Del 7 al 9 de marzo, vea estas tres películas subestimadas en Max: una comedia romántica coral, una trágica película biográfica deportiva y un drama revelador de un reciente ganador del Oscar.

3 películas subestimadas (HBO) Max que deberías ver este fin de semana (del 7 al 9 de marzo)

Del 7 al 9 de marzo, vea estas tres películas subestimadas en Max: una comedia romántica coral, una trágica película biográfica deportiva y un drama revelador de un reciente ganador del Oscar.

M3 Ultra vs. M4 Max: ¿Cuál es mejor? Los puntos de referencia tampoco pueden decir

Se han filtrado los primeros puntos de referencia para el M3 Ultra Mac Studio, que muestran un rendimiento de la CPU que apenas supera al M4 Max.

M3 Ultra vs. M4 Max: ¿Cuál es mejor? Los puntos de referencia tampoco pueden decir

Se han filtrado los primeros puntos de referencia para el M3 Ultra Mac Studio, que muestran un rendimiento de la CPU que apenas supera al M4 Max.

.jpg) 3 películas subestimadas de Netflix que deberías ver este fin de semana (del 7 al 9 de marzo)

¿Buscas películas subestimadas para ver este fin de semana? Netflix tiene una amplia gama de gemas ocultas, incluidos dramas independientes, antologías únicas y películas emocionantes.

3 películas subestimadas de Netflix que deberías ver este fin de semana (del 7 al 9 de marzo)

¿Buscas películas subestimadas para ver este fin de semana? Netflix tiene una amplia gama de gemas ocultas, incluidos dramas independientes, antologías únicas y películas emocionantes.

OpenAI muestra una 'mentalidad muy peligrosa' en materia de seguridad, advierte un experto

El exinvestigador de políticas de OpenAI, Miles Brundage, ha criticado a OpenAI por reescribir su historia y despreciar demasiado las preocupaciones de seguridad.