Обнаружение подделок улучшается при использовании алгоритмов, которые лучше учитывают демографическое разнообразие

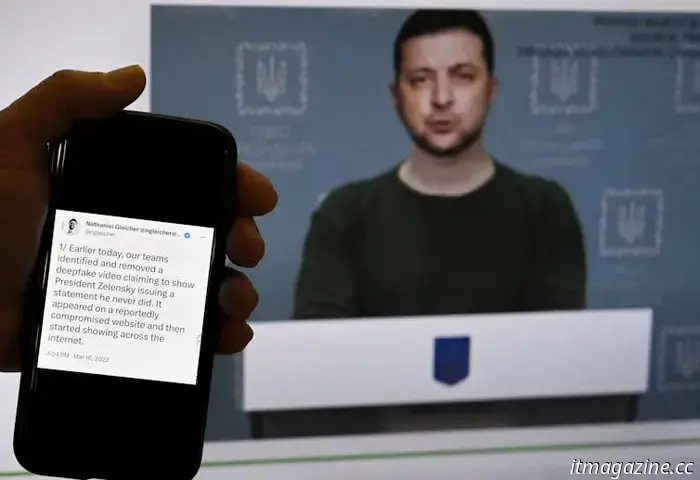

Глубокие подделки - по сути, правдоподобное вложение слов в чужие уста - с каждым днем становятся все более изощренными, и их все труднее распознать. Среди недавних примеров глубоких подделок - изображения обнаженной Тейлор Свифт, аудиозапись, на которой президент Джо Байден говорит жителям Нью-Гэмпшира не голосовать, и видео, на котором президент Украины Владимир Зеленский призывает своих солдат сложить оружие. Хотя компании создали детекторы, помогающие выявлять глубокие подделки, исследования показали, что предвзятость данных, используемых для обучения этих инструментов, может привести к тому, что определенные демографические группы будут несправедливо атакованы.

Глубокая подделка президента Украины Владимира Зеленского в 2022 году, на которой якобы изображен его призыв к войскам сложить оружие. Olivier Douliery/AFP via Getty Images Мы с командой обнаружили новые методы, которые повышают справедливость и точность алгоритмов, используемых для обнаружения глубоких подделок. Для этого мы использовали большой набор данных подделок лиц, позволяющий исследователям вроде нас тренировать подходы глубокого обучения. В своей работе мы опирались на современный алгоритм обнаружения Xception, который широко используется в системах глубокого обнаружения подделок и позволяет выявлять их с точностью 91,5 %. Мы создали два отдельных метода глубокого обнаружения подделок, призванных обеспечить справедливость. Один из них был направлен на то, чтобы алгоритм лучше учитывал демографическое разнообразие, маркируя наборы данных по полу и расе, чтобы минимизировать ошибки среди недопредставленных групп. Второй был призван повысить справедливость, не опираясь на демографические метки, а ориентируясь на признаки, не видимые человеческому глазу. Как оказалось, первый метод работает лучше. Он повысил точность с базового уровня 91,5 % до 94,17 %, что больше, чем у второго метода, а также у нескольких других, которые мы тестировали. Более того, он увеличил точность, повысив при этом справедливость, что было нашим главным приоритетом. Мы считаем, что справедливость и точность имеют решающее значение для того, чтобы общество приняло технологию искусственного интеллекта. Когда большие языковые модели, такие как ChatGPT, "галлюцинируют", они могут распространять ошибочную информацию. Аналогичным образом, поддельные изображения и видео могут подорвать принятие ИИ, если их нельзя быстро и точно обнаружить. Улучшение справедливости алгоритмов обнаружения фальшивок, чтобы определенные демографические группы не страдали от них в непропорционально большой степени, является ключевым аспектом в этом вопросе. Наше исследование посвящено справедливости алгоритмов обнаружения фальшивок, а не просто попыткам сбалансировать данные. Оно предлагает новый подход к разработке алгоритмов, в котором демографическая справедливость рассматривается как основной аспект. Сивэй Лю, профессор компьютерных наук и инженерии, директор лаборатории медиа-криминалистики UB, Университет Буффало и Ян Цзю, кандидат наук в области компьютерных наук и инженерии, Университет Буффало Эта статья перепечатана с сайта The Conversation по лицензии Creative Commons. Читайте оригинал статьи. Получайте рассылку TNW Получайте самые важные новости технологий в свой почтовый ящик каждую неделю. Также отмечено с

Другие статьи

.jpg) Лучшие бесплатные фильмы на YouTube прямо сейчас (январь 2025)

Доджбол", "Предложение", "В первый раз" и "Перерыв на пойнт" - одни из лучших бесплатных фильмов на YouTube в этом месяце.

Лучшие бесплатные фильмы на YouTube прямо сейчас (январь 2025)

Доджбол", "Предложение", "В первый раз" и "Перерыв на пойнт" - одни из лучших бесплатных фильмов на YouTube в этом месяце.

Новый правительственный министр по вопросам искусственного интеллекта еще не использовал ChatGPT

Министр Ирландии по надзору за искусственным интеллектом обещает, что будет "быстро учиться" этой преобразующей технологии.

Новый правительственный министр по вопросам искусственного интеллекта еще не использовал ChatGPT

Министр Ирландии по надзору за искусственным интеллектом обещает, что будет "быстро учиться" этой преобразующей технологии.

Получите скидку $50 на годовую подписку на Peacock с помощью этого кода

Годовая подписка на канал Peacock от NBC обычно стоит 80 долларов, но с помощью кода вам придется заплатить всего 30 долларов за доступ к потоковому сервису.

Получите скидку $50 на годовую подписку на Peacock с помощью этого кода

Годовая подписка на канал Peacock от NBC обычно стоит 80 долларов, но с помощью кода вам придется заплатить всего 30 долларов за доступ к потоковому сервису.

Сможет ли искусственный интеллект произвести революцию в разработке лекарств? Исследователи говорят, что это зависит от того, как его использовать

Высокий процент неудач лекарств - это не просто проблема распознавания образов. Вот как мы можем устранить некоторые из основных причин.

Сможет ли искусственный интеллект произвести революцию в разработке лекарств? Исследователи говорят, что это зависит от того, как его использовать

Высокий процент неудач лекарств - это не просто проблема распознавания образов. Вот как мы можем устранить некоторые из основных причин.

Последний полет ракеты Blue Origin включал в себя лунный опыт

Впервые компания, занимающаяся космическими полетами под руководством Джеффа Безоса, имитировала лунную гравитацию на суборбитальной ракете для испытания различных научных нагрузок.

Последний полет ракеты Blue Origin включал в себя лунный опыт

Впервые компания, занимающаяся космическими полетами под руководством Джеффа Безоса, имитировала лунную гравитацию на суборбитальной ракете для испытания различных научных нагрузок.

НБА тестирует новый "умный" баскетбольный мяч, сделанный в Европе

НБА экспериментирует с "умным" баскетбольным мячом, созданным SportIQ, финским стартапом, разрабатывающим сенсорные системы для спорта.

НБА тестирует новый "умный" баскетбольный мяч, сделанный в Европе

НБА экспериментирует с "умным" баскетбольным мячом, созданным SportIQ, финским стартапом, разрабатывающим сенсорные системы для спорта.

Обнаружение подделок улучшается при использовании алгоритмов, которые лучше учитывают демографическое разнообразие

Программы для обнаружения фальшивок могут несправедливо воздействовать на людей из некоторых групп. Исследователи попытались решить эту проблему.