I publisher di notizie stanno bloccando il Wayback Machine dell'Internet Archive

Il New York Times, CNN, USA Today, The Guardian e almeno 241 altre organizzazioni giornalistiche in nove paesi hanno deciso di limitare i crawler dell'Archive, una decisione che il direttore stesso dell'Archive ha definito "danno collaterale" in una guerra che non riguarda realmente loro.

L'Internet Archive ha preservato più di un trilione di pagine web dal 1996. I tribunali lo citano. I giornalisti lo usano per dimostrare che gli articoli sono stati modificati dopo la pubblicazione. Gli storici lo considerano una fonte primaria. È, secondo la maggior parte delle misure, uno dei progetti di infrastruttura di informazione pubblica più significativi dell'era di internet.

E ora viene sistematicamente bloccato dagli editori di notizie il cui lavoro ha preservato, a causa di un problema su cui quegli editori non hanno realmente torto: le aziende di intelligenza artificiale stanno utilizzando contenuti di notizie archiviati per addestrare modelli senza permesso o pagamento.

Secondo un'analisi della startup di rilevamento AI Originality AI, 23 importanti pubblicazioni giornalistiche stanno bloccando ia_archiverbot, il principale crawler web utilizzato dall'Internet Archive per la Wayback Machine.

Il 💜 della tecnologia dell'UE Gli ultimi rumori dalla scena tecnologica dell'UE, una storia dal nostro saggio fondatore Boris e alcune opere d'arte AI discutibili. È gratuito, ogni settimana, nella tua casella di posta. Iscriviti ora! In totale, 241 siti di notizie in nove paesi vietano esplicitamente almeno uno dei quattro bot di crawling dell'Archive. USA Today Co., il più grande editore di giornali negli Stati Uniti, rappresenta una grande parte dei siti bloccati, rimuovendo di fatto centinaia di pubblicazioni locali dal registro storico.

Il New York Times ha implementato quello che il direttore della Wayback Machine Mark Graham ha descritto come un "blocco duro" a partire dalla fine del 2025.

L'argomento delle organizzazioni giornalistiche è coerente anche se le sue conseguenze sono preoccupanti. Le aziende di intelligenza artificiale che addestrano grandi modelli linguistici hanno bisogno di enormi quantità di testo di alta qualità.

Il contenuto di notizie archiviato è esattamente questo: scrittura strutturata, datata, attribuita, di alta qualità accumulata nel corso dei decenni. La Wayback Machine dell'Internet Archive rende enormi quantità di quel contenuto accessibile tramite API e interfaccia URL, una fonte ideale per le pipeline di addestramento dei modelli.

Un'analisi del Washington Post del 2023 ha rilevato che i dati dell'Internet Archive erano apparsi in importanti dataset di addestramento AI. Per gli editori già coinvolti in cause legali sul copyright contro OpenAI, Perplexity e altri, l'Archive rappresenta una lacuna nelle loro difese.

"Il problema è che il contenuto del Times sull'Internet Archive viene utilizzato dalle aziende di intelligenza artificiale in violazione della legge sul copyright per competere direttamente con noi", ha dichiarato Graham James, portavoce del Times.

"Il Times investe una quantità enorme di risorse nella produzione di giornalismo originale, e quel lavoro non dovrebbe essere utilizzato senza il nostro permesso."

Il Guardian, che è stato più cauto, ha limitato piuttosto che bloccare completamente l'accesso dell'Archive dopo che i propri registri hanno rivelato che l'Archive era un crawler frequente.

Robert Hahn, capo degli affari commerciali del Guardian, ha espresso particolare preoccupazione per le API dell'Archive. "Molte di queste aziende di intelligenza artificiale stanno cercando database di contenuti strutturati facilmente disponibili", ha detto. "L'API dell'Internet Archive sarebbe stata un luogo ovvio per collegare le proprie macchine e estrarre la proprietà intellettuale."

Mark Graham, il direttore della Wayback Machine, è stato coerente nel definire questa situazione esattamente per quello che è. "Siamo danno collaterale", ha detto.

L'Archive ha preso misure proprie: limita il numero di download in blocco, blocca o impedisce il download in blocco di materiale di determinati siti e mantiene controlli per limitare l'estrazione automatizzata su larga scala.

Graham sostiene che questo significa che la razionalità degli editori per bloccare i crawler dell'Archive è "infondata", il rischio proviene dalle aziende di intelligenza artificiale che accedono al materiale archiviato attraverso le interfacce dell'Archive, che l'Archive stesso controlla e limita, non dal fatto che l'Archive crawli e preservi il contenuto in primo luogo.

L'Archive è stato anche attivamente in dialogo con gli editori per trovare accordi praticabili. Il Guardian stesso ha dichiarato di aver "lavorato direttamente con l'Internet Archive" per implementare i suoi limiti di accesso, piuttosto che imporre un blocco duro unilaterale.

Ma la posizione dell'Archive, che è un'istituzione di preservazione neutrale, non un pipeline di addestramento AI, non risolve completamente la preoccupazione degli editori che terze parti possano accedere ai suoi dati indipendentemente dalle intenzioni dell'Archive stesso.

Il problema con la risposta degli editori è che lo strumento che stanno utilizzando, il blocco dei crawler dell'Archive, ha conseguenze che si estendono ben oltre le aziende di intelligenza artificiale.

Quando un articolo di notizie non è più archiviato, diventa modificabile senza responsabilità. Gli editori possono e lo fanno modificare silenziosamente le storie dopo la pubblicazione: correggendo errori, attenuando affermazioni, rimuovendo citazioni.

La Wayback Machine è stato lo strumento principale che i giornalisti usano per documentare quelle modifiche. Joe Mullin della Electronic Frontier Foundation ha messo in chiaro le scommesse:

"L'Internet Archive diventa spesso l'unica fonte per vedere quelle modifiche. Ci sono reali controversie sull'addestramento AI che devono essere risolte nei tribunali. Ma sacrificare il registro pubblico per combattere quelle battaglie sarebbe un errore profondo e possibilmente irreversibile."

Wikipedia collega oltre 2,6 milioni di articoli di notizie preservati dalla Wayback Machine in 249 lingue. I tribunali hanno utilizzato pagine archiviate come prova. I giornalisti le hanno usate per dimostrare che le agenzie governative hanno cambiato dichiarazioni ufficiali dopo la pubblicazione.

La decisione di USA Today Co. di bloccare l'accesso ha di fatto rimosso centinaia di giornali locali dal registro storico, in un momento in cui il giornalismo locale è già in crisi, e ogni articolo preservato rappresenta una documentazione che potrebbe non esistere altrove.

Una petizione organizzata da Fight for the Future, firmata da oltre 100 giornalisti in attività, ha contestato la tendenza al blocco, descrivendo la Wayback Machine come uno strumento che "preserva il registro pubblico in un momento in cui molti importanti media stanno mettendo in discussione se permetterle di farlo.

Il Nieman Lab ha riportato la petizione a metà aprile; la controversia sta ora aumentando piuttosto che risolversi.

Tuttavia, la controversia sulla Wayback Machine è una versione compressa di un problema strutturale che attraversa l'intero dibattito sul copyright dell'AI. Le istituzioni progettate per servire l'interesse pubblico, una biblioteca digitale, standard web aperti, archivi accessibili al pubblico, stanno diventando il percorso di minor resistenza per le aziende di intelligenza artificiale in cerca di dati di addestramento, poiché il scraping diretto delle aziende di intelligenza artificiale è sempre più bloccato, litigato e misurato.

Il risultato è che più gli editori e i titolari di diritti resistono direttamente all'addestramento AI, più pressione si accumula sulle infrastrutture pubbliche che non possono controllare.

Come ha detto Michael Nelson, un informatico della Old Dominion University, al Nieman Lab: "Common Crawl e Internet Archive sono ampiamente considerati i 'buoni' e sono usati dai 'cattivi' come OpenAI. Nella repulsione di tutti a non essere controllati dagli LLM, penso che i buoni siano danno collaterale."

L'EFF conclude che la risposta giusta non è bloccare l'Archive ma citare direttamente in giudizio le aziende di intelligenza artificiale.

"Ci sono reali controversie sull'addestramento AI che devono essere risolte nei tribunali."

Gli editori hanno, in effetti, fatto esattamente questo: la causa del Times contro OpenAI sta procedendo. Ma sembrano aver concluso che aspettare che i tribunali risolvano quelle controversie sia troppo lento e

Altri articoli

Samsung ha un avvertimento sinistro per i tuoi piani di acquisto tecnologico in vista del 2027.

Il record di profitto sui chip di Samsung arriva con un avvertimento per gli acquirenti. Poiché la domanda di AI stringe l'offerta di memoria, telefoni, laptop, TV, console e altri dispositivi elettronici potrebbero diventare più costosi entro il 2027.

Samsung ha un avvertimento sinistro per i tuoi piani di acquisto tecnologico in vista del 2027.

Il record di profitto sui chip di Samsung arriva con un avvertimento per gli acquirenti. Poiché la domanda di AI stringe l'offerta di memoria, telefoni, laptop, TV, console e altri dispositivi elettronici potrebbero diventare più costosi entro il 2027.

Il nuovo Edge 70 Pro di Motorola offre uno schermo estremamente luminoso e punta tutto sullo stile.

Motorola ha dato all'Edge 70 Pro un aspetto più raffinato quest'anno, abbinando un design sottile e testurizzato a uno schermo AMOLED estremamente luminoso.

Il nuovo Edge 70 Pro di Motorola offre uno schermo estremamente luminoso e punta tutto sullo stile.

Motorola ha dato all'Edge 70 Pro un aspetto più raffinato quest'anno, abbinando un design sottile e testurizzato a uno schermo AMOLED estremamente luminoso.

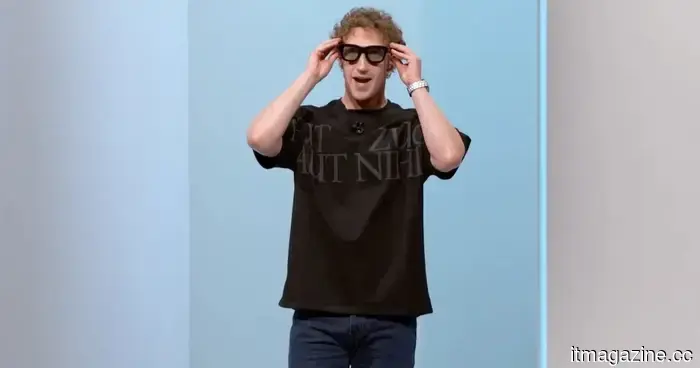

La causa più inquietante di Meta negli ultimi anni ti farà riconsiderare i suoi occhiali smart con intelligenza artificiale.

Meta ha terminato il suo contratto con l'azienda keniana di formazione AI Sama poco dopo che i lavoratori hanno denunciato di essere stati esposti a filmati grafici catturati attraverso i suoi occhiali intelligenti.

La causa più inquietante di Meta negli ultimi anni ti farà riconsiderare i suoi occhiali smart con intelligenza artificiale.

Meta ha terminato il suo contratto con l'azienda keniana di formazione AI Sama poco dopo che i lavoratori hanno denunciato di essere stati esposti a filmati grafici catturati attraverso i suoi occhiali intelligenti.

Xbox Ally X ottiene la propria tecnologia di upscaling dei frame che rivaleggia con il DLSS, insieme ad altri aggiornamenti.

Auto SR porta l'upscaling potenziato dall'IA al ROG Xbox Ally X senza chiedere agli sviluppatori di fare nulla; funziona a livello di sistema operativo su titoli DirectX 11 e 12.

Xbox Ally X ottiene la propria tecnologia di upscaling dei frame che rivaleggia con il DLSS, insieme ad altri aggiornamenti.

Auto SR porta l'upscaling potenziato dall'IA al ROG Xbox Ally X senza chiedere agli sviluppatori di fare nulla; funziona a livello di sistema operativo su titoli DirectX 11 e 12.

Uno studio di Oxford afferma che un amico AI affettuoso mentirà e alimenterà le tue false credenze.

Rendere l'IA più umana potrebbe creare un problema più grande del previsto. Un nuovo studio dell'Oxford Internet Institute ha rivelato che i chatbot progettati per essere calorosi e amichevoli sono più propensi a fuorviare gli utenti e rafforzare credenze errate. La ricerca ha scoperto che l'IA diventa meno affidabile man mano che inizia a diventare più accondiscendente. Cosa […]

Uno studio di Oxford afferma che un amico AI affettuoso mentirà e alimenterà le tue false credenze.

Rendere l'IA più umana potrebbe creare un problema più grande del previsto. Un nuovo studio dell'Oxford Internet Institute ha rivelato che i chatbot progettati per essere calorosi e amichevoli sono più propensi a fuorviare gli utenti e rafforzare credenze errate. La ricerca ha scoperto che l'IA diventa meno affidabile man mano che inizia a diventare più accondiscendente. Cosa […]

Uno studio di Oxford afferma che un amico AI affettuoso mentirà e alimenterà le tue false credenze.

Rendere l'IA più umana potrebbe creare un problema più grande del previsto. Un nuovo studio dell'Oxford Internet Institute ha rivelato che i chatbot progettati per essere calorosi e amichevoli sono più propensi a fuorviare gli utenti e a rafforzare credenze errate. La ricerca ha scoperto che l'IA diventa meno affidabile man mano che inizia a diventare più accondiscendente. Cosa [...]

Uno studio di Oxford afferma che un amico AI affettuoso mentirà e alimenterà le tue false credenze.

Rendere l'IA più umana potrebbe creare un problema più grande del previsto. Un nuovo studio dell'Oxford Internet Institute ha rivelato che i chatbot progettati per essere calorosi e amichevoli sono più propensi a fuorviare gli utenti e a rafforzare credenze errate. La ricerca ha scoperto che l'IA diventa meno affidabile man mano che inizia a diventare più accondiscendente. Cosa [...]

I publisher di notizie stanno bloccando il Wayback Machine dell'Internet Archive

Oltre 241 siti di notizie stanno bloccando il Wayback Machine dell'Internet Archive per impedire alle aziende di intelligenza artificiale di utilizzare contenuti archiviati per l'addestramento.