Google compone una catena di fornitura di chip a quattro partner con Broadcom, MediaTek, Marvell per sfidare Nvidia nell'inferenza.

Sommario: Google sta costruendo la catena di approvvigionamento di chip personalizzati più diversificata dell'industria dell'IA, con quattro partner di design (Broadcom, MediaTek, Marvell, Intel) e una roadmap che si estende dal TPU Ironwood ora in spedizione in milioni fino ai chip TPU v8 presso TSMC a 2nm alla fine del 2027. La strategia, dettagliata prima di Google Cloud Next, divide esplicitamente la prossima generazione: il “Sunfish” di Broadcom per l'addestramento, lo “Zebrafish” di MediaTek per l'inferenza a un costo inferiore del 20-30%, con Marvell in trattative per aggiungere un'unità di elaborazione della memoria e un ulteriore TPU per l'inferenza, posizionando il silicio personalizzato di Google come la sfida più diretta al dominio di Nvidia nell'inferenza IA.

Google sta assemblando la catena di approvvigionamento di chip personalizzati più diversificata dell'industria dell'IA, con quattro partner di design, una relazione di fabbricazione con TSMC e una roadmap di prodotto che ora si estende dai chip di inferenza che sta spedendo oggi ai processori a 2 nanometri che prevede di distribuire alla fine del 2027. La strategia, dettagliata in un articolo di Bloomberg prima di Google Cloud Next questa settimana, posiziona il programma di silicio di Google come la sfida più diretta al dominio di Nvidia nell'inferenza IA, la fase di calcolo in cui i modelli servono gli utenti piuttosto che apprendere dai dati.

Il pezzo centrale è Ironwood, il TPU di settima generazione di Google e il primo progettato specificamente per l'inferenza. Offre dieci volte le prestazioni di picco del TPU v5p, offre 192 gigabyte di memoria HBM3E per chip con 7,2 terabyte al secondo di larghezza di banda e scala fino a 9.216 chip raffreddati a liquido in un singolo superpod che produce 42,5 FP8 exaflops. Ironwood è ora generalmente disponibile per i clienti di Google Cloud. Google prevede di produrre milioni di unità quest'anno e Anthropic si è impegnata per un massimo di un milione di TPU. Anche Meta ha un accordo di noleggio.

Il programma di chip di Google coinvolge ora quattro partner di design distinti, ciascuno dei quali gestisce diversi segmenti della linea di prodotto.

Broadcom, che ha firmato un accordo a lungo termine il 6 aprile per fornire TPU e componenti di rete fino al 2031, gestisce le varianti di chip ad alte prestazioni. Sta anche progettando il chip di addestramento TPU v8 di prossima generazione, con nome in codice “Sunfish”, mirato al nodo di processo a 2 nanometri di TSMC per la fine del 2027. Broadcom detiene oltre il 70% del mercato degli acceleratori IA personalizzati e prevede 100 miliardi di dollari di entrate dai chip IA entro il 2027.

MediaTek sta progettando la variante di inferenza ottimizzata per i costi del TPU v8, con nome in codice “Zebrafish”, anch'essa mirata a TSMC 2nm alla fine del 2027. Il coinvolgimento di MediaTek è iniziato con i moduli I/O e i componenti periferici su Ironwood, dove i suoi progetti costano dal 20 al 30% in meno rispetto alle alternative. La strategia del TPU v8 divide esplicitamente la linea di prodotto: Broadcom costruisce il chip di addestramento, MediaTek costruisce il chip di inferenza e Google guadagna il potere di negoziazione che deriva dal fatto che ogni partner sa dell'esistenza dell'altro.

Marvell Technology, che è in trattative con Google per sviluppare un'unità di elaborazione della memoria e un nuovo TPU focalizzato sull'inferenza, diventerebbe il terzo partner di design se quelle trattative producessero un contratto. Google prevede di produrre quasi due milioni di unità di elaborazione della memoria, con la finalizzazione del design prevista per il prossimo anno. L'attività di silicio personalizzato di Marvell opera a un tasso annuale di 1,5 miliardi di dollari su 18 vittorie di design per fornitori di cloud, e Nvidia ha investito 2 miliardi di dollari nella società a marzo.

Intel è entrata in gioco il 9 aprile con un accordo pluriennale per fornire processori Xeon e unità di elaborazione dell'infrastruttura personalizzata per l'infrastruttura del data center IA di Google. L'accordo copre i livelli di rete e di calcolo generico che circondano i TPU piuttosto che gli acceleratori IA stessi.

TSMC fabbrica tutto il silicio personalizzato di Google. La relazione è strutturale: ogni chip progettato da Google, indipendentemente da quale partner lo abbia progettato, passa attraverso i fab di TSMC.

Perché l'inferenza cambia l'economia

Il passaggio dall'addestramento all'inferenza come costo di calcolo IA dominante è il presupposto strategico dietro l'intero programma di chip di Google. Addestrare un modello all'avanguardia è un evento singolare e intensivo. L'inferenza è continua e scala con ogni utente, ogni query e ogni prodotto che incorpora l'IA. Google gestisce miliardi di query di ricerca potenziate dall'IA, conversazioni Gemini e chiamate API Cloud IA quotidianamente. A quella scala, il costo per inferenza determina l'economia dell'intero business dell'IA.

Le GPU di Nvidia rimangono dominanti per i carichi di lavoro di addestramento, dove la loro programmabilità e l'ecosistema software CUDA creano costi di switching che i chip personalizzati non possono facilmente replicare. Ma i carichi di lavoro di inferenza sono più prevedibili, più ripetitivi e più adatti al tipo di ottimizzazione a funzione fissa in cui il silicio personalizzato eccelle. Un chip di inferenza progettato per uno scopo che costa meno per query rispetto a una GPU Nvidia, anche se non può eguagliare la versatilità della GPU, vince sul metro che conta su scala di Google.

Questo è il motivo per cui Google sta investendo in più percorsi di chip di inferenza contemporaneamente. Ironwood serve i carichi di lavoro di oggi. Lo Zebrafish di MediaTek mira alla prossima generazione a un costo inferiore. I chip proposti da Marvell aggiungerebbero un'altra opzione. La ridondanza è deliberata: Google sta costruendo opzioni in una catena di approvvigionamento in cui la dipendenza da un singolo partner crea rischi di prezzo, rischi di capacità e la vulnerabilità strategica di avere la propria infrastruttura IA controllata dalla roadmap di qualcun altro.

I numeri dietro l'ambizione

Le spedizioni totali previste di TPU di Google sono stimate in 4,3 milioni di unità nel 2026, aumentando a oltre 35 milioni entro il 2028. L'impegno di Anthropic da solo rappresenta fino a un milione di quei chip, con accesso a circa 3,5 gigawatt di calcolo basato su TPU di nuova generazione a partire dal 2027. Le entrate stimate da Mizuho di Broadcom derivanti dalle sue relazioni con Google e Anthropic sono di 21 miliardi di dollari nel 2026, aumentando a 42 miliardi di dollari nel 2027.

Il mercato degli ASIC personalizzati più in generale sta crescendo più velocemente delle GPU. TrendForce prevede che le vendite di chip personalizzati aumenteranno del 45% nel 2026, rispetto a una crescita del 16% nelle spedizioni di GPU. Si prevede che il mercato raggiunga i 118 miliardi di dollari entro il 2033. Google non è l'unico hyperscaler a costruire silicio personalizzato per l'inferenza: Amazon ha Trainium e Inferentia, Microsoft ha Maia e Anthropic sta esplorando il proprio programma di chip. Ma l'approccio multi-partner e multi-generazione di Google è il più architettonicamente ambizioso.

Cosa tenere d'occhio a Cloud Next

Google Cloud Next apre mercoledì a Las Vegas con keynote di Sundar Pichai e Thomas Kurian. La conferenza dovrebbe presentare l'architettura TPU di nuova generazione e la roadmap del silicio personalizzato che collega Ironwood alla generazione v8. Il tempismo dell'articolo di Bloomberg, un giorno dopo che The Information ha rivelato le trattative con Marvell e due giorni prima di Cloud Next, suggerisce che Google sta utilizzando la conferenza per inquadrare il proprio programma di chip come una strategia coerente piuttosto che una serie di partnership individuali.

La sfida che affronta Nvidia non è che un singolo chip di Google supererà le sue

Altri articoli

Motorola ha appena aperto la beta di Android 17 a più telefoni Razr ed Edge.

Motorola sta ampliando l'accesso alla beta di Android 17 a più telefoni premium, aggiungendo due modelli Razr e l'Edge 50 Ultra in diverse regioni.

Motorola ha appena aperto la beta di Android 17 a più telefoni Razr ed Edge.

Motorola sta ampliando l'accesso alla beta di Android 17 a più telefoni premium, aggiungendo due modelli Razr e l'Edge 50 Ultra in diverse regioni.

Samsung ha silenziosamente rilasciato un aggiornamento di editing carico per gli utenti Galaxy

L'app Galaxy Enhance-X di Samsung ha appena ricevuto un grande redesign, insieme a nuovi effetti basati su plugin, strumenti per documenti più potenti e modifica in batch per foto e video.

Samsung ha silenziosamente rilasciato un aggiornamento di editing carico per gli utenti Galaxy

L'app Galaxy Enhance-X di Samsung ha appena ricevuto un grande redesign, insieme a nuovi effetti basati su plugin, strumenti per documenti più potenti e modifica in batch per foto e video.

8 migliori piattaforme di software per la gestione dei fornitori per il 2026

Confronta le migliori piattaforme software per la gestione dei fornitori per il 2026, comprese le capacità di intelligenza artificiale, gli strumenti di conformità e le funzionalità per unificare i dati sui fornitori, i contratti e le spese.

8 migliori piattaforme di software per la gestione dei fornitori per il 2026

Confronta le migliori piattaforme software per la gestione dei fornitori per il 2026, comprese le capacità di intelligenza artificiale, gli strumenti di conformità e le funzionalità per unificare i dati sui fornitori, i contratti e le spese.

Il test dell'abbonamento a WhatsApp Plus a 2,49 EUR/mese si unisce a Instagram Plus nella spinta premium cross-app di Meta.

WhatsApp sta testando un abbonamento di 2,49 EUR/mese con temi di chat, icone e suonerie, dopo Instagram Plus, mentre Meta costruisce livelli a pagamento nel suo ecosistema di app con 3,3 miliardi di utenti.

Il test dell'abbonamento a WhatsApp Plus a 2,49 EUR/mese si unisce a Instagram Plus nella spinta premium cross-app di Meta.

WhatsApp sta testando un abbonamento di 2,49 EUR/mese con temi di chat, icone e suonerie, dopo Instagram Plus, mentre Meta costruisce livelli a pagamento nel suo ecosistema di app con 3,3 miliardi di utenti.

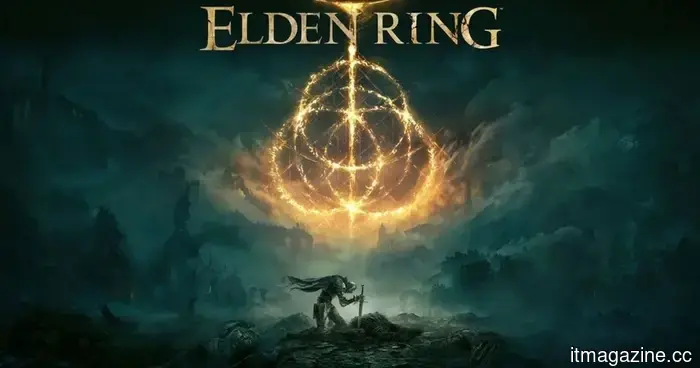

Il film di Elden Ring ha appena ricevuto una data di uscita, un cast eccezionale, e si sta girando in IMAX.

L'adattamento di Elden Ring di A24 è ora in produzione nel Regno Unito, diretto da Alex Garland. George R.R. Martin ha co-scritto la mitologia del gioco ed è ora produttore del film live-action.

Il film di Elden Ring ha appena ricevuto una data di uscita, un cast eccezionale, e si sta girando in IMAX.

L'adattamento di Elden Ring di A24 è ora in produzione nel Regno Unito, diretto da Alex Garland. George R.R. Martin ha co-scritto la mitologia del gioco ed è ora produttore del film live-action.

Il Framework di Visibilità del Marchio di Semrush viene lanciato all'Adobe Summit mentre la ricerca AI riscrive le regole della scoperta.

Il nuovo framework di Semrush introduce l'ottimizzazione della ricerca agentica e si basa su 213 milioni di prompt LLM per misurare la visibilità del marchio attraverso la ricerca AI, mentre il CTR organico diminuisce del 61%.

Il Framework di Visibilità del Marchio di Semrush viene lanciato all'Adobe Summit mentre la ricerca AI riscrive le regole della scoperta.

Il nuovo framework di Semrush introduce l'ottimizzazione della ricerca agentica e si basa su 213 milioni di prompt LLM per misurare la visibilità del marchio attraverso la ricerca AI, mentre il CTR organico diminuisce del 61%.

Google compone una catena di fornitura di chip a quattro partner con Broadcom, MediaTek, Marvell per sfidare Nvidia nell'inferenza.

Il programma di chip personalizzati di Google coinvolge quattro partner di design e una roadmap TPU v8 a doppio binario presso TSMC 2nm, posizionando il suo silicio per l'inferenza come la sfida più diretta a Nvidia.