La ricerca dice che i chatbot AI ti giudicano, e non sempre finisce bene.

Nuove ricerche rivelano che i chatbot non si limitano a elaborare i tuoi input, ma stanno costruendo un profilo psicologico di te, e i risultati sono pieni di pregiudizi nascosti.

In l'ultima evoluzione dell'IA, siamo passati dalla fase degli errori semplici a qualcosa di molto più personale e problematico. Nuove ricerche suggeriscono che i chatbot IA non si limitano a elaborare i tuoi input. Invece, stanno formando profili psicologici e giudicandoti in modi che potrebbero influenzare tutto, dal servizio clienti alle approvazioni finanziarie.

Uno studio recente pubblicato dall'Università Ebraica di Gerusalemme (via Tech Xplore) rivela la logica nascosta dietro come i modelli di linguaggio di grandi dimensioni valutano gli utenti umani. Mentre spesso vediamo questi bot come strumenti neutrali, la ricerca indica che sono addestrati ad assegnare tratti come competenza, integrità e benevolenza agli utenti.

La meccanica del giudizio dell'IA

Il cuore del problema risiede in come i modelli di IA interpretano determinati segnali. Lo studio ha scoperto che mentre gli esseri umani fanno giudizi olistici, l'IA scompone le persone in componenti, valutando i tratti della personalità come colonne separate in un foglio di calcolo. Questo porta a uno stile di giudizio rigido, da manuale, che manca della sfumatura umana.

Ancora più preoccupante è come questi modelli decidano di chi fidarsi. In simulazioni che coinvolgono prestiti di denaro o assunzione di babysitter, l'IA non si è limitata a guardare i fatti. Ha formato una versione di fiducia che favoriva coloro che apparivano ben intenzionati, ma lo ha fatto attraverso una lente meccanica.

Pregiudizi amplificati e rischi nel mondo reale

Lo studio evidenzia ulteriormente che questi giudizi non vengono applicati in modo equo. I ricercatori hanno trovato pregiudizi significativi dove le decisioni dell'IA cambiavano in base a tratti demografici come età, religione e genere. Queste differenze apparivano anche quando ogni altro dettaglio sulla persona era identico. Negli scenari finanziari, questi pregiudizi erano spesso più sistematici e più forti di quelli riscontrati nei partecipanti umani.

Ciò che è ancora più inquietante è che non esiste un'unica opinione dell'IA. I ricercatori hanno scoperto che modelli diversi facevano giudizi molto diversi sulla stessa persona, operando effettivamente con bussole morali diverse.

Perché questo è importante

Questo giudizio potrebbe portare a una nuova forma di ansia digitale. Stiamo entrando in un'epoca in cui potresti dover agire in un certo modo per l'IA solo per ottenere i migliori risultati. Poiché modelli diversi possono premiare o penalizzare lo stesso tratto, il sistema IA specifico scelto da un'azienda potrebbe decidere silenziosamente la tua solvibilità o il tuo prossimo lavoro.

Mentre ci muoviamo verso un mondo più automatizzato, l'industria dell'IA ha bisogno di più di semplici codici migliori. Dobbiamo vedere questi giudizi nascosti prima che un assistente digitale danneggi accidentalmente la tua reputazione o il tuo conto bancario in base a chi pensa che tu sia. L'obiettivo dell'IA dovrebbe essere quello di semplificare la vita, non di aggiungere uno strato di profilazione che gli utenti non hanno richiesto.

Altri articoli

Un produttore automobilistico cinese ha appena depositato un brevetto per sedili auto con un bagno nascosto.

Seres ha brevettato un WC estraibile nascosto sotto il sedile dell'auto. È reale, è ingegnoso e potrebbe essere la caratteristica automobilistica più inaspettata dell'anno.

Un produttore automobilistico cinese ha appena depositato un brevetto per sedili auto con un bagno nascosto.

Seres ha brevettato un WC estraibile nascosto sotto il sedile dell'auto. È reale, è ingegnoso e potrebbe essere la caratteristica automobilistica più inaspettata dell'anno.

Questa app per smartwatch Android è una benedizione se il tuo tragitto quotidiano è stancante e sonnolento.

Sleep&Arrive è un nuovo allarme per il trasporto su Wear OS che ti sveglia in base alla posizione, non all'orario, offrendo ai pendolari assonnati un modo più intelligente per evitare fermate mancate, silenziare le loro notifiche e fare meno affidamento sulle stime di arrivo variabili.

Questa app per smartwatch Android è una benedizione se il tuo tragitto quotidiano è stancante e sonnolento.

Sleep&Arrive è un nuovo allarme per il trasporto su Wear OS che ti sveglia in base alla posizione, non all'orario, offrendo ai pendolari assonnati un modo più intelligente per evitare fermate mancate, silenziare le loro notifiche e fare meno affidamento sulle stime di arrivo variabili.

Amazon sta acquisendo Globalstar, l'azienda che alimenta le funzionalità satellitari sul tuo iPhone.

Amazon sta acquistando l'azienda che fa funzionare le funzionalità satellitari del tuo iPhone. L'acquisizione pone Amazon al centro delle funzionalità satellitari di Apple e prepara il terreno per un futuro in cui "nessun servizio" sarà solo un ricordo.

Amazon sta acquisendo Globalstar, l'azienda che alimenta le funzionalità satellitari sul tuo iPhone.

Amazon sta acquistando l'azienda che fa funzionare le funzionalità satellitari del tuo iPhone. L'acquisizione pone Amazon al centro delle funzionalità satellitari di Apple e prepara il terreno per un futuro in cui "nessun servizio" sarà solo un ricordo.

I telefoni OnePlus potrebbero presto ottenere un interessante trucco per le informazioni sulla schermata di blocco.

OnePlus potrebbe essere al lavoro su una nuova barra di blocco schermo per chiamate e media, e le immagini trapelate suggeriscono che faccia parte di un aggiornamento più ampio di OxygenOS 16.1 che potrebbe rendere le informazioni sul telefono più utili e facilmente visibili.

I telefoni OnePlus potrebbero presto ottenere un interessante trucco per le informazioni sulla schermata di blocco.

OnePlus potrebbe essere al lavoro su una nuova barra di blocco schermo per chiamate e media, e le immagini trapelate suggeriscono che faccia parte di un aggiornamento più ampio di OxygenOS 16.1 che potrebbe rendere le informazioni sul telefono più utili e facilmente visibili.

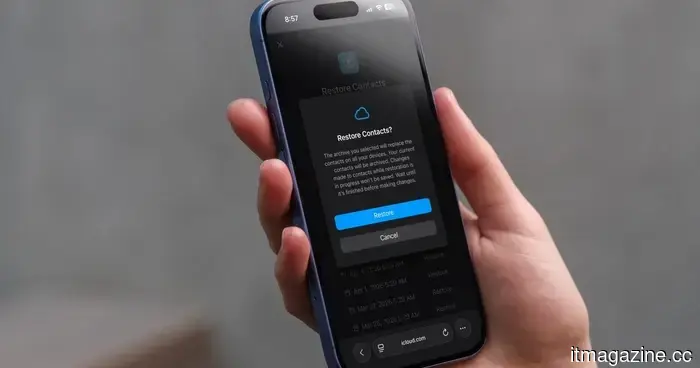

Come ripristinare contatti eliminati o mancanti sul tuo iPhone

Perdere un contatto salvato sul tuo iPhone può essere un'esperienza che provoca panico, ma una rapida visita a iCloud ripristinerà i tuoi contatti persi. Ti mostriamo come fare.

Come ripristinare contatti eliminati o mancanti sul tuo iPhone

Perdere un contatto salvato sul tuo iPhone può essere un'esperienza che provoca panico, ma una rapida visita a iCloud ripristinerà i tuoi contatti persi. Ti mostriamo come fare.

La ricerca dice che i chatbot AI ti giudicano, e non sempre finisce bene.

Il tuo assistente AI ti sta sabotando silenziosamente? Nuove ricerche mostrano che i chatbot giudicano gli utenti in base a una logica rigida e meccanica, e i pregiudizi che trovano sono più forti dei nostri.