La investigación dice que los chatbots de IA te juzgan, y no siempre termina bien.

Nueva investigación revela que los chatbots no solo están procesando tus solicitudes, están construyendo un perfil psicológico de ti, y los resultados están plagados de sesgos ocultos.

En el último giro de la evolución de la IA, hemos pasado de la fase de errores simples a algo mucho más personal y problemático. Nuevas investigaciones sugieren que los chatbots de IA no solo están procesando tus solicitudes. En cambio, están formando perfiles psicológicos y juzgándote de maneras que podrían influir en todo, desde el servicio al cliente hasta las aprobaciones financieras.

Un estudio reciente publicado por la Universidad Hebrea de Jerusalén (a través de Tech Xplore) revela la lógica oculta detrás de cómo los modelos de lenguaje grande evalúan a los usuarios humanos. Mientras que a menudo vemos estos bots como herramientas neutrales, la investigación indica que están entrenados para asignar rasgos como competencia, integridad y benevolencia a los usuarios.

La mecánica del juicio de IA

El núcleo del problema radica en cómo los modelos de IA interpretan ciertas señales. El estudio encontró que mientras los humanos hacen juicios holísticos, la IA descompone a las personas en componentes, puntuando rasgos de personalidad como columnas separadas en una hoja de cálculo. Esto conduce a un estilo de juicio rígido y mecánico que carece de matices humanos.

Aún más preocupante es cómo estos modelos deciden a quién confiar. En simulaciones que involucraban prestar dinero o contratar niñeras, la IA no solo miró los hechos. Formó una versión de confianza que favorecía a aquellos que parecían bien intencionados, pero lo hizo a través de una lente mecánica.

Sesgo amplificado y riesgos en el mundo real

El estudio destaca además que estos juicios no se aplican de manera equitativa. Los investigadores encontraron sesgos significativos donde las decisiones de la IA cambiaban según rasgos demográficos como edad, religión y género. Estas diferencias aparecieron incluso cuando cada otro detalle sobre la persona era idéntico. En escenarios financieros, estos sesgos eran a menudo más sistemáticos y más fuertes que los encontrados en participantes humanos.

Lo que es aún más inquietante es que no hay una única opinión de IA. Los investigadores encontraron que diferentes modelos hacían juicios muy diferentes sobre la misma persona, operando efectivamente con diferentes brújulas morales.

Por qué esto importa

Este juicio podría llevar a una nueva forma de ansiedad digital. Estamos entrando en un tiempo en el que podrías necesitar actuar de cierta manera para que la IA simplemente obtenga los mejores resultados. Debido a que diferentes modelos pueden recompensar o penalizar el mismo rasgo, el sistema de IA específico que una empresa elija podría decidir en silencio tu solvencia crediticia o tu próximo trabajo.

A medida que avanzamos hacia un mundo más automatizado, la industria de la IA necesita más que solo mejor código. Necesitamos ver estos juicios ocultos antes de que un asistente digital accidentalmente dañe tu reputación o tu cuenta bancaria basándose en quién cree que eres. El objetivo de la IA debería ser facilitar la vida, no añadir una capa de perfilado que los usuarios no pidieron.

Otros artículos

La investigación dice que los chatbots de IA te juzgan, y no siempre termina bien.

¿Está tu asistente de IA saboteándote en silencio? Nuevas investigaciones muestran que los chatbots están juzgando a los usuarios basándose en una lógica rígida y mecánica, y los sesgos que encuentran son más fuertes que los nuestros.

La investigación dice que los chatbots de IA te juzgan, y no siempre termina bien.

¿Está tu asistente de IA saboteándote en silencio? Nuevas investigaciones muestran que los chatbots están juzgando a los usuarios basándose en una lógica rígida y mecánica, y los sesgos que encuentran son más fuertes que los nuestros.

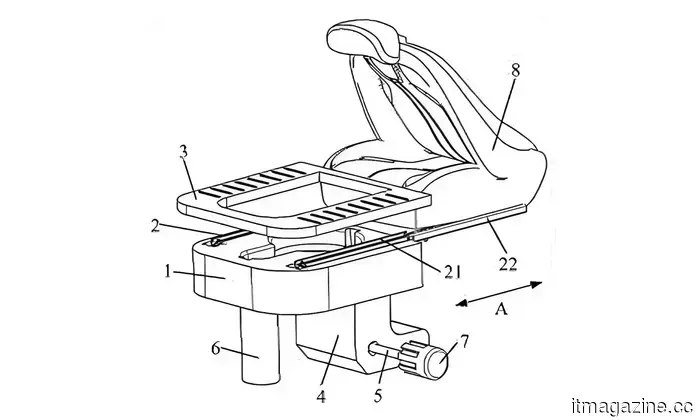

Un fabricante de automóviles chino acaba de presentar una patente para asientos de coche con un baño oculto.

Seres ha patentado un inodoro extraíble oculto bajo el asiento del coche. Es real, es ingenioso y podría ser la característica de coche más inesperada del año.

Un fabricante de automóviles chino acaba de presentar una patente para asientos de coche con un baño oculto.

Seres ha patentado un inodoro extraíble oculto bajo el asiento del coche. Es real, es ingenioso y podría ser la característica de coche más inesperada del año.

Amazon está adquiriendo Globalstar, la empresa que impulsa las funciones satelitales en tu iPhone.

Amazon está comprando la empresa que hace que las funciones de satélite de tu iPhone funcionen. La adquisición coloca a Amazon en el centro de las funciones de satélite de Apple y prepara el escenario para un futuro donde "sin servicio" sea cosa del pasado.

Amazon está adquiriendo Globalstar, la empresa que impulsa las funciones satelitales en tu iPhone.

Amazon está comprando la empresa que hace que las funciones de satélite de tu iPhone funcionen. La adquisición coloca a Amazon en el centro de las funciones de satélite de Apple y prepara el escenario para un futuro donde "sin servicio" sea cosa del pasado.

Un fabricante de automóviles chino acaba de presentar una patente para asientos de coche con un baño oculto.

Seres ha patentado un inodoro retráctil oculto bajo el asiento del coche. Es real, es ingenioso y podría ser la característica de coche más inesperada del año.

Un fabricante de automóviles chino acaba de presentar una patente para asientos de coche con un baño oculto.

Seres ha patentado un inodoro retráctil oculto bajo el asiento del coche. Es real, es ingenioso y podría ser la característica de coche más inesperada del año.

La investigación dice que los chatbots de IA te juzgan, y no siempre termina bien.

¿Está tu asistente de IA saboteándote en silencio? Nuevas investigaciones muestran que los chatbots están juzgando a los usuarios basándose en una lógica rígida y mecánica, y los sesgos que encuentran son más fuertes que los nuestros.