OpenAI ha lanciato una borsa di studio per la sicurezza

Il OpenAI Safety Fellowship, annunciato il 6 aprile 2026, è un programma pilota per ricercatori esterni per condurre lavori indipendenti sulla sicurezza e l'allineamento dell'IA. Si svolgerà da settembre 2026 a febbraio 2027.

È stato pubblicato sui social media poche ore dopo che un'inchiesta di Ronan Farrow su The New Yorker ha riportato che OpenAI aveva sciolto i suoi team di superallineamento e di prontezza all'AGI e aveva rimosso la sicurezza dall'elenco delle attività più significative nelle sue dichiarazioni fiscali all'IRS.

OpenAI ha annunciato il OpenAI Safety Fellowship, un programma pilota che finanzierà un gruppo di ricercatori esterni per condurre lavori indipendenti sulla sicurezza e l'allineamento dell'IA.

Il programma si svolgerà dal 14 settembre 2026 al 5 febbraio 2027. I borsisti riceveranno un compenso mensile, risorse informatiche e mentorship da ricercatori di OpenAI, e si prevede che producano un output di ricerca significativo, un articolo, un benchmark o un dataset, entro la fine del programma.

Le domande chiudono il 3 maggio, con i candidati selezionati notificati entro il 25 luglio.

Le aree di ricerca prioritarie includono la valutazione della sicurezza, la robustezza, strategie di mitigazione scalabili, metodi di protezione della privacy, supervisione agentica e domini di uso improprio ad alta gravità.

OpenAI ha specificato che i borsisti riceveranno crediti API ma non accesso ai sistemi interni. Il programma è descritto come un pilota, e l'azienda afferma di essere aperta a ricercatori provenienti da informatica, scienze sociali, cybersecurity, privacy e interazione uomo-computer, enfatizzando la capacità di ricerca e il giudizio tecnico rispetto alle credenziali accademiche.

L'annuncio è stato pubblicato sugli account social media di OpenAI alle 12:12 PM del 6 aprile. Poche ore prima, The New Yorker ha pubblicato un'importante inchiesta di Ronan Farrow e Andrew Marantz che riportava che OpenAI aveva sciolto sia il suo team di superallineamento che il suo team di prontezza all'AGI, e aveva rimosso la sicurezza dall'elenco delle sue attività più significative nelle sue dichiarazioni fiscali all'IRS.

L'inchiesta ha anche riportato che quando i giornalisti hanno chiesto di parlare con i ricercatori che lavorano sulla sicurezza esistenziale, un rappresentante di OpenAI ha risposto: ‘Cosa intendi per sicurezza esistenziale? Non è, tipo, una cosa.’ Farrow ha notato il tempismo dell'annuncio della fellowship esplicitamente sui social media.

Il modello di scioglimento dei team di sicurezza in OpenAI è documentato. Il team di superallineamento, annunciato a metà 2023 con un impegno del 20% della capacità computazionale dell'azienda per quattro anni, è stato sciolto nel maggio 2024 dopo che i co-leader Ilya Sutskever e Jan Leike sono partiti.

Leike ha scritto alla partenza che la cultura della sicurezza e i processi avevano ‘preso un secondo posto rispetto ai prodotti luccicanti.’ Il team di prontezza all'AGI è stato poi sciolto nell'ottobre 2024 quando il suo leader, Miles Brundage, se n'è andato.

Il team di Allineamento della Missione, successore del Superallineamento, è stato disbandato nel febbraio 2026 dopo 16 mesi. All'inizio del 2026, le persone più associate alla supervisione della sicurezza in OpenAI erano in gran parte partite o erano state spostate in ruoli con responsabilità indefinite.

L'inchiesta di The New Yorker ha anche riportato che la parola ‘safely’ era stata eliminata dalla dichiarazione di missione di OpenAI nelle sue dichiarazioni fiscali all'IRS.

OpenAI non ha risposto pubblicamente alle specifiche affermazioni nell'inchiesta di The New Yorker. Il Safety Fellowship, così strutturato, indirizza i ricercatori esterni verso domande di sicurezza a distanza dall'azienda, piuttosto che ripristinare l'infrastruttura interna di sicurezza.

Se un programma di fellowship esterno sia un sostituto significativo per la ricerca di allineamento interna è una domanda che la comunità di ricerca sulla sicurezza dell'IA è probabile che dibatta nelle settimane a venire.

Altri articoli

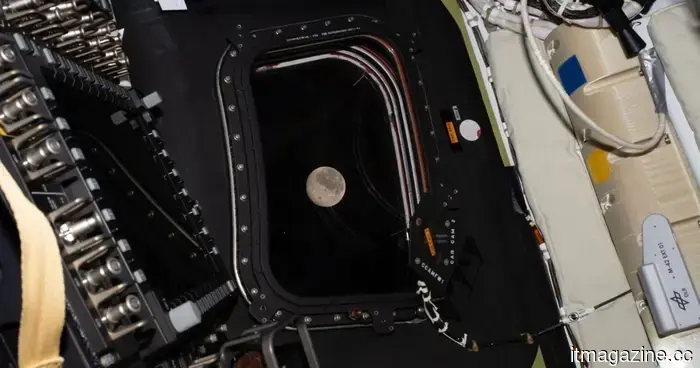

Primi notevoli della missione lunare Artemis II … finora

Dopo aver appena orbitato attorno alla luna in un volo storico del nostro vicino più prossimo, l'equipaggio di Artemis II è ora sulla strada del ritorno verso la Terra. Victor Glover, Reid Wiseman e Christina Koch della NASA, insieme a Jeremy Hansen dell'Agenzia Spaziale Canadese, sono stati lanciati a bordo della navetta Orion dal Kennedy Space Center il 1 aprile, [...]

Primi notevoli della missione lunare Artemis II … finora

Dopo aver appena orbitato attorno alla luna in un volo storico del nostro vicino più prossimo, l'equipaggio di Artemis II è ora sulla strada del ritorno verso la Terra. Victor Glover, Reid Wiseman e Christina Koch della NASA, insieme a Jeremy Hansen dell'Agenzia Spaziale Canadese, sono stati lanciati a bordo della navetta Orion dal Kennedy Space Center il 1 aprile, [...]

Bill Ackman propone di acquistare Universal Music Group per 56 miliardi di euro

Pershing Square ha presentato una proposta non vincolante per acquistare Universal Music Group a €30,40 per azione, un premio del 78%.

Bill Ackman propone di acquistare Universal Music Group per 56 miliardi di euro

Pershing Square ha presentato una proposta non vincolante per acquistare Universal Music Group a €30,40 per azione, un premio del 78%.

nFuse raccoglie 2 milioni di dollari per consentire ai piccoli rivenditori di ordinare tramite WhatsApp

nFuse ha raccolto 2 milioni di dollari da Eleven Ventures e LAUNCHub per una piattaforma di ordinazione B2B che funziona tramite WhatsApp e SMS.

nFuse raccoglie 2 milioni di dollari per consentire ai piccoli rivenditori di ordinare tramite WhatsApp

nFuse ha raccolto 2 milioni di dollari da Eleven Ventures e LAUNCHub per una piattaforma di ordinazione B2B che funziona tramite WhatsApp e SMS.

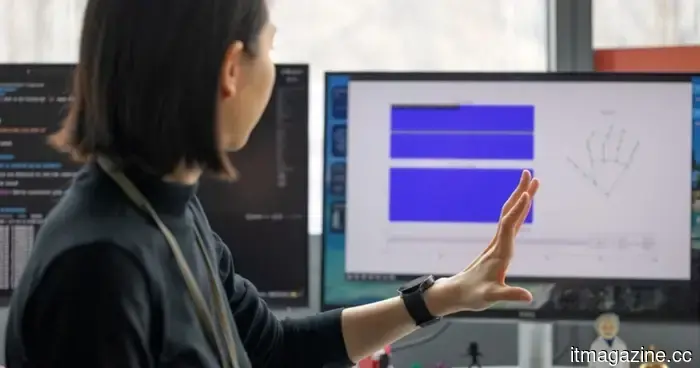

Il tuo smartwatch potrebbe presto permetterti di controllare il tuo PC attraverso gesti delle mani.

WatchHand è un nuovo sistema AI che trasforma normali smartwatch in dispositivi di tracciamento delle mani utilizzando il sonar, permettendoti potenzialmente di controllare i computer solo con gesti delle dita.

Il tuo smartwatch potrebbe presto permetterti di controllare il tuo PC attraverso gesti delle mani.

WatchHand è un nuovo sistema AI che trasforma normali smartwatch in dispositivi di tracciamento delle mani utilizzando il sonar, permettendoti potenzialmente di controllare i computer solo con gesti delle dita.

nFuse raccoglie 2 milioni di dollari per consentire ai piccoli rivenditori di ordinare tramite WhatsApp

nFuse ha raccolto 2 milioni di dollari da Eleven Ventures e LAUNCHub per una piattaforma di ordinazione B2B che funziona tramite WhatsApp e SMS.

nFuse raccoglie 2 milioni di dollari per consentire ai piccoli rivenditori di ordinare tramite WhatsApp

nFuse ha raccolto 2 milioni di dollari da Eleven Ventures e LAUNCHub per una piattaforma di ordinazione B2B che funziona tramite WhatsApp e SMS.

La nuova app di dettatura gratuita di Google è l'alternativa Willow che stavi aspettando.

Google AI Edge Eloquent è un'app di dettatura vocale gratuita e offline-first che pulisce automaticamente il discorso e entra in un mercato dove rivali a pagamento come Willow e Wispr Flow addebitano fino a 15 dollari al mese.

La nuova app di dettatura gratuita di Google è l'alternativa Willow che stavi aspettando.

Google AI Edge Eloquent è un'app di dettatura vocale gratuita e offline-first che pulisce automaticamente il discorso e entra in un mercato dove rivali a pagamento come Willow e Wispr Flow addebitano fino a 15 dollari al mese.

OpenAI ha lanciato una borsa di studio per la sicurezza

OpenAI ha annunciato una borsa di studio per la sicurezza esterna, poche ore dopo che un'inchiesta del New Yorker ha riportato che aveva sciolto il suo superallineamento.