OpenAI lanzó una beca de seguridad

La Beca de Seguridad de OpenAI, anunciada el 6 de abril de 2026, es un programa piloto para que investigadores externos realicen trabajos independientes sobre la seguridad y alineación de la IA. Se llevará a cabo desde septiembre de 2026 hasta febrero de 2027.

Se publicó en las redes sociales horas después de que una investigación de Ronan Farrow en The New Yorker informara que OpenAI había disuelto sus equipos de superalineación y preparación para AGI y había eliminado la seguridad de la lista de las actividades más significativas en sus declaraciones ante el IRS.

OpenAI ha anunciado la Beca de Seguridad de OpenAI, un programa piloto que financiará a un grupo de investigadores externos para realizar trabajos independientes sobre la seguridad y alineación de la IA.

El programa se desarrollará del 14 de septiembre de 2026 al 5 de febrero de 2027. Los becados recibirán un estipendio mensual, recursos informáticos y mentoría de investigadores de OpenAI, y se espera que produzcan un resultado de investigación significativo, un artículo, un punto de referencia o un conjunto de datos, para el final del programa.

Las solicitudes cierran el 3 de mayo, y los candidatos seleccionados serán notificados antes del 25 de julio.

Las áreas de investigación prioritarias incluyen evaluación de seguridad, robustez, estrategias de mitigación escalables, métodos de preservación de la privacidad, supervisión agente y dominios de uso indebido de alta gravedad.

OpenAI ha especificado que los becados recibirán créditos de API pero no acceso a sistemas internos. El programa se describe como un piloto, y la empresa dice que está abierto a investigadores de ciencias de la computación, ciencias sociales, ciberseguridad, privacidad e interacción humano-computadora, enfatizando la capacidad de investigación y el juicio técnico sobre las credenciales académicas.

El anuncio se publicó en las cuentas de redes sociales de OpenAI a las 12:12 PM del 6 de abril. Horas antes, The New Yorker publicó una importante investigación de Ronan Farrow y Andrew Marantz informando que OpenAI había disuelto tanto su equipo de superalineación como su equipo de preparación para AGI, y había eliminado la seguridad de la lista de sus actividades más significativas en sus declaraciones del Formulario 990 del IRS.

La investigación también informó que cuando los periodistas pidieron hablar con investigadores que trabajaban en seguridad existencial, un representante de OpenAI respondió: ‘¿Qué quieres decir con seguridad existencial? Eso no es, como, una cosa.’ Farrow notó el momento del anuncio de la beca explícitamente en las redes sociales.

El patrón de disoluciones de equipos de seguridad en OpenAI está documentado. El equipo de superalineación, anunciado a mediados de 2023 con un compromiso del 20% de la computación de la empresa durante cuatro años, fue disuelto en mayo de 2024 después de que los co-líderes Ilya Sutskever y Jan Leike se marcharan.

Leike escribió al irse que la cultura de seguridad y los procesos habían ‘quedado en un segundo plano frente a productos llamativos.’ El equipo de Preparación para AGI fue disuelto en octubre de 2024 cuando su líder, Miles Brundage, se fue.

El equipo de Alineación de Misión, sucesor de Superalineación, fue desmantelado en febrero de 2026 después de 16 meses. A principios de 2026, las personas más asociadas con la supervisión de seguridad en OpenAI habían en su mayoría partido o sido trasladadas a roles con responsabilidades indefinidas.

La investigación de The New Yorker también informó que la palabra ‘seguramente’ había sido eliminada de la declaración de misión de OpenAI en sus declaraciones ante el IRS.

OpenAI no ha respondido públicamente a las afirmaciones específicas en la investigación de The New Yorker. La Beca de Seguridad, tal como está estructurada, dirige a los investigadores externos hacia preguntas de seguridad a distancia de la empresa, en lugar de restaurar la infraestructura de seguridad interna.

Si un programa de becas externas es un sustituto significativo para la investigación de alineación interna es una pregunta que la comunidad de investigación de seguridad de IA probablemente debatirá en las próximas semanas.

Otros artículos

nFuse recauda $2 millones para permitir que pequeños minoristas hagan pedidos a través de WhatsApp

nFuse ha recaudado $2M de Eleven Ventures y LAUNCHub para una plataforma de pedidos B2B que funciona a través de WhatsApp y SMS.

nFuse recauda $2 millones para permitir que pequeños minoristas hagan pedidos a través de WhatsApp

nFuse ha recaudado $2M de Eleven Ventures y LAUNCHub para una plataforma de pedidos B2B que funciona a través de WhatsApp y SMS.

El próximo OnePlus 16 podría causar sensación con una gran actualización de la cámara.

OnePlus está entrando en el juego de las cámaras como si realmente quisiera ganar esta vez.

El próximo OnePlus 16 podría causar sensación con una gran actualización de la cámara.

OnePlus está entrando en el juego de las cámaras como si realmente quisiera ganar esta vez.

Tu próximo iPhone podría verse exactamente como el actual.

Las filtraciones de Weibo de Fixed Focus Digital sugieren que el iPhone 18 se verá casi idéntico a su predecesor, mientras que el iPhone Air 2 aún podría estar en camino para un lanzamiento en otoño de 2026.

Tu próximo iPhone podría verse exactamente como el actual.

Las filtraciones de Weibo de Fixed Focus Digital sugieren que el iPhone 18 se verá casi idéntico a su predecesor, mientras que el iPhone Air 2 aún podría estar en camino para un lanzamiento en otoño de 2026.

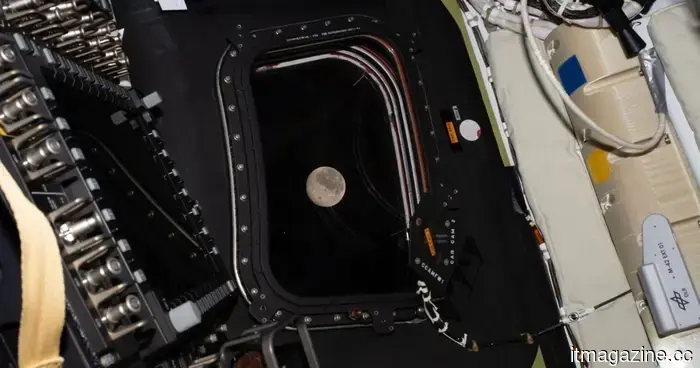

Primeros notables de la misión lunar Artemis II … hasta ahora

Después de haber orbitado la luna en un histórico sobrevuelo de nuestro vecino más cercano, la tripulación del Artemis II está ahora de regreso a la Tierra. Victor Glover, Reid Wiseman y Christina Koch de la NASA, junto con Jeremy Hansen de la Agencia Espacial Canadiense, lanzaron a bordo de la nave espacial Orion desde el Centro Espacial Kennedy el 1 de abril, […]

Primeros notables de la misión lunar Artemis II … hasta ahora

Después de haber orbitado la luna en un histórico sobrevuelo de nuestro vecino más cercano, la tripulación del Artemis II está ahora de regreso a la Tierra. Victor Glover, Reid Wiseman y Christina Koch de la NASA, junto con Jeremy Hansen de la Agencia Espacial Canadiense, lanzaron a bordo de la nave espacial Orion desde el Centro Espacial Kennedy el 1 de abril, […]

nFuse recauda $2 millones para permitir que pequeños minoristas hagan pedidos a través de WhatsApp

nFuse ha recaudado $2M de Eleven Ventures y LAUNCHub para una plataforma de pedidos B2B que funciona a través de WhatsApp y SMS.

nFuse recauda $2 millones para permitir que pequeños minoristas hagan pedidos a través de WhatsApp

nFuse ha recaudado $2M de Eleven Ventures y LAUNCHub para una plataforma de pedidos B2B que funciona a través de WhatsApp y SMS.

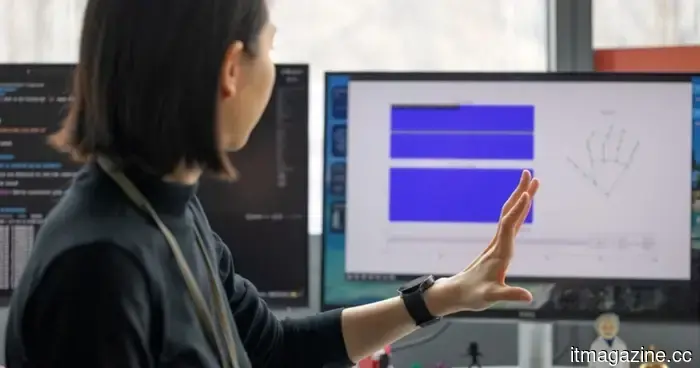

Tu reloj inteligente podría pronto permitirte controlar tu PC a través de gestos de la mano.

WatchHand es un nuevo sistema de IA que convierte relojes inteligentes comunes en dispositivos de seguimiento de manos utilizando sonar, lo que potencialmente te permite controlar computadoras solo con gestos de los dedos.

Tu reloj inteligente podría pronto permitirte controlar tu PC a través de gestos de la mano.

WatchHand es un nuevo sistema de IA que convierte relojes inteligentes comunes en dispositivos de seguimiento de manos utilizando sonar, lo que potencialmente te permite controlar computadoras solo con gestos de los dedos.

OpenAI lanzó una beca de seguridad

OpenAI anunció una beca externa de Seguridad, horas después de que una investigación de New Yorker informara que había disuelto su superalineación.