La ronda de $220 millones de Fractile llega mientras Anthropic pone la mira en su silicio en el Reino Unido.

Accel lideró la ronda de la startup de chips de Londres, con Pat Gelsinger uniéndose como inversor ángel, semanas después de que se informara que Anthropic estaba en conversaciones iniciales para convertirse en cliente.

Fractile, la startup con sede en Londres que diseña chips de inferencia que colocan la computación y la memoria en el mismo chip, ha recaudado 220 millones de dólares para llevar su hardware a producción, dijo la compañía el martes.

La ronda cierra por encima del objetivo reportado de 200 millones de dólares que se entendía que la compañía estaba sondeando a finales de marzo, como señaló por primera vez Electronics Weekly, y eleva a Fractile a la cohorte de empresas de chips europeas que se presentan como alternativas a Nvidia en la capa de inferencia.

El perfil de los inversores es lo que le da peso a la ronda. Se entiende que Accel ha liderado, con el exdirector ejecutivo de Intel, Pat Gelsinger, participando como ángel y asesor operativo.

El 💜 de la tecnología de la UE Las últimas novedades de la escena tecnológica de la UE, una historia de nuestro sabio fundador Boris, y un arte de IA cuestionable. Es gratis, cada semana, en tu bandeja de entrada. ¡Inscríbete ahora! Los patrocinadores existentes Kindred Capital, el Fondo de Innovación de la OTAN y Oxford Science Enterprises, que co-lideraron la ronda de semillas de 15 millones de dólares de Fractile en julio de 2024, son parte de la ronda.

El argumento tecnológico va en contra de la arquitectura predominante. Los aceleradores de IA convencionales, incluidos los GPUs H y B de Nvidia, separan el chip de computación de la memoria de alto ancho de banda y pagan un impuesto de energía y latencia al trasladar datos entre ellos.

El diseño de Fractile, en cambio, realiza las multiplicaciones de matrices que dominan la inferencia de transformadores dentro de celdas SRAM ubicadas junto a la lógica de computación, un enfoque de computación en memoria que la compañía dice que elimina la mayor parte de la dependencia de DRAM que actualmente es la restricción vinculante en el costo de inferencia.

Fractile afirma que el chip resultante puede ejecutar modelos de frontera hasta 100 veces más rápido y 10 veces más barato que las configuraciones actuales de GPU; materiales de inversores más recientes enmarcan la comparación como 25 veces más rápido a una décima parte del costo.

Si esos números se mantienen bajo cargas de producción es la pregunta técnica central. La compañía hasta ahora ha divulgado resultados de simulación y de pequeño silicio en lugar de referencias a gran escala contra clústeres de GPU desplegados.

Se espera que el primer chip comercial de Fractile no esté disponible hasta 2027, una línea de tiempo que la compañía ha reiterado públicamente, y los 220 millones de dólares están dimensionados para llevar el diseño a través de la salida de cinta, la construcción de la pila de software y la integración temprana de clientes en lugar de un aumento de producción completo.

El lado del cliente es donde la ronda llega en el momento adecuado. Anthropic está en conversaciones iniciales para comprar chips de Fractile cuando estén disponibles, informaron múltiples medios a principios de este mes.

Si la relación se formaliza, Fractile se convertiría en el cuarto proveedor de computación nombrado de Anthropic junto a Nvidia, los TPUs de Google y las partes Trainium e Inferentia de Amazon.

Anthropic ha estado explorando por separado la construcción de sus propios chips de IA personalizados, pero la pista de Fractile sugiere que aún está persiguiendo una cobertura de múltiples proveedores.

Fractile también es parte de un pequeño grupo de startups de chips europeas cuyo argumento es que el mercado de inferencia es estructuralmente distinto del entrenamiento y, por lo tanto, ganable.

TNW ha seguido a tres de estas empresas durante el último año. El argumento es que el entrenamiento seguirá requiriendo los sistemas más grandes y exóticos y que el foso de CUDA de Nvidia es más fuerte allí, mientras que la inferencia, la carga de trabajo que realmente consume la mayor parte de los dólares una vez que se despliega un modelo, recompensa arquitecturas especializadas ajustadas para el rendimiento y la energía por token en lugar de los FLOPs máximos.

El conjunto competitivo en esa tesis se está volviendo concurrido. Groq ha enviado sus unidades de procesamiento de lenguaje a múltiples proveedores de modelos y recientemente recaudó a una valoración de 6.9 mil millones de dólares; Etched está construyendo silicio específico para transformadores; Cerebras y SambaNova han recaudado contra la misma carga de trabajo desde diferentes ángulos.

Google mismo está ensamblando una cadena de suministro de chips de inferencia con cuatro socios junto a Broadcom, MediaTek y Marvell para desafiar a Nvidia en la capa de inferencia. La afirmación de Fractile es que su arquitectura en memoria gana en la métrica que más importa para la inferencia sensible al costo, vatios por token útil.

La ronda sigue al anuncio de Fractile en febrero de una expansión de 100 millones de libras (132 millones de dólares) a tres años de sus operaciones en Londres y Bristol, incluyendo un nuevo sitio de ingeniería de hardware en Bristol, y se ajusta al impulso más amplio de IA soberana del Reino Unido que también produjo la asociación de centros de datos de BT, Nscale y Nvidia en abril.

El fundador y director ejecutivo Walter Goodwin, un PhD del Instituto de Robótica de Oxford ahora en sus veintes, ha sido la cara pública de la propuesta.

El equipo ha atraído ingenieros de Graphcore, Nvidia e Imagination Technologies, y está construyendo su pila de software junto al silicio. La salida de cinta y la integración de clientes son los próximos hitos visibles.

Otros artículos

Amazon coloca a Alexa dentro de la barra de búsqueda a medida que el comercio agente se intensifica

Amazon está incorporando Alexa para Compras, una versión unificada de Rufus y Alexa+, dentro de la barra de búsqueda principal en Amazon.com.

Amazon coloca a Alexa dentro de la barra de búsqueda a medida que el comercio agente se intensifica

Amazon está incorporando Alexa para Compras, una versión unificada de Rufus y Alexa+, dentro de la barra de búsqueda principal en Amazon.com.

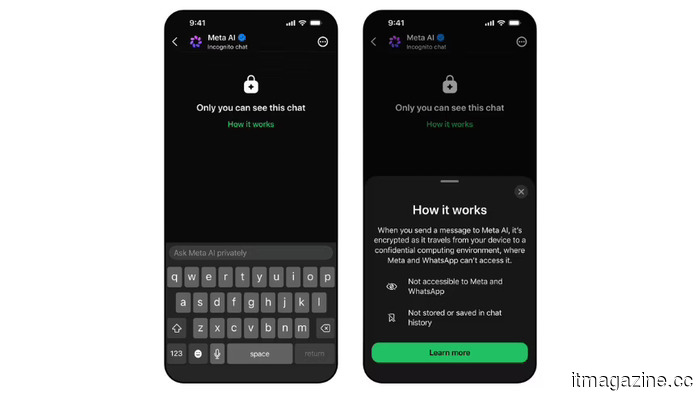

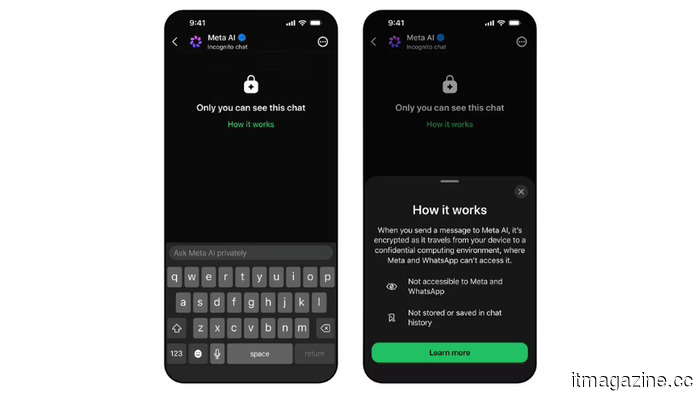

Meta lanza Incognito Chat en WhatsApp, el primer modo de IA que dice que ni siquiera Meta puede leer.

Meta ha lanzado Incognito Chat con Meta AI en WhatsApp, con conversaciones procesadas dentro de un enclave seguro al que la empresa dice que ni siquiera sus propios ingenieros pueden acceder.

Meta lanza Incognito Chat en WhatsApp, el primer modo de IA que dice que ni siquiera Meta puede leer.

Meta ha lanzado Incognito Chat con Meta AI en WhatsApp, con conversaciones procesadas dentro de un enclave seguro al que la empresa dice que ni siquiera sus propios ingenieros pueden acceder.

Meta lanza Incognito Chat en WhatsApp, el primer modo de IA que dice que ni siquiera Meta puede leer.

Meta ha lanzado Incognito Chat con Meta AI en WhatsApp, con conversaciones procesadas dentro de un enclave seguro al que la empresa dice que ni siquiera sus propios ingenieros pueden acceder.

Meta lanza Incognito Chat en WhatsApp, el primer modo de IA que dice que ni siquiera Meta puede leer.

Meta ha lanzado Incognito Chat con Meta AI en WhatsApp, con conversaciones procesadas dentro de un enclave seguro al que la empresa dice que ni siquiera sus propios ingenieros pueden acceder.

LinkedIn se convierte en el último nombre en una lista de despidos tecnológicos de 100,000 empleos.

LinkedIn está despidiendo aproximadamente al 5% de su personal, lo que es lo último en una ola de despidos tecnológicos de 2026 que ha desplazado a más de 100,000 trabajadores.

LinkedIn se convierte en el último nombre en una lista de despidos tecnológicos de 100,000 empleos.

LinkedIn está despidiendo aproximadamente al 5% de su personal, lo que es lo último en una ola de despidos tecnológicos de 2026 que ha desplazado a más de 100,000 trabajadores.

La ronda de $220 millones de Fractile llega mientras Anthropic pone la mira en su silicio en el Reino Unido.

Fractile ha recaudado $220 millones para llevar su chip de inferencia basado en SRAM a producción, con Accel liderando e invirtiendo Pat Gelsinger.