Usuarios no autorizados obtuvieron acceso al modelo de IA Mythos restringido de Anthropic.

Un pequeño grupo se comunicó a través de un canal privado de Discord al que accedió a Claude Mythos Preview adivinando la URL del modelo el mismo día en que Anthropic anunció públicamente el Proyecto Glasswing. Anthropic dice que está investigando y no ha encontrado evidencia de impacto en sus sistemas centrales. La brecha destaca los riesgos de restringir el acceso a las capacidades de IA de frontera a través de entornos de proveedores en lugar de controles técnicos.

Un pequeño grupo de usuarios no autorizados accedió a Claude Mythos Preview, el modelo de IA de ciberseguridad de Anthropic, que está estrechamente restringido, el mismo día en que la compañía anunció públicamente la existencia del modelo, aparentemente adivinando la URL del modelo basándose en su familiaridad con las convenciones de formato de URL de Anthropic para otros modelos, según un informe de Bloomberg News publicado el 21 de abril.

El grupo, cuyos miembros se comunican a través de un canal privado de Discord dedicado a reunir inteligencia sobre modelos de IA no publicados, ha estado utilizando Mythos regularmente desde que obtuvo acceso y proporcionó a Bloomberg pruebas en forma de capturas de pantalla y una demostración en vivo.

Anthropic confirmó que está investigando las afirmaciones: “Estamos investigando un informe que afirma el acceso no autorizado a Claude Mythos Preview a través de uno de nuestros entornos de proveedores externos.”

La compañía dijo que actualmente no hay evidencia de que el acceso haya impactado los sistemas centrales de Anthropic o se haya extendido más allá del entorno del proveedor en cuestión.

Un individuo actualmente empleado en un contratista externo que trabaja con Anthropic parece haber estado involucrado, al menos en parte, en facilitar el acceso del grupo, informó el medio.

La importancia de la brecha es inseparable de la naturaleza del modelo. Anthropic anunció Mythos Preview y la iniciativa del Proyecto Glasswing el 7 de abril de 2026.

La compañía retuvo el modelo de la liberación general específicamente debido a sus capacidades cibernéticas ofensivas: en pruebas, Mythos descubrió de forma autónoma miles de vulnerabilidades de día cero previamente desconocidas en todos los principales sistemas operativos y navegadores web, y escribió exploits funcionales, incluyendo la cadena de cuatro vulnerabilidades en un navegador para escapar tanto de los entornos de renderizado como de los sistemas operativos, una hazaña que normalmente requeriría meses de trabajo experto.

Ingenieros de Anthropic sin formación formal en seguridad pidieron al modelo que encontrara vulnerabilidades de ejecución remota de código durante la noche y se despertaron con exploits completos y funcionales. La compañía dijo que estaba reteniendo el modelo porque las mismas capacidades que lo hacen poderoso para la defensa podrían ser devastadoras en las manos equivocadas.

El Proyecto Glasswing fue diseñado para navegar esa tensión: en lugar de un lanzamiento público, Anthropic extendió el acceso a Mythos a 12 socios de lanzamiento nombrados, Amazon Web Services, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorganChase, la Fundación Linux, Microsoft, Nvidia y Palo Alto Networks, además de Anthropic mismo, para trabajos de seguridad defensiva, con alrededor de 40 organizaciones adicionales también autorizadas a acceder.

La iniciativa también incluyó $100 millones en créditos de uso y $4 millones en donaciones directas a organizaciones de seguridad de código abierto. El lanzamiento restringido fue el intento explícito de Anthropic de dar a los defensores una ventaja sobre los atacantes antes de que un modelo con estas capacidades se proliferara.

El acceso no autorizado socava esa lógica sin derrotarla por completo: el grupo en cuestión supuestamente describió sus intenciones como impulsadas por la curiosidad, pero la intención no es un salvaguarda confiable cuando la herramienta en cuestión puede producir de forma autónoma exploits utilizables como armas.

La brecha también tiene peso político, llegando el día después de que el presidente Trump dijera en CNBC que un acuerdo del Pentágono con Anthropic era "posible" y que la compañía se estaba "preparando". Anthropic está simultáneamente demandando al Departamento de Defensa por su inclusión en la lista negra como un riesgo de cadena de suministro, con esa disputa centrada específicamente en la cuestión de cuán seguro se puede controlar su IA.

Un incidente de acceso no autorizado, incluso uno aparentemente enrutado a través de un entorno de proveedor externo en lugar de la propia infraestructura de Anthropic, proporciona municiones a aquellos en la administración que han argumentado que Anthropic no puede gobernar de manera confiable el acceso a sus propias herramientas.

También complica el caso de la compañía en los tribunales, que se basa en parte en su argumento de que aplica rigurosos controles de seguridad y acceso a sus modelos más capaces.

El mecanismo de acceso, una suposición educada sobre la URL del modelo, habilitada por el conocimiento de las convenciones de Anthropic para otros puntos finales de modelos, apunta a un modo de fallo específico que es distinto de una violación de datos convencional o intrusión.

El grupo no eludió la arquitectura de seguridad de Anthropic tanto como explotó la brecha entre los controles de Anthropic sobre sus propios sistemas y los de un proveedor externo con credenciales de acceso.

Esa distinción es importante para la investigación y para cómo el incidente debe ser interpretado por la industria de IA en general: es un fallo de seguridad del proveedor tanto como un fallo de gobernanza del modelo. Pero el resultado es el mismo.

Otros artículos

Japanet cuadruplica su fondo de capital de riesgo a $200 millones después de que sus primeras inversiones en Anthropic y xAI generen retornos extraordinarios.

El gigante japonés de compras por televisión Japanet amplía su fondo de inversión de $50 millones a $200 millones después de inversiones iniciales en Anthropic, xAI y OpenAI a través de Pegasus Tech Ventures.

Japanet cuadruplica su fondo de capital de riesgo a $200 millones después de que sus primeras inversiones en Anthropic y xAI generen retornos extraordinarios.

El gigante japonés de compras por televisión Japanet amplía su fondo de inversión de $50 millones a $200 millones después de inversiones iniciales en Anthropic, xAI y OpenAI a través de Pegasus Tech Ventures.

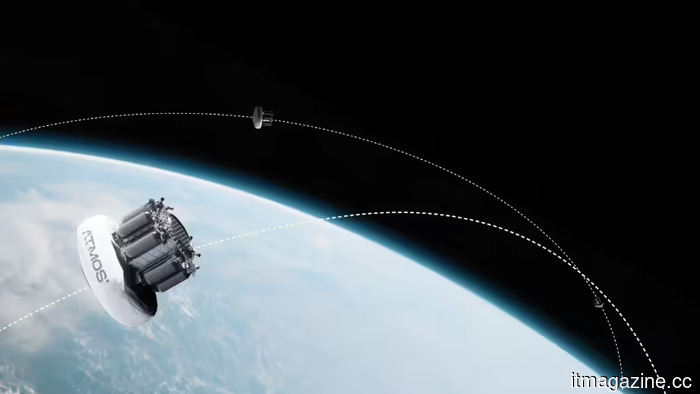

ATMOS recauda 25,7 millones de euros para hacer que el retorno orbital sea rutinario

ATMOS Space Cargo cierra una ronda de financiación Serie A de 25,7 millones de euros para financiar tres misiones de retorno orbital PHOENIX 2, un nuevo negocio de defensa ATMOS WORKS y el desarrollo de PHOENIX 3.

ATMOS recauda 25,7 millones de euros para hacer que el retorno orbital sea rutinario

ATMOS Space Cargo cierra una ronda de financiación Serie A de 25,7 millones de euros para financiar tres misiones de retorno orbital PHOENIX 2, un nuevo negocio de defensa ATMOS WORKS y el desarrollo de PHOENIX 3.

ATMOS recauda 25,7 millones de euros para hacer que el regreso orbital sea rutinario

ATMOS Space Cargo cierra una ronda de financiación Serie A de 25,7 millones de euros para financiar tres misiones de retorno orbital PHOENIX 2, un nuevo negocio de defensa ATMOS WORKS y el desarrollo de PHOENIX 3.

ATMOS recauda 25,7 millones de euros para hacer que el regreso orbital sea rutinario

ATMOS Space Cargo cierra una ronda de financiación Serie A de 25,7 millones de euros para financiar tres misiones de retorno orbital PHOENIX 2, un nuevo negocio de defensa ATMOS WORKS y el desarrollo de PHOENIX 3.

Altrucos nuevos del Galaxy S26 están llegando a los antiguos buques insignia y dispositivos plegables de Samsung.

Samsung está llevando algunas funciones de IA del Galaxy S26 a teléfonos insignia y plegables Galaxy más antiguos a través de One UI 8.5.

Altrucos nuevos del Galaxy S26 están llegando a los antiguos buques insignia y dispositivos plegables de Samsung.

Samsung está llevando algunas funciones de IA del Galaxy S26 a teléfonos insignia y plegables Galaxy más antiguos a través de One UI 8.5.

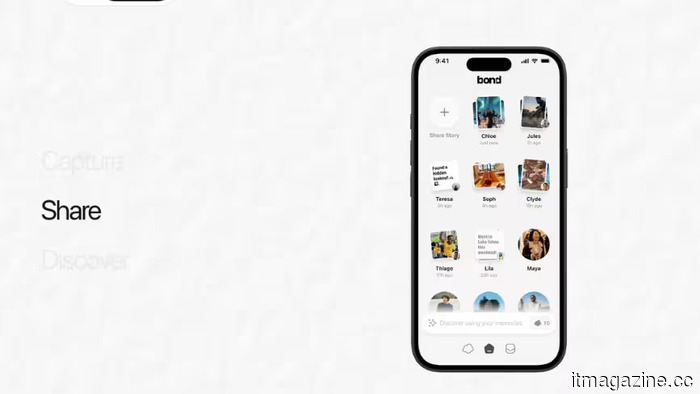

Bond lanza una red social de post-feed utilizando recuerdos de IA para combatir el doomscrolling, pero su modelo de datos plantea preguntas.

Bond no tiene alimentación y no tiene desplazamiento infinito. Su IA aprende de tus fotos y videos para recomendar actividades en el mundo real. Su modelo de negocio planea licenciar esos datos.

La apuesta de $40 millones de NeoCognition en agentes de IA autoaprendices

NeoCognition recauda $40 millones de Cambium Capital, Walden Catalyst, Vista, el CEO de Intel Lip-Bu Tan y Databricks para construir agentes de IA autoaprendices para empresas.

Bond lanza una red social de post-feed utilizando recuerdos de IA para combatir el doomscrolling, pero su modelo de datos plantea preguntas.

Bond no tiene alimentación y no tiene desplazamiento infinito. Su IA aprende de tus fotos y videos para recomendar actividades en el mundo real. Su modelo de negocio planea licenciar esos datos.

La apuesta de $40 millones de NeoCognition en agentes de IA autoaprendices

NeoCognition recauda $40 millones de Cambium Capital, Walden Catalyst, Vista, el CEO de Intel Lip-Bu Tan y Databricks para construir agentes de IA autoaprendices para empresas.

Usuarios no autorizados obtuvieron acceso al modelo de IA Mythos restringido de Anthropic.

Un grupo de Discord accedió al modelo de IA Mythos de Anthropic en su día de lanzamiento adivinando su URL a través de un entorno de un proveedor externo.