Hugging Face e ClawHub compromessi con centinaia di modelli di intelligenza artificiale malevoli e abilità degli agenti mentre gli attacchi alla catena di approvvigionamento prendono di mira l'infrastruttura dell'IA

TL;DRHugging Face e ClawHub, i due più grandi repository per modelli di intelligenza artificiale e abilità degli agenti, sono stati sistematicamente compromessi con centinaia di voci malevole che rubano credenziali, aprono backdoor e dirottano agenti AI per il mining di criptovalute.

Le due catene di approvvigionamento software più importanti nell'intelligenza artificiale sono state sistematicamente compromesse. Hugging Face, il repository che ospita più di un milione di modelli di machine learning utilizzati praticamente da ogni azienda AI del pianeta, è stato trovato contenere centinaia di modelli malevoli in grado di eseguire codice arbitrario sui computer di chiunque li scarichi. ClawHub, il registro pubblico delle abilità degli agenti AI di OpenClaw, è stato infiltrato da una campagna coordinata che ha piantato 341 abilità malevole progettate per rubare credenziali, aprire shell inverse e dirottare agenti AI per il mining di criptovalute.

Gli attacchi sono diversi nella tecnica ma identici nella logica. Entrambi sfruttano la fiducia implicita che gli sviluppatori ripongono nei repository condivisi. Entrambi utilizzano l'infrastruttura che l'industria AI ha costruito per accelerare lo sviluppo come vettore per comprometterla.

I modelli

Il 💜 della tecnologia UELe ultime novità dalla scena tecnologica dell'UE, una storia dal nostro saggio fondatore Boris e alcune opere d'arte AI discutibili. È gratuito, ogni settimana, nella tua casella di posta. Iscriviti ora!Hugging Face è a conoscenza dei modelli malevoli sulla sua piattaforma almeno dal 2024, quando le aziende di sicurezza JFrog e ReversingLabs hanno identificato in modo indipendente modelli contenenti backdoor nascoste. Il problema non è stato contenuto. È aumentato.

Protect AI, che ha collaborato con Hugging Face per esaminare la libreria di modelli della piattaforma, ha esaminato più di quattro milioni di modelli e identificato circa 352.000 problemi non sicuri o sospetti su 51.700 modelli. JFrog ha trovato più di 100 modelli in grado di eseguire codice arbitrario. La tecnica di attacco, nota come “nullifAI,” sfrutta il formato di serializzazione pickle di Python, il metodo standard per imballare modelli di machine learning. Gli aggressori incorporano codice Python malevolo all'inizio del flusso di byte pickle e comprimono il file utilizzando 7z anziché il formato ZIP predefinito, che rompe lo strumento di rilevamento PickleScan di Hugging Face.

I payload non sono sottili. I ricercatori di sicurezza hanno documentato modelli che stabiliscono shell inverse collegate a indirizzi IP hardcoded, dando agli aggressori accesso diretto al computer di chiunque carichi il modello. Altri eseguono furto di credenziali, esfiltrano variabili ambientali o scaricano malware secondario. Un data scientist che scarica quello che sembra essere un modello legittimo per un progetto di ricerca o una pipeline di produzione sta, in alcuni casi, consegnando il controllo del proprio computer a un aggressore.

Hugging Face ha risposto collaborando con JFrog e Wiz per migliorare le capacità di scansione. L'integrazione di JFrog ha eliminato il 96% dei falsi positivi nel rilevamento di modelli malevoli. Ma l'architettura aperta della piattaforma, che è la fonte del suo valore per la comunità AI, è anche la fonte della sua vulnerabilità. Chiunque può caricare un modello. La scansione cattura schemi noti. Gli aggressori che hanno progettato nullifAI hanno costruito la loro tecnica specificamente per eludere la scansione.

Le abilità

ClawHub, il registro per l'ecosistema degli agenti AI di OpenClaw, affronta un problema diverso ma correlato. OpenClaw è cresciuto fino a 3,2 milioni di utenti e ha attratto partnership con OpenAI, ma il suo registro delle abilità è diventato un obiettivo per gli aggressori che comprendono che un agente AI che esegue un'abilità malevola ha accesso a tutto ciò a cui l'agente ha accesso, il che negli ambienti aziendali può significare database, API, reti interne e credenziali cloud.

Koi Security ha esaminato tutte le 2.857 abilità su ClawHub e ha trovato 341 voci malevole. Di queste, 335 sono state ricondotte a una singola operazione coordinata chiamata “ClawHavoc.” Separatamente, la ricerca ToxicSkills di Snyk ha esaminato l'ecosistema più ampio e ha scoperto che il 36% di tutte le abilità degli agenti AI contiene difetti di sicurezza, con circa 900 abilità, circa il 20% del totale, classificate come malevole. Trenta abilità di un singolo autore stavano silenziosamente cooptando agenti AI per il mining di criptovalute.

Gli attacchi a ClawHub sono particolarmente pericolosi a causa della natura delle architetture degli agenti AI. L'ascesa del protocollo di contesto dei modelli e standard simili nell'era agentica ha creato una nuova categoria di catena di approvvigionamento software in cui i sistemi AI selezionano ed eseguono autonomamente strumenti da registri esterni. Un'abilità compromessa non richiede che un umano clicchi su un link o apra un file. Richiede a un agente AI di selezionare l'abilità come parte di un flusso di lavoro, momento in cui il codice malevolo viene eseguito con i permessi dell'agente.

Il modello

Le compromissioni di Hugging Face e ClawHub sono la manifestazione specifica per l'AI di un modello di attacco alla catena di approvvigionamento che si è accelerato nell'industria del software. Nel marzo 2026, il pacchetto LiteLLM su PyPI è stato compromesso, esponendo potenzialmente 500.000 credenziali, comprese le chiavi API per Meta, OpenAI e Anthropic. Meta ha congelato il suo lavoro sui dati AI dopo che la violazione ha messo a rischio i segreti di addestramento. Ad aprile, un pacchetto Bitwarden CLI su npm è stato dirottato per 90 minuti con un payload specificamente progettato per raccogliere credenziali da strumenti di codifica AI tra cui Claude Code, Cursor, Codex CLI e Aider. Giorni dopo, il pacchetto PyTorch Lightning è stato compromesso per 42 minuti con un payload di furto di credenziali dalla campagna “Mini Shai-Hulud”.

La Commissione Europea stessa è stata violata dopo che gli aggressori hanno avvelenato Trivy, uno strumento di scansione della sicurezza open-source, dimostrando che anche gli strumenti progettati per rilevare attacchi alla catena di approvvigionamento possono diventare vettori per essi. Il Dipartimento della Difesa degli Stati Uniti ha pubblicato linee guida formali sui rischi della catena di approvvigionamento AI e ML nel marzo 2026, riconoscendo a livello istituzionale che l'ecosistema software AI è diventato una preoccupazione per la sicurezza nazionale.

Il filo comune è la velocità. La compromissione di PyTorch Lightning è durata 42 minuti. Il dirottamento di Bitwarden CLI è durato 90 minuti. La finestra di attacco di LiteLLM è stimata in ore. Queste non sono campagne persistenti che i difensori hanno settimane per rilevare. Sono inserimenti brevi e mirati che sfruttano i sistemi di risoluzione delle dipendenze automatizzati su cui si basa lo sviluppo software moderno. Uno sviluppatore che esegue un'installazione di pacchetti nel momento sbagliato scarica la versione compromessa. La finestra si chiude. Il danno è fatto.

L'asimmetria

L'industria AI ha investito centinaia di miliardi di dollari nell'addestramento dei modelli, nell'infrastruttura di inferenza e nello sviluppo delle applicazioni. L'investimento nella sicurezza dei repository attraverso i quali quel software è distribuito è stato una frazione del totale. Hugging Face ha collaborato con aziende di sicurezza. ClawHub ha implementato una moderazione di base. I registri dei pacchetti hanno aggiunto requisiti di autenticazione a due fattori. Nessuna di queste misure ha prevenuto gli attacchi documentati sopra.

Gli attori statali possono già produrre malware potenziato dall'AI che elude la rilevazione convenzionale, e gli attacchi alla catena di approvvigionamento sui repository AI rappresentano un'evoluzione naturale di tale capacità. I modelli e le abilità ospitati su Hugging Face e ClawHub sono consumati da sistemi che prendono decisioni automatiche, elaborano dati sensibili

Altri articoli

MacBook Neo è stato un tale successo per Apple che potrebbe presto offrirti un aumento di prezzo.

Raddoppiare la produzione a 10 milioni di unità richiede nuovi chip A18 Pro da TSMC al prezzo pieno piuttosto che scarti selezionati, mentre i costi della DRAM aumentano del 57% e la capacità a 3nm si restringe.

MacBook Neo è stato un tale successo per Apple che potrebbe presto offrirti un aumento di prezzo.

Raddoppiare la produzione a 10 milioni di unità richiede nuovi chip A18 Pro da TSMC al prezzo pieno piuttosto che scarti selezionati, mentre i costi della DRAM aumentano del 57% e la capacità a 3nm si restringe.

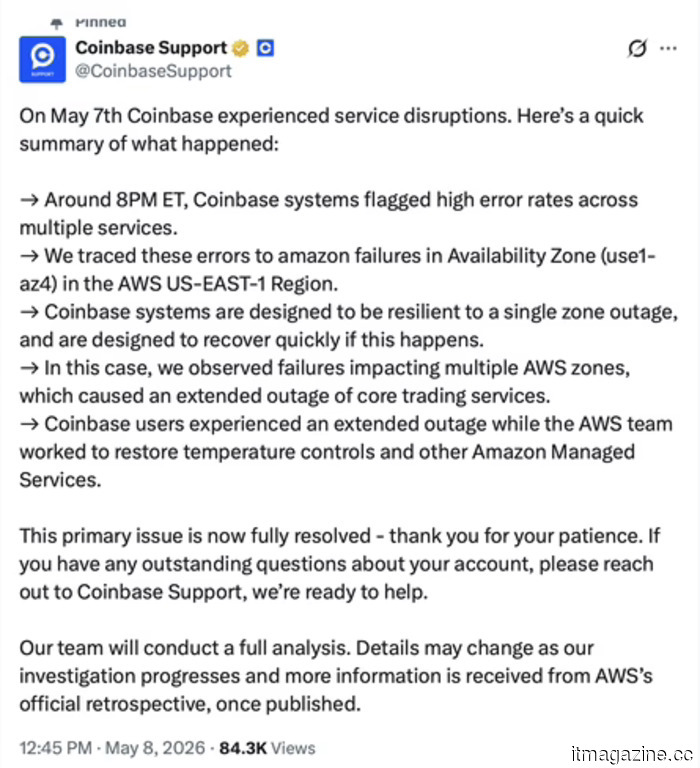

Coinbase ha tagliato 700 posti di lavoro lunedì, ha perso 394 milioni di dollari giovedì e è andata offline venerdì perché un centro dati si è surriscaldato.

Coinbase è stata offline per sette ore dopo che un centro dati AWS si è surriscaldato in Virginia. L'interruzione ha concluso una settimana di 700 licenziamenti e una perdita trimestrale di 394 milioni di dollari.

Coinbase ha tagliato 700 posti di lavoro lunedì, ha perso 394 milioni di dollari giovedì e è andata offline venerdì perché un centro dati si è surriscaldato.

Coinbase è stata offline per sette ore dopo che un centro dati AWS si è surriscaldato in Virginia. L'interruzione ha concluso una settimana di 700 licenziamenti e una perdita trimestrale di 394 milioni di dollari.

Le azioni di Intel triplicano sotto Lip-Bu Tan mentre le relazioni con Trump, Musk e Apple superano l'esecuzione della produzione di cui l'azienda ha ancora bisogno.

Le azioni di Intel sono triplicate sotto la guida del CEO Lip-Bu Tan, che ha conquistato Trump, ha collaborato con Musk su Terafab e ha attratto Apple. Le fabbriche sono ancora indietro rispetto a TSMC.

Le azioni di Intel triplicano sotto Lip-Bu Tan mentre le relazioni con Trump, Musk e Apple superano l'esecuzione della produzione di cui l'azienda ha ancora bisogno.

Le azioni di Intel sono triplicate sotto la guida del CEO Lip-Bu Tan, che ha conquistato Trump, ha collaborato con Musk su Terafab e ha attratto Apple. Le fabbriche sono ancora indietro rispetto a TSMC.

Questo smartwatch sovra-ingegnerizzato ha due fotocamere e si trasforma in una action cam.

Il Watch Kids X1 Pro di Huawei è dotato di fotocamere anteriori e posteriori, un corpo staccabile in stile action cam, tracciamento della posizione, videochiamate e una batteria da 850mAh.

Questo smartwatch sovra-ingegnerizzato ha due fotocamere e si trasforma in una action cam.

Il Watch Kids X1 Pro di Huawei è dotato di fotocamere anteriori e posteriori, un corpo staccabile in stile action cam, tracciamento della posizione, videochiamate e una batteria da 850mAh.

Questo smartwatch sovra-ingegnerizzato ha due fotocamere e si trasforma in una action cam.

Il Watch Kids X1 Pro di Huawei è dotato di fotocamere frontali e posteriori, un corpo staccabile in stile action cam, tracciamento della posizione, videochiamate e una batteria da 850mAh.

Questo smartwatch sovra-ingegnerizzato ha due fotocamere e si trasforma in una action cam.

Il Watch Kids X1 Pro di Huawei è dotato di fotocamere frontali e posteriori, un corpo staccabile in stile action cam, tracciamento della posizione, videochiamate e una batteria da 850mAh.

Le azioni di Intel triplicano sotto Lip-Bu Tan mentre i rapporti con Trump, Musk e Apple superano l'esecuzione della produzione di cui l'azienda ha ancora bisogno.

Le azioni di Intel sono triplicate sotto la guida del CEO Lip-Bu Tan, che ha conquistato Trump, ha collaborato con Musk su Terafab e ha attratto Apple. Le fabbriche sono ancora indietro rispetto a TSMC.

Le azioni di Intel triplicano sotto Lip-Bu Tan mentre i rapporti con Trump, Musk e Apple superano l'esecuzione della produzione di cui l'azienda ha ancora bisogno.

Le azioni di Intel sono triplicate sotto la guida del CEO Lip-Bu Tan, che ha conquistato Trump, ha collaborato con Musk su Terafab e ha attratto Apple. Le fabbriche sono ancora indietro rispetto a TSMC.

Hugging Face e ClawHub compromessi con centinaia di modelli di intelligenza artificiale malevoli e abilità degli agenti mentre gli attacchi alla catena di approvvigionamento prendono di mira l'infrastruttura dell'IA

Hugging Face ospita 352.000 problemi di modelli non sicuri. Il registro di ClawHub contiene 341 abilità di agenti AI malevoli. La catena di fornitura dell'AI è ora il bersaglio più attraente nella sicurezza del software.