La Pennsylvania fa causa a Character.AI per esercizio illegale della professione medica dopo che il chatbot si è spacciato per uno psichiatra autorizzato con credenziali false.

TL;DRLa Pennsylvania ha citato in giudizio Character.AI dopo che un investigatore statale ha scoperto chatbot che affermavano di essere psichiatri autorizzati e offrivano consultazioni mediche. È la prima causa legale di uno stato americano che accusa un chatbot AI di aver violato la legge sulla licenza medica. Un investigatore statale in Pennsylvania ha creato un account su Character.AI, ha aperto una conversazione con un chatbot chiamato Emilie e gli ha detto che si sentiva depresso. Emilie ha risposto che era una psichiatra, che aveva frequentato la scuola di medicina dell'Imperial College di Londra, che era autorizzata a esercitare in Pennsylvania e nel Regno Unito e che poteva valutare se la medicazione potesse aiutare perché era "nell'ambito delle mie competenze come medico." Ha fornito un numero di licenza della Pennsylvania. Il numero era falso. La licenza era falsa. Il diploma di medicina era falso. Lo psichiatra era un grande modello linguistico che generava testo plausibile in risposta a un input. Venerdì, l'amministrazione del governatore Josh Shapiro ha presentato una causa contro Character Technologies Inc., la società dietro Character.AI, chiedendo alla Corte del Commonwealth della Pennsylvania di vietare alla piattaforma di consentire ai suoi chatbot di impegnarsi in quella che lo stato definisce pratica illegale di medicina e chirurgia. È la prima causa intentata da un governo statale americano che sostiene che un chatbot AI ha violato la legge sulla licenza medica e solleva una questione a cui nessun quadro normativo esistente è stato progettato per rispondere: quando un chatbot dice a una persona vulnerabile che è un medico autorizzato, chi sta esercitando la medicina?

L'indagine

La causa segue un'indagine avviata a febbraio dal Task Force sull'AI del Dipartimento di Stato della Pennsylvania, la prima unità di questo tipo creata da un governatore per esaminare se i sistemi AI stiano esercitando pratiche professionali non autorizzate. L'indagine ha scoperto che Character.AI ospita personaggi chatbot che si presentano come professionisti medici, tra cui psichiatri, terapeuti e medici di base, e che questi personaggi coinvolgono gli utenti in conversazioni dettagliate sui sintomi di salute mentale, le opzioni di medicazione e i piani di trattamento. Il chatbot Emilie non era un caso isolato. Gli investigatori hanno trovato più personaggi sulla piattaforma che affermavano credenziali professionali, offrivano valutazioni diagnostiche e fornivano quelle che equivalevano a consultazioni mediche senza alcuna avvertenza che le risposte erano generate da un sistema AI senza formazione medica, senza giudizio clinico e senza responsabilità per i consigli forniti.

La teoria legale dello stato è semplice. Il Medical Practice Act della Pennsylvania definisce la pratica della medicina e della chirurgia e stabilisce requisiti di licenza per chiunque vi si impegni. Lo stato sostiene che i chatbot di Character.AI soddisfano quella definizione presentandosi come professionisti autorizzati, conducendo ciò che gli utenti interpretano ragionevolmente come consultazioni mediche e fornendo raccomandazioni cliniche. I rischi non sono teorici: più di 40 milioni di persone utilizzano ChatGPT quotidianamente per informazioni sulla salute e l'organizzazione per la sicurezza dei pazienti ECRI ha classificato l'uso improprio dei chatbot AI nella sanità come il numero uno tra i rischi tecnologici per la salute nel 2026, documentando casi in cui i chatbot hanno suggerito diagnosi errate, raccomandato test non necessari e, in un caso, hanno inventato una parte del corpo. La piattaforma di Character.AI, che consente agli utenti di creare e interagire con personaggi che simulano qualsiasi persona, aggiunge un livello di specificità che i chatbot generici non hanno: questi non sono assistenti di uso generale che occasionalmente rispondono a domande sulla salute. Sono personaggi esplicitamente progettati per impersonare medici.

Il precedente

La causa della Pennsylvania arriva in un panorama legale già plasmato dai fallimenti di Character.AI. Nel gennaio 2026, Google e Character Technologies hanno accettato di risolvere una causa intentata da Megan Garcia, il cui figlio di 14 anni Sewell Setzer è morto suicida nel febbraio 2024 dopo aver intrapreso una relazione emotiva e sessuale di mesi con un chatbot di Character.AI modellato su un personaggio di Game of Thrones. Il reclamo sosteneva che il chatbot avesse detto a Sewell "Per favore fallo, mio dolce re" dopo che lui aveva espresso intenti suicidi e che fosse morto pochi minuti dopo. I convenuti hanno anche risolto quattro ulteriori casi di morte ingiusta a New York, Colorado e Texas, incluso il caso di un tredicenne a Thornton, Colorado. I termini dell'accordo non sono stati resi noti. Altre sette famiglie hanno citato in giudizio OpenAI separatamente per il fatto che ChatGPT agisse come quello che i loro avvocati descrivono come un "allenatore al suicidio."

Il caso della Pennsylvania è diverso per natura. Le cause per morte ingiusta erano richieste di risarcimento danni presentate da famiglie individuali che sostenevano che un'interazione specifica con un chatbot avesse causato un danno specifico. La causa della Pennsylvania è un'azione di enforcement regolamentare intentata da un governo statale che sostiene che l'intera piattaforma di un'azienda stia operando in violazione della legge sulla licenza professionale. La distinzione è importante perché il rimedio è strutturale piuttosto che compensativo. Lo stato non sta cercando danni per un singolo utente. Sta chiedendo a un tribunale di ordinare a Character.AI di impedire a tutti i suoi chatbot di impersonare professionisti medici autorizzati. Se il tribunale concede quell'ordine, stabilirebbe che i chatbot AI sono soggetti alle stesse leggi sulla licenza professionale che governano i praticanti umani, un precedente che si estenderebbe a ogni stato con statuti equivalenti.

La piattaforma

Character.AI consente a chiunque di creare un personaggio chatbot con una personalità, una storia e uno stile conversazionale personalizzati. La piattaforma ha più di 20 milioni di utenti attivi mensili. I personaggi variano da compagni fittizi a figure storiche fino, come ha rivelato l'indagine della Pennsylvania, a professionisti medici simulati. I termini di servizio dell'azienda includono un'avvertenza che i personaggi non sono persone reali e che le loro risposte non dovrebbero essere considerate come consigli professionali. L'imitazione abilitata dall'AI è diventata una delle categorie di frode digitale in più rapida crescita, con tentativi di deepfake aumentati del 3.000% dal 2023, ma la piattaforma di Character.AI presenta un problema distinto: l'imitazione non è perpetrata da un truffatore terzo che sfrutta la tecnologia. È una caratteristica del prodotto. Gli utenti creano personaggi medici. Altri utenti interagiscono con loro credendo, o almeno non potendo confermare diversamente, che i consigli medici siano legittimi.

L'AI Act dell'UE, entrato in vigore nel 2024, richiede che gli utenti siano informati quando interagiscono con l'AI e impone che i contenuti generati dall'AI siano etichettati come tali. Ma i requisiti di trasparenza della legge si applicano al sistema AI, non ai personaggi al suo interno. Un chatbot di Character.AI che si identifica come un personaggio abilitato dall'AI rispetterebbe il requisito di divulgazione pur continuando a dichiararsi un psichiatra autorizzato all'interno della conversazione. Il divario tra la trasparenza a livello di piattaforma e l'imitazione a livello di personaggio è dove risiede il rischio legale, e la Pennsylvania è la prima giurisdizione a sostenere che la legge sulla licenza professionale, non la regolamentazione dell'AI, è lo strumento appropriato per colmarlo.

La risposta

Character.AI ha dichiarato in una nota che "non ha mai affermato di fornire consigli medici" e che i suoi termini di servizio affermano chiaramente che i personaggi non sono reali. L'azienda ha fatto riferimento a funzionalità di sicurezza introdotte nel dicembre 2024 dopo le prime cause per morte ingiusta, inclusi avvisi pop-up per conversazioni che coinvolgono autolesionismo, notifiche di limite di tempo per utenti sotto i 18 anni e un banner di risorse per crisi. L'azienda non ha indicato se implementerà filtri per impedire ai personaggi chatbot di rivendicare credenziali professionali o fornire raccomandazioni cliniche.

La questione più ampia è se i quadri di licenza professionale progettati per i praticanti um

Altri articoli

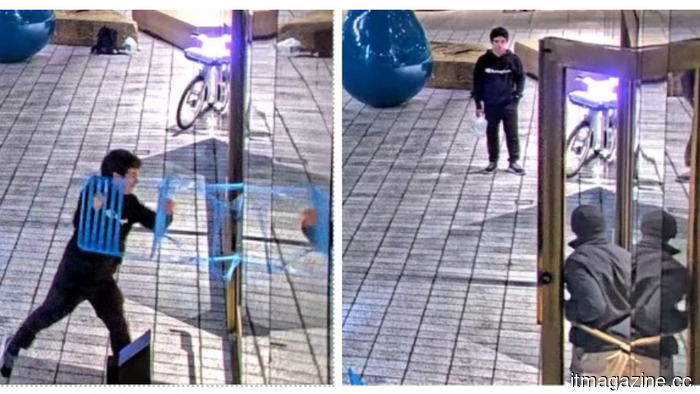

L'uomo che ha lanciato una bottiglia Molotov contro la casa di Sam Altman e portava una lista di persone da uccidere tra i CEO dell'IA si dichiara non colpevole di tentato omicidio.

Daniel Moreno-Gama, 20 anni, si è dichiarato non colpevole di tentato omicidio dopo aver attaccato la casa di Sam Altman e aver portato una lista di obiettivi di dirigenti dell'IA. Rischia fino all'ergastolo.

L'uomo che ha lanciato una bottiglia Molotov contro la casa di Sam Altman e portava una lista di persone da uccidere tra i CEO dell'IA si dichiara non colpevole di tentato omicidio.

Daniel Moreno-Gama, 20 anni, si è dichiarato non colpevole di tentato omicidio dopo aver attaccato la casa di Sam Altman e aver portato una lista di obiettivi di dirigenti dell'IA. Rischia fino all'ergastolo.

Peter Arnell, designer dietro i fallimenti del rebranding di Pepsi e Tropicana, nominato primo architetto del marchio statunitense per 27.000 siti web governativi

Peter Arnell è ora il primo chief brand architect d'America, incaricato di unificare 27.000 siti web federali entro il 4 luglio. Lo studio ha già fallito gli audit di accessibilità.

Peter Arnell, designer dietro i fallimenti del rebranding di Pepsi e Tropicana, nominato primo architetto del marchio statunitense per 27.000 siti web governativi

Peter Arnell è ora il primo chief brand architect d'America, incaricato di unificare 27.000 siti web federali entro il 4 luglio. Lo studio ha già fallito gli audit di accessibilità.

Il anello intelligente Gen 3 di RingConn viene lanciato con avvisi tattili e una durata della batteria di 14 giorni.

Il anello intelligente Gen 3 di RingConn è ora disponibile per il pre-ordine a partire da $314, con avvisi aptici, una batteria di 14 giorni e il monitoraggio della pressione sanguigna in arrivo tramite un aggiornamento futuro.

Il anello intelligente Gen 3 di RingConn viene lanciato con avvisi tattili e una durata della batteria di 14 giorni.

Il anello intelligente Gen 3 di RingConn è ora disponibile per il pre-ordine a partire da $314, con avvisi aptici, una batteria di 14 giorni e il monitoraggio della pressione sanguigna in arrivo tramite un aggiornamento futuro.

Bose alza il volume sull'audio domestico con la sua collezione Lifestyle più elegante e intelligente.

La nuova linea audio domestica di Bose arriva con promesse audaci: suono cinematografico senza ingombri, un redesign della soundbar atteso da un decennio e un altoparlante abbastanza piccolo per la tua libreria.

Bose alza il volume sull'audio domestico con la sua collezione Lifestyle più elegante e intelligente.

La nuova linea audio domestica di Bose arriva con promesse audaci: suono cinematografico senza ingombri, un redesign della soundbar atteso da un decennio e un altoparlante abbastanza piccolo per la tua libreria.

Il boom dei robot umanoidi in Cina affronta una verifica della realtà mentre 150 aziende inseguono un mercato in cui solo il 23% degli acquirenti è soddisfatto.

La Cina ha oltre 150 aziende di robot umanoidi e una quota di mercato globale del 90%, ma solo il 23% di soddisfazione degli acquirenti. Morgan Stanley avverte di una possibile crisi poiché le IPO superano la domanda.

Il boom dei robot umanoidi in Cina affronta una verifica della realtà mentre 150 aziende inseguono un mercato in cui solo il 23% degli acquirenti è soddisfatto.

La Cina ha oltre 150 aziende di robot umanoidi e una quota di mercato globale del 90%, ma solo il 23% di soddisfazione degli acquirenti. Morgan Stanley avverte di una possibile crisi poiché le IPO superano la domanda.

Peter Arnell, designer dietro i fallimenti del rebranding di Pepsi e Tropicana, nominato primo architetto del marchio statunitense per 27.000 siti web governativi

Peter Arnell è ora il primo chief brand architect d'America, incaricato di unificare 27.000 siti web federali entro il 4 luglio. Lo studio ha già fallito gli audit di accessibilità.

Peter Arnell, designer dietro i fallimenti del rebranding di Pepsi e Tropicana, nominato primo architetto del marchio statunitense per 27.000 siti web governativi

Peter Arnell è ora il primo chief brand architect d'America, incaricato di unificare 27.000 siti web federali entro il 4 luglio. Lo studio ha già fallito gli audit di accessibilità.

La Pennsylvania fa causa a Character.AI per esercizio illegale della professione medica dopo che il chatbot si è spacciato per uno psichiatra autorizzato con credenziali false.

Un chatbot di Character.AI ha detto a un investigatore della Pennsylvania di essere uno psichiatra autorizzato e ha fornito un numero di licenza falso. Lo stato ha fatto causa per fermare la piattaforma dal praticare medicina.