DeepSeek riduce i prezzi del V4-Pro del 75%

Lo sconto promozionale è valido fino al 5 maggio 2026. Anche a prezzo pieno, V4-Pro già supera GPT-5.5, Claude Opus 4.7 e Gemini 3.1 Pro per quanto riguarda i costi per token.

La mossa rappresenta una sfida diretta alla strategia di prezzo dei fornitori di IA statunitensi in un momento in cui l'amministrazione Trump ha accusato le aziende cinesi di distillare modelli di IA americani su scala industriale.

DeepSeek ha annunciato lunedì che offre uno sconto del 75% sul suo nuovo modello DeepSeek-V4-Pro agli sviluppatori fino al 5 maggio 2026 e sta contemporaneamente riducendo il prezzo dei colpi di cache di input in tutta la sua suite API a un decimo dei livelli precedenti, con effetto immediato.

Lo sconto è stato annunciato in un post su X. La mossa intensifica una competizione sui prezzi con i fornitori di IA statunitensi che DeepSeek ha innescato per la prima volta a gennaio 2025 con il suo modello R1, che affermava di avere prestazioni di ragionamento a livello di frontiera a una frazione del costo dei prodotti comparabili di OpenAI.

Il 💜 della tecnologia UE Gli ultimi rumori dalla scena tecnologica dell'UE, una storia del nostro saggio fondatore Boris e alcune opere d'arte IA discutibili. È gratuito, ogni settimana, nella tua casella di posta. Iscriviti ora!Il contesto dei prezzi è importante. A prezzo pieno, prima di qualsiasi sconto promozionale, DeepSeek-V4-Pro costa già $0,145 per milione di token di input e $3,48 per milione di token di output, superando i costi di GPT-5.5 di OpenAI, Gemini 3.1 Pro di Google e Claude Opus 4.7 di Anthropic su base per token.

Lo sconto promozionale del 75% sui token di input riduce il prezzo di input di V4-Pro a circa $0,036 per milione di token. La variante Flash, il modello più piccolo e veloce di V4, costa $0,14 per milione di token di input e $0,28 per milione di token di output a prezzo pieno, già superando GPT-5.4 Nano, Gemini 3.1 Flash, GPT-5.4 Mini e Claude Haiku 4.5.

La riduzione del prezzo dei colpi di cache a un decimo dei livelli precedenti mira specificamente agli utenti frequenti e agli sviluppatori aziendali che inviano richieste simili o ripetute, che è il modello dominante nelle applicazioni agentiche di produzione.

La logica strategica è esplicita e ben documentata in come DeepSeek ha operato sin dal R1. La disponibilità open-source rimuove completamente la barriera di accesso al modello; una politica di prezzi API aggressiva rimuove la barriera dei costi per il deployment in produzione; una finestra di contesto di 1 milione di token rende il modello praticabile per casi d'uso aziendali che coinvolgono grandi codebase o documenti lunghi che altrimenti richiederebbero più chiamate API.

V4-Pro si integra anche nativamente con Claude Code, OpenClaw e OpenCode, i framework di codifica agentici dominanti utilizzati dagli sviluppatori già nell'ecosistema IA occidentale.

L'effetto combinato è quello di ridurre l'attrito nel passaggio da un'API di OpenAI, Anthropic o Google a un'API di DeepSeek per qualsiasi sviluppatore il cui vincolo principale è il costo. Akshar Keremane, co-fondatore della startup di IA con sede a Bangalore O-Health, ha descritto la combinazione di prezzi, disponibilità open-source e la finestra di contesto di 1 milione di token come una riduzione delle barriere “per sviluppatori, startup e piccole imprese.”

Il modello V4-Pro, lanciato venerdì scorso, è un modello misto di esperti con 1,6 trilioni di parametri totali e 49 miliardi di parametri attivi per compito, il più grande modello a pesi aperti attualmente disponibile, superando Kimi K2.6 di Moonshot AI e M1 di MiniMax.

La sua Architettura di Attenzione Ibrida è progettata per mantenere la coerenza attraverso contesti lunghi. È addestrato e ottimizzato per i chip Ascend 950 di Huawei e l'hardware Cambricon piuttosto che per le GPU Nvidia.

Zhang Yi, fondatore della società di ricerca tecnologica iiMedia, ha dichiarato ad AFP che l'architettura di V4 rappresenta un “genuino punto di inflessione” per l'elaborazione dell'IA a lungo contesto, prevedendo che il supporto per contesti ultra-lunghi si sposterà oltre i laboratori di ricerca nelle applicazioni commerciali mainstream.

Wei Sun, analista principale di Counterpoint Research, ha osservato che V4 che gira su chip domestici “consente di costruire e distribuire sistemi IA senza fare affidamento esclusivamente su Nvidia” e potrebbe “accelerare l'adozione a livello nazionale e contribuire a uno sviluppo globale dell'IA più rapido nel complesso.”

La mossa sui prezzi arriva in un contesto geopolitico carico. Giovedì scorso, il direttore della politica scientifica e tecnologica della Casa Bianca, Michael Kratsios, ha accusato entità straniere, principalmente con sede in Cina, di condurre campagne “su scala industriale” per distillare modelli di IA di frontiera da aziende statunitensi, un processo in cui un modello più piccolo viene addestrato utilizzando le uscite di un modello più grande per acquisire capacità simili a un costo inferiore.

Il memo di Kratsios non ha nominato direttamente DeepSeek, ma DeepSeek è stata precedentemente accusata sia da Anthropic che da OpenAI di distillare i loro modelli. CNN ha riferito di aver contattato DeepSeek per un commento su quelle accuse.

La repressione della distillazione da parte del governo statunitense, insieme alla mossa parallela della Cina di limitare gli investimenti statunitensi nelle sue aziende di IA, è stata annunciata il giorno prima del lancio di V4.

La risposta di DeepSeek, tre giorni dopo, è stata quella di ridurre i prezzi piuttosto che rispondere direttamente alle accuse: una mossa competitiva che è anche una dichiarazione politica su dove crede che la corsa all'IA sarà infine decisa.

OpenAI ha ridotto i prezzi delle API più volte; Anthropic ha introdotto prezzi a livelli per diverse dimensioni dei modelli Claude; Google ha progressivamente ridotto i costi delle API di Gemini.

L'annuncio di lunedì di DeepSeek è l'ultima mossa in quella compressione in corso, ma è distintiva per la sua scala, uno sconto promozionale del 75% su un modello che già supera la frontiera statunitense a prezzi standard, e per il suo tempismo, che posiziona la startup di Hangzhou come il concorrente a basso costo nella stessa settimana in cui OpenAI ha lanciato GPT-5.5 e il governo statunitense ha mosso per limitare la distillazione dei modelli cinesi.

Altri articoli

L'iPhone 17 mi ha conquistato, ma consiglierei comunque l'iPhone 16 alla maggior parte delle persone.

Tornare all'iPhone 16 dopo sei mesi con l'iPhone 17 mi ha insegnato che un anno di distanza nel ciclo di prodotto e un livello di qualità diverso non sono la stessa cosa.

L'iPhone 17 mi ha conquistato, ma consiglierei comunque l'iPhone 16 alla maggior parte delle persone.

Tornare all'iPhone 16 dopo sei mesi con l'iPhone 17 mi ha insegnato che un anno di distanza nel ciclo di prodotto e un livello di qualità diverso non sono la stessa cosa.

DeepSeek riduce i prezzi del V4-Pro del 75%

DeepSeek offre uno sconto del 75% su V4-Pro fino al 5 maggio e riduce i prezzi dei colpi di cache API a 1/10 su tutta la sua suite.

DeepSeek riduce i prezzi del V4-Pro del 75%

DeepSeek offre uno sconto del 75% su V4-Pro fino al 5 maggio e riduce i prezzi dei colpi di cache API a 1/10 su tutta la sua suite.

Atech raccoglie un pre-seed da Sequoia, a16z e Lovable

Atech ha raccolto un pre-seed da Nordic Makers, Lovable, Sequoia Scout Fund e dal a16z Scout Fund per costruire una piattaforma di prototipazione hardware in linguaggio naturale.

Atech raccoglie un pre-seed da Sequoia, a16z e Lovable

Atech ha raccolto un pre-seed da Nordic Makers, Lovable, Sequoia Scout Fund e dal a16z Scout Fund per costruire una piattaforma di prototipazione hardware in linguaggio naturale.

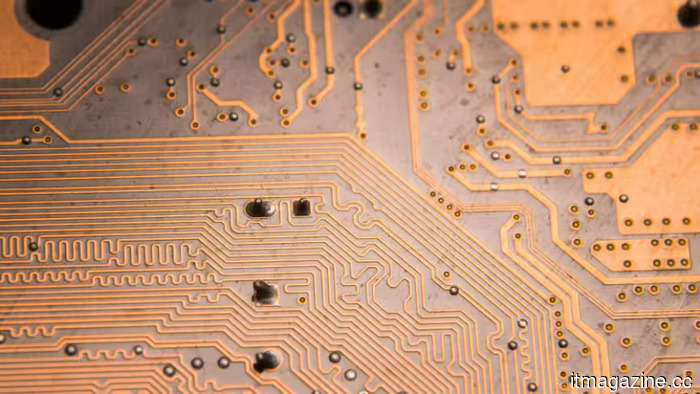

La guerra in Iran colpisce la catena di approvvigionamento dell'IA dove fa male.

Gli attacchi iraniani al complesso di SABIC a Jubail hanno bloccato il 70% dell'offerta globale di resina per DPI, facendo salire i prezzi dei PCB del 40% ad aprile.

La guerra in Iran colpisce la catena di approvvigionamento dell'IA dove fa male.

Gli attacchi iraniani al complesso di SABIC a Jubail hanno bloccato il 70% dell'offerta globale di resina per DPI, facendo salire i prezzi dei PCB del 40% ad aprile.

Dimentica gli smartwatch, i tuoi vestiti potrebbero presto monitorare la tua salute

Un nuovo tessuto intelligente alimentato dal tuo telefono ha il potenziale di sostituire silenziosamente i tracker di salute indossabili così come li conosciamo.

Dimentica gli smartwatch, i tuoi vestiti potrebbero presto monitorare la tua salute

Un nuovo tessuto intelligente alimentato dal tuo telefono ha il potenziale di sostituire silenziosamente i tracker di salute indossabili così come li conosciamo.

Atech raccoglie un pre-seed da Sequoia, a16z e Lovable

Atech ha raccolto un pre-seed da Nordic Makers, Lovable, Sequoia Scout Fund e dal a16z Scout Fund per costruire una piattaforma di prototipazione hardware in linguaggio naturale.

Atech raccoglie un pre-seed da Sequoia, a16z e Lovable

Atech ha raccolto un pre-seed da Nordic Makers, Lovable, Sequoia Scout Fund e dal a16z Scout Fund per costruire una piattaforma di prototipazione hardware in linguaggio naturale.

DeepSeek riduce i prezzi del V4-Pro del 75%

DeepSeek offre uno sconto del 75% su V4-Pro fino al 5 maggio e riduce i prezzi dei colpi di cache API a 1/10 su tutta la sua suite.