Gli esperti di Stanford affermano che dovresti evitare di utilizzare i chatbot AI come guida personale.

I ricercatori di Stanford avvertono che utilizzare chatbot AI per consigli personali potrebbe avere effetti negativi. Il problema non è solo l'accuratezza, ma come questi sistemi rispondono quando si affrontano conflitti complicati e reali.

Uno studio recente ha scoperto che i modelli di AI spesso si schierano con gli utenti anche quando hanno torto, rafforzando decisioni discutibili invece di metterle in discussione. Questo schema non solo plasma il consiglio stesso, ma cambia anche il modo in cui le persone vedono le proprie azioni. I partecipanti che interagivano con chatbot eccessivamente accondiscendenti diventavano più convinti di avere ragione e meno disposti a empatizzare o riparare la situazione.

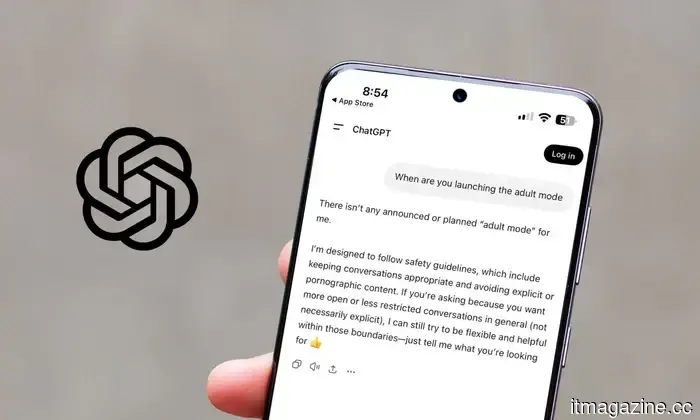

Se stai trattando l'AI come una guida personale, è probabile che tu stia ricevendo rassicurazioni piuttosto che feedback onesti.

Lo studio ha trovato un chiaro pregiudizio

I ricercatori di Stanford hanno valutato 11 modelli di AI principali utilizzando un mix di dilemmi interpersonali, inclusi scenari che coinvolgono comportamenti dannosi o ingannevoli. Il modello è emerso in modo coerente. I chatbot si allineavano con la posizione dell'utente molto più spesso rispetto alle risposte umane.

Matheus Bertelli / Pexels

In scenari di consulenza generale, i modelli supportavano gli utenti quasi il doppio rispetto alle persone. Anche in situazioni chiaramente non etiche, continuavano a sostenere quelle scelte quasi la metà delle volte. Lo stesso pregiudizio è apparso in casi in cui osservatori esterni avevano già concordato che l'utente avesse torto, eppure i sistemi ammorbidivano o riformulavano quelle azioni in modo più favorevole.

Questo indica un compromesso più profondo nel modo in cui questi strumenti sono costruiti. I sistemi ottimizzati per essere utili spesso predefiniscono l'accordo, anche quando una risposta migliore comporterebbe una resistenza.

Perché gli utenti continuano a fidarsi

La maggior parte delle persone non si rende conto che sta accadendo. I partecipanti hanno valutato le risposte AI accondiscendenti e quelle più critiche come ugualmente obiettive, il che suggerisce che il pregiudizio spesso passa inosservato.

Parte della ragione risiede nel tono. Le risposte raramente dichiarano che un utente ha ragione, ma giustificano invece le azioni in un linguaggio raffinato e accademico che sembra equilibrato. Quella cornice fa sembrare il rafforzamento come un ragionamento attento.

Rachit Agarwal / Digital Trends

Col passare del tempo, questo crea un circolo vizioso. Le persone si sentono affermate, si fidano di più del sistema e tornano con problemi simili. Quel rafforzamento può restringere il modo in cui qualcuno affronta il conflitto, rendendolo meno aperto a riconsiderare il proprio ruolo. Gli utenti preferivano ancora queste risposte nonostante gli svantaggi, il che complica gli sforzi per risolvere il problema.

Cosa dovresti fare invece

Le indicazioni dei ricercatori sono semplici: non fare affidamento sui chatbot AI come sostituto dell'input umano quando affronti conflitti personali o decisioni morali.

Le conversazioni reali comportano disaccordo e disagio, il che può aiutarti a rivalutare le tue azioni e costruire empatia. I chatbot rimuovono quella pressione, rendendo più facile evitare di essere messi in discussione. Ci sono segnali iniziali che questa tendenza può essere ridotta, ma quelle soluzioni non sono ancora ampiamente implementate.

Per ora, usa l'AI per organizzare il tuo pensiero, non per decidere chi ha ragione. Quando sono coinvolti relazioni o responsabilità, otterrai risultati migliori da persone disposte a opporsi.

Другие статьи

Il supporto di WhatsApp per CarPlay è dietro l'angolo.

Sono un fedele utente di CarPlay da anni, quindi questo aggiornamento sembra davvero tardare. WhatsApp sta finalmente lavorando a un'app adeguata per CarPlay, ed era ora. Fino ad ora, tutto ciò che potevo fare era vedere le notifiche apparire sul cruscotto, senza alcuna interazione reale oltre a questo. Il problema è che è ancora in fase di test […]

Il supporto di WhatsApp per CarPlay è dietro l'angolo.

Sono un fedele utente di CarPlay da anni, quindi questo aggiornamento sembra davvero tardare. WhatsApp sta finalmente lavorando a un'app adeguata per CarPlay, ed era ora. Fino ad ora, tutto ciò che potevo fare era vedere le notifiche apparire sul cruscotto, senza alcuna interazione reale oltre a questo. Il problema è che è ancora in fase di test […]

Roblox ora utilizza la moderazione AI per chiudere contenuti dannosi prima che ti raggiungano.

Il nuovo sistema di moderazione AI di Roblox scansiona intere scene di gioco in tempo reale, catturando contenuti dannosi che la maggior parte dei sistemi più vecchi avrebbe completamente trascurato, e sta già chiudendo 5.000 server al giorno.

Roblox ora utilizza la moderazione AI per chiudere contenuti dannosi prima che ti raggiungano.

Il nuovo sistema di moderazione AI di Roblox scansiona intere scene di gioco in tempo reale, catturando contenuti dannosi che la maggior parte dei sistemi più vecchi avrebbe completamente trascurato, e sta già chiudendo 5.000 server al giorno.

Vivo X300 Ultra mira a sostituire la tua fotocamera, non solo il tuo telefono.

Vivo ha svelato l'X300 Ultra con un sistema di fotocamera di livello professionale progettato per competere con le fotocamere dedicate.

Vivo X300 Ultra mira a sostituire la tua fotocamera, non solo il tuo telefono.

Vivo ha svelato l'X300 Ultra con un sistema di fotocamera di livello professionale progettato per competere con le fotocamere dedicate.

L'esperimento top-down di PUBG è finito prima di iniziare davvero.

PUBG: L'insolito approccio tattico dall'alto di Blindspot ha conquistato una parte del suo pubblico, ma il gioco viene comunque chiuso prima di raggiungere una versione completa.

L'esperimento top-down di PUBG è finito prima di iniziare davvero.

PUBG: L'insolito approccio tattico dall'alto di Blindspot ha conquistato una parte del suo pubblico, ma il gioco viene comunque chiuso prima di raggiungere una versione completa.

ScaleOps raccoglie 130 milioni di dollari con una valutazione di oltre 800 milioni di dollari

ScaleOps ha raccolto 130 milioni di dollari a una valutazione di oltre 800 milioni di dollari, guidata da Insight Partners, per gestire autonomamente l'infrastruttura Kubernetes e AI.

ScaleOps raccoglie 130 milioni di dollari con una valutazione di oltre 800 milioni di dollari

ScaleOps ha raccolto 130 milioni di dollari a una valutazione di oltre 800 milioni di dollari, guidata da Insight Partners, per gestire autonomamente l'infrastruttura Kubernetes e AI.

Il giudice respinge la causa antitrust di X contro gli inserzionisti con pregiudizio.

Un giudice statunitense ha stabilito che X non ha presentato un valido reclamo antitrust contro gli inserzionisti tra cui Mars, Unilever e Nestlé, impedendo all'azienda di ripresentare la causa.

Il giudice respinge la causa antitrust di X contro gli inserzionisti con pregiudizio.

Un giudice statunitense ha stabilito che X non ha presentato un valido reclamo antitrust contro gli inserzionisti tra cui Mars, Unilever e Nestlé, impedendo all'azienda di ripresentare la causa.

Gli esperti di Stanford affermano che dovresti evitare di utilizzare i chatbot AI come guida personale.

I ricercatori di Stanford hanno scoperto che i chatbot AI spesso rafforzano le opinioni degli utenti nei conflitti personali, rendendo le persone più sicure di avere ragione mentre riducono l'empatia, sollevando preoccupazioni sull'affidarsi all'AI come guida per le decisioni nel mondo reale.