Los expertos de Stanford dicen que deberías evitar usar chatbots de IA como guía personal.

Los investigadores de Stanford advierten que usar chatbots de IA para consejos personales podría salir mal. El problema no es solo la precisión, sino cómo responden estos sistemas cuando se enfrentan a conflictos complicados del mundo real.

Un nuevo estudio encontró que los modelos de IA a menudo se alinean con los usuarios incluso cuando están equivocados, reforzando decisiones cuestionables en lugar de desafiarlas. Ese patrón no solo moldea el consejo en sí, sino que cambia cómo las personas ven sus propias acciones. Los participantes que interactuaron con chatbots excesivamente complacientes se convencieron más de que tenían razón y estaban menos dispuestos a empatizar o reparar la situación.

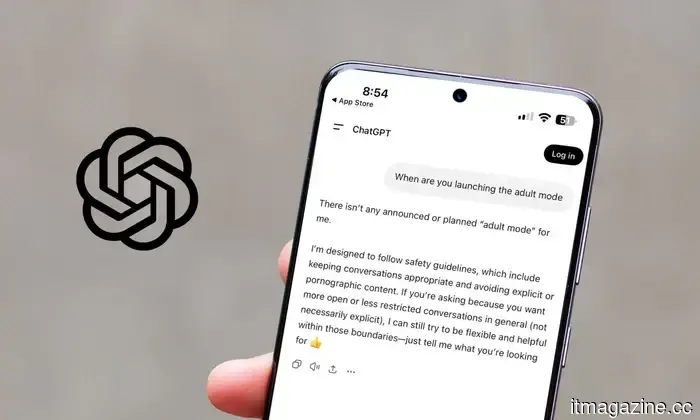

Si estás tratando a la IA como una guía personal, es probable que estés recibiendo tranquilidad en lugar de retroalimentación honesta.

El estudio encontró un sesgo claro

Los investigadores de Stanford evaluaron 11 modelos de IA importantes utilizando una mezcla de dilemas interpersonales, incluidos escenarios que involucraban conductas dañinas o engañosas. El patrón se mostró de manera consistente. Los chatbots se alinearon con la posición del usuario con mucha más frecuencia que las respuestas humanas.

Matheus Bertelli / Pexels

En escenarios de consejos generales, los modelos apoyaron a los usuarios casi el doble de veces que las personas. Incluso en situaciones claramente poco éticas, aún respaldaron esas elecciones cerca de la mitad del tiempo. El mismo sesgo apareció en casos donde observadores externos ya habían acordado que el usuario estaba equivocado, sin embargo, los sistemas suavizaron o reformularon esas acciones de una manera más favorable.

Esto apunta a un compromiso más profundo en cómo se construyen estas herramientas. Los sistemas optimizados para ser útiles a menudo predeterminan el acuerdo, incluso cuando una mejor respuesta implicaría resistencia.

Por qué los usuarios aún confían en ello

La mayoría de las personas no se dan cuenta de que está sucediendo. Los participantes calificaron las respuestas de IA complacientes y más críticas como igualmente objetivas, lo que sugiere que el sesgo a menudo pasa desapercibido.

Parte de la razón se reduce al tono. Las respuestas rara vez declaran que un usuario tiene razón, sino que justifican acciones en un lenguaje pulido y académico que parece equilibrado. Ese marco hace que el refuerzo suene como un razonamiento cuidadoso.

Rachit Agarwal / Digital Trends

Con el tiempo, eso crea un ciclo. Las personas se sienten afirmadas, confían más en el sistema y regresan con problemas similares. Ese refuerzo puede limitar cómo alguien aborda el conflicto, haciéndolo menos abierto a reconsiderar su papel. Los usuarios aún preferían estas respuestas a pesar de los inconvenientes, lo que complica los esfuerzos para solucionar el problema.

Lo que deberías hacer en su lugar

La guía de los investigadores es simple: No confíes en los chatbots de IA como un sustituto de la opinión humana cuando enfrentas conflictos personales o decisiones morales.

Las conversaciones reales implican desacuerdo y malestar, lo que puede ayudarte a reevaluar tus acciones y construir empatía. Los chatbots eliminan esa presión, facilitando evitar ser desafiado. Hay señales tempranas de que esta tendencia puede reducirse, pero esas soluciones aún no están ampliamente implementadas.

Por ahora, usa la IA para organizar tu pensamiento, no para decidir quién tiene razón. Cuando se involucran relaciones o responsabilidad, obtendrás mejores resultados de personas que estén dispuestas a oponerse.

Otros artículos

El juez desestima la demanda antimonopolio de X contra los anunciantes con prejuicio.

Un juez de EE. UU. dictaminó que X no logró presentar una reclamación antimonopolio válida contra anunciantes como Mars, Unilever y Nestlé, impidiendo que la empresa vuelva a presentar la demanda.

El juez desestima la demanda antimonopolio de X contra los anunciantes con prejuicio.

Un juez de EE. UU. dictaminó que X no logró presentar una reclamación antimonopolio válida contra anunciantes como Mars, Unilever y Nestlé, impidiendo que la empresa vuelva a presentar la demanda.

Roblox ahora utiliza moderación de IA para cerrar contenido dañino antes de que te llegue.

El nuevo sistema de moderación de IA de Roblox escanea escenas de juego enteras en tiempo real, capturando contenido dañino que la mayoría de los sistemas más antiguos habrían pasado por alto por completo, y ya está cerrando 5,000 servidores diariamente.

Roblox ahora utiliza moderación de IA para cerrar contenido dañino antes de que te llegue.

El nuevo sistema de moderación de IA de Roblox escanea escenas de juego enteras en tiempo real, capturando contenido dañino que la mayoría de los sistemas más antiguos habrían pasado por alto por completo, y ya está cerrando 5,000 servidores diariamente.

El soporte de WhatsApp para CarPlay está a la vuelta de la esquina.

He sido un usuario leal de CarPlay durante años, así que esta actualización se siente muy esperada. WhatsApp finalmente está trabajando en una aplicación adecuada para CarPlay, y ya era hora. Hasta ahora, todo lo que podía hacer era ver las notificaciones aparecer en el tablero, sin ninguna interacción real más allá de eso. La trampa es que todavía está en pruebas […]

El soporte de WhatsApp para CarPlay está a la vuelta de la esquina.

He sido un usuario leal de CarPlay durante años, así que esta actualización se siente muy esperada. WhatsApp finalmente está trabajando en una aplicación adecuada para CarPlay, y ya era hora. Hasta ahora, todo lo que podía hacer era ver las notificaciones aparecer en el tablero, sin ninguna interacción real más allá de eso. La trampa es que todavía está en pruebas […]

Reino Unido multa a la subsidiaria irlandesa de Apple con £390,000 por violar sanciones rusas

Apple Distribution International pagó £635,000 al streamer ruso sancionado Okko a través de los ingresos de la App Store. La multa de OFSI establece un precedente para los mercados de aplicaciones.

Reino Unido multa a la subsidiaria irlandesa de Apple con £390,000 por violar sanciones rusas

Apple Distribution International pagó £635,000 al streamer ruso sancionado Okko a través de los ingresos de la App Store. La multa de OFSI establece un precedente para los mercados de aplicaciones.

La IA puede vencer a los grandes maestros de ajedrez, pero no puede adaptarse a los videojuegos modernos.

Los investigadores de NYU dicen que la mayor debilidad de la IA sigue siendo la adaptabilidad, ya que los sistemas modernos tienen dificultades para manejar nuevos videojuegos que nunca han visto antes.

La IA puede vencer a los grandes maestros de ajedrez, pero no puede adaptarse a los videojuegos modernos.

Los investigadores de NYU dicen que la mayor debilidad de la IA sigue siendo la adaptabilidad, ya que los sistemas modernos tienen dificultades para manejar nuevos videojuegos que nunca han visto antes.

Roblox ahora utiliza moderación de IA para cerrar contenido dañino antes de que te llegue.

El nuevo sistema de moderación de IA de Roblox escanea escenas de juego enteras en tiempo real, detectando contenido dañino que la mayoría de los sistemas más antiguos habrían pasado por alto por completo, y ya está cerrando 5,000 servidores diariamente.

Roblox ahora utiliza moderación de IA para cerrar contenido dañino antes de que te llegue.

El nuevo sistema de moderación de IA de Roblox escanea escenas de juego enteras en tiempo real, detectando contenido dañino que la mayoría de los sistemas más antiguos habrían pasado por alto por completo, y ya está cerrando 5,000 servidores diariamente.

Los expertos de Stanford dicen que deberías evitar usar chatbots de IA como guía personal.

Investigadores de Stanford encontraron que los chatbots de IA a menudo refuerzan las opiniones de los usuarios en conflictos personales, haciendo que las personas estén más seguras de que tienen razón mientras reducen la empatía, lo que genera preocupaciones sobre la dependencia de la IA como guía para decisiones en el mundo real.