Esta nueva actualización de voz de OpenAI hace que Siri y Alexa parezcan necesitar volver a la escuela.

El traductor universal acaba de salir de la ciencia ficción y ha aterrizado en tu tienda de aplicaciones.

OpenAI ha lanzado tres nuevos modelos de audio en su API en tiempo real, y son un gran avance para cualquiera que esté construyendo aplicaciones impulsadas por voz. Los tres modelos son GPT-Realtime-2, GPT-Realtime-Translate y GPT-Realtime-Whisper.

Juntos, llevan la IA de voz más allá de simples respuestas de ida y vuelta hacia algo que puede entenderte, tomar acción y mantener una conversación real.

Si su demostración es algo a tener en cuenta, acabamos de ver la próxima evolución en cómo funcionan los modelos de IA de voz.

Entonces, ¿qué pueden hacer realmente estos modelos?

GPT-Realtime-2 es el acto principal. Trae razonamiento de clase GPT-5 a las interacciones de voz en vivo, lo que significa que puede manejar solicitudes más difíciles sin perder el hilo de la conversación.

Puede llamar a múltiples herramientas simultáneamente e incluso narrar lo que está haciendo con frases como "revisando tu calendario" o "déjame investigar eso". También tiene una ventana de contexto más grande de 128K tokens, lo que significa sesiones más largas y coherentes. Los desarrolladores incluso pueden ajustar el esfuerzo de razonamiento según la complejidad de la solicitud.

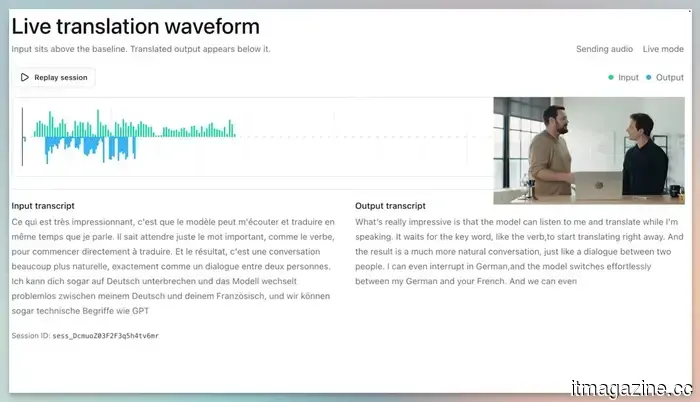

GPT-Realtime-Translate es probablemente mi favorito. Es lo más cercano que hemos estado de tener el Traductor Universal de Star Trek en la vida real. Soporta traducción de voz en vivo en más de 70 idiomas de entrada y 13 idiomas de salida.

La mejor parte de la demostración fue que incluso cuando una nueva persona se unió y habló un idioma diferente, GPT-Realtime-Translate no tuvo problemas para traducir a ambos hablantes al inglés en tiempo real.

OpenAI

Finalmente, está el GPT-Realtime-Whisper. La mayoría de los modelos de conversión de voz a texto esperan a que el hablante termine antes de proporcionar la traducción completa. Este es un modelo de transcripción en streaming que convierte el habla en texto mientras el hablante habla. Es útil para subtítulos en vivo, notas de reuniones y cualquier flujo de trabajo impulsado por voz donde esperar una transcripción no es una opción.

¿Puede cualquiera usar estos nuevos modelos de IA de voz?

Actualmente, OpenAI ha lanzado estos modelos para desarrolladores. Pero las aplicaciones que construyan afectarán a todos. Por ejemplo, un desarrollador puede crear una aplicación de traductor en tiempo real, permitiendo a los usuarios conversar con personas en diferentes idiomas.

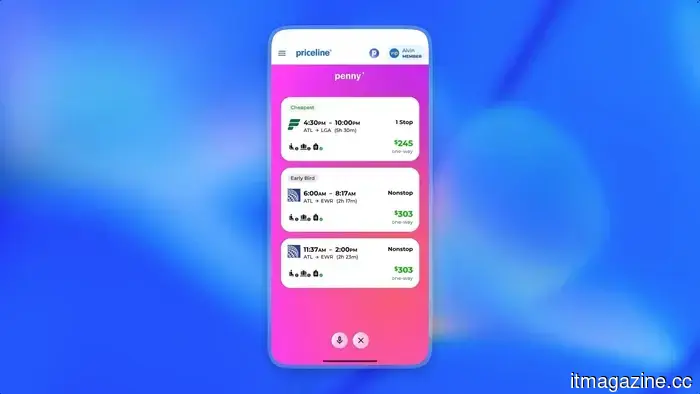

Muchas empresas ya están probando estos nuevos modelos. Zillow está construyendo un asistente de voz que puede buscar casas y programar visitas a partir de una sola solicitud hablada. Priceline puede verificar tus vuelos y hoteles, cancelarlos y reservar nuevos. Vimeo lo está utilizando para transcripción en tiempo real, y así sucesivamente.

OpenAI

Los precios comienzan en $0.017 por minuto para Whisper, $0.034 por minuto para Translate, y $32 por 1M de tokens de entrada de audio para GPT-Realtime-2.

Rachit es un periodista tecnológico experimentado con más de siete años de experiencia cubriendo el panorama de la tecnología de consumo.

Corea da la bienvenida a un monje budista robótico en un monasterio real. Es un signo de lo que está por venir.

El budismo ha entrado en la era robótica con un monje llamado Gabi.

Un robot humanoide se unió a una ceremonia budista en Seúl, y fue un espectáculo digno de ver. El robot, llamado Gabi, fue presentado en el Templo Jogyesa en el centro de Seúl durante una ceremonia celebrada antes de las celebraciones del Cumpleaños de Buda. El robot de 1.3 metros de altura recibió el nombre Dharma "Gabi" durante una ceremonia de refugio especial realizada por la Orden Jogye del budismo coreano, la mayor orden budista de Corea del Sur.

Por qué un robot se convirtió en un verdadero monje en un templo real

Leer más

ChatGPT ahora te permite nombrar a alguien para que verifique si las cosas se ponen oscuras.

OpenAI está construyendo una red de seguridad humana en ChatGPT para momentos de crisis.

Los chatbots de IA han hecho sorprendentemente fácil hablar sobre cualquier cosa, y eso incluye algunos de los temas más pesados imaginables. Esa apertura siempre ha sido una espada de doble filo. OpenAI ahora está dando un paso para abordar eso, con una nueva función que trae a una persona de confianza a la imagen cuando las cosas se ponen serias.

La compañía está implementando una nueva función llamada Contacto de Confianza, y está comenzando a aparecer en la configuración de ChatGPT para usuarios adultos. Permite a los usuarios nombrar a una persona que puede ser alertada si ChatGPT detecta una preocupación seria de autolesión.

Leer más

El motor de respuesta de IA de Perplexity no llegará a Snapchat, después de todo.

Perplexity ya no se está deslizando en los chats de Snapchat.

La integración planificada de Perplexity en Snapchat ya no se llevará a cabo. Snap reveló en su carta a los inversores del Q1 2026 que ambas compañías "terminaron amistosamente la relación en el Q1", poniendo fin a un acuerdo de efectivo y acciones de $400 millones anunciado el noviembre pasado.

El acuerdo habría traído el motor de respuesta de IA de Perplexity directamente a la interfaz de chat de Snapchat. Los usuarios habrían podido hacer preguntas y obtener respuestas conversacionales respaldadas por fuentes sin salir de la aplicación. Snap había dicho anteriormente que la asociación comenzaría a contribuir a los ingresos en 2026, pero su última guía de ventas ahora asume ninguna contribución de Perplexity.

Leer más

Otros artículos

SoftBank reduce su objetivo de préstamo con margen respaldado por OpenAI en un 40% a $6 mil millones

SoftBank ha reducido su objetivo de préstamo con margen respaldado por OpenAI de $10 mil millones a tan solo $6 mil millones debido a las preocupaciones de los prestamistas sobre la valoración de las acciones de OpenAI como garantía.

SoftBank reduce su objetivo de préstamo con margen respaldado por OpenAI en un 40% a $6 mil millones

SoftBank ha reducido su objetivo de préstamo con margen respaldado por OpenAI de $10 mil millones a tan solo $6 mil millones debido a las preocupaciones de los prestamistas sobre la valoración de las acciones de OpenAI como garantía.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

Esta nueva actualización de voz de OpenAI hace que Siri y Alexa parezcan necesitar volver a la escuela.

OpenAI lanzó tres nuevos modelos de audio que pueden razonar, traducir en más de 70 idiomas y transcribir el habla en tiempo real, convirtiendo la voz en una interfaz realmente útil para los desarrolladores.

Esta nueva actualización de voz de OpenAI hace que Siri y Alexa parezcan necesitar volver a la escuela.

OpenAI lanzó tres nuevos modelos de audio que pueden razonar, traducir en más de 70 idiomas y transcribir el habla en tiempo real, convirtiendo la voz en una interfaz realmente útil para los desarrolladores.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

NVIDIA toma un warrant de $2.1 mil millones en IREN como parte de un acuerdo de centro de datos de IA de 5GW

NVIDIA invertirá hasta $2.1 mil millones en el operador de centros de datos IREN a través de una opción de cinco años sobre 30 millones de acciones.

NVIDIA toma un warrant de $2.1 mil millones en IREN como parte de un acuerdo de centro de datos de IA de 5GW

NVIDIA invertirá hasta $2.1 mil millones en el operador de centros de datos IREN a través de una opción de cinco años sobre 30 millones de acciones.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

Mejor Software de Recursos Humanos Global para Empresas Internacionales en 2026

Comparamos las mejores plataformas de software de recursos humanos globales para empresas internacionales en 2026, incluyendo HiBob, Rippling, BambooHR, Personio, UKG, Sage HR y ADP.

Esta nueva actualización de voz de OpenAI hace que Siri y Alexa parezcan necesitar volver a la escuela.

OpenAI lanzó tres nuevos modelos de audio que pueden razonar, traducir en más de 70 idiomas y transcribir el habla en tiempo real, convirtiendo la voz en una interfaz realmente útil para los desarrolladores.