Este nuevo ataque de IA roba modelos sin tocar el sistema.

Un ataque de canal lateral puede reconstruir modelos de IA desde la distancia utilizando señales filtradas.

Los sistemas de IA han sido tratados durante mucho tiempo como cajas negras selladas, especialmente en áreas como el reconocimiento facial y la conducción autónoma. Nuevas investigaciones sugieren que la protección no es tan sólida como se asumía.

Un equipo liderado por KAIST muestra que los sistemas de IA pueden ser ingeniería inversa de forma remota utilizando emisiones que se filtran durante el funcionamiento normal, sin intrusión directa. En su lugar, el enfoque escucha.

Utilizando una pequeña antena, los investigadores capturaron débiles trazas electromagnéticas de las GPU y reconstruyeron cómo se diseñó el sistema. Suena como un truco de robo, pero los resultados son sólidos, y las implicaciones de seguridad son inmediatas.

Cómo funciona el canal lateral

El sistema, llamado ModelSpy, recoge la salida electromagnética producida mientras las GPU manejan cargas de trabajo de IA. Estas trazas son sutiles, pero siguen patrones relacionados con cómo está dispuesta la arquitectura.

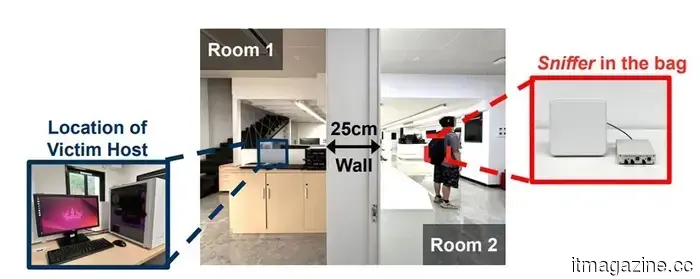

Las estructuras de modelos de IA pueden ser robadas a través de paredes utilizando una antena oculta en una bolsa, según un artículo del Simposio NDSS 2026 de Jun Han et al.

Al analizar esos patrones, el equipo inferió detalles clave, incluidos los arreglos de capas y las elecciones de parámetros. Las pruebas mostraron que las estructuras centrales podían identificarse con hasta un 97.6 por ciento de precisión.

La configuración es lo que hace que esto sea inquietante. La antena cabe dentro de una bolsa y no necesita acceso físico. Funcionó desde hasta seis metros de distancia, incluso a través de paredes, en múltiples tipos de GPU. La computación en sí misma se convierte en un canal lateral, exponiendo el diseño del sistema sin una violación tradicional.

Por qué esto cambia la seguridad de la IA

Esto empuja la seguridad de la IA a un territorio menos familiar. La mayoría de las defensas se centran en exploits de software o acceso a redes. ModelSpy apunta a los subproductos físicos de la computación en su lugar.

Incluso los sistemas aislados podrían filtrar información sensible si las emisiones de hardware no se controlan. Para las empresas, esa arquitectura es a menudo propiedad intelectual central, lo que convierte esto en un riesgo comercial directo.

El trabajo enmarca esto como un desafío ciberfísico, donde defender la IA ahora implica tanto salvaguardias digitales como el entorno circundante, lo que eleva el estándar de lo que realmente significa protección.

Cómo se ven ahora las defensas

El equipo también esbozó formas de reducir el riesgo, incluyendo la adición de ruido electromagnético y ajustando cómo se ejecutan los cálculos para que los patrones sean más difíciles de interpretar.

Esas soluciones sugieren un cambio más amplio. Asegurar la IA puede requerir ajustes a nivel de hardware, no solo actualizaciones de software, lo que complica la implementación para industrias que ya están atrapadas en sistemas existentes.

La investigación recibió reconocimiento en una importante conferencia de seguridad, señalando cuán en serio se está tomando esta amenaza. La próxima exposición puede no implicar entrar en absoluto, sino simplemente observar lo que los sistemas revelan involuntariamente.

Otros artículos

Samsung está trayendo el soporte de Google Cast tan esperado a sus televisores más antiguos.

Samsung finalmente está respondiendo a una solicitud de larga data de sus usuarios: el soporte para Google Cast llegará no solo a sus nuevos televisores, sino también a algunos modelos más antiguos. Esta función tan solicitada se extenderá a modelos seleccionados de 2023 y 2024. Incluso podría llegar a los Monitores Inteligentes y otros dispositivos con Tizen OS lanzados recientemente. El despliegue comenzó […]

Samsung está trayendo el soporte de Google Cast tan esperado a sus televisores más antiguos.

Samsung finalmente está respondiendo a una solicitud de larga data de sus usuarios: el soporte para Google Cast llegará no solo a sus nuevos televisores, sino también a algunos modelos más antiguos. Esta función tan solicitada se extenderá a modelos seleccionados de 2023 y 2024. Incluso podría llegar a los Monitores Inteligentes y otros dispositivos con Tizen OS lanzados recientemente. El despliegue comenzó […]

La encuesta de Steam muestra que Linux alcanza un récord histórico entre los jugadores.

Linux ha alcanzado un máximo histórico del 5.33% en la última encuesta de Steam de Valve, un hito que subraya lo lejos que ha llegado el juego en PC en Linux.

La encuesta de Steam muestra que Linux alcanza un récord histórico entre los jugadores.

Linux ha alcanzado un máximo histórico del 5.33% en la última encuesta de Steam de Valve, un hito que subraya lo lejos que ha llegado el juego en PC en Linux.

Google Vids recibe un gran impulso de IA para facilitar la generación de videos con algunos trucos nuevos y geniales.

IA en abundancia, pero está haciendo las cosas correctas.

Google Vids recibe un gran impulso de IA para facilitar la generación de videos con algunos trucos nuevos y geniales.

IA en abundancia, pero está haciendo las cosas correctas.

La encuesta de Steam muestra que Linux alcanza un récord histórico entre los jugadores.

Linux ha alcanzado un máximo histórico del 5.33% en la última encuesta de Steam de Valve, un hito que subraya lo lejos que ha llegado el juego en PC en Linux.

La encuesta de Steam muestra que Linux alcanza un récord histórico entre los jugadores.

Linux ha alcanzado un máximo histórico del 5.33% en la última encuesta de Steam de Valve, un hito que subraya lo lejos que ha llegado el juego en PC en Linux.

Los videos de la tripulación de Artemis II muestran a los astronautas bromeando con un iPhone en el espacio.

Nuevos clips de Artemis II muestran a los astronautas jugando casualmente con un iPhone en el espacio, haciendo que la primera misión lunar tripulada de NASA en más de 50 años se sienta extrañamente relatable.

Los videos de la tripulación de Artemis II muestran a los astronautas bromeando con un iPhone en el espacio.

Nuevos clips de Artemis II muestran a los astronautas jugando casualmente con un iPhone en el espacio, haciendo que la primera misión lunar tripulada de NASA en más de 50 años se sienta extrañamente relatable.

Este nuevo ataque de IA roba modelos sin tocar el sistema.

Los modelos de IA pueden no ser seguros detrás de muros, ya que los investigadores muestran que las señales de las GPU pueden revelar su diseño interno sin necesidad de hackeo, utilizando una pequeña antena y análisis de canal lateral desde varios metros de distancia.

Este nuevo ataque de IA roba modelos sin tocar el sistema.

Los modelos de IA pueden no ser seguros detrás de muros, ya que los investigadores muestran que las señales de las GPU pueden revelar su diseño interno sin necesidad de hackeo, utilizando una pequeña antena y análisis de canal lateral desde varios metros de distancia.

Este nuevo ataque de IA roba modelos sin tocar el sistema.

Los modelos de IA pueden ya no ser seguros detrás de muros, ya que los investigadores muestran que las señales de las GPU pueden revelar su diseño interno sin necesidad de hackear, utilizando una pequeña antena y análisis de canal lateral desde varios metros de distancia.