Nvidia выпускает Nemotron 3 Nano Omni: открытая мультимодальная модель с 30B параметрами, 3B активными, для агентов на краевых AI.

TL;DRNvidia выпустила Nemotron 3 Nano Omni, модель с открытыми весами и мультимодальной архитектурой, которая объединяет зрение, аудио и язык в одной структуре с 30 миллиардами параметров, но активирует только 3 миллиарда на одно выведение. Она заявляет о 9-кратной производительности по сравнению с сопоставимыми открытыми моделями и занимает первые места в шести бенчмарках. Доступна в рамках Открытого Соглашения Nvidia для коммерческого использования, она нацелена на развертывание AI-агентов на краевых устройствах с использованием одиночных GPU, что делает Nvidia конкурентом не только в области инфраструктуры AI, но и в моделях, которые на ней работают.

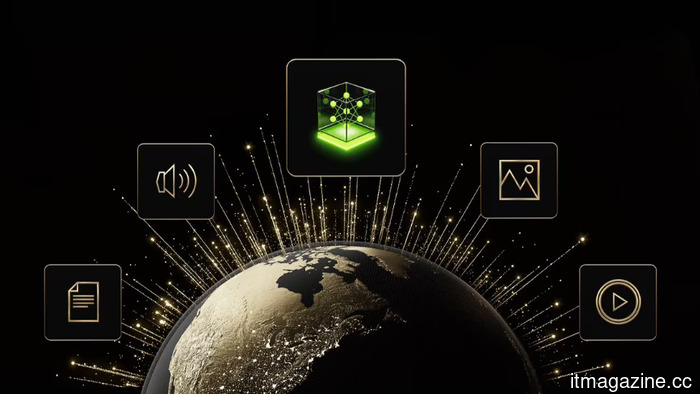

Nvidia выпустила Nemotron 3 Nano Omni во вторник, открытую мультимодальную AI модель, которая объединяет понимание зрения, аудио и языка в одной архитектуре, предназначенной для работы автономных AI-агентов на краевых устройствах. Модель имеет 30 миллиардов параметров, но активирует только три миллиарда за один проход через дизайн с смесью экспертов, что позволяет ей работать на одном GPU, при этом соответствуя или превышая мультимодальные возможности моделей, в несколько раз превышающих её размер. Nvidia утверждает, что производительность в девять раз выше, чем у сопоставимых открытых мультимодальных моделей с эквивалентной интерактивностью, в 2,9 раза быстрее однопоточного рассуждения по мультимодальным задачам и примерно в девять раз больше эффективной системной мощности для видео-рассуждений. Модель занимает первые места в шести бенчмарках в области документальной интеллигенции, понимания видео и аудио. Она обрабатывает текст, изображения, аудио, видео, документы, графики и графические интерфейсы в качестве входных данных и производит текст в качестве выхода, что означает, что одна модель может заменить набор специализированных моделей для зрения, речи и обработки документов, которые в настоящее время объединяются в большинстве корпоративных развертываний AI. Выпуск, доступный на Hugging Face в рамках Открытого Соглашения Nvidia с полными правами на коммерческое использование, представляет собой самый агрессивный шаг компании, продающей инфраструктуру для AI на рынок самого AI.

Архитектура

Nemotron 3 Nano Omni использует гибридную архитектуру Mamba-Transformer с 23 слоями выборочного состояния Mamba-2, 23 слоями смеси экспертов с 128 экспертами, маршрутизирующими к шести на токен плюс общий эксперт, и шестью слоями внимания с группированными запросами. Кодировщик зрения, C-RADIOv4-H, обрабатывает изображения переменного разрешения с патчами 16 на 16, масштабируемыми от 1,024 до 13,312 визуальных патчей на изображение. Кодировщик аудио, Parakeet-TDT-0.6B-v2, обрабатывает речь и окружающее аудио. Обработка видео использует трехмерные свертки для захвата движения между кадрами, а не рассматривает видео как последовательность неподвижных изображений. Базовая текстовая модель была предварительно обучена на 25 триллионах токенов и поддерживает контекстное окно в 256,000 токенов. Архитектурные выборы отражают конкретную философию дизайна: максимизировать возможности на активный параметр, а не на общее количество параметров, поскольку развертывание на крае ограничено не размером модели в состоянии покоя, а вычислениями на каждом шаге вывода. Три миллиарда активных параметров на выводе означают, что модель может работать на оборудовании, представленном на конференции разработчиков Nvidia GTC 2026, включая рабочие станции DGX Spark и DGX Station, без необходимости в кластерах с несколькими GPU, которые питают более крупные модели в дата-центрах.

Подход с смесью экспертов не нов, но его применение к мультимодальной модели такого масштаба — это новшество. Большинство открытых мультимодальных моделей либо используют одну плотную архитектуру, которая требует, чтобы все параметры были активны на каждом шаге вывода, либо используют отдельные специализированные модели, соединенные в цепочку, что вводит задержку на каждом переходе. Nemotron 3 Nano Omni не делает ни того, ни другого. Он маршрутизирует каждый токен к шести из 128 экспертов в единой модели, что означает, что токены зрения, аудио и текста проходят через одну и ту же архитектуру, но активируют разные экспертизы в зависимости от модальности. Результат — это модель, которая может одновременно обрабатывать видеопоток, устную инструкцию и документ без межмодельной задержки, которая делает архитектуры цепочек неподходящими для приложений реального времени. Для корпоративных развертываний это упрощает операционную сложность поддержания отдельных моделей зрения, речи и языка с отдельными конечными точками вывода, мониторингом и версионированием в одну модель, обслуживающую одну конечную точку.

Стратегия

💜 технологий ЕС Последние слухи из технологической сцены ЕС, история от нашего мудрого основателя Бориса и немного сомнительного AI-искусства. Это бесплатно, каждую неделю, в вашем почтовом ящике. Подпишитесь сейчас!Nvidia потратила бум AI на продажу инфраструктуры: GPU, сетевое оборудование и программное обеспечение CUDA, которое привязывает разработчиков к её оборудованию. Семейство моделей Nemotron, которое было загружено более 50 миллионов раз за последний год, представляет собой параллельную стратегию, в рамках которой Nvidia также предоставляет модели, которые работают на этой инфраструктуре. Логика замкнута, но мощна: модели Nvidia оптимизированы для оборудования Nvidia, а оборудование Nvidia оптимизировано для моделей Nvidia, создавая полный стек экосистемы, который конкурирует с предложениями моделей плюс облака от Google, Amazon и Microsoft. Аргумент в пользу небольших, специализированных языковых моделей был представлен в образовании, здравоохранении и бизнесе, и Nemotron 3 Nano Omni расширяет этот аргумент для мультимодальных приложений: вместо того чтобы вызывать массивную облачную модель для каждой задачи зрения или аудио, предприятия могут запускать компактную модель локально, которая обрабатывает весь перцептивный стек.

Раннее корпоративное принятие включает Foxconn, Palantir, Aible, ASI, Eka Care и H Company, при этом Dell, DocuSign, Infosys, Oracle и Zefr оценивают модель для производственного развертывания. Сценарии использования, визуальная инспекция на заводе, обработка документов, приложения голосовых агентов и понимание экрана для компьютерных агентов, отражают рынок, на который нацелена Nvidia: не потребительские AI-ассистенты, а промышленные AI-агенты, которые должны видеть, слышать и читать в реальном времени на локальном оборудовании. Модель доступна как микросервис Nvidia NIM, через Amazon SageMaker JumpStart и на OpenRouter, с вариантами развертывания, включая vLLM, SGLang, Ollama, llama.cpp и TensorRT-LLM. Широта вариантов развертывания сама по себе является конкурентным заявлением: Nvidia делает модель доступной для запуска везде, на каждой платформе, чтобы максимизировать принятие и углубить зависимость от более широкой экосистемы Nvidia.

Конкуренция

Открытые AI-модели, предназначенные для агентного рассуждения, приходят с разных направлений одновременно. Модели V4-Pro и V4-Flash от DeepSeek, выпущенные на прошлой неделе, используют гибридную архитектуру внимания, оптимизированную для долгосрочных агентных задач. Модели Llama от Meta доминируют в пространстве текстов с открытыми весами. Модели Gemini от Google обрабатывают мультимодальные задачи в облачном масштабе. Модели GPT от OpenAI остаются коммерческим эталоном. Что отличает Nemotron 3 Nano Omni, так это не какая-то одна способность, а комбинация: мультимодальное восприятие в области зрения, аудио и текста в одной модели, с эффективностью смеси экспертов, которая позволяет развертывание на крае, выпущенной с открытыми весами и коммерческим лицензированием. Ни одна другая модель в настоящее время не предлагает все четыре свойства вместе. Ближайшие аналоги, Gemini Nano от Google для устройств и Llama от Meta для открытых весов, каждый из которых не хватает как минимум одного элемента: Gemini Nano не имеет открытых весов, а мультимодальные возможности Llama не включают обработку аудио в единой архитектуре.

Конкурентные последствия выходят за рамки самой модели. Если открытые модели Nvidia станут стандартом для развертывания AI-агентов на крае, компания захватывает ценность на каждом уровне

Другие статьи

Google Play Store упростит поиск приложений, которые не выглядят ужасно на планшетах и складных устройствах.

Предстоящее обновление v51.2 Google Play Store добавляет значок оптимизации для больших экранов в списки приложений, что сразу же дает понять, какие приложения разработаны для планшетов и складных устройств.

Google Play Store упростит поиск приложений, которые не выглядят ужасно на планшетах и складных устройствах.

Предстоящее обновление v51.2 Google Play Store добавляет значок оптимизации для больших экранов в списки приложений, что сразу же дает понять, какие приложения разработаны для планшетов и складных устройств.

Nvidia тихо выпустила новую версию графического процессора GeForce RTX 5070 в блоге о драйверах

Новая 12ГБ видеокарта Nvidia GeForce RTX 5070 для ноутбуков использует другой источник памяти GDDR7 для решения проблем с запасами, предоставляя производителям ноутбуков третью конфигурацию выше существующей модели на 8ГБ.

Nvidia тихо выпустила новую версию графического процессора GeForce RTX 5070 в блоге о драйверах

Новая 12ГБ видеокарта Nvidia GeForce RTX 5070 для ноутбуков использует другой источник памяти GDDR7 для решения проблем с запасами, предоставляя производителям ноутбуков третью конфигурацию выше существующей модели на 8ГБ.

Приложение LibrePods, которое позволяет AirPods хорошо работать с телефонами на Android, наконец-то устраняет свою главную проблему.

LibrePods, приложение, которое разблокирует функции AirPods на Android, теперь проще в использовании благодаря доступности в Play Store и сниженной зависимости от рискованного рут-доступа.

Приложение LibrePods, которое позволяет AirPods хорошо работать с телефонами на Android, наконец-то устраняет свою главную проблему.

LibrePods, приложение, которое разблокирует функции AirPods на Android, теперь проще в использовании благодаря доступности в Play Store и сниженной зависимости от рискованного рут-доступа.

Наконец, Amazon исправляет единственную вещь, которая делала чтение на Kindle Colorsoft болезненным после темноты.

Последнее обновление Amazon наконец-то предоставляет системный темный режим для Kindle Colorsoft и Scribe Colorsoft, охватывая каждую поверхность устройства с возможностью настройки по разделам.

Наконец, Amazon исправляет единственную вещь, которая делала чтение на Kindle Colorsoft болезненным после темноты.

Последнее обновление Amazon наконец-то предоставляет системный темный режим для Kindle Colorsoft и Scribe Colorsoft, охватывая каждую поверхность устройства с возможностью настройки по разделам.

Основатель Scholly Кристофер Грей подал в суд на Sallie Mae, обвиняя в незаконном увольнении и продаже данных студентов, включая несовершеннолетних.

Кристофер Грей создал Scholly, чтобы помочь студентам находить стипендии. После того как Sallie Mae приобрела компанию, он говорит, что его уволили за то, что он возразил против продажи личных данных пользователей, включая информацию о несовершеннолетних.

Основатель Scholly Кристофер Грей подал в суд на Sallie Mae, обвиняя в незаконном увольнении и продаже данных студентов, включая несовершеннолетних.

Кристофер Грей создал Scholly, чтобы помочь студентам находить стипендии. После того как Sallie Mae приобрела компанию, он говорит, что его уволили за то, что он возразил против продажи личных данных пользователей, включая информацию о несовершеннолетних.

GIGABYTE выпустит на рынок компактный ноутбук с искусственным интеллектом.

Компания GIGABYTE, известный производитель компьютерного оборудования, представила ноутбук AERO X16. Этот новый продукт ориентирован на пользователей, которым требуется ультратонкое устройство для мобильности, современные нейросети и возможности для творчества. В одном корпусе объединили все актуальные на сегодняшний день тренды.

GIGABYTE выпустит на рынок компактный ноутбук с искусственным интеллектом.

Компания GIGABYTE, известный производитель компьютерного оборудования, представила ноутбук AERO X16. Этот новый продукт ориентирован на пользователей, которым требуется ультратонкое устройство для мобильности, современные нейросети и возможности для творчества. В одном корпусе объединили все актуальные на сегодняшний день тренды.

Nvidia выпускает Nemotron 3 Nano Omni: открытая мультимодальная модель с 30B параметрами, 3B активными, для агентов на краевых AI.

Nemotron 3 Nano Omni от Nvidia объединяет визуальные, аудио и текстовые данные в одной модели с открытым весом и 9-кратной пропускной способностью. Активно только 3 миллиарда из 30 миллиардов параметров на шаг. Ориентирован на AI-агентов на краю на одиночных GPU.