Пользователи Discord нарушают контроль доступа, чтобы получить доступ к модели Mythos компании Anthropic.

Недавний инцидент с безопасностью, связанный с Anthropic, подчеркнул, насколько хрупкими могут быть меры предосторожности вокруг продвинутых ИИ-систем. В отчете Wired говорится, что небольшая группа пользователей, действуя через частные каналы Discord, смогла получить несанкционированный доступ к высоко ограниченной модели Mythos AI компании — экспериментальной системе, предназначенной для применения в области кибербезопасности.

Нарушение, которое выявляет большие риски контроля ИИ

Инцидент, по всей видимости, произошел почти сразу после того, как Mythos стал доступен ограниченной группе доверенных партнеров. Согласно нескольким отчетам, несанкционированные пользователи получили доступ через среду стороннего поставщика, а не непосредственно нарушив основные системы Anthropic.

Некоторые источники утверждают, что члены частного сообщества Discord смогли использовать разрешения доступа или определить точки входа, используя общедоступную информацию, эффективно обходя ограничения, наложенные на модель.

Unsplash

Важно отметить, что нет подтвержденных доказательств того, что система использовалась для злонамеренной деятельности. На самом деле, отчеты указывают на то, что пользователи взаимодействовали с моделью относительно ограниченными способами. Тем не менее, тот факт, что доступ был получен вообще, является настоящей новостью.

Mythos сам по себе не просто еще одна модель ИИ. Он предназначен для выявления уязвимостей в программных системах и моделирования кибератак — что делает его одним из самых чувствительных инструментов ИИ, находящихся в разработке. Эта двойная функция именно поэтому доступ к нему был строго ограничен изначально.

Почему этот инцидент важен не только из-за одного нарушения

На первый взгляд, это может показаться локальным сбоем в безопасности. На самом деле, это подчеркивает более широкую проблему, с которой сталкивается индустрия ИИ: контроль становится сложнее, чем способность.

Модели ИИ, такие как Mythos, созданы для поиска слабых мест в системах, что означает, что в неправильных руках они могут ускорить кибератаки, а не предотвратить их. Исследователи и чиновники уже предупреждали, что такие инструменты могут представлять значительные риски в случае неправильного использования, учитывая их способность автоматизировать сложные цепочки атак.

Что делает этот случай особенно примечательным, так это то, как произошло нарушение. Это не был сложный хак, нацеленный на основную инфраструктуру. Вместо этого, похоже, он использовал пробелы в окружающей экосистеме — подрядчики, разрешения и управление доступом.

Это различие имеет значение. Оно предполагает, что обеспечение безопасности продвинутого ИИ — это не только вопрос самой модели, но и всей окружающей среды.

Почему это должно иметь значение для вас

Для обычных пользователей этот инцидент может показаться далеким, но его последствия ближе, чем кажется.

Системы ИИ, такие как Mythos, разрабатываются для защиты всего, от браузеров до финансовых систем. Если эти же инструменты будут раскрыты преждевременно или неправильно контролироваться, риск смещается с оборонительного на потенциально наступательный.

Представительное изображение Unsplash

Даже без злонамеренных намерений несанкционированный доступ вводит неопределенность. Это вызывает вопросы о том, насколько хорошо компании могут защищать технологии, которые становятся все более критичными для цифровой инфраструктуры.

Проще говоря, если ИИ разрабатывается для защиты интернета, его нужно сначала защитить.

Что будет дальше для Anthropic и безопасности ИИ

Anthropic уже начала расследование инцидента и заявила, что нарушение было ограничено средой третьей стороны, без доказательств более широкого компрометации системы.

Тем не менее, время нарушения — совпадающее с ранним запуском модели — вероятно, усилит внимание к тому, как такие системы тестируются и делятся. Регуляторы и отраслевые организации уже внимательно следят за высокорисковыми моделями ИИ, и такие инциденты только добавляют срочности к этим обсуждениям.

В будущем ожидайте более строгих контролей доступа, более тщательного надзора за поставщиками и потенциально новых рамок для работы с чувствительными инструментами ИИ. Потому что если этот эпизод чему-то и учит, так это тому, что задача больше не заключается только в создании мощного ИИ — она заключается в его сдерживании.

Другие статьи

Я никогда не думал, что ИИ будет добавлять опечатки – но это в каком-то смысле имеет смысл.

Новый инструмент ИИ намеренно добавляет опечатки в электронные письма, отражая сдвиг, при котором несовершенное письмо воспринимается как более человеческое и заслуживающее доверия в эпоху коммуникации, генерируемой ИИ.

Я никогда не думал, что ИИ будет добавлять опечатки – но это в каком-то смысле имеет смысл.

Новый инструмент ИИ намеренно добавляет опечатки в электронные письма, отражая сдвиг, при котором несовершенное письмо воспринимается как более человеческое и заслуживающее доверия в эпоху коммуникации, генерируемой ИИ.

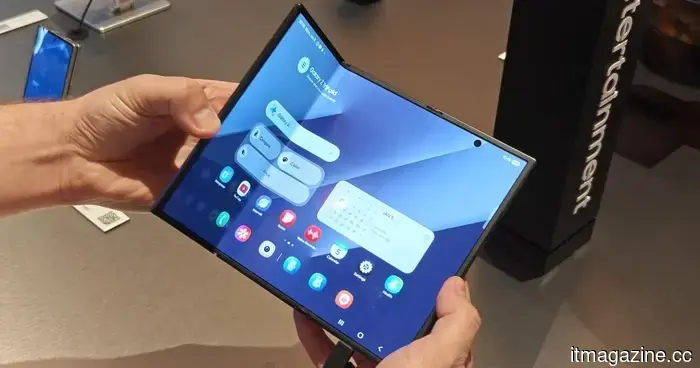

Галактика Z TriFold уходит в прошлое. Вот что я хочу, чтобы его преемник исправил.

TriFold был самым амбициозным телефоном Samsung за последние годы и самым компромиссным. Его преемник не может позволить себе повторить те же ошибки.

Галактика Z TriFold уходит в прошлое. Вот что я хочу, чтобы его преемник исправил.

TriFold был самым амбициозным телефоном Samsung за последние годы и самым компромиссным. Его преемник не может позволить себе повторить те же ошибки.

Tesla предлагает один год бесплатной суперзарядки с Model 3 Premium и Performance

Tesla предлагает один год бесплатной суперзарядки с вариантами Model 3 Premium и Performance, снижая затраты на владение и укрепляя свои преимущества в экосистеме зарядки.

Tesla предлагает один год бесплатной суперзарядки с Model 3 Premium и Performance

Tesla предлагает один год бесплатной суперзарядки с вариантами Model 3 Premium и Performance, снижая затраты на владение и укрепляя свои преимущества в экосистеме зарядки.

NotebookLM теперь может автоматически организовывать ваши исследовательские источники.

Google внедрил автоматическую маркировку и категоризацию источников в NotebookLM. Функция активируется автоматически, как только у вас в блокноте есть пять или более источников.

NotebookLM теперь может автоматически организовывать ваши исследовательские источники.

Google внедрил автоматическую маркировку и категоризацию источников в NotebookLM. Функция активируется автоматически, как только у вас в блокноте есть пять или более источников.

Apple может вернуть моду на изогнутые дисплеи с юбилейным 20-м iPhone

20-летний юбилейный iPhone от Apple обещает стать значительным изменением в дизайне, с плоским четырехугольным микро-изгибом и OLED-панелью COE, произведенной Samsung.

Apple может вернуть моду на изогнутые дисплеи с юбилейным 20-м iPhone

20-летний юбилейный iPhone от Apple обещает стать значительным изменением в дизайне, с плоским четырехугольным микро-изгибом и OLED-панелью COE, произведенной Samsung.

Я никогда не думал, что ИИ добавит опечатки – но это в какой-то степени имеет смысл.

Новый инструмент ИИ намеренно добавляет опечатки в электронные письма, отражая сдвиг, при котором несовершенное письмо воспринимается как более человеческое и заслуживающее доверия в эпоху коммуникации, созданной ИИ.

Я никогда не думал, что ИИ добавит опечатки – но это в какой-то степени имеет смысл.

Новый инструмент ИИ намеренно добавляет опечатки в электронные письма, отражая сдвиг, при котором несовершенное письмо воспринимается как более человеческое и заслуживающее доверия в эпоху коммуникации, созданной ИИ.

Пользователи Discord нарушают контроль доступа, чтобы получить доступ к модели Mythos компании Anthropic.

Несанкционированный доступ к Mythos AI компании Anthropic подчеркивает растущие опасения по поводу защиты мощных систем, выявляя уязвимости не в самом модели, а в окружающей ее экосистеме доступа.