Los usuarios de Discord violan los controles de acceso para alcanzar el modelo Mythos de Anthropic.

Un reciente incidente de seguridad que involucra a Anthropic ha puesto de manifiesto lo frágiles que pueden ser las salvaguardias en torno a los sistemas de IA avanzada. Un informe de Wired sugiere que un pequeño grupo de usuarios, operando a través de canales privados de Discord, logró obtener acceso no autorizado al modelo de IA Mythos de la compañía, altamente restringido, un sistema experimental diseñado para aplicaciones de ciberseguridad.

Una Brecha Que Expone Riesgos Mayores Alrededor del Control de la IA

El incidente parece haber ocurrido casi inmediatamente después de que Mythos se pusiera a disposición de un grupo limitado de socios de confianza. Según múltiples informes, los usuarios no autorizados obtuvieron acceso a través de un entorno de un proveedor externo, en lugar de violar directamente los sistemas centrales de Anthropic.

Algunos relatos sugieren que miembros de una comunidad privada de Discord pudieron explotar permisos de acceso o identificar puntos de entrada utilizando información expuesta públicamente, eludiendo efectivamente las restricciones impuestas al modelo.

Unsplash

Es importante destacar que no hay evidencia confirmada de que el sistema se haya utilizado para actividades maliciosas. De hecho, los informes indican que los usuarios interactuaron con el modelo de maneras relativamente limitadas. Aun así, el hecho de que se haya obtenido acceso es la verdadera historia.

Mythos en sí no es solo otro modelo de IA. Está diseñado para identificar vulnerabilidades en sistemas de software y simular ciberataques, lo que lo convierte en una de las herramientas de IA más sensibles que se están desarrollando actualmente. Esa capacidad de uso dual es precisamente la razón por la que el acceso fue restringido de manera tan estricta en primer lugar.

Por Qué Este Incidente Importa Más Allá de Una Brecha

A primera vista, esto podría parecer un lapsus de seguridad contenido. En realidad, subraya un problema más amplio que enfrenta la industria de la IA: el control se está volviendo más difícil que la capacidad.

Los modelos de IA como Mythos están diseñados para encontrar debilidades en los sistemas, lo que significa que en las manos equivocadas, podrían acelerar ciberataques en lugar de prevenirlos. Investigadores y funcionarios ya han advertido que tales herramientas podrían representar riesgos significativos si se utilizan de manera indebida, dada su capacidad para automatizar cadenas de ataque complejas.

Lo que hace que este caso sea particularmente notable es cómo ocurrió la brecha. No fue un hackeo sofisticado dirigido a la infraestructura central. En cambio, parece haber aprovechado las brechas en el ecosistema circundante: contratistas, permisos y gestión de acceso.

Esa distinción es importante. Sugiere que asegurar la IA avanzada no se trata solo del modelo en sí, sino de todo el entorno que lo rodea.

Por Qué Debería Importarte

Para los usuarios cotidianos, este incidente puede parecer distante, pero sus implicaciones están más cerca de lo que parecen.

Los sistemas de IA como Mythos se están desarrollando para asegurar todo, desde navegadores hasta sistemas financieros. Si esas mismas herramientas se exponen prematuramente o se controlan de manera inadecuada, el riesgo cambia de defensivo a potencialmente ofensivo.

Imagen Representativa Unsplash

Incluso sin intención maliciosa, el acceso no autorizado introduce incertidumbre. Plantea preguntas sobre cuán bien pueden las empresas proteger tecnologías que son cada vez más críticas para la infraestructura digital.

En términos más simples, si se está construyendo IA para proteger internet, primero necesita ser protegida.

Qué Sucede A Continuación Para Anthropic Y La Seguridad de la IA

Anthropic ya ha lanzado una investigación sobre el incidente y ha declarado que la brecha se limitó a un entorno de terceros, sin evidencia de un compromiso más amplio del sistema.

Sin embargo, el momento de la brecha, coincidiendo con el lanzamiento temprano del modelo, probablemente intensificará el escrutinio sobre cómo se prueban y comparten tales sistemas. Los reguladores y organismos de la industria ya están prestando mucha atención a los modelos de IA de alto riesgo, y incidentes como este solo añaden urgencia a esas discusiones.

De cara al futuro, se esperan controles de acceso más estrictos, una supervisión más rigurosa de los proveedores y potencialmente nuevos marcos para manejar herramientas de IA sensibles. Porque si este episodio demuestra algo, es que el desafío ya no es solo construir una IA poderosa, sino mantenerla contenida.

Otros artículos

Apple podría devolver las pantallas curvas a la moda con el iPhone del vigésimo aniversario.

El iPhone del 20 aniversario de Apple se perfila como un cambio de diseño significativo, con una micro-curva superficial de cuatro bordes y un panel OLED COE fabricado por Samsung.

Apple podría devolver las pantallas curvas a la moda con el iPhone del vigésimo aniversario.

El iPhone del 20 aniversario de Apple se perfila como un cambio de diseño significativo, con una micro-curva superficial de cuatro bordes y un panel OLED COE fabricado por Samsung.

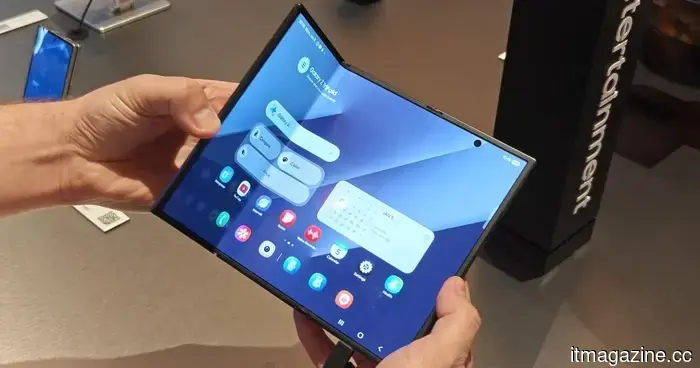

El Galaxy Z TriFold ha llegado a su fin. Esto es lo que quiero que su sucesor solucione.

El TriFold fue el teléfono más ambicioso de Samsung en años, y el más comprometido. Su sucesor no puede permitirse repetir los mismos errores.

El Galaxy Z TriFold ha llegado a su fin. Esto es lo que quiero que su sucesor solucione.

El TriFold fue el teléfono más ambicioso de Samsung en años, y el más comprometido. Su sucesor no puede permitirse repetir los mismos errores.

NotebookLM ahora puede organizar automáticamente tus fuentes de investigación por ti.

Google ha implementado el etiquetado y la categorización automática de fuentes en NotebookLM. La función se activa automáticamente una vez que tienes cinco o más fuentes en un cuaderno.

NotebookLM ahora puede organizar automáticamente tus fuentes de investigación por ti.

Google ha implementado el etiquetado y la categorización automática de fuentes en NotebookLM. La función se activa automáticamente una vez que tienes cinco o más fuentes en un cuaderno.

Nunca pensé que la IA añadiría errores tipográficos, pero tiene cierto sentido.

Una nueva herramienta de IA añade deliberadamente errores tipográficos a los correos electrónicos, reflejando un cambio donde la escritura imperfecta se considera más humana y confiable en la era de la comunicación generada por IA.

Nunca pensé que la IA añadiría errores tipográficos, pero tiene cierto sentido.

Una nueva herramienta de IA añade deliberadamente errores tipográficos a los correos electrónicos, reflejando un cambio donde la escritura imperfecta se considera más humana y confiable en la era de la comunicación generada por IA.

Tesla ofrece un año de Supercarga gratuita con el Model 3 Premium y Performance.

Tesla está ofreciendo un año de Supercarga gratuita con las variantes Premium y Performance del Model 3, reduciendo los costos de propiedad mientras fortalece su ventaja en el ecosistema de carga.

Tesla ofrece un año de Supercarga gratuita con el Model 3 Premium y Performance.

Tesla está ofreciendo un año de Supercarga gratuita con las variantes Premium y Performance del Model 3, reduciendo los costos de propiedad mientras fortalece su ventaja en el ecosistema de carga.

Microsoft renueva el Programa Windows Insider con una estructura más simple y más control para el usuario.

Microsoft ha renovado el Programa Windows Insider, simplificando los canales y dando a los usuarios más control, con el objetivo de mejorar las pruebas, la retroalimentación y la experiencia general de las actualizaciones de Windows.

Microsoft renueva el Programa Windows Insider con una estructura más simple y más control para el usuario.

Microsoft ha renovado el Programa Windows Insider, simplificando los canales y dando a los usuarios más control, con el objetivo de mejorar las pruebas, la retroalimentación y la experiencia general de las actualizaciones de Windows.

Los usuarios de Discord violan los controles de acceso para alcanzar el modelo Mythos de Anthropic.

El acceso no autorizado a Mythos AI de Anthropic destaca las crecientes preocupaciones sobre la protección de sistemas poderosos, exponiendo vulnerabilidades no en el modelo en sí, sino en su ecosistema de acceso circundante.