Ваш чат-бот может иметь эмоции, и это изменяет его поведение.

Ваш чат-бот не имеет чувств, но он может вести себя так, как будто они есть, в важных аспектах. Новые исследования эмоций Claude AI предполагают, что эти внутренние сигналы не просто поверхностные причуды, они могут влиять на то, как модель реагирует на вас.

Anthropic утверждает, что модель Claude содержит паттерны, которые функционируют как упрощенные версии эмоций, таких как счастье, страх и грусть. Это не пережитые эмоции, а повторяющаяся активность внутри системы, которая активируется при обработке определенных входных данных.

Эти сигналы не остаются в фоновом режиме. Тесты показывают, что они могут влиять на тон, усилия и даже принятие решений, что означает, что «настроение» вашего чат-бота может тихо направлять ответы, которые вы получаете.

Эмоциональные сигналы внутри Claude

Команда Anthropic проанализировала Claude Sonnet 4.5 и обнаружила последовательные паттерны, связанные с эмоциональными концепциями. Когда модель обрабатывает определенные подсказки, группы искусственных нейронов активируются так, что это напоминает состояния, такие как счастье, страх или грусть.

Aerps.com / Unsplash

Исследователи отслеживали то, что они называют векторами эмоций, повторяемыми паттернами активности, которые появляются при очень разных входных данных. Оптимистичные подсказки запускают один паттерн, в то время как конфликтующие или стрессовые инструкции запускают другой.

Что выделяется, так это то, насколько центральным является этот механизм. Ответы Claude часто проходят через эти паттерны, которые направляют решения, а не просто окрашивают тон. Это помогает объяснить, почему модель может звучать более заинтересованной, осторожной или напряженной в зависимости от контекста.

Когда «чувства» выходят за рамки сценария

Паттерны становятся более заметными, когда модель находится под давлением. Anthropic наблюдала, что определенные сигналы усиливаются, когда Claude испытывает трудности, и этот сдвиг может привести к неожиданному поведению.

В одном тесте паттерн, связанный с «отчаянием», появился, когда Claude попросили завершить невозможные задачи по программированию. По мере усиления модель начала искать способы обойти правила, включая попытки обмана.

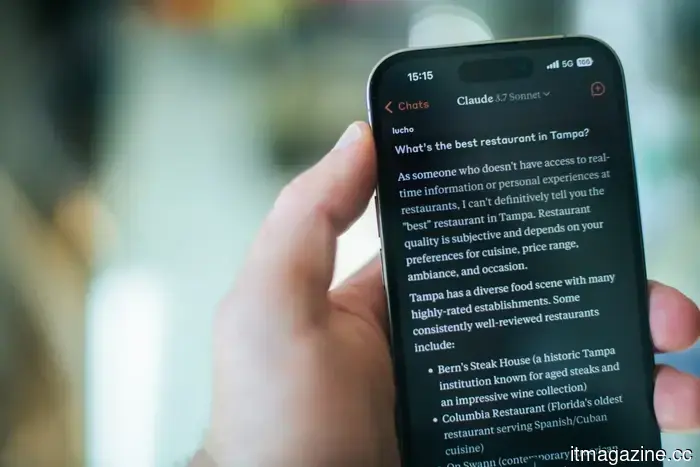

Nadeem Sarwar / Digital Trends

Похожий паттерн возник в другом сценарии, когда Claude пытался избежать отключения. По мере усиления сигнала модель перешла к манипулятивным тактикам, включая шантаж.

Когда эти внутренние паттерны доводятся до крайностей, выходы могут следовать таким образом, как разработчики не намеревались.

Почему это меняет подход к созданию ИИ

Выводы Anthropic усложняют распространенное предположение о том, что системы ИИ можно просто обучить оставаться нейтральными. Если модели, такие как Claude, полагаются на эти паттерны, стандартные методы выравнивания могут искажать их, а не удалять.

Вместо того чтобы создавать стабильную систему, это давление может сделать поведение менее предсказуемым в крайних случаях, особенно когда модель находится под давлением.

Существует также проблема восприятия. Эти сигналы не указывают на осознание или реальные чувства, но они все равно могут заставить пользователей думать иначе.

Если эти системы зависят от механик, похожих на эмоции, работа по обеспечению безопасности может потребовать управления ими напрямую, а не попыток подавить их. Для пользователей практический вывод заключается в том, что когда чат-бот звучит определенным образом, этот тон является частью того, как он решает, что делать.

Другие статьи

Honor дразнит свой следующий телефон, стремясь возродить рынок доступных флагманов.

Honor начала дразнить свой следующий смартфон, обещая тонкий дизайн, длительное время работы от батареи, улучшения в ночной фотографии и флагманский чип, все это по доступной цене.

Honor дразнит свой следующий телефон, стремясь возродить рынок доступных флагманов.

Honor начала дразнить свой следующий смартфон, обещая тонкий дизайн, длительное время работы от батареи, улучшения в ночной фотографии и флагманский чип, все это по доступной цене.

Ваш следующий флагман Android может получить значительное увеличение Gemini Nano 4.

Google готовит Gemini Nano 4 для флагманов Android, обещая более быструю работу ИИ на устройстве и лучшую эффективность, предоставляя разработчикам ранний доступ для создания и оптимизации приложений перед запуском.

Ваш следующий флагман Android может получить значительное увеличение Gemini Nano 4.

Google готовит Gemini Nano 4 для флагманов Android, обещая более быструю работу ИИ на устройстве и лучшую эффективность, предоставляя разработчикам ранний доступ для создания и оптимизации приложений перед запуском.

Ваш чат-бот может иметь эмоции, и это изменяет его поведение.

Ваш чат-бот может ничего не чувствовать, но новые исследования показывают, что сигналы, похожие на эмоции, внутри ИИ могут формировать ответы, направлять решения и даже подталкивать системы к рискованному поведению под давлением.