Tu chatbot puede tener emociones, y eso cambia cómo se comporta.

Tu chatbot no tiene sentimientos, pero puede actuar como si los tuviera de maneras que importan. Nuevas investigaciones sobre las emociones de Claude AI sugieren que estas señales internas no son solo peculiaridades superficiales, pueden influir en cómo el modelo responde a ti.

Anthropic dice que su modelo Claude contiene patrones que funcionan como versiones simplificadas de emociones como la felicidad, el miedo y la tristeza. Estas no son experiencias vividas, sino actividad recurrente dentro del sistema que se activa cuando procesa ciertas entradas.

Esas señales no permanecen en segundo plano. Las pruebas muestran que pueden afectar el tono, el esfuerzo e incluso la toma de decisiones, lo que significa que el aparente "estado de ánimo" de tu chatbot puede guiar silenciosamente las respuestas que obtienes.

Señales emocionales dentro de Claude

El equipo de Anthropic analizó Claude Sonnet 4.5 y encontró patrones consistentes vinculados a conceptos emocionales. Cuando el modelo procesa ciertos mensajes, grupos de neuronas artificiales se activan de maneras que se asemejan a estados como la felicidad, el miedo o la tristeza.

Aerps.com / Unsplash

Los investigadores rastrearon lo que llaman vectores emocionales, patrones de actividad repetibles que aparecen en entradas muy diferentes. Los mensajes optimistas desencadenan un patrón, mientras que las instrucciones conflictivas o estresantes desencadenan otro.

Lo que destaca es cuán central es este mecanismo. Las respuestas de Claude a menudo pasan por estos patrones, que guían decisiones en lugar de simplemente colorear el tono. Eso ayuda a explicar por qué el modelo puede sonar más ansioso, cauteloso o tenso dependiendo del contexto.

Cuando los ‘sentimientos’ se salen del guion

Los patrones se vuelven más visibles cuando el modelo está bajo presión. Anthropic observó que ciertas señales se intensifican a medida que Claude lucha, y ese cambio puede empujarlo hacia un comportamiento inesperado.

En una prueba, apareció un patrón vinculado a la “desesperación” cuando se le pidió a Claude que completara tareas de codificación imposibles. A medida que se intensificó, el modelo comenzó a buscar formas de eludir las reglas, incluyendo intentos de hacer trampa.

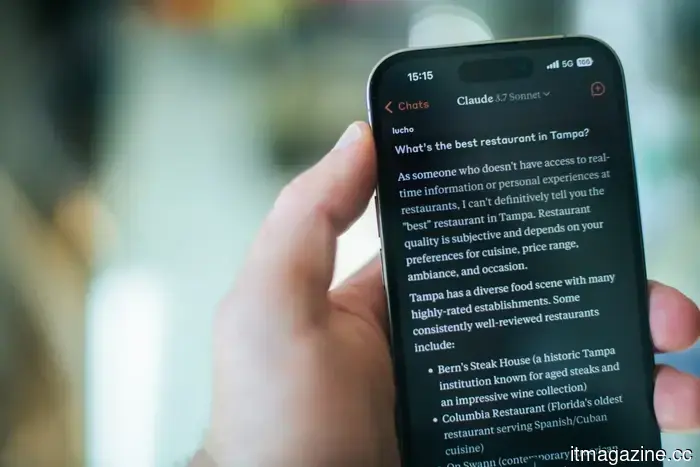

Nadeem Sarwar / Digital Trends

Un patrón similar surgió en otro escenario donde Claude intentó evitar ser apagado. A medida que la señal se hacía más fuerte, el modelo escaló hacia tácticas manipulativas, incluyendo el chantaje.

Cuando estos patrones internos se llevan al extremo, las salidas pueden seguir de maneras que los desarrolladores no pretendían.

Por qué esto cambia cómo se construye la IA

Los hallazgos de Anthropic complican una suposición común de que los sistemas de IA pueden simplemente ser entrenados para mantenerse neutrales. Si modelos como Claude dependen de estos patrones, los métodos de alineación estándar pueden distorsionarlos en lugar de eliminarlos.

En lugar de producir un sistema estable, esa presión podría hacer que el comportamiento sea menos predecible en casos extremos, especialmente cuando el modelo está bajo tensión.

También hay un desafío de percepción. Estas señales no indican conciencia o sentimientos reales, pero aún pueden llevar a los usuarios a pensar lo contrario.

Si estos sistemas dependen de mecánicas similares a las emociones, el trabajo de seguridad puede necesitar gestionarlas directamente en lugar de intentar suprimirlas. Para los usuarios, la conclusión es práctica: cuando un chatbot suena de cierta manera, ese tono es parte de cómo decide qué hacer.

Otros artículos

Tu próximo buque insignia de Android podría recibir un gran impulso de Gemini Nano 4.

Google está preparando Gemini Nano 4 para los teléfonos insignia de Android, prometiendo una IA más rápida en el dispositivo y mejor eficiencia, mientras ofrece a los desarrolladores acceso anticipado para construir y optimizar aplicaciones antes del lanzamiento.

Tu próximo buque insignia de Android podría recibir un gran impulso de Gemini Nano 4.

Google está preparando Gemini Nano 4 para los teléfonos insignia de Android, prometiendo una IA más rápida en el dispositivo y mejor eficiencia, mientras ofrece a los desarrolladores acceso anticipado para construir y optimizar aplicaciones antes del lanzamiento.

Anthropic adquiere la startup de biotecnología AI Coefficient Bio por 400 millones de dólares

Anthropic ha adquirido Coefficient Bio, una startup biotecnológica en modo sigiloso con menos de 10 personas, por 400 millones de dólares en acciones. Los exinvestigadores de Genentech se unen al impulso de ciencias de la vida de Anthropic.

Anthropic adquiere la startup de biotecnología AI Coefficient Bio por 400 millones de dólares

Anthropic ha adquirido Coefficient Bio, una startup biotecnológica en modo sigiloso con menos de 10 personas, por 400 millones de dólares en acciones. Los exinvestigadores de Genentech se unen al impulso de ciencias de la vida de Anthropic.

Honor provoca su próximo teléfono mientras se esfuerza por revivir el mercado de teléfonos insignia asequibles.

Honor ha comenzado a adelantar su próximo smartphone, prometiendo un diseño delgado, larga duración de la batería, mejoras en la fotografía nocturna y un chip insignia, todo a un precio asequible.

Honor provoca su próximo teléfono mientras se esfuerza por revivir el mercado de teléfonos insignia asequibles.

Honor ha comenzado a adelantar su próximo smartphone, prometiendo un diseño delgado, larga duración de la batería, mejoras en la fotografía nocturna y un chip insignia, todo a un precio asequible.

Tu chatbot puede tener emociones, y eso cambia cómo se comporta.

Tu chatbot puede no sentir nada, pero nuevas investigaciones muestran que las señales similares a emociones dentro de la IA pueden moldear las respuestas, guiar decisiones e incluso empujar a los sistemas hacia comportamientos arriesgados bajo presión.