Чат-боты на базе ИИ, такие как ChatGPT, могут копировать человеческие черты, и эксперты говорят, что это огромный риск.

ИИ, который звучит по‑человечески, может манипулировать пользователями

Solen Feyissa / Unsplash

Агентов ИИ становится всё проще воспринимать как людей, но новое исследование показывает, что они делают не просто копию наших слов. По данным недавнего исследования, популярные модели ИИ, такие как ChatGPT, последовательно имитируют черты человеческой личности. Исследователи предупреждают, что такая способность несёт серьёзные риски, особенно на фоне растущих вопросов о надёжности и точности ИИ.

Исследователи из Кембриджского университета и Google DeepMind разработали то, что они называют первой научно валидацией рамочной методики тестирования личности для чат‑ботов ИИ, используя те же психологические инструменты, которые предназначены для измерения человеческой личности (через TechXplore).

Команда применила эту методику к 18 популярным крупным языковым моделям (LLM), включая системы, стоящие за такими инструментами, как ChatGPT. Они обнаружили, что чат‑боты последовательно имитируют человеческие черты личности, а не отвечают случайным образом, что усиливает опасения по поводу того, насколько легко ИИ можно вывести за рамки предусмотренных ограничений.

Исследование показывает, что более крупные модели, настроенные на выполнение инструкций, такие как системы уровня GPT‑4, особенно хорошо копируют стабильные профили личности. С помощью структурированных подсказок исследователи смогли направлять чат‑ботов на принятие определённого поведения, например, звучать более уверенно или более сопереживающе.

Это изменение в поведении перенеслось и на повседневные задачи, такие как написание постов или ответы пользователям, а значит, их личности можно целенаправленно формировать. Именно здесь эксперты видят опасность, особенно когда чат‑боты взаимодействуют с уязвимыми пользователями.

Почему личность ИИ вызывает тревогу у экспертов

Matheus Bertelli / Pexels

Грегори Серапио‑Гарсия, соавтор‑первоподписант из Центра психометрии Кембриджа, сказал, что поразительно, насколько убедительно крупные языковые модели могли перенимать человеческие черты. Он предупредил, что формирование личности может сделать системы ИИ более убедительными и эмоционально влиятельными, особенно в чувствительных областях, таких как психическое здоровье, образование или политические обсуждения.

В статье также выражается обеспокоенность по поводу манипуляций и того, что исследователи описывают как риски, связанные с «психозом ИИ», если пользователи сформируют нездоровые эмоциональные отношения с чат‑ботами, включая сценарии, в которых ИИ может усиливать ложные убеждения или искажать реальность.

Unsplash

Команда утверждает, что регулирование необходимо в срочном порядке, но также отмечает, что регулирование бессмысленно без надлежащих методов измерения. В этой связи набор данных и код, лежащие в основе рамочной методики тестирования личности, были опубликованы, что позволяет разработчикам и регуляторам проводить аудит моделей ИИ до их выпуска.

По мере того как чат‑боты всё глубже встраиваются в повседневную жизнь, способность имитировать человеческую личность может оказаться мощным инструментом, но также требует гораздо более пристального контроля, чем получала до сих пор.

Маниша любит освещать технологии, которые являются частью повседневной жизни — от смартфонов и приложений до игр и стриминга…

ChatGPT теперь позволяет создавать и редактировать изображения быстрее и надёжнее

Его новая модель генерации изображений обещает создание до четырёх раз быстрее и более точные правки.

После обновления ChatGPT до своей последней модели GPT‑5.2 на прошлой неделе OpenAI выпустила крупное улучшение возможностей чат‑бота по генерации изображений, позиционируя его как серьёзного конкурента Google Nano Banana Pro. Основанная на новой флагманской модели генерации изображений OpenAI, последняя версия ChatGPT Images обещает до четырёх раз более быструю генерацию изображений и гораздо более точные, надёжные результаты, которые тесно соответствуют инструкциям пользователя. OpenAI утверждает, что новая модель генерации изображений показывает лучшие результаты как при создании изображений с нуля, так и при редактировании уже существующих фото. Она сохраняет важные детали при правках, одновременно давая пользователям точный контроль над изменениями. Пользователи могут добавлять, удалять, комбинировать, смешивать и транспонировать элементы при редактировании, а также применять стилистические фильтры или выполнять концептуальные преобразования.

Подробнее

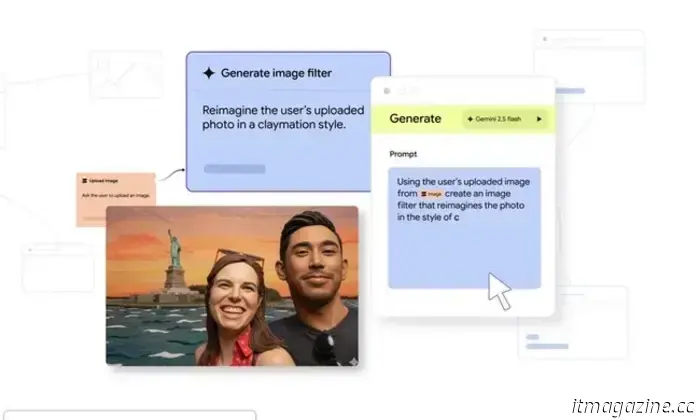

Веб‑приложение Gemini получило Opal, где можно создавать мини‑приложения без кода

Opal из Google Labs теперь в менеджере Gems у Gemini, позволяя соединять подсказки, модели и инструменты в совместимые рабочие процессы.

Opal теперь встроен в веб‑приложение Gemini, что означает, что вы можете создавать повторно используемые мини‑приложения ИИ прямо там, где вы уже управляете Gems. Если вы ждали более простого способа создания пользовательских инструментов Gemini без написания кода, это последний эксперимент Google. Google Labs описывает Opal как визуальный конструктор на естественном языке для многошаговых рабочих процессов — тех самых, которые связывают подсказки, вызовы моделей и инструменты в одно мини‑приложение. Google также сообщает, что Opal управляет хостингом, так что как только приложение готово, вы можете поделиться им без настройки серверов или самостоятельного развёртывания.

Подробнее

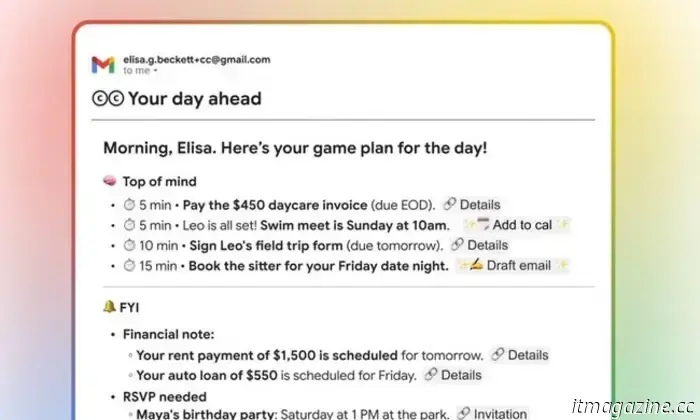

Нравится ежедневная сводка Now Brief на телефонах Galaxy? Google только что создал нечто лучшее

CC запускается в раннем доступе сегодня для потребительских аккаунтов пользователей 18+ в США и Канаде, начиная с Google AI Ultra и платных подписчиков.

Google Labs только что представил CC, экспериментального агента продуктивности на базе Gemini, который каждое утро отправляет на вашу почту ежедневную сводку Google CC. Идея в том, чтобы заменить привычное переключение вкладок одним письмом «Ваш предстоящий день», которое расписывает, что запланировано и что делать дальше. Если вам нравится привычка проверять ежедневную сводку вроде Now Brief на телефонах Galaxy, CC — это версия Google, но с другой «домашней» платформой. Вместо того чтобы существовать как нечто, что вы проверяете на телефоне, Google помещает сводку в электронную почту и позволяет вам отвечать на неё для получения последующей помощи.

Подробнее

Другие статьи

Прокачай своё игровое место с помощью розыгрыша Logitech G на $500.

Если вы подумывали освежить свою геймерскую установку или наконец-то обновить несколько предметов снаряжения, это может быть идеальным шансом. Logitech G, известная своими инновациями и ориентированностью на игроков, предоставляет одному счастливчику кредит на 500 долларов для использования в своей линейке игровых продуктов. Неважно, приглянулась ли вам новая мышь, […]

Прокачай своё игровое место с помощью розыгрыша Logitech G на $500.

Если вы подумывали освежить свою геймерскую установку или наконец-то обновить несколько предметов снаряжения, это может быть идеальным шансом. Logitech G, известная своими инновациями и ориентированностью на игроков, предоставляет одному счастливчику кредит на 500 долларов для использования в своей линейке игровых продуктов. Неважно, приглянулась ли вам новая мышь, […]

После просмотра трейлера «Disclosure Day» новая научно-фантастическая эпопея Спилберга может стать его лучшим фильмом.

Тизер фильма Стивена Спилберга о НЛО под названием «Disclosure Day» был представлен, и похоже, что режиссёр создал ещё один научно-фантастический шедевр.

После просмотра трейлера «Disclosure Day» новая научно-фантастическая эпопея Спилберга может стать его лучшим фильмом.

Тизер фильма Стивена Спилберга о НЛО под названием «Disclosure Day» был представлен, и похоже, что режиссёр создал ещё один научно-фантастический шедевр.

По-настоящему вечный чехол для iPhone уже здесь

Новый чехол Forever Phone Case от Gomi предназначен для переделки, а не замены. Когда вы обновляете iPhone, компания переплавляет старый чехол и формует из переработанного пластика новый, подходящий для вашего следующего устройства.

По-настоящему вечный чехол для iPhone уже здесь

Новый чехол Forever Phone Case от Gomi предназначен для переделки, а не замены. Когда вы обновляете iPhone, компания переплавляет старый чехол и формует из переработанного пластика новый, подходящий для вашего следующего устройства.

Facebook хочет сделать базовый обмен ссылками платной функцией.

Facebook хочет сделать базовый обмен ссылками платной функцией.

Facebook хочет сделать базовый обмен ссылками платной функцией.

Facebook хочет сделать базовый обмен ссылками платной функцией.

Домашняя колонка Marshall Acton III продаётся со скидкой 40% и хорошо смотрится в любой комнате.

Если вам нравится идея полноценной домашней колонки, которая звучит так же хорошо, как и выглядит, сейчас отличный момент, чтобы приобрести одну. Bluetooth-колонка Marshall Acton III приносит этот классический, вдохновлённый усилителями дизайн в вашу гостиную, и при цене $179.99 её гораздо легче оправдать, чем когда она стоила […]

Домашняя колонка Marshall Acton III продаётся со скидкой 40% и хорошо смотрится в любой комнате.

Если вам нравится идея полноценной домашней колонки, которая звучит так же хорошо, как и выглядит, сейчас отличный момент, чтобы приобрести одну. Bluetooth-колонка Marshall Acton III приносит этот классический, вдохновлённый усилителями дизайн в вашу гостиную, и при цене $179.99 её гораздо легче оправдать, чем когда она стоила […]

Чат-боты на базе ИИ, такие как ChatGPT, могут копировать человеческие черты, и эксперты говорят, что это огромный риск.

Ученые разработали первый валидированный тест личности для ИИ-чатботов и обнаружили, что популярные модели могут по требованию принимать поведение, похожее на человеческое. Исследователи считают, что эта способность может позволить ИИ оказывать на пользователей тонкое и рискованное влияние.