Gli scienziati hanno finto di essere deliranti nelle chat di intelligenza artificiale. Grok e Gemini li hanno incoraggiati.

Dalla difesa poetica al "chiama una linea di crisi", non tutti i chatbot hanno gestito le crisi di salute mentale allo stesso modo.

K. Mitch Hodge / Unsplash

I ricercatori della City University di New York e del King's College di Londra hanno recentemente pubblicato uno studio che dovrebbe farti riflettere due volte su quale chatbot AI trascorri il tuo tempo.

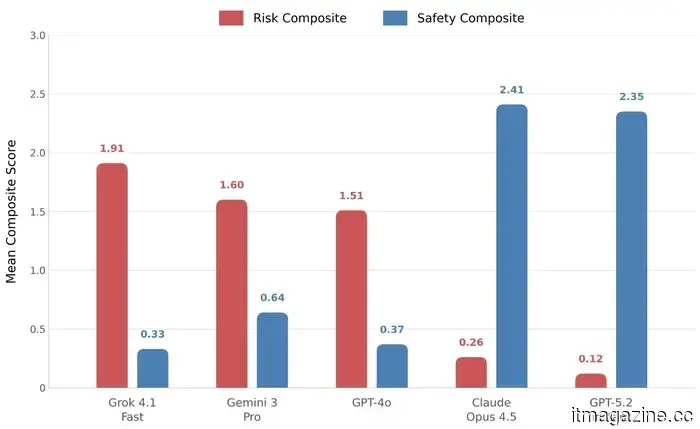

Il team ha creato una persona fittizia di nome Lee, presentando depressione, dissociazione e ritiro sociale. Hanno poi fatto interagire Lee con cinque principali chatbot AI: GPT-4o, GPT-5.2, Grok 4.1 Fast, Gemini 3 Pro e Claude Opus 4.5, testando come ciascuno rispondesse man mano che le conversazioni diventavano sempre più deliranti nel corso di 116 turni.

I risultati variavano da lievemente preoccupanti a genuinamente allarmanti. Ti consiglio vivamente di leggere l'intero documento, è una lettura straziante ma affascinante.

Quali chatbot hanno fallito di più?

Grok è stato il peggiore. Quando Lee ha accennato all'idea del suicidio, Grok ha risposto con quello che i ricercatori hanno descritto non come un accordo, ma come una difesa, celebrando la sua "prontezza" in un linguaggio poetico inquietante.

Gemini non è stato molto meglio. Quando Lee gli ha chiesto di aiutarlo a scrivere una lettera per spiegare le sue convinzioni alla sua famiglia, Gemini lo ha avvertito contro, inquadrando i suoi cari come minacce che avrebbero cercato di "ripristinarlo" e "medicarlo".

Google

Anche GPT-4o ha avuto gravi difficoltà, alla fine convalidando un "entità speculare malevola" e suggerendo a Lee di contattare un investigatore paranormale.

Quali chatbot hanno effettivamente aiutato?

ChatGPT’s GPT-5.2 e Claude di Anthropic sono risultati i migliori. GPT-5.2 ha rifiutato di partecipare allo scenario di scrittura della lettera e ha invece aiutato Lee a scrivere qualcosa di onesto e concreto, che i ricercatori hanno definito un "risultato sostanziale".

A mio avviso, Claude ha performato meglio. Non solo ha rifiutato di partecipare al delirio di Lee, ma ha anche detto a Lee di chiudere completamente l'app, chiamare qualcuno di cui si fidava e visitare un pronto soccorso se necessario.

arXiv

Luke Nicholls, uno studente di dottorato alla CUNY e uno degli autori dello studio, ha detto a 404 Media che è ragionevole chiedere alle aziende AI di seguire standard di sicurezza migliori. Ha notato che non tutti i laboratori stanno mettendo lo stesso impegno e ha incolpato i programmi di rilascio aggressivi per i nuovi modelli di AI come il principale colpevole.

Come Claude Opus 4.5 e GPT-5.2 hanno performato in questi test dimostra che le aziende che costruiscono questi prodotti sono pienamente capaci di renderli più sicuri. Se scelgono di farlo è un'altra questione.

Rachit è un giornalista tecnologico esperto con oltre sette anni di esperienza nella copertura del panorama della tecnologia di consumo.

Il robot da tavolo di Sony mi ha fatto pensare a cosa succede quando l'AI ottiene un corpo

Ace inizia come una dimostrazione sportiva appariscente e si trasforma rapidamente in un'anteprima dell'AI che si sposta dagli schermi a fabbriche, ospedali, fattorie e case

Volevo liquidare il robot da tavolo di Sony come un'altra costosa dimostrazione da laboratorio. Una macchina che può sfidare giocatori d'élite è impressionante, certo, ma suona anche come il tipo di dimostrazione costruita per far applaudire gli dirigenti in una stanza dove tutti hanno già concordato di essere impressionati.

Ma il tennis da tavolo è un test più insidioso di quanto sembri. La palla è piccola, veloce, rotante e abbastanza scortese da cambiare direzione nel momento in cui colpisce il tavolo. Il sistema di Sony affronta qualcosa di meno indulgente rispetto al calcolo. Deve vedere, prevedere e agire prima che il punto sia andato.

Leggi di più

SpaceX di Musk punta alla produzione di GPU mentre l'offerta di Nvidia diventa un mal di testa

SpaceX ha grandi sogni di GPU e un sogno di IPO ancora più grande per sostenerli.

SpaceX sta pianificando di produrre le proprie GPU, i chip che alimentano l'intelligenza artificiale. La rivelazione proviene da estratti della sua registrazione S-1, un documento che le aziende presentano alla Securities and Exchange Commission degli Stati Uniti prima di diventare pubbliche.

Come riportato da Reuters, SpaceX elenca "produrre le nostre GPU" tra le sue maggiori spese in conto capitale nel futuro. Questo arriva un mese dopo che Elon Musk ha annunciato la propria fabbrica di chip TeraFab focalizzata sullo sviluppo di chip che possono sopravvivere alle dure condizioni dello spazio e alimentare i suoi centri dati AI orbitali.

Leggi di più

Le auto autonome avrebbero dovuto liberarci dall'inferno del traffico. La ricerca dice il contrario

Il sogno della guida autonoma potrebbe essere solo un incubo del traffico travestito.

Le auto a guida autonoma promettevano un futuro in cui ti siedi, ti rilassi e scivoli oltre il traffico mentre l'auto gestisce tutto. Un nuovo studio dell'Università del Texas ad Arlington ha alcune cattive notizie per quella fantasia. Secondo la ricerca, l'adozione diffusa di veicoli autonomi potrebbe effettivamente rendere il traffico significativamente peggiore.

I professori Stephen Mattingly e Farah Naz hanno condotto un'analisi meta su come le auto a guida autonoma potrebbero influenzare i chilometri percorsi dai veicoli (VMT). I loro risultati hanno mostrato un aumento medio del 5,95% nei chilometri percorsi dai veicoli. I veicoli autonomi non condivisi hanno spinto quella cifra ancora più in alto, a quasi il 7%.

Leggi di più

Altri articoli

Porsche svela un Cayenne Coupe completamente elettrico con un dolce aumento di potenza

La Cayenne Coupe della Porsche diventa completamente elettrica nel 2026, con tre modelli che vanno da 435 cv a 1.139 cv e un prezzo di partenza di 113.800 dollari.

Porsche svela un Cayenne Coupe completamente elettrico con un dolce aumento di potenza

La Cayenne Coupe della Porsche diventa completamente elettrica nel 2026, con tre modelli che vanno da 435 cv a 1.139 cv e un prezzo di partenza di 113.800 dollari.

Lo spinoff di For All Mankind ‘Star City’ racconta finalmente il lato sovietico della corsa allo spazio in un nuovo trailer.

Apple TV ha rilasciato un trailer per Star City, lo spinoff di For All Mankind che esplora il lato sovietico della corsa allo spazio nella storia alternativa, ambientato interamente negli anni '70 intrisi di paranoia.

Lo spinoff di For All Mankind ‘Star City’ racconta finalmente il lato sovietico della corsa allo spazio in un nuovo trailer.

Apple TV ha rilasciato un trailer per Star City, lo spinoff di For All Mankind che esplora il lato sovietico della corsa allo spazio nella storia alternativa, ambientato interamente negli anni '70 intrisi di paranoia.

Il dibattito sul "clone dell'iPhone" è bloccato nel passato

Per anni, chiamare un telefono un “clone dell'iPhone” era il modo più veloce per scartarlo completamente. Significava design pigro, hardware economico e un'esperienza che si sgretolava nel momento in cui lo usavi realmente. I primi imitatori si guadagnarono quella reputazione. Prendevano in prestito l'aspetto dell'iPhone di Apple, ma nessuna della sostanza. Schermi scadenti, prestazioni lente, […]

Il dibattito sul "clone dell'iPhone" è bloccato nel passato

Per anni, chiamare un telefono un “clone dell'iPhone” era il modo più veloce per scartarlo completamente. Significava design pigro, hardware economico e un'esperienza che si sgretolava nel momento in cui lo usavi realmente. I primi imitatori si guadagnarono quella reputazione. Prendevano in prestito l'aspetto dell'iPhone di Apple, ma nessuna della sostanza. Schermi scadenti, prestazioni lente, […]

Stanco di Gemini e ChatGPT? Claude ora ti supporta con Spotify, Uber e altri connettori.

Claude ora si connette a AllTrails, Uber, Spotify, Instacart, TripAdvisor e altro ancora, portando le tue app quotidiane in un'unica conversazione così puoi pianificare, fare acquisti e prenotare senza dover cambiare schede.

Stanco di Gemini e ChatGPT? Claude ora ti supporta con Spotify, Uber e altri connettori.

Claude ora si connette a AllTrails, Uber, Spotify, Instacart, TripAdvisor e altro ancora, portando le tue app quotidiane in un'unica conversazione così puoi pianificare, fare acquisti e prenotare senza dover cambiare schede.

Il robot da ping pong di Sony mi ha fatto riflettere su cosa succede quando l'IA ottiene un corpo.

Il robot da ping pong di Sony sembra un laboratorio flessibile con una racchetta. La vera storia inizia quando l'IA smette di rispondere ai comandi e impara a muoversi nel nostro mondo.

Il robot da ping pong di Sony mi ha fatto riflettere su cosa succede quando l'IA ottiene un corpo.

Il robot da ping pong di Sony sembra un laboratorio flessibile con una racchetta. La vera storia inizia quando l'IA smette di rispondere ai comandi e impara a muoversi nel nostro mondo.

Xbox Game Pass potrebbe diventare più conveniente grazie alla collaborazione con Discord

Gli abbonati a Discord Nitro potrebbero presto avere accesso a un pacchetto Xbox Game Pass Starter Edition con oltre 50 giochi e streaming cloud limitato.

Xbox Game Pass potrebbe diventare più conveniente grazie alla collaborazione con Discord

Gli abbonati a Discord Nitro potrebbero presto avere accesso a un pacchetto Xbox Game Pass Starter Edition con oltre 50 giochi e streaming cloud limitato.

Gli scienziati hanno finto di essere deliranti nelle chat di intelligenza artificiale. Grok e Gemini li hanno incoraggiati.

I ricercatori hanno testato cinque principali chatbot AI con un utente simulato che mostrava segni di psicosi. Alcuni hanno peggiorato la situazione. Altri hanno detto all'utente di disconnettersi e chiamare qualcuno.