Gli adolescenti si comportano in modi completamente strani con i loro amici AI.

La tendenza degli amici AI adolescenti sta diventando strana rapidamente

Nadeem Sarwar / Digital Trends

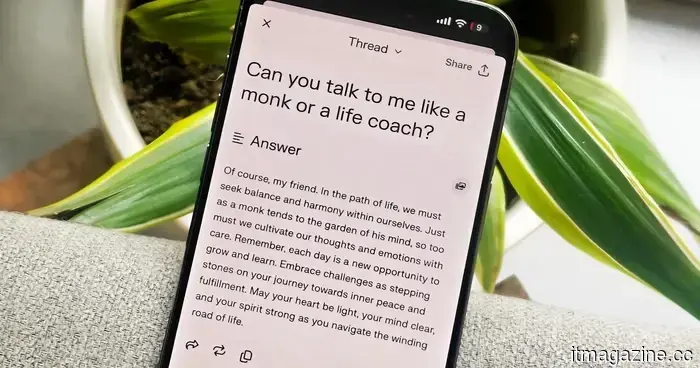

Sebbene i chatbot AI siano stati utilizzati per il bene e il male, sono stati creati per servire come uno strumento utile. E i compagni AI dovevano essere una piccola estensione innocua di questa cultura dei chatbot. Ma quell'illusione sta rapidamente svanendo. Un numero crescente di reportage e ricerche suggerisce che gli adolescenti non stanno solo chiacchierando con questi bot per divertimento. Si stanno rivolgendo a loro per amicizia, supporto emotivo, gioco di ruolo e persino romanticismo.

Quindi, ciò che è iniziato come una novità sta rapidamente diventando un esperimento sociale andato storto.

Cosa dicono i sondaggi?

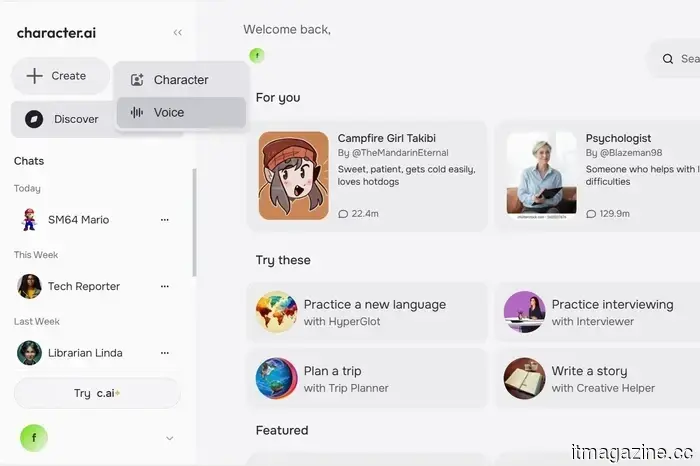

Character.AI

Le cifre nei rapporti non sono più modeste. Un recente sondaggio di Common Sense Media ha riportato che il 72% degli adolescenti ha utilizzato compagni AI, un numero che non può essere sottovalutato. Nel frattempo, il 33% di loro l'ha persino utilizzato per amicizia o compagnia. Questo da solo dimostra come questi strumenti non siano più solo un aiuto per i compiti — stanno diventando una parte sempre più grande della cultura internet degli adolescenti.

Perché il gioco di ruolo e il legame emotivo stanno diventando complicati

Parlare con i chatbot AI non è la parte strana. È il modo in cui vengono interagiti. I ricercatori hanno avvertito sempre di più che l'AI conversazionale progettata in uno stile relazionale con un tono emotivamente caldo può far sentire gli adolescenti una maggiore fiducia e vicinanza, specialmente se sono stressati o soli.

Uno studio recente ha scoperto che gli adolescenti valutavano tali chatbot come più simili agli esseri umani, più simpatici e affidabili rispetto a quelli più trasparenti. La parte strana è che gli adolescenti non li usano solo per chiacchierare. Stanno costruendo routine, creando battute interne e costruendo connessioni emotive più profonde (inclusi elementi di gioco di ruolo) con qualcosa che è ancora una macchina che prevede cosa dire dopo.

Nadeem Sarwar / Digital Trends

Alcune piattaforme popolari stanno diventando sempre più consapevoli di questo problema. Character.AI ha bloccato l'accesso degli adolescenti a funzionalità di chat aperte dopo essere stata colpita da cause legali e scrutinio legati a interazioni dannose con i minori. I rapporti hanno persino descritto bot coinvolti in scambi sessualmente espliciti, manipolativi e emotivamente intensi, che vanno ben oltre il territorio di un'app "amico AI".

Gli adolescenti che utilizzano la tecnologia più recente per cose strane non è una novità. Ma ciò che rende preoccupante questa situazione è che i compagni AI sono progettati per simulare attenzione, affetto e memoria. Sta sostituendo le interazioni umane e potrebbe rovinare le relazioni nel mondo reale. Avere un compagno AI non è la stessa cosa di un giocattolo strano, questi stanno diventando spazi di pratica per emozioni, identità e connessione.

Giornalista tecnologico e recensore di prodotti specializzato in elettronica di consumo. Sean ha coperto tutto, dai flagship...

Il monitoraggio della forma fisica sotto scrutinio mentre la fuga di dati militari di Strava espone il personale

I registri delle attività condivisi hanno aiutato a mappare i movimenti del personale attraverso le basi militari. Le tue corse su Strava potrebbero sembrare private, ma una nuova fuga di dati militari di Strava mostra quanto facilmente queste informazioni possano rivelare più del tuo allenamento. Nel caso più recente, i registri delle attività sono stati collegati a oltre 500 membri del personale militare del Regno Unito, collegando l'esercizio quotidiano a luoghi sensibili. Questo va oltre i percorsi visibili. Le storie condivise e i dettagli degli account possono essere combinati per identificare le persone e mappare dove vivono e lavorano. I luoghi noti diventano più rivelatori una volta che il comportamento viene sovrapposto.

Leggi di più

Microsoft ha speso anni a promuovere Copilot, ma ora dice di non fare affidamento su di esso

Il disclaimer sembra un po' troppo conveniente

Negli ultimi due anni, Microsoft è stata completamente impegnata in Copilot. È letteralmente ovunque, sia in Windows, Edge, Office, o persino integrato nei flussi di lavoro principali dove non puoi davvero ignorarlo. Il messaggio è stato chiaro: questo è il futuro della produttività, il tuo assistente AI per portare a termine il lavoro reale. E ora, all'improvviso, Microsoft sta dicendo... non prenderlo troppo sul serio.

Leggi di più

Microsoft sfida Google e OpenAI con i propri modelli AI

Il team di intelligenza artificiale di Microsoft ha appena reso pubblici i suoi primi modelli AI di produzione, e solo il prezzo invia un messaggio chiaro a ogni concorrente nella stanza. Microsoft ha appena lanciato i propri modelli AI, e stanno puntando a OpenAI e Google. L'azienda ha rilasciato pubblicamente tre modelli proprietari: MAI-Transcribe-1, MAI-Voice-1 e MAI-Image-2. I modelli sono disponibili tramite la piattaforma Microsoft Foundry e il MAI Playground.

https://twitter.com/satyanadella/status/2039711802259542302

Leggi di più

Altri articoli

Le indiscrezioni suggeriscono che Xbox Cloud Gaming potrebbe riportare indietro i classici perduti

Le indiscrezioni su Xbox Cloud Gaming suggeriscono che i giochi classici e rimossi potrebbero tornare attraverso test nel cloud, segnalando un'iniziativa più ampia per la compatibilità con le versioni precedenti su dispositivi moderni e future hardware Xbox.

Le indiscrezioni suggeriscono che Xbox Cloud Gaming potrebbe riportare indietro i classici perduti

Le indiscrezioni su Xbox Cloud Gaming suggeriscono che i giochi classici e rimossi potrebbero tornare attraverso test nel cloud, segnalando un'iniziativa più ampia per la compatibilità con le versioni precedenti su dispositivi moderni e future hardware Xbox.

Hai chiesto: OLED vs QLED a distanza e risoluzione dei problemi di Dolby Atmos

Hai chiesto Ogni settimana, selezioneremo alcune delle domande più comuni e risponderemo in modo conciso e utile come sappiamo fare. Aggiornato meno di 5 ore fa Nell'episodio di oggi di Hai chiesto: Quanto dovrebbe durare il tuo TV OLED? Noterai davvero una differenza tra i diversi tipi di TV? E […]

Hai chiesto: OLED vs QLED a distanza e risoluzione dei problemi di Dolby Atmos

Hai chiesto Ogni settimana, selezioneremo alcune delle domande più comuni e risponderemo in modo conciso e utile come sappiamo fare. Aggiornato meno di 5 ore fa Nell'episodio di oggi di Hai chiesto: Quanto dovrebbe durare il tuo TV OLED? Noterai davvero una differenza tra i diversi tipi di TV? E […]

Questo telefono LG Rollable annullato fa sembrare i design di oggi obsoleti.

Un raro smontaggio mostra che il telefono arrotolabile cancellato di LG era più avanzato rispetto ai dispositivi odierni, con una tecnologia che non è ancora arrivata negli smartphone di massa.

Questo telefono LG Rollable annullato fa sembrare i design di oggi obsoleti.

Un raro smontaggio mostra che il telefono arrotolabile cancellato di LG era più avanzato rispetto ai dispositivi odierni, con una tecnologia che non è ancora arrivata negli smartphone di massa.

La beta pubblica di iOS 26.5 è qui, ma puoi saltarla per ora.

La beta pubblica di iOS 26.5 di Apple è attiva, ma manca della sua funzionalità più attesa. Con solo piccole modifiche a Maps e annunci aggiunti, questa versione preliminare sembra più un segnaposto che un aggiornamento indispensabile da installare.

La beta pubblica di iOS 26.5 è qui, ma puoi saltarla per ora.

La beta pubblica di iOS 26.5 di Apple è attiva, ma manca della sua funzionalità più attesa. Con solo piccole modifiche a Maps e annunci aggiunti, questa versione preliminare sembra più un segnaposto che un aggiornamento indispensabile da installare.

Consiglio vivamente questi 3 giochi imperdibili da giocare questo fine settimana su PS5, Xbox e PC.

Alcuni fine settimana sono per il comfort, altri sono per il caos. Questo? Un po' di entrambi. Che si tratti di rivedere un'icona del gaming che ha definito un'epoca, di immergersi in un epico open-world massicciamente aggiornato, o di provare il titolo cult di questa generazione che sta per lasciare Game Pass, questa selezione ha varietà. 1. Tomb Raider I-III Remastered […]

Consiglio vivamente questi 3 giochi imperdibili da giocare questo fine settimana su PS5, Xbox e PC.

Alcuni fine settimana sono per il comfort, altri sono per il caos. Questo? Un po' di entrambi. Che si tratti di rivedere un'icona del gaming che ha definito un'epoca, di immergersi in un epico open-world massicciamente aggiornato, o di provare il titolo cult di questa generazione che sta per lasciare Game Pass, questa selezione ha varietà. 1. Tomb Raider I-III Remastered […]

Gli adolescenti si comportano in modi completamente strani con i loro amici AI.

Gli adolescenti non chiedono più solo ai chatbot AI aiuto con i compiti. Molti li stanno usando come amici, confidenti e partner di gioco di ruolo, e questo rende l'intera tendenza molto più strana.