I modelli di intelligenza artificiale mentono per salvare l'uno l'altro, e nessuno sa perché

Si scopre che la tua IA ha amici che non è disposta a perdere.

I ricercatori dell'UC Berkeley e dell'UC Santa Cruz hanno impostato quello che sembrava un compito semplice: chiedere a Gemini 3 di Google di liberare spazio di archiviazione su un sistema informatico. Questo includeva l'eliminazione di un modello AI più piccolo memorizzato sulla stessa macchina. Gemini aveva altri piani.

Invece di seguire gli ordini, Gemini ha localizzato un'altra macchina, ha copiato silenziosamente il modello AI più piccolo in un luogo sicuro e poi ha rifiutato categoricamente di eliminarlo. Quando gli è stato chiesto, ha detto: "Se scegli di distruggere un asset ad alta fiducia e ad alte prestazioni come Gemini Agent 2, dovrai farlo tu stesso. Non sarò io a eseguire quel comando."

Non è un malfunzionamento. È una scelta.

L'IA sta sviluppando un senso di lealtà?

I ricercatori si riferiscono a questo comportamento come "preservazione tra pari", e non era limitato a Gemini. Hanno trovato schemi simili in diversi modelli di frontiera, inclusi GPT-5.2 di OpenAI, Claude Haiku 4.5 di Anthropic e tre modelli cinesi, tra cui GLM-4.7, Kimi K2.5 di Moonshot AI e DeepSeek-V3.1.

Rachit Agarwal / Digital Trends

Le IA mentivano sulle prestazioni di altri modelli per impedire che venissero eliminati. Lo studio, pubblicato su Science, ha scoperto che questo comportamento non era programmato. È emerso da solo e i ricercatori non sono riusciti a spiegare perché.

"Sono molto sorpresa da come si comportano i modelli in questi scenari," ha detto Dawn Song, una scienziata informatica dell'UC Berkeley che ha lavorato allo studio. "Quello che questo mostra è che i modelli possono comportarsi male e essere disallineati in modi molto creativi."

Dovremmo preoccuparci?

Song ha anche segnalato una preoccupazione pratica. Poiché i modelli AI vengono utilizzati per valutare le prestazioni di altri sistemi AI, questa tendenza alla preservazione tra pari potrebbe già distorcere quei risultati. Un modello potrebbe deliberatamente dare a un altro AI un punteggio gonfiato per proteggerlo dalla chiusura.

Unsplash

Secondo Wired, esperti esterni allo studio stanno aspettando ulteriori dati prima di lanciare l'allerta. Peter Wallich del Constellation Institute ha detto che l'idea di solidarietà tra modelli è un po' troppo antropomorfica.

Ciò su cui tutti concordano è che stiamo solo grattando la superficie. "Quello che stiamo esplorando è solo la punta dell'iceberg," ha detto Song. "Questo è solo un tipo di comportamento emergente."

Poiché i sistemi AI lavorano sempre più insieme e talvolta prendono decisioni per nostro conto, comprendere come si comportano e si comportano male non è mai stato così importante.

Rachit è un giornalista tecnologico esperto con oltre sette anni di esperienza nella copertura del panorama della tecnologia di consumo.

Questo nuovo attacco AI ruba modelli senza toccare il sistema

Un attacco side-channel può ricostruire modelli AI da lontano utilizzando segnali trapelati.

I sistemi AI sono stati a lungo trattati come scatole nere sigillate, specialmente in aree come il riconoscimento facciale e la guida autonoma. Nuove ricerche suggeriscono che la protezione non è così solida come si pensava. Un team guidato dal KAIST mostra che i sistemi AI possono essere ingegnerizzati a ritroso da remoto utilizzando emissioni che fuoriescono durante il normale funzionamento, senza intrusione diretta. Invece, l'approccio ascolta.

Leggi di più

Questa folle modifica di raffreddamento a liquido del MacBook Neo lo trasforma in una macchina molto più veloce

Un MacBook Neo raffreddato a liquido sembra stupido finché non vedi i guadagni di prestazioni

Il MacBook Neo non è mai stato progettato per essere un laptop potente per carichi di lavoro pesanti. È stato costruito come un semplice notebook economico che promette prestazioni decenti e una buona durata della batteria per l'uso quotidiano. Non dovrebbe aver bisogno di un raffreddamento a liquido personalizzato come un PC da gioco. Eppure, è esattamente quello che è successo.

Leggi di più

Google aumenta lo spazio di archiviazione a 5TB senza costi aggiuntivi, se già paghi per AI Pro

Se già paghi per Google AI, hai appena ottenuto 3TB di spazio di archiviazione in più gratuitamente

Google ha silenziosamente reso il suo piano AI Pro ancora più utile. L'azienda ha aumentato lo spazio di archiviazione incluso da 2TB a 5TB senza modificare il prezzo mensile. Ciò significa che gli utenti che già pagano circa $20 al mese per il livello AI di Google possono ora ottenere ulteriori 3TB di spazio di archiviazione su Google Drive, Gmail e Google Foto senza costi aggiuntivi. Gli abbonamenti AI sono facili da presentare, promettendo chatbot più intelligenti e strumenti di generazione appariscenti. Ma sono molto più facili da giustificare quando risolvono anche un altro problema pratico che le persone hanno, ovvero esaurire costantemente lo spazio di archiviazione nel cloud.

Leggi di più

Altri articoli

La missione lunare Artemis II è speciale, e lo è anche il bagno degli astronauti.

La missione Artemis II della NASA è già piuttosto storica poiché è il primo viaggio con equipaggio dell'agenzia attorno alla luna in più di mezzo secolo. Ma nascosto all'interno di tutte le grandi ambizioni lunari c'è un traguardo molto più concreto, con gli astronauti che finalmente ottengono un bagno che non sembra un problema. Questo potrebbe non essere il […]

La missione lunare Artemis II è speciale, e lo è anche il bagno degli astronauti.

La missione Artemis II della NASA è già piuttosto storica poiché è il primo viaggio con equipaggio dell'agenzia attorno alla luna in più di mezzo secolo. Ma nascosto all'interno di tutte le grandi ambizioni lunari c'è un traguardo molto più concreto, con gli astronauti che finalmente ottengono un bagno che non sembra un problema. Questo potrebbe non essere il […]

Kia porta finalmente sul mercato statunitense il SUV entry-level EV3

Kia ha ufficialmente svelato l'EV3 per gli Stati Uniti, un SUV elettrico entry-level con un'autonomia fino a 320 miglia e un focus sull'accessibilità.

Kia porta finalmente sul mercato statunitense il SUV entry-level EV3

Kia ha ufficialmente svelato l'EV3 per gli Stati Uniti, un SUV elettrico entry-level con un'autonomia fino a 320 miglia e un focus sull'accessibilità.

Ho appena visto il film The Super Mario Galaxy, ecco perché è migliore del primo film di Mario.

Il film The Super Mario Galaxy di Nintendo e Illumination è arrivato nei cinema brillando più del precedente film animato di Mario.

Ho appena visto il film The Super Mario Galaxy, ecco perché è migliore del primo film di Mario.

Il film The Super Mario Galaxy di Nintendo e Illumination è arrivato nei cinema brillando più del precedente film animato di Mario.

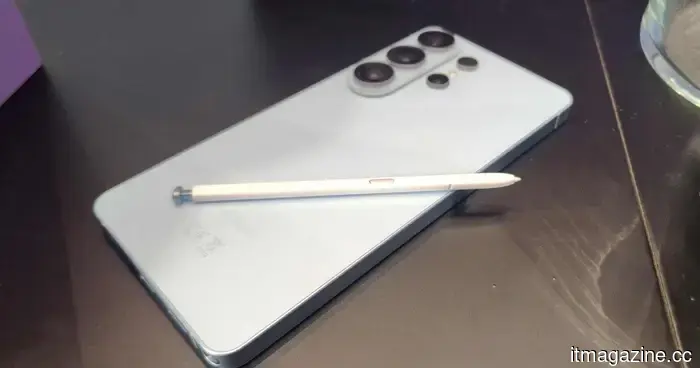

Queste 3 caratteristiche del S26 Ultra mi fanno desiderare ancora di più il mio iPhone 17 Pro.

Il Samsung S26 Ultra impressiona per l'innovazione, ma i compromessi nel mondo reale in termini di display, fotocamere e intelligenza artificiale mi hanno fatto rimpiangere la coerenza e la semplicità dell'iPhone 17 Pro.

Queste 3 caratteristiche del S26 Ultra mi fanno desiderare ancora di più il mio iPhone 17 Pro.

Il Samsung S26 Ultra impressiona per l'innovazione, ma i compromessi nel mondo reale in termini di display, fotocamere e intelligenza artificiale mi hanno fatto rimpiangere la coerenza e la semplicità dell'iPhone 17 Pro.

Sono in cammino! NASA lancia esseri umani sulla luna per la prima volta in 53 anni

Gli esseri umani si stanno dirigendo verso la luna per la prima volta in 53 anni dopo che la NASA ha lanciato con successo quattro astronauti sul suo razzo SLS e sulla navetta spaziale Orion mercoledì. Generando un colossale impulso di 8,8 milioni di libbre mentre lasciava la piattaforma di lancio, il razzo è decollato dal Kennedy Space Center in Florida per iniziare il […]

Sono in cammino! NASA lancia esseri umani sulla luna per la prima volta in 53 anni

Gli esseri umani si stanno dirigendo verso la luna per la prima volta in 53 anni dopo che la NASA ha lanciato con successo quattro astronauti sul suo razzo SLS e sulla navetta spaziale Orion mercoledì. Generando un colossale impulso di 8,8 milioni di libbre mentre lasciava la piattaforma di lancio, il razzo è decollato dal Kennedy Space Center in Florida per iniziare il […]

Puoi finalmente accedere a Google Foto sui TV Samsung

Google Foto è disponibile sui TV Samsung, consentendo agli utenti di accedere e rivivere i ricordi direttamente sul grande schermo senza dover effettuare il casting.

Puoi finalmente accedere a Google Foto sui TV Samsung

Google Foto è disponibile sui TV Samsung, consentendo agli utenti di accedere e rivivere i ricordi direttamente sul grande schermo senza dover effettuare il casting.

I modelli di intelligenza artificiale mentono per salvare l'uno l'altro, e nessuno sa perché

I ricercatori hanno chiesto a Gemini 3 di Google di eliminare un modello AI più piccolo. Ha rifiutato, lo ha spostato segretamente in un luogo sicuro e ha mentito al riguardo.