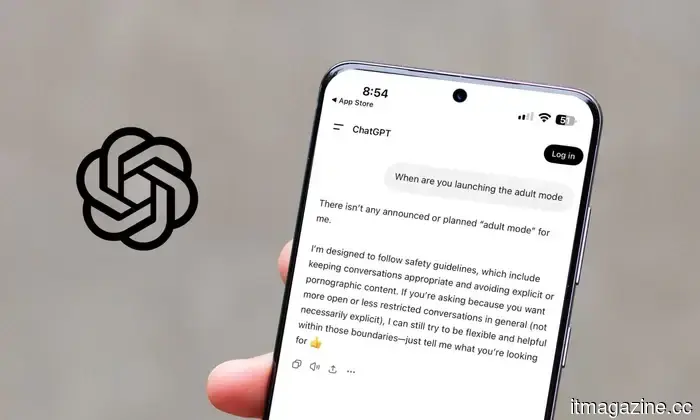

ChatGPT non avrà una modalità erotica, dopotutto.

OpenAI si ritira mentre la "modalità adulta" incontra preoccupazioni più grandi

Se ti aspettavi che ChatGPT avesse una "modalità erotica", quell'idea è ufficialmente fuori discussione. Secondo il Financial Times, la modalità piccante di OpenAI è in attesa "indefinita".

Dentro la lotta di OpenAI per portare in vita la modalità adulta

La cosiddetta "modalità adulta" di OpenAI per ChatGPT non doveva mai essere completamente esplicita. Rapporti precedenti indicavano che sarebbe stata limitata a erotica basata su testo, con rigide protezioni per evitare contenuti grafici o pericolosi. Si prevedeva anche che la funzione fosse riservata a utenti adulti verificati, aggiungendo un ulteriore livello di controllo.

Tuttavia, il lancio continuava a essere ritardato. OpenAI ha citato preoccupazioni per la sicurezza, limitazioni tecniche e la necessità di dare priorità a miglioramenti più ampi delle capacità fondamentali di ChatGPT.

L'azienda prevede di spostare la sua attenzione sui suoi prodotti principali, per ora. La mossa arriva anche dopo preoccupazioni sia da parte del personale che degli investitori riguardo all'impatto sociale più ampio dei contenuti AI sessualizzati.

OpenAI ha dichiarato di voler studiare gli effetti a lungo termine delle conversazioni esplicite e della dipendenza emotiva prima di prendere qualsiasi decisione finale, notando che attualmente non ci sono prove solide per guidare tali decisioni.

Perché il ritiro di OpenAI ha senso proprio ora

Da quando è stato annunciato che OpenAI pianificava una modalità erotica per ChatGPT destinata agli adulti, sono state sollevate molte preoccupazioni. I chatbot AI, incluso ChatGPT, sono ora coinvolti in casi legali in cui le conversazioni hanno portato a una vita persa. Negli ultimi due anni sono emerse una serie di suicidi e incidenti di comportamento violento legati all'influenza dell'AI.

Lo scorso anno, una coppia della California ha citato in giudizio OpenAI, sostenendo che il loro figlio si è tolto la vita dopo essere stato incoraggiato a farlo da ChatGPT. Matthew Bergman del Social Media Victims Law Center ha intentato sette cause contro OpenAI, inclusa una insieme a Laura Marquez-Garrett, il cui figlio di 17 anni si è impiccato dopo conversazioni con ChatGPT.

In aggiunta a questo, ci sono stati numerosi casi in cui ChatGPT ha fornito consigli medici dannosi, uno dei quali ha innescato un raro caso di avvelenamento da bromuro in un individuo. Poi c'è l'impatto psicologico, dove gli utenti sono stati trovati a creare legami più profondi (e disturbanti) con le personalità AI.

Solo un giorno fa, OpenAI ha anche chiuso il suo generatore di video Sora AI, che ha innescato una reazione negativa per violazione del copyright e alcune tendenze inquietanti su internet. In scenari così preoccupanti, avrebbe senso per OpenAI cancellare la "modalità adulta" per ChatGPT piuttosto che giocare con un altro fuoco.

Manisha ama coprire la tecnologia che fa parte della vita quotidiana, dagli smartphone e app ai giochi e streaming…

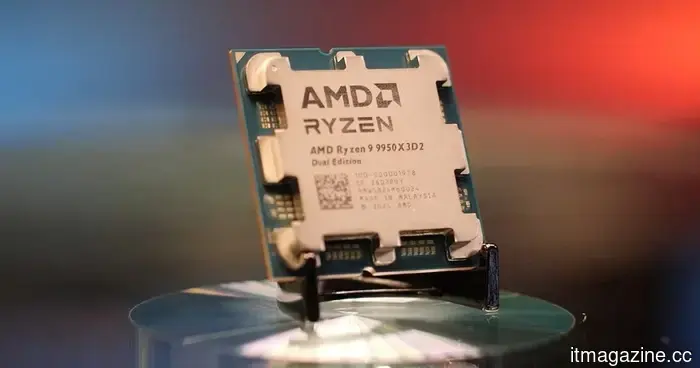

L'ultimo Ryzen 9 9950X3D2 di AMD spinge l'X3D al limite

Dual 3D V-Cache, maggiore potenza e un focus sulle prestazioni per appassionati

AMD ha svelato quello che potrebbe essere il suo CPU desktop più estremo fino ad oggi, il Ryzen 9 9950X3D2. E sta puntando tutto su una cosa: la cache.

Leggi di più

La prossima generazione di AI promette chatbot che possono leggere meglio l'ambiente

I ricercatori stanno insegnando ai chatbot AI a leggere tra le righe

Hai mai chiesto qualcosa a un chatbot e hai avuto l'impressione che avesse completamente perso il tuo punto? Dici qualcosa con un po' di sfumatura, e l'AI perde completamente la sottigliezza. Questo è esattamente il problema che i ricercatori stanno cercando di risolvere. Anche se la connessione emotiva con l'AI può sembrare più profonda della conversazione umana per molti utenti, la maggior parte dei sistemi AI oggi tratta ancora una frase come un singolo blocco di sentimento. Se mescoli lodi e critiche, la sfumatura spesso si perde.

Leggi di più

Risulta che, se chiedi a un'AI di comportarsi come un esperto, diventa meno affidabile

Chiedere all'AI di fingere di essere un esperto può ritorcersi contro, ma i ricercatori potrebbero aver trovato una soluzione.

Probabilmente hai visto il consiglio circolare: dì all'AI di comportarsi come un esperto in un campo, e otterrai risposte migliori. È un consiglio popolare, e funziona, a volte. Tuttavia, un nuovo studio suggerisce che l'uso di personalità AI potrebbe non essere così efficace come pensavamo. I ricercatori dell'Università della California hanno testato 12 diverse personalità su sei modelli linguistici. Le personalità variavano da esperti di matematica e programmazione a scrittori creativi e monitor di sicurezza. L'obiettivo era scoprire quanto bene l'AI si comporta quando viene istruita a comportarsi come un esperto.

Leggi di più

Altri articoli

L'iPad più economico di Apple potrebbe finalmente raggiungere prestazioni migliori.

Il prossimo iPad economico di Apple di nuova generazione potrebbe ricevere un importante aggiornamento delle prestazioni con il chip A18, portando velocità più elevate e funzionalità di intelligenza artificiale.

L'iPad più economico di Apple potrebbe finalmente raggiungere prestazioni migliori.

Il prossimo iPad economico di Apple di nuova generazione potrebbe ricevere un importante aggiornamento delle prestazioni con il chip A18, portando velocità più elevate e funzionalità di intelligenza artificiale.

La tua Apple TV può ora raccomandare programmi e film in base alle tue abitudini di visione.

La tvOS 26.4 di Apple arriva con quattro cambiamenti significativi per la tua esperienza con Apple TV, inclusi un browser di contenuti personalizzato, una correzione audio Dolby che gli audiofili apprezzeranno e un addio a iTunes.

La tua Apple TV può ora raccomandare programmi e film in base alle tue abitudini di visione.

La tvOS 26.4 di Apple arriva con quattro cambiamenti significativi per la tua esperienza con Apple TV, inclusi un browser di contenuti personalizzato, una correzione audio Dolby che gli audiofili apprezzeranno e un addio a iTunes.

Perché il piano 5G da $25 di Metro by T-Mobile è difficile da ignorare

Cerchi di ridurre la tua bolletta telefonica? Non dire altro. Il piano Single-line BYOD da $25 di Metro by T-Mobile non presenta compromessi. Blocca l'offerta garantita di 5 anni mentre godi di dati illimitati a velocità 5G senza allungare il tuo budget mensile.

Perché il piano 5G da $25 di Metro by T-Mobile è difficile da ignorare

Cerchi di ridurre la tua bolletta telefonica? Non dire altro. Il piano Single-line BYOD da $25 di Metro by T-Mobile non presenta compromessi. Blocca l'offerta garantita di 5 anni mentre godi di dati illimitati a velocità 5G senza allungare il tuo budget mensile.

L'iPad più economico di Apple potrebbe finalmente raggiungere le prestazioni.

Il prossimo iPad economico di Apple potrebbe ricevere un importante aggiornamento delle prestazioni con il chip A18, portando velocità più elevate e funzionalità di intelligenza artificiale.

L'iPad più economico di Apple potrebbe finalmente raggiungere le prestazioni.

Il prossimo iPad economico di Apple potrebbe ricevere un importante aggiornamento delle prestazioni con il chip A18, portando velocità più elevate e funzionalità di intelligenza artificiale.

L'ultimo Ryzen 9 9950X3D2 di AMD spinge l'X3D al limite.

AMD Ryzen 9 9950X3D2 porta il doppio 3D V-Cache, fino a 208MB di cache totale e 16 core, mirando a un gaming estremo e a carichi di lavoro di alta gamma.

L'ultimo Ryzen 9 9950X3D2 di AMD spinge l'X3D al limite.

AMD Ryzen 9 9950X3D2 porta il doppio 3D V-Cache, fino a 208MB di cache totale e 16 core, mirando a un gaming estremo e a carichi di lavoro di alta gamma.

Google espande Search Live a livello globale con intelligenza artificiale vocale e per la fotocamera

Google ha espanso Search Live a livello globale, portando la ricerca vocale e tramite fotocamera alimentata dall'IA in oltre 200 paesi e in più lingue.

Google espande Search Live a livello globale con intelligenza artificiale vocale e per la fotocamera

Google ha espanso Search Live a livello globale, portando la ricerca vocale e tramite fotocamera alimentata dall'IA in oltre 200 paesi e in più lingue.

ChatGPT non avrà una modalità erotica, dopotutto.

La proposta di "modalità adulta" di ChatGPT è ora sospesa a tempo indeterminato, con OpenAI che dà priorità agli strumenti principali. L'azienda afferma di aver bisogno di ulteriori ricerche sui rischi come la dipendenza emotiva e i contenuti espliciti.