ChatGPT Salute è arrivato

Ho detto questo molte volte: i prodotti che vediamo sul mercato sono raramente salti visionari. La maggior parte delle volte, sono specchi. Riflettono le abitudini delle persone, le scorciatoie, le paure e i piccoli comportamenti quotidiani. Il design segue il comportamento. Lo ha sempre fatto.

Pensaci. Probabilmente conosci almeno una persona che già usa ChatGPT per domande relative alla salute. Non occasionalmente. Regolarmente. Come secondo parere. Come un luogo per testare preoccupazioni prima di dirle ad alta voce. A volte anche come un terapeuta, un confidente, o uno spazio dove l'imbarazzo non esiste.

Quando le abitudini diventano consistenti, le aziende smettono di osservare e iniziano a costruire. A quel punto, gli utenti non sono più solo clienti. Sono co-architetti. Il loro comportamento plasma silenziosamente la roadmap del prodotto.

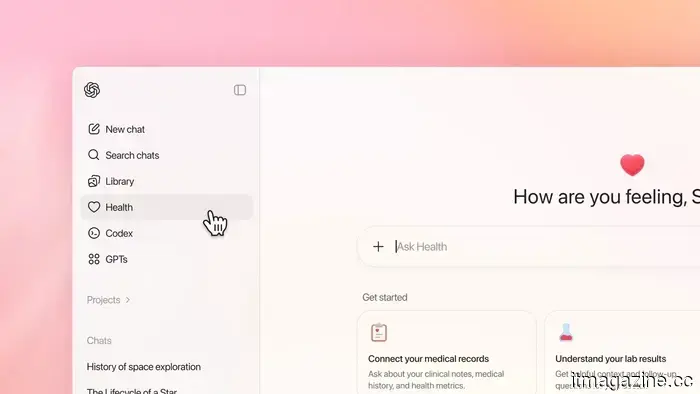

Quel contesto è importante quando si guarda a ciò che OpenAI ha annunciato il 7 gennaio 2026: il lancio di ChatGPT Health, un'esperienza dedicata alimentata dall'IA focalizzata sulla salute. OpenAI la descrive come “un'esperienza dedicata che porta in modo sicuro insieme le tue informazioni sanitarie e l'intelligenza di ChatGPT.”

Immagine: OpenAI

L'accesso è limitato per ora. L'azienda lo sta distribuendo attraverso una lista d'attesa, con un'espansione graduale pianificata nelle prossime settimane. Chiunque abbia un account ChatGPT, gratuito o a pagamento, può iscriversi per l'accesso anticipato, tranne gli utenti nell'Unione Europea, nel Regno Unito e in Svizzera, dove l'allineamento normativo è ancora in attesa.

L'obiettivo dichiarato è semplice sulla carta: aiutare le persone a sentirsi più informate, più preparate e più sicure nella gestione della propria salute. Ma i numeri dietro quella decisione dicono più di quanto il linguaggio della stampa possa mai fare. Secondo OpenAI, oltre 230 milioni di persone in tutto il mondo già pongono domande sulla salute o sul benessere a ChatGPT ogni settimana.

Quella cifra solleva domande scomode.

Perché così tante persone si rivolgono a un'IA per domande sulla salute? È la velocità? La promessa di una risposta immediata? Il modo in cui le nostre aspettative si sono spostate verso una chiarezza istantanea, anche per questioni complesse o sensibili? È il disagio, la riluttanza a parlare apertamente con un medico su determinati argomenti? O qualcosa di più profondo, un'erosione silenziosa della fiducia nei sistemi umani, abbinata a una crescente fiducia nelle macchine che non giudicano, non interrompono e non affrettano?

ChatGPT Health non risponde a queste domande. Semplicemente formalizza il comportamento.

Secondo OpenAI, il nuovo spazio Salute consente agli utenti di connettere in modo sicuro i dati personali sulla salute, inclusi i referti medici, i risultati di laboratorio e le informazioni provenienti da app di fitness o benessere. Qualcuno potrebbe caricare i risultati recenti di un esame del sangue e chiedere un riassunto. Un altro potrebbe collegare un contapassi e chiedere come la propria attività si confronta con i mesi precedenti.

Il sistema può integrare dati provenienti da piattaforme come Apple Health, MyFitnessPal, Peloton, AllTrails e persino dati alimentari da Instacart. La promessa è risposte contestualizzate, non consigli generici. Risultati di laboratorio spiegati in linguaggio semplice. Schemi evidenziati nel tempo. Suggerimenti per domande da porre durante un appuntamento medico. Idee per diete o esercizi basate su ciò che i dati mostrano realmente.

Ciò che ChatGPT Health è attento a non fare è altrettanto importante di ciò che può fare.

OpenAI è esplicita: questo non è un consiglio medico. Non diagnostica condizioni. Non prescrive trattamenti. È progettato per supportare la cura, non per sostituirla. Il quadro è intenzionale. ChatGPT Health si posiziona come un assistente, non come un'autorità. Uno strumento per comprendere schemi e preparare conversazioni, non per prendere decisioni in isolamento.

Quella distinzione è cruciale. E, francamente, spero che gli utenti la prendano sul serio.

Dietro le quinte, OpenAI afferma che il sistema è stato sviluppato con una vasta supervisione medica. Negli ultimi due anni, oltre 260 medici di circa 60 paesi hanno esaminato le risposte e fornito feedback, contribuendo con oltre 600.000 punti di valutazione individuali. L'attenzione non era solo sull'accuratezza, ma anche sul tono, sulla chiarezza e su quando il sistema dovrebbe chiaramente incoraggiare gli utenti a cercare assistenza professionale.

Per supportare quel processo, OpenAI ha costruito un framework di valutazione interno chiamato HealthBench. Valuta le risposte in base a standard definiti dai clinici, inclusi sicurezza, correttezza medica e appropriatezza delle indicazioni. È un tentativo di portare struttura in un dominio dove le sfumature contano e gli errori hanno peso.

La privacy è un altro pilastro su cui OpenAI insiste nel sottolineare. ChatGPT Health opera in un ambiente separato e isolato all'interno dell'app. Le conversazioni relative alla salute, le fonti di dati connesse e i file caricati sono mantenuti completamente separati dalle chat normali. I dati sulla salute non fluiscono nella memoria generale di ChatGPT e le conversazioni in questo spazio sono criptate.

OpenAI afferma anche che le conversazioni sulla salute non vengono utilizzate per addestrare i suoi modelli principali. Se quella garanzia sarà sufficiente per tutti gli utenti rimane da vedere, ma la separazione architettonica segnala una consapevolezza di quanto sia sensibile questo territorio.

Negli Stati Uniti, il sistema fa un passo ulteriore. Attraverso una partnership con b.well Connected Health, ChatGPT Health può accedere a veri e propri registri elettronici della salute da migliaia di fornitori, con il permesso dell'utente. Questo consente di riassumere referti di laboratorio ufficiali o condensare lunghe storie mediche in panoramiche leggibili. Al di fuori degli Stati Uniti, la funzionalità è più limitata, principalmente a causa di differenze normative.

Ci sono anche potenziali effetti a valle per i fornitori di assistenza sanitaria. Se i pazienti arrivano agli appuntamenti già familiari con i propri dati, già consapevoli delle tendenze, già preparati con domande mirate, le consultazioni potrebbero diventare più efficienti. Meno tempo a decifrare numeri. Più tempo a discutere decisioni.

E inevitabilmente, la domanda emerge: i medici dovrebbero preoccuparsi?

No. Non seriamente.

L'IA non è un professionista medico. Non esamina i pazienti. Non porta responsabilità legale. Non può sostituire il giudizio clinico, l'esperienza o la responsabilità. ChatGPT Health non cambia questo. Non è una scorciatoia per l'auto-diagnosi, e non dovrebbe essere trattata come tale.

Ciò che cambia è il punto di partenza della conversazione.

Usato responsabilmente, ChatGPT Health può aiutare le persone a interagire con le proprie informazioni sulla salute invece di evitarle. Se usato in modo improprio, potrebbe rafforzare una falsa certezza o ritardare cure necessarie. La responsabilità, come sempre, è condivisa tra lo strumento e la persona che lo utilizza.

Gli utenti dovrebbero rimanere consapevoli delle implicazioni sulla privacy, cercare consigli professionali quando è importante e trattare le indicazioni dell'IA come un input tra molti, non come una risposta finale.

Una cosa è chiara, però. Il 2026 non è arrivato silenziosamente.

Altri articoli

ChatGPT Salute è arrivato

OpenAI lancia ChatGPT Health, una nuova funzione che collega i dati personali sulla salute con le intuizioni dell'IA, per consentire agli utenti di comprendere la propria salute.