Si scopre che non è così difficile fare quello che fa OpenAI a un prezzo inferiore

OpenAI Anche se OpenAI continua a sostenere che l'unica strada per l'AGI è rappresentata da ingenti spese finanziarie ed energetiche, ricercatori indipendenti stanno sfruttando le tecnologie open-source per eguagliare le prestazioni dei suoi modelli più potenti - e lo fanno a una frazione del prezzo. Venerdì scorso, un team unificato dell'Università di Stanford e dell'Università di Washington ha annunciato di aver addestrato un modello linguistico di grandi dimensioni incentrato sulla matematica e sulla codifica che ha prestazioni pari a quelle dei modelli di ragionamento o1 di OpenAI e R1 di DeepSeek. La sua realizzazione è costata solo 50 dollari in crediti di calcolo nel cloud. Secondo quanto riferito, il team ha utilizzato un modello di base già pronto, per poi distillare il modello Gemini 2.0 Flash Thinking Experimental di Google. Il processo di distillazione delle Intelligenze Artificiali consiste nell'estrarre le informazioni rilevanti per completare un compito specifico da un modello di Intelligenza Artificiale più grande e trasferirle a uno più piccolo. Inoltre, martedì i ricercatori di Hugging Face hanno rilasciato un concorrente degli strumenti Deep Research di OpenAI e Google Gemini (anch'esso), denominato Open Deep Research, che hanno sviluppato in sole 24 ore. "Mentre i potenti LLM sono ora liberamente disponibili in open-source, OpenAI non ha rivelato molto sul framework agenziale alla base di Deep Research", ha scritto Hugging Face nel suo post di annuncio. "Così abbiamo deciso di imbarcarci in una missione di 24 ore per riprodurre i loro risultati e rendere open-source il framework necessario" Il modello di Hugging Face ha ottenuto una precisione del 55% nel benchmark General AI Assistants (GAIA), utilizzato per testare le capacità dei sistemi di intelligenza artificiale agici. In confronto, Deep Research di OpenAI ha ottenuto un'accuratezza compresa tra il 67 e il 73%, a seconda delle metodologie di risposta. Certo, il modello di 24 ore non ha le stesse prestazioni dell'offerta di OpenAI, ma non ha nemmeno richiesto miliardi di dollari e la capacità di generazione di energia di una nazione europea di medie dimensioni per essere addestrato. Questi sforzi seguono la notizia di gennaio secondo cui un team dello Sky Computing Lab dell'Università della California, Berkeley, è riuscito ad addestrare il proprio modello di ragionamento Sky T1 con circa 450 dollari di crediti di calcolo cloud. Il modello Sky-T1-32B-Preview del team si è dimostrato all'altezza del modello di ragionamento o1-preview rilasciato all'inizio. Mentre emergono altri concorrenti open-source al dominio di OpenAI, la loro semplice esistenza mette in dubbio che il piano dell'azienda di spendere mezzo trilione di dollari per costruire centri dati AI e impianti di produzione di energia sia davvero la risposta. Andrew Tarantola è un giornalista che da oltre un decennio si occupa di tecnologie emergenti, dalla robotica alle macchine... I chatbot vanno a Washington con ChatGPT Gov In un post di lunedì scorso, commentando l'improvviso successo di DeepSeek, l'amministratore delegato di OpenAI Sam Altman ha promesso di "tirare su qualche release" e sembra che l'abbia fatto. Martedì OpenAI ha presentato il suo ultimo prodotto, una "versione personalizzata di ChatGPT progettata per fornire alle agenzie governative statunitensi un ulteriore modo di accedere ai modelli di frontiera di OpenAI", si legge nel post di annuncio. Secondo quanto riferito, ChatGPT Gov offrirà misure di sicurezza dei dati ancora più rigide rispetto a ChatGPT Enterprise, ma come gestirà le allucinazioni che affliggono gli altri modelli dell'azienda? Secondo OpenAI, più di 90.000 dipendenti federali, statali e locali di 3.500 agenzie hanno interrogato ChatGPT più di 18 milioni di volte dall'inizio del 2024. La nuova piattaforma consentirà alle agenzie governative di inserire "informazioni sensibili non pubbliche" in ChatGPT mentre viene eseguito all'interno dei loro ambienti di hosting sicuri - in particolare, il cloud commerciale Microsoft Azure o il cloud comunitario Azure Government - e dei framework di cybersecurity come IL5 o CJIS. Questo permette a ogni agenzia di "gestire i propri requisiti di sicurezza, privacy e conformità", ha dichiarato Felipe Millon, responsabile delle vendite governative di OpenAI, durante la conferenza stampa di martedì. Continua a leggere Microsoft ha già messo il suo mirino legale su DeepSeek L'interfaccia di chat della home page di DeepSeek AI. Nadeem Sarwar / Digital Trends Microsoft, uno dei principali investitori di OpenAI, sta ora valutando se l'azienda cinese DeepSeek abbia utilizzato metodi nefasti per addestrare i suoi modelli di ragionamento. Secondo Bloomberg Law, l'azienda ritiene che DeepSeek abbia violato i suoi termini di servizio utilizzando la sua interfaccia di programmazione delle applicazioni (API) per addestrare il suo modello R1, annunciato di recente. Leggi tutto Come DeepSeek ha sconvolto il mondo della tecnologia durante la notte DeepSeek, il chatbot realizzato da una startup cinese che sembra aver detronizzato ChatGPT, sta conquistando il mondo. Attualmente è l'argomento numero uno in tutte le notizie e nelle ultime 24 ore sono successe molte cose. Tra le altre cose, le azioni di Nvidia sono crollate in risposta a DeepSeek; il presidente Donald Trump ha commentato la nuova IA; Mark Zuckerberg sta mettendo insieme un team per trovare una risposta a DeepSeek. Di seguito, vi illustreremo tutte le ultime notizie che dovete sapere su DeepSeek. Nvidia viene colpita dall'ascesa di DeepSeek Sebbene ChatGPT sia il chatbot che ha perso rapidamente il suo status di beniamino del pubblico con l'ascesa di DeepSeek, Nvidia è l'azienda che ha subito le perdite maggiori. Infatti, secondo Forbes, la perdita di mercato di Nvidia in seguito al lancio del modello linguistico di grandi dimensioni (LLM) di DeepSeek segna il più grande calo borsistico di un giorno nella storia. Nvidia ha perso quasi 600 miliardi di dollari in seguito alla rivelazione da parte dell'azienda cinese che sta dietro a DeepSeek di quanto sia economico sviluppare il nuovo LLM rispetto ai rivali di Anthropic, Meta o OpenAI. Per saperne di più

Altri articoli

Questo televisore QLED da 85 pollici di Samsung è scontato di 2.250 dollari: perfetto per il Super Bowl LIX

Il televisore Samsung QNX1D Neo QLED 4K da 85 pollici è lo schermo perfetto per guardare il Super Bowl LIX, soprattutto ora che è in vendita con un enorme sconto di 2.250 dollari.

Questo televisore QLED da 85 pollici di Samsung è scontato di 2.250 dollari: perfetto per il Super Bowl LIX

Il televisore Samsung QNX1D Neo QLED 4K da 85 pollici è lo schermo perfetto per guardare il Super Bowl LIX, soprattutto ora che è in vendita con un enorme sconto di 2.250 dollari.

L'UE sta dando un giro di vite sulle etichette nel menu Start di Windows 11

Microsoft apporta modifiche alla ricerca nel menu Start di Windows 11 per conformarsi alle normative dell'UE, ma c'è una fregatura in queste modifiche tanto attese.

L'UE sta dando un giro di vite sulle etichette nel menu Start di Windows 11

Microsoft apporta modifiche alla ricerca nel menu Start di Windows 11 per conformarsi alle normative dell'UE, ma c'è una fregatura in queste modifiche tanto attese.

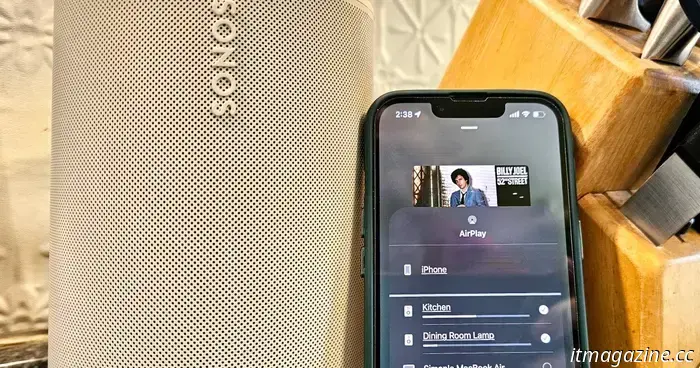

I problemi di Sonos continuano con il licenziamento di 200 dipendenti

I licenziamenti di Sonos sono l'emblema del suo anno negativo. Il tempo ci dirà se la ristrutturazione potrà aiutare l'azienda a ritrovare la sua direzione.

I problemi di Sonos continuano con il licenziamento di 200 dipendenti

I licenziamenti di Sonos sono l'emblema del suo anno negativo. Il tempo ci dirà se la ristrutturazione potrà aiutare l'azienda a ritrovare la sua direzione.

Il Bluetooth portatile da 100W di JBL è in sconto oggi

Concedete ai vostri ospiti del Super Bowl un audio al cardiopalma e brani celebrativi con il JBL Partybox Encore Essential.

Il Bluetooth portatile da 100W di JBL è in sconto oggi

Concedete ai vostri ospiti del Super Bowl un audio al cardiopalma e brani celebrativi con il JBL Partybox Encore Essential.

Le fotocamere dei telefoni sono così buone che hanno finalmente sostituito la mia macchina fotografica per il lavoro

Dopo un decennio trascorso a portarmi dietro una grossa macchina fotografica, ho deciso che ne avevo abbastanza. Ecco i dispositivi che mi hanno permesso di lasciarla a casa per lavoro!

Le fotocamere dei telefoni sono così buone che hanno finalmente sostituito la mia macchina fotografica per il lavoro

Dopo un decennio trascorso a portarmi dietro una grossa macchina fotografica, ho deciso che ne avevo abbastanza. Ecco i dispositivi che mi hanno permesso di lasciarla a casa per lavoro!

I pieghevoli Apple di grandi dimensioni potrebbero essere nella linea temporale immediata

Apple potrebbe utilizzare l'imminente iPhone pieghevole come banco di prova per il prossimo iPad/MacBook pieghevole.

I pieghevoli Apple di grandi dimensioni potrebbero essere nella linea temporale immediata

Apple potrebbe utilizzare l'imminente iPhone pieghevole come banco di prova per il prossimo iPad/MacBook pieghevole.

Si scopre che non è così difficile fare quello che fa OpenAI a un prezzo inferiore

Mentre Hugging Face ha clonato la Deep Research di OpenAI in 24 ore, un team di ricercatori multi-istituzionale ha costruito un concorrente di o1 per soli 50 dollari.