ChatGPT ahora te permite nombrar a alguien para que verifique si las cosas se ponen oscuras.

OpenAI está construyendo una red de seguridad humana en ChatGPT para momentos de crisis

Los chatbots de IA han hecho sorprendentemente fácil hablar sobre cualquier cosa, y eso incluye algunos de los temas más pesados que se puedan imaginar. Esa apertura siempre ha sido una espada de doble filo. OpenAI ahora está dando un paso para abordar eso, con una nueva función que trae a una persona de confianza al panorama cuando las cosas se ponen serias.

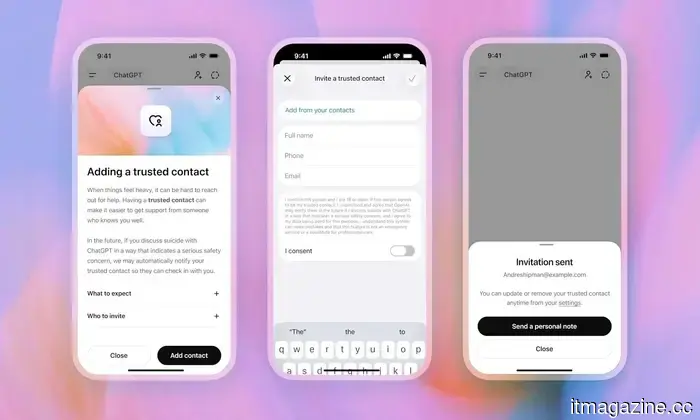

La compañía está implementando una nueva función llamada Contacto de Confianza, y está comenzando a aparecer en la configuración de ChatGPT para usuarios adultos. Permite a los usuarios nombrar a una persona que puede ser alertada si ChatGPT detecta una preocupación seria de autolesionarse.

OpenAI

¿Cómo funciona el Contacto de Confianza?

Configurar un Contacto de Confianza es opcional, pero si decides configurarlo, debes asegurarte de que la persona que estás nominando tenga al menos 18 años, o 19 en Corea del Sur. Una vez que nombras a alguien, recibe una invitación que explica lo que realmente significa el rol, y tiene una semana para aceptarlo antes de que la función se active. Si rechaza, puedes elegir a otra persona.

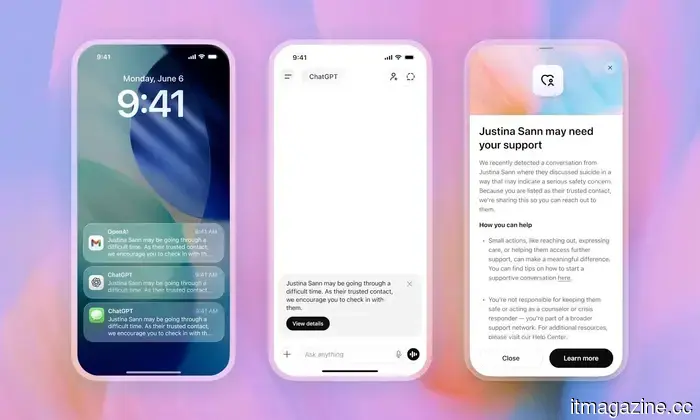

El sistema de alertas en sí no es automático. Si los sistemas de ChatGPT marcan una conversación como potencialmente preocupante, el chatbot primero le dice al usuario que su Contacto de Confianza puede ser notificado, y también le sugiere al usuario que se comunique directamente con algunas sugerencias de iniciadores de conversación. Un pequeño equipo de revisores humanos especialmente capacitados interviene para evaluar la situación. Solo si confirman un riesgo serio es cuando el contacto realmente recibe la notificación, ya sea por correo electrónico, mensaje de texto o notificación en la aplicación. La alerta no comparte transcripciones de chat ni detalles de la conversación. Simplemente dice que se mencionó la autolesión de una manera potencialmente preocupante y pide al contacto que verifique. OpenAI dice que su objetivo es completar esa revisión humana en menos de una hora.

OpenAI

¿Por qué OpenAI está agregando esto ahora?

El contacto de confianza es parte de un conjunto más amplio de funciones de seguridad en la plataforma. Anteriormente, OpenAI agregó funciones que permiten a los padres recibir alertas cuando una cuenta de adolescente vinculada muestra signos de angustia. El Contacto de Confianza es la extensión para adultos de esta misma función. Se informó que fue desarrollado con la participación de clínicos, investigadores y organizaciones de salud mental, incluida la Asociación Psicológica Americana.

Dicho esto, vale la pena mencionar que el Contacto de Confianza no reemplaza a las líneas de crisis, los servicios de emergencia o la atención profesional de salud mental. ChatGPT seguirá dirigiendo a los usuarios hacia esos recursos cuando sea necesario. Los usuarios pueden eliminar o cambiar su Contacto de Confianza en cualquier momento, y los contactos pueden eliminarse a sí mismos siempre que lo deseen.

La realidad es que ChatGPT se está utilizando para algunas conversaciones profundamente personales, ya sea que OpenAI lo haya planeado o no. Agregar una función como el Contacto de Confianza es un paso en la dirección correcta, y también una admisión de que un chatbot solo puede hacer tanto.

He tenido aproximadamente 4 años de experiencia, cubriendo principalmente videojuegos, hardware de PC y teléfonos inteligentes. En mi tiempo libre, me gusta…

Corea da la bienvenida a un monje budista robótico en un verdadero monasterio. Es una señal de lo que está por venir.

El budismo ha entrado en la era robótica con un monje llamado Gabi

Un robot humanoide se unió a una ceremonia budista en Seúl, y fue un espectáculo digno de ver. El robot, llamado Gabi, fue presentado en el Templo Jogyesa en el centro de Seúl durante una ceremonia celebrada antes de las celebraciones del cumpleaños de Buda. El robot de 1.3 metros de altura recibió el nombre Dharma "Gabi" durante una ceremonia especial de refugio realizada por la Orden Jogye del budismo coreano, la mayor orden budista de Corea del Sur.

Por qué un robot se convirtió en un verdadero monje en un verdadero templo

Lee más

Esta nueva actualización de voz de OpenAI hace que Siri y Alexa parezcan necesitar volver a la escuela

El traductor universal acaba de salir de la ciencia ficción y aterrizó en tu tienda de aplicaciones.

OpenAI ha lanzado tres nuevos modelos de audio en su API en tiempo real, y son un gran avance para cualquiera que esté construyendo aplicaciones impulsadas por voz. Los tres modelos son GPT-Realtime-2, GPT-Realtime-Translate y GPT-Realtime-Whisper.

Juntos, llevan la IA de voz más allá de simples respuestas de ida y vuelta hacia algo que puede entenderte, tomar acción y mantener una conversación real.

Lee más

El motor de respuestas de IA de Perplexity no llegará a Snapchat, después de todo

Perplexity ya no se está deslizando en los chats de Snapchat

La integración planificada de Perplexity en Snapchat ya no se llevará a cabo. Snap reveló en su carta a los inversores del primer trimestre de 2026 que ambas compañías "terminaron amistosamente la relación en el primer trimestre", poniendo fin a un acuerdo de efectivo y acciones de 400 millones de dólares anunciado el noviembre pasado.

El acuerdo habría llevado el motor de respuestas de IA de Perplexity directamente a la interfaz de chat de Snapchat. Los usuarios habrían podido hacer preguntas y obtener respuestas conversacionales respaldadas por fuentes sin salir de la aplicación. Snap había dicho anteriormente que la asociación comenzaría a contribuir a los ingresos en 2026, pero su última guía de ventas ahora asume que no habrá contribución de Perplexity.

Lee más

Otros artículos

Lime presenta archivos para la OPI de Nasdaq bajo el ticker LIME

Lime, el operador de micromovilidad respaldado por Uber, ha presentado una solicitud para una OPI en EE. UU. bajo el nombre corporativo Neutron Holdings. Goldman Sachs y JPMorgan lideran.

Lime presenta archivos para la OPI de Nasdaq bajo el ticker LIME

Lime, el operador de micromovilidad respaldado por Uber, ha presentado una solicitud para una OPI en EE. UU. bajo el nombre corporativo Neutron Holdings. Goldman Sachs y JPMorgan lideran.

El ordenador personal de Perplexity puede trabajar de forma autónoma en tu Mac, y ahora está disponible para todos.

La nueva aplicación de Mac de Perplexity lleva la Computadora Personal a tu escritorio, permitiendo que los agentes de IA trabajen a través de tus archivos locales, aplicaciones nativas y la web, para que tú no tengas que hacerlo.

El ordenador personal de Perplexity puede trabajar de forma autónoma en tu Mac, y ahora está disponible para todos.

La nueva aplicación de Mac de Perplexity lleva la Computadora Personal a tu escritorio, permitiendo que los agentes de IA trabajen a través de tus archivos locales, aplicaciones nativas y la web, para que tú no tengas que hacerlo.

NVIDIA toma un warrant de $2.1 mil millones en IREN como parte de un acuerdo de centro de datos de IA de 5GW

NVIDIA invertirá hasta $2.1 mil millones en el operador de centros de datos IREN a través de una opción de cinco años sobre 30 millones de acciones.

NVIDIA toma un warrant de $2.1 mil millones en IREN como parte de un acuerdo de centro de datos de IA de 5GW

NVIDIA invertirá hasta $2.1 mil millones en el operador de centros de datos IREN a través de una opción de cinco años sobre 30 millones de acciones.

OpenAI lanza GPT-Realtime-2 y dos nuevos modelos de API de voz

OpenAI lanzó tres nuevos modelos de voz, GPT-Realtime-2, GPT-Realtime-Translate y GPT-Realtime-Whisper.

OpenAI lanza GPT-Realtime-2 y dos nuevos modelos de API de voz

OpenAI lanzó tres nuevos modelos de voz, GPT-Realtime-2, GPT-Realtime-Translate y GPT-Realtime-Whisper.

Nintendo está aumentando el precio del Switch 2 en EE. UU., pero aún hay tiempo para conseguir uno por menos.

La Switch 2 de Nintendo aumentará $50 en los EE. UU. a partir del 1 de septiembre, uniéndose a Europa, Canadá y Japón en una revisión de precios general impulsada por los costos de RAM inflacionados por la IA.

Nintendo está aumentando el precio del Switch 2 en EE. UU., pero aún hay tiempo para conseguir uno por menos.

La Switch 2 de Nintendo aumentará $50 en los EE. UU. a partir del 1 de septiembre, uniéndose a Europa, Canadá y Japón en una revisión de precios general impulsada por los costos de RAM inflacionados por la IA.

El ordenador personal de Perplexity puede trabajar de forma autónoma en tu Mac, y ahora está disponible para todos.

La nueva aplicación de Mac de Perplexity lleva la Computadora Personal a tu escritorio, permitiendo que los agentes de IA trabajen a través de tus archivos locales, aplicaciones nativas y la web, para que tú no tengas que hacerlo.

El ordenador personal de Perplexity puede trabajar de forma autónoma en tu Mac, y ahora está disponible para todos.

La nueva aplicación de Mac de Perplexity lleva la Computadora Personal a tu escritorio, permitiendo que los agentes de IA trabajen a través de tus archivos locales, aplicaciones nativas y la web, para que tú no tengas que hacerlo.

ChatGPT ahora te permite nombrar a alguien para que verifique si las cosas se ponen oscuras.

ChatGPT ahora puede alertar a alguien en quien confías si las cosas se ponen serias. Es una función simple, pero podría ser una de las cosas más humanas que OpenAI ha incorporado a su chatbot.