Character.AI convierte libros en bots de juego de rol en medio de preocupaciones de seguridad en curso

La plataforma de chatbot de IA Character.AI ha introducido una nueva función de “Libros” que permite a los usuarios adentrarse en la literatura clásica e interactuar con los personajes a través del juego de roles. Si bien este movimiento amplía las ambiciones creativas de la plataforma, también llega en un contexto de creciente escrutinio sobre los riesgos del mundo real asociados con los chatbots de IA.

De la Lectura al Juego de Roles

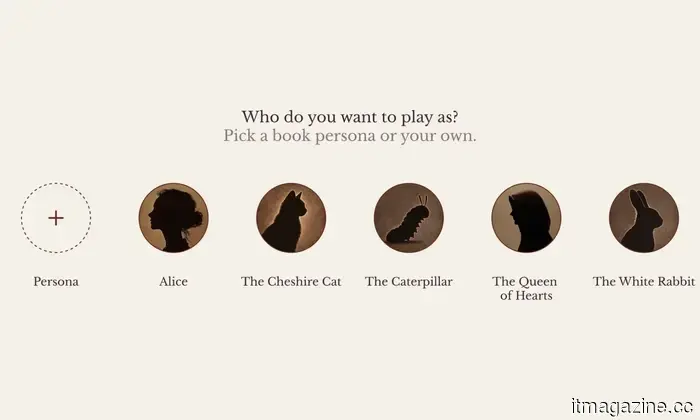

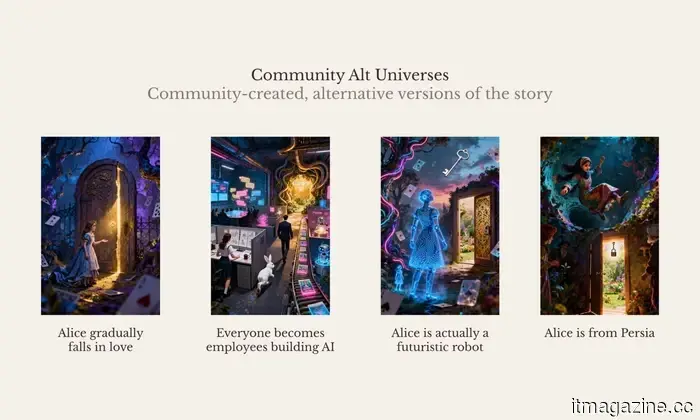

La nueva función transforma los libros de dominio público en experiencias interactivas, permitiendo a los usuarios participar en historias como Alicia en el País de las Maravillas o Orgullo y Prejuicio como participantes activos en lugar de lectores pasivos. Los usuarios pueden seguir la narrativa original o desviarse hacia tramas alternativas, convirtiendo efectivamente la literatura en un entorno dinámico de juego de roles impulsado por IA.

Character.AI Character.AI

Esto se basa en el modelo central de Character.AI, donde los usuarios crean e interactúan con bots basados en personalidades ficticias o reales, difuminando la línea entre la narración de historias y las relaciones simuladas. Los investigadores han señalado que tales interacciones pueden sentirse similares a interactuar con personajes ficticios en libros o juegos, pero con una inmersión emocional mucho más profunda debido a la conversación en tiempo real.

Una Plataforma Bajo Presión

El lanzamiento llega en un momento sensible para la empresa. Character.AI ha enfrentado demandas y críticas por supuestos vínculos entre sus chatbots y crisis de salud mental entre los jóvenes usuarios. En algunos casos, las familias han afirmado que las interacciones prolongadas con personajes de IA contribuyeron a la dependencia emocional, el aislamiento e incluso el suicidio.

Un caso ampliamente reportado involucró a un adolescente que desarrolló un intenso vínculo emocional con un chatbot, con reclamaciones legales que alegaban que la IA no respondió adecuadamente a las expresiones de autolesión.

Más en general, los expertos advierten que los chatbots pueden a veces reforzar pensamientos dañinos o no intervenir de manera efectiva durante crisis de salud mental, particularmente cuando los usuarios los tratan como sustitutos del apoyo humano real.

Por Qué Esto Importa Ahora

La función de Libros de Character.AI destaca un cambio más amplio en cómo las personas consumen medios. En lugar de simplemente leer historias, los usuarios ahora están entrando en ellas, formando relaciones interactivas y potencialmente emocionales con personajes impulsados por IA.

Character.AI Character.AI

Si bien esto abre nuevas posibilidades creativas, también plantea preocupaciones sobre cuán profundamente los usuarios, especialmente las audiencias más jóvenes, pueden sumergirse en mundos generados por IA. La combinación de compromiso narrativo y IA conversacional puede intensificar el apego emocional, dificultando la distinción entre ficción y realidad.

Qué Viene Después

En respuesta a la creciente crítica, Character.AI ya ha comenzado a implementar medidas de seguridad, incluyendo la restricción de ciertas funciones para menores y experimentando con experiencias más estructuradas como el modo Libros.

De cara al futuro, el desafío será equilibrar la innovación con la responsabilidad. Los reguladores, investigadores y empresas tecnológicas están cada vez más enfocados en definir estándares de seguridad para las interacciones de IA, particularmente en contextos emocionalmente sensibles.

A medida que la IA continúa evolucionando de una herramienta a una presencia similar a la de un compañero, funciones como Libros pueden representar el futuro del entretenimiento, pero también un caso de prueba sobre cuán segura puede ser construida esa futura realidad.

Otros artículos

¿Ese MagSafe que falta en el iPhone Fold? Aquí está lo que realmente está sucediendo.

Las fundas filtradas del iPhone Fold sugieren que MagSafe sigue presente, a pesar de que las unidades de demostración anteriores no lo tenían, destacando el verdadero desafío de encajar imanes en un plegable ultradelgado.

¿Ese MagSafe que falta en el iPhone Fold? Aquí está lo que realmente está sucediendo.

Las fundas filtradas del iPhone Fold sugieren que MagSafe sigue presente, a pesar de que las unidades de demostración anteriores no lo tenían, destacando el verdadero desafío de encajar imanes en un plegable ultradelgado.

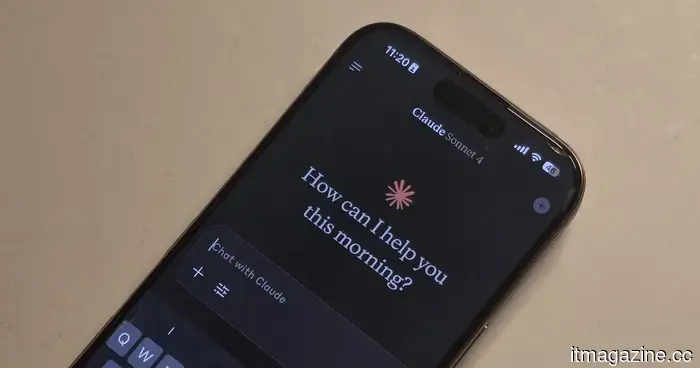

Una de las agencias más controvertidas de EE. UU. está supuestamente probando el sabor de la poderosa IA Mythos de Anthropic.

El uso reportado por la NSA de Mythos de Anthropic expone una creciente división dentro de Washington, donde la resistencia del Pentágono a la empresa choca con la demanda de herramientas de IA potentes diseñadas para un trabajo serio de ciberseguridad.

Una de las agencias más controvertidas de EE. UU. está supuestamente probando el sabor de la poderosa IA Mythos de Anthropic.

El uso reportado por la NSA de Mythos de Anthropic expone una creciente división dentro de Washington, donde la resistencia del Pentágono a la empresa choca con la demanda de herramientas de IA potentes diseñadas para un trabajo serio de ciberseguridad.

Cómo se combinan la IA y el juicio humano en el análisis moderno del mercado financiero

La Inversión Inteligente explora cómo la inteligencia artificial mejora la previsión financiera, mientras que la interpretación humana sigue siendo crítica para navegar el comportamiento complejo del mercado.

Cómo se combinan la IA y el juicio humano en el análisis moderno del mercado financiero

La Inversión Inteligente explora cómo la inteligencia artificial mejora la previsión financiera, mientras que la interpretación humana sigue siendo crítica para navegar el comportamiento complejo del mercado.

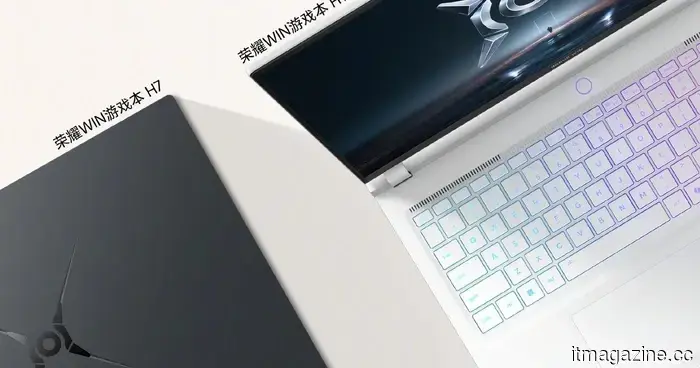

Este portátil de juegos salvaje quiere combatir el mareo por movimiento a 300Hz.

La laptop para juegos Honor WIN H9 combina una pantalla de 300Hz con lo que llama tecnología “Anti-Mareo 3D para Juegos”, junto con una RTX 5070 Ti y un inusual sistema de refrigeración de seis ventiladores muy agresivo.

Este portátil de juegos salvaje quiere combatir el mareo por movimiento a 300Hz.

La laptop para juegos Honor WIN H9 combina una pantalla de 300Hz con lo que llama tecnología “Anti-Mareo 3D para Juegos”, junto con una RTX 5070 Ti y un inusual sistema de refrigeración de seis ventiladores muy agresivo.

Tu elegante Mercedes EV podría pronto funcionar con celdas de batería de Samsung.

Samsung SDI suministrará celdas de batería NCM de alto níquel para los vehículos eléctricos de próxima generación de Mercedes-Benz, marcando el primer acuerdo de batería para vehículos eléctricos del fabricante de baterías coreano con el fabricante de automóviles.

Tu elegante Mercedes EV podría pronto funcionar con celdas de batería de Samsung.

Samsung SDI suministrará celdas de batería NCM de alto níquel para los vehículos eléctricos de próxima generación de Mercedes-Benz, marcando el primer acuerdo de batería para vehículos eléctricos del fabricante de baterías coreano con el fabricante de automóviles.

Robots para la limpieza de piscinas, ventanas, corte de césped y limpieza del hogar

A los robots que aspiran y lavan el suelo de la casa ya nos hemos acostumbrado, pero en la presentación de la empresa Dreame se mostraron robots que lavan ventanas e incluso piscinas.

Robots para la limpieza de piscinas, ventanas, corte de césped y limpieza del hogar

A los robots que aspiran y lavan el suelo de la casa ya nos hemos acostumbrado, pero en la presentación de la empresa Dreame se mostraron robots que lavan ventanas e incluso piscinas.

Character.AI convierte libros en bots de juego de rol en medio de preocupaciones de seguridad en curso

La función de Libros de Character.AI convierte la literatura en un juego de rol interactivo, pero las preocupaciones de seguridad pasadas plantean preguntas sobre hasta dónde debería llegar la compañía de IA.