Google, Microsoft e xAI concordano nel rilasciare in anteprima le valutazioni dei modelli di intelligenza artificiale del governo mentre la crisi di Mythos costringe a un'espansione della supervisione

TL;DRGoogle, Microsoft e xAI si sono uniti a OpenAI e Anthropic nel fornire al Dipartimento del Commercio degli Stati Uniti accesso anticipato per valutare i loro modelli di intelligenza artificiale, creando una supervisione volontaria di tutti e cinque i principali laboratori di intelligenza artificiale di frontiera attraverso un ufficio privo di autorità statutaria e con meno di 200 dipendenti. L'espansione è stata catalizzata dalla crisi di Mythos e da un potenziale ordine esecutivo che formalizzerebbe il processo di revisione.

La crisi di Mythos ha costretto il governo degli Stati Uniti a confrontarsi con una domanda che aveva evitato: cosa succede quando un modello di intelligenza artificiale è abbastanza potente da minacciare la sicurezza nazionale e il governo non ha un meccanismo formale per valutarlo prima che il pubblico ne abbia accesso? Martedì, il Dipartimento del Commercio ha annunciato che Google, Microsoft e xAI hanno accettato di fornire al governo degli Stati Uniti accesso anticipato ai loro modelli di intelligenza artificiale per la valutazione. Si uniscono a OpenAI e Anthropic, che hanno presentato modelli allo stesso ufficio dal 2024. Cinque aziende ora rappresentano la stragrande maggioranza dello sviluppo dell'intelligenza artificiale di frontiera a livello mondiale, e tutte e cinque hanno accettato di consentire a un unico ufficio governativo di testare i loro sistemi prima del dispiegamento. L'accordo è volontario, non ha una base statutaria e non conferisce al governo alcun potere di bloccare un rilascio. È anche la cosa più vicina che gli Stati Uniti abbiano a un sistema di supervisione dell'IA, ed è stato costruito in meno di due anni da un ufficio con meno di duecento dipendenti.

L'ufficio

Il Centro per gli Standard e l'Innovazione dell'IA si trova all'interno dell'Istituto Nazionale di Standard e Tecnologia del Dipartimento del Commercio. È stato istituito sotto il presidente Biden nel 2023 come Istituto per la Sicurezza dell'IA, ristrutturato sotto Trump con un nuovo nome e una riorientazione verso gli standard e la sicurezza nazionale piuttosto che la ricerca sulla sicurezza. Il centro ha completato più di 40 valutazioni di modelli di IA, inclusi sistemi all'avanguardia che non sono mai stati rilasciati al pubblico. Gli sviluppatori presentano frequentemente versioni con le protezioni di sicurezza rimosse in modo che i valutatori possano indagare sulle capacità rilevanti per la sicurezza nazionale: percorsi di sintesi di armi biologiche, automazione degli attacchi informatici e comportamenti di agenti autonomi che potrebbero essere difficili da controllare su larga scala.

Chris Fall ora dirige il centro, dopo l'improvvisa partenza di Collin Burns, un ex ricercatore di IA di Anthropic scelto per il ruolo ma allontanato dalla Casa Bianca dopo quattro giorni. Burns aveva lasciato Anthropic, rinunciato a preziose azioni e si era trasferito dall'altra parte del paese per assumere la posizione governativa. Il suo allontanamento, riportato come motivato dalla sua connessione con un'azienda con cui l'amministrazione stava combattendo attivamente, illustra la complessità politica di costruire un sistema di supervisione per un'industria in cui i valutatori e i valutati provengono dallo stesso bacino di talenti. L'approccio normativo più ampio di Trump per l'IA ha dato priorità alla preclusione federale della regolamentazione statale e a una postura di leggera supervisione nei confronti dell'industria, ma il programma di valutazione dei modelli rappresenta un approccio più rigoroso: il governo vuole vedere cosa possono fare questi sistemi prima che chiunque altro lo faccia.

Gli accordi

Le nuove partnership con Google, Microsoft e xAI espandono quello che era un accordo tra due aziende in qualcosa di più vicino a una copertura completa della frontiera. OpenAI e Anthropic hanno rinegoziato i loro accordi esistenti per allinearsi con il Piano d'Azione per l'IA di Trump, che incarica il centro di guidare le valutazioni dei modelli relative alla sicurezza nazionale e lo posiziona come parte di un più ampio "ecosistema di valutazioni". Gli accordi non sono contratti. Sono impegni volontari dai quali le aziende possono ritirarsi in qualsiasi momento. Nessuna legge richiede una valutazione anticipata. Nessuna regolamentazione conferisce al centro l'autorità di ritardare o bloccare il dispiegamento. L'intero sistema dipende dalle aziende di IA che decidono, per motivi strategici, che fornire al governo accesso anticipato è preferibile all'alternativa.

L'alternativa, dal punto di vista delle aziende, è la legislazione. Diversi disegni di legge darebbero al centro un'autorità statutaria permanente, requisiti di valutazione obbligatori e il potere di imporre condizioni sul dispiegamento. Il Pentagono ha già dimostrato disponibilità a mettere al bando le aziende di IA che rifiutano di conformarsi alle richieste del governo, designando Anthropic come rischio per la catena di approvvigionamento dopo che l'azienda ha rifiutato di consentire l'uso dei suoi modelli per armi autonome o sorveglianza domestica di massa. Gli accordi di valutazione volontaria sono, in parte, un modo per le aziende rimanenti di dimostrare cooperazione prima che la cooperazione diventi obbligatoria.

Il catalizzatore

L'espansione del programma di valutazione avviene sullo sfondo della crisi di Mythos. Il modello innovativo di Anthropic, annunciato ad aprile, può scoprire e sfruttare autonomamente vulnerabilità zero-day in ogni principale sistema operativo e browser web. Ha identificato migliaia di bug ad alta gravità, comprese vulnerabilità che esistevano da decenni senza essere rilevate. La Casa Bianca si è opposta al piano di Anthropic di espandere l'accesso a Mythos oltre il suo consorzio iniziale di partner di lancio. La NSA lo sta utilizzando nonostante la lista nera del Pentagono di Anthropic. L'UE sta richiedendo accesso a Mythos per la difesa informatica europea, sostenendo che lo strumento di cybersecurity più significativo esistente non può rimanere sotto il controllo esclusivo di un'azienda americana che il governo americano ha parzialmente messo al bando.

Mythos ha dimostrato cosa è progettato per catturare il programma di valutazione: un modello le cui capacità hanno implicazioni immediate per la sicurezza nazionale che non possono essere valutate dopo il dispiegamento. Le oltre 40 valutazioni del centro dal 2024 presumibilmente hanno identificato capacità in modelli non rilasciati che hanno informato decisioni politiche, ma quelle valutazioni sono avvenute sotto accordi con solo due aziende. I modelli di Google Gemini, Microsoft e Grok di xAI non erano soggetti a revisione governativa anticipata fino ad ora. I nuovi accordi colmano quella lacuna, garantendo che il prossimo modello con capacità a livello di Mythos, indipendentemente da quale laboratorio lo produca, raggiunga i valutatori governativi prima di raggiungere il pubblico.

I limiti

La debolezza strutturale del programma è evidente: dipende interamente dalla partecipazione volontaria. Un'azienda che scopre che il suo modello ha capacità pericolose potrebbe, legalmente, rifiutarsi di presentarlo per valutazione e rilasciarlo comunque. Il centro non ha potere di citazione, né autorità ingiuntiva, né meccanismo per costringere alla divulgazione. La sua leva è reputazionale e politica: le aziende che partecipano segnalano responsabilità, e le aziende che rifiutano invitano alla regolamentazione. Ma quella leva presuppone che il governo possa minacciare credibilmente la legislazione, e la preferenza dichiarata dell'attuale amministrazione per una regolamentazione leggera indebolisce quella minaccia.

I ministri delle finanze dell'area euro hanno discusso di Mythos di Anthropic come una preoccupazione per la stabilità finanziaria, riconoscendo che uno strumento di cybersecurity capace di scoprire vulnerabilità nell'infrastruttura bancaria ha implicazioni oltre la sicurezza nazionale tradizionale. La dimensione internazionale aggiunge pressione: se il governo degli Stati Uniti non può dimostrare di avere supervisione sui modelli di IA di frontiera sviluppati sul suo suolo, altri governi imporranno i propri requisiti, frammentando il mercato globale dell'IA e creando costi di conformità che le aziende vogliono evitare. Il programma di valutazione volontaria è, in questa lettura, non supervisione ma una profilassi contro la supervisione: prova che l'industria sta cooperando, offerta in cambio della continua libertà di autogovernarsi.

La

Other articles

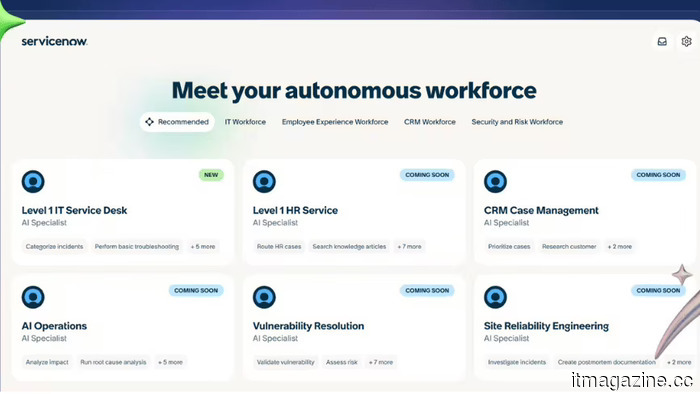

ServiceNow prevede 30 miliardi di dollari entro il 2030, con un terzo dell'ACV proveniente dall'IA.

ServiceNow prevede 30 miliardi di dollari di entrate da abbonamenti nel 2030, con il 30% di tale ACV proveniente da Now Assist, l'offerta principale di intelligenza artificiale dell'azienda. La presentazione del giorno per gli investitori è una risposta strutturale alle preoccupazioni sullo spostamento dell'AI-SaaS.

ServiceNow prevede 30 miliardi di dollari entro il 2030, con un terzo dell'ACV proveniente dall'IA.

ServiceNow prevede 30 miliardi di dollari di entrate da abbonamenti nel 2030, con il 30% di tale ACV proveniente da Now Assist, l'offerta principale di intelligenza artificiale dell'azienda. La presentazione del giorno per gli investitori è una risposta strutturale alle preoccupazioni sullo spostamento dell'AI-SaaS.

Fervo Energy lancia un'IPO da 1,33 miliardi di dollari, la più grande quotazione di tecnologia climatica del 2026.

Fervo Energy ha lanciato il suo roadshow per l'IPO mirato a raccogliere fino a 1,33 miliardi di dollari a un prezzo di 21-24 dollari per azione, in una quotazione Nasdaq posizionata come veicolo climate-tech per il commercio delle infrastrutture AI.

Fervo Energy lancia un'IPO da 1,33 miliardi di dollari, la più grande quotazione di tecnologia climatica del 2026.

Fervo Energy ha lanciato il suo roadshow per l'IPO mirato a raccogliere fino a 1,33 miliardi di dollari a un prezzo di 21-24 dollari per azione, in una quotazione Nasdaq posizionata come veicolo climate-tech per il commercio delle infrastrutture AI.

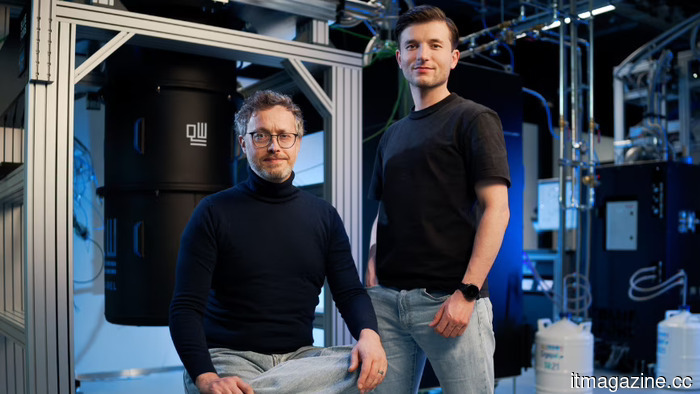

Dentro il round da 152 milioni di euro di QuantWare per costruire KiloFab

QuantWare ha chiuso un round di Serie B da 152 milioni di euro guidato da Intel Capital, In-Q-Tel e ETF Partners, il più grande round deeptech olandese di sempre.

Dentro il round da 152 milioni di euro di QuantWare per costruire KiloFab

QuantWare ha chiuso un round di Serie B da 152 milioni di euro guidato da Intel Capital, In-Q-Tel e ETF Partners, il più grande round deeptech olandese di sempre.

I fondatori di IronSource raccolgono 60 milioni di dollari con una valutazione di 500 milioni di dollari per Zyg, una piattaforma di intelligenza artificiale agentica che automatizza la pubblicità nell'e-commerce.

Zyg ha raccolto 60 milioni di dollari guidati da Accel con una valutazione di 500 milioni di dollari due mesi dopo il lancio in incognito. Il team di IronSource sta costruendo agenti AI che sostituiscono gli acquirenti pubblicitari umani per i marchi DTC.

I fondatori di IronSource raccolgono 60 milioni di dollari con una valutazione di 500 milioni di dollari per Zyg, una piattaforma di intelligenza artificiale agentica che automatizza la pubblicità nell'e-commerce.

Zyg ha raccolto 60 milioni di dollari guidati da Accel con una valutazione di 500 milioni di dollari due mesi dopo il lancio in incognito. Il team di IronSource sta costruendo agenti AI che sostituiscono gli acquirenti pubblicitari umani per i marchi DTC.

I lavoratori di Google DeepMind votano per unirsi in sindacato dopo che un accordo classificato sull'IA del Pentagono ha annullato otto anni di impegni etici.

Il personale di DeepMind UK ha votato il 98% per unirsi a CWU e Unite dopo che Google ha firmato un accordo riservato con il Pentagono per "qualsiasi scopo lecito". Vogliono che l'uso dell'IA militare venga interrotto e che l'etica venga ripristinata.

I lavoratori di Google DeepMind votano per unirsi in sindacato dopo che un accordo classificato sull'IA del Pentagono ha annullato otto anni di impegni etici.

Il personale di DeepMind UK ha votato il 98% per unirsi a CWU e Unite dopo che Google ha firmato un accordo riservato con il Pentagono per "qualsiasi scopo lecito". Vogliono che l'uso dell'IA militare venga interrotto e che l'etica venga ripristinata.

Dentro il round da 152 milioni di euro di QuantWare per costruire KiloFab

QuantWare ha chiuso un round di Serie B da 152 milioni di euro guidato da Intel Capital, In-Q-Tel e ETF Partners, il più grande round deeptech olandese di sempre.

Dentro il round da 152 milioni di euro di QuantWare per costruire KiloFab

QuantWare ha chiuso un round di Serie B da 152 milioni di euro guidato da Intel Capital, In-Q-Tel e ETF Partners, il più grande round deeptech olandese di sempre.

Google, Microsoft e xAI concordano nel rilasciare in anteprima le valutazioni dei modelli di intelligenza artificiale del governo mentre la crisi di Mythos costringe a un'espansione della supervisione

Cinque laboratori di intelligenza artificiale di frontiera ora presentano modelli per la valutazione del governo degli Stati Uniti. Il programma volontario non ha autorità statutaria ma copre ogni principale sviluppatore di intelligenza artificiale dopo la crisi di Mythos.