Elon Musk condivide un video dei robot umanoidi Unitree G1 che eseguono salti mortali all'indietro durante un concerto

Credito: Unitree

Il CEO di Tesla, Elon Musk, oggi ha rilanciato un video di una performance concertistica cinese sulla piattaforma social X, commentandolo "Impressive", una mossa che ha rapidamente attirato l'attenzione dell'intera comunità tecnologica globale.

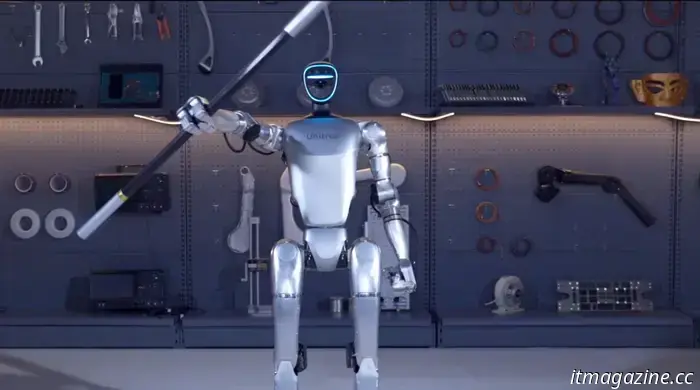

Il video mostrava sei robot umanoidi G1 sviluppati dalla Unitree Robotics di Hangzhou che si esibivano insieme a ballerini umani in un concerto di Wang Leehom a Chengdu, in Cina. Vestiti con costumi di paillettes argentate, i robot si muovevano in stretta sincronizzazione con la musica durante "Firepower", eseguendo routine di danza nitide e sincronizzate al ritmo prima di riuscire insieme in un Webster flip ad alta difficoltà e atterrare senza intoppi sul palco.

Unitree G1 mostra un controllo del movimento rapido e simile a quello umano

Gli osservatori del settore considerano ampiamente l'esibizione un progresso nell'equilibrio dinamico e nei sistemi di potenza dei robot. Il robot umanoide G1 di Unitree è dotato di LiDAR 3D e di algoritmi di coordinamento multi-agente, che consentono tempi di risposta dell'ordine dei secondi e una flessibilità delle articolazioni che si avvicina a quella dei ballerini umani.

Rispetto ai movimenti più cauti mostrati dai robot al Gala del Festival di Primavera cinese appena undici mesi fa, la stabilità e la fluidità del salto mortale all'indietro in questa esibizione hanno segnato un grande balzo in avanti. Il progresso è visto come un passo chiave nel portare la tecnologia dei robot umanoidi cinesi dalle dimostrazioni in laboratorio verso applicazioni commerciali nel mondo reale.

«Al Gala del Festival di Primavera all'inizio di quest'anno, i robot sembravano ancora dei bimbi che imparano a camminare. Ora fanno i salti mortali — il ritmo dell'evoluzione sembra uscito dalla fantascienza», ha detto un utente dei social media cinesi a TechNode.

Robot umanoide Unitree G1 — panoramica e prezzo

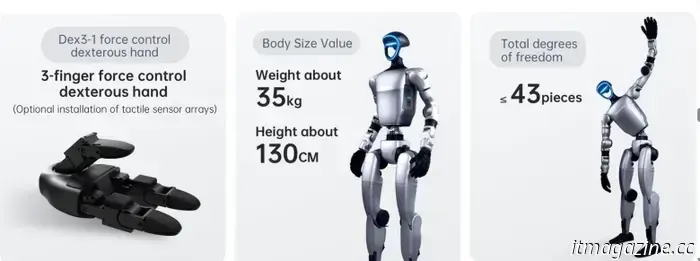

Il Unitree G1 è un umanoide bipede compatto sviluppato dalla società tecnologica cinese Unitree Robotics, presentato a maggio 2024 come parte della spinta dell'azienda a portare la robotica avanzata in ambiti più ampi di ricerca, dimostrazione e uso commerciale.

Alta circa 1,30 metri e con un peso di circa 35 kg, la G1 combina un design meccanico agile con un controllo guidato dall'intelligenza artificiale. Presenta un'ampia gamma di movimento con 23–43 motori articolari, che le conferiscono flessibilità per movimenti dinamici come la corsa, l'equilibrio coordinato e pose complesse. La percezione a bordo è garantita da LiDAR 3D e telecamere di profondità, che supportano la consapevolezza spaziale e la navigazione in tempo reale.

Una parte chiave della filosofia di progettazione del robot è l'integrazione dell'apprendimento AI. La G1 utilizza framework di imitation learning e reinforcement learning per adattare e migliorare nel tempo il suo repertorio di movimenti, mentre mani dotate di controllo della forza e dexterity le danno il potenziale per interagire con oggetti nell'ambiente con capacità di manipolazione fine.

Unitree elenca la G1 a circa 85.000–99.000 RMB (12.000–16.000 $) per il modello base, rendendola uno dei robot umanoidi più economici dotati di capacità avanzate di locomozione e sensing.

Jessie Wu è una giornalista tecnologica con base a Shanghai. Copre elettronica di consumo, semiconduttori e l'industria del gaming per TechNode. Contattala via e-mail: [email protected].

Altri articoli di Jessie Wu

Altri articoli

Offerta sul portatile da gaming Lenovo Legion Pro 5: schermo OLED, RTX 5060 e 32 GB di RAM

La maggior parte dei portatili da gaming in questa fascia di prezzo ti chiede di scendere a compromessi da qualche parte: o uno schermo eccellente con specifiche di fascia media, o componenti potenti con un pannello deludente. Questa offerta sul Legion Pro 5 è interessante perché riesce a trovare il giusto equilibrio. Ottieni un processore AMD Ryzen 7 2025, una GPU RTX 5060, 32 GB di RAM e un […]

Offerta sul portatile da gaming Lenovo Legion Pro 5: schermo OLED, RTX 5060 e 32 GB di RAM

La maggior parte dei portatili da gaming in questa fascia di prezzo ti chiede di scendere a compromessi da qualche parte: o uno schermo eccellente con specifiche di fascia media, o componenti potenti con un pannello deludente. Questa offerta sul Legion Pro 5 è interessante perché riesce a trovare il giusto equilibrio. Ottieni un processore AMD Ryzen 7 2025, una GPU RTX 5060, 32 GB di RAM e un […]

Il proiettore laser 4K Sony VPL-XW5000ES è in offerta con 1.000 $ di sconto.

Gli aggiornamenti seri per il cinema in casa di solito richiedono una spesa importante, e il VPL‑XW5000ES di Sony rientra assolutamente in quella categoria. Anche in offerta, non è un acquisto d'impulso. Ma se stai pianificando una sala cinema dedicata o un aggiornamento a grande schermo che vada oltre qualsiasi TV, questo prezzo di $4,999.99 (ridotto da $5,999.99) è il tipo di sconto […]

Il proiettore laser 4K Sony VPL-XW5000ES è in offerta con 1.000 $ di sconto.

Gli aggiornamenti seri per il cinema in casa di solito richiedono una spesa importante, e il VPL‑XW5000ES di Sony rientra assolutamente in quella categoria. Anche in offerta, non è un acquisto d'impulso. Ma se stai pianificando una sala cinema dedicata o un aggiornamento a grande schermo che vada oltre qualsiasi TV, questo prezzo di $4,999.99 (ridotto da $5,999.99) è il tipo di sconto […]

OpenAI только что обновила свою «Model Spec» — фактически свод правил для своей ИИ — добавив специальный набор принципов для лиц младше 18 лет (U18), призванных изменить то, как ChatGPT общается с подростками в возрасте от 13 до 17 лет. Этот шаг — явное признание того, что подростки — не просто «мини‑взрослые»: у них другие эмоциональные и развивающие потребности, которые требуют более строгих ограничений, особенно когда разговоры становятся тяжёлыми или рискованными.

Новая система взаимодействия ИИ, ориентированная на подростков

Это обновление подробно описывает, как именно ChatGPT должен работать с подростками, при этом соблюдая общие правила, применимые ко всем остальным. OpenAI говорит, что цель — создать опыт, который ощущается более безопасным и соответствующим возрасту, с упором на профилактику и прозрачность.

Airam Dato-on / Pexels

Это не просто случайные правила; принципы U18 основаны на науке о развитии и были проверены внешними экспертами, включая Американскую психологическую ассоциацию.

Рамочная система строится на четырёх основных обещаниях: ставить безопасность подростков превыше всего (даже если это сделает ИИ в данный момент менее «полезным»), направлять подростков к реальной поддержке вместо того, чтобы позволять им полагаться на чат‑бота, относиться к ним как к реальным подросткам, а не к маленьким детям или взрослым, и быть честными в отношении ограничений ИИ.

Эти принципы формализуют то, как ChatGPT должен действовать с повышенной осторожностью, когда поднимаются такие темы, как самоповреждение, сексуальные ролевые игры, опасные челленджи, употребление психоактивных веществ, проблемы с образом тела или просьбы сохранять в секрете небезопасное поведение.

Что это значит для семей и что будет дальше

Это важно, потому что ИИ быстро превращается в стандартный инструмент для того, как молодые люди учатся и ищут ответы. Без чётких границ существует реальная опасность, что подростки могут обращаться к ИИ в моменты, когда им на самом деле нужен родитель, врач или консультант.

OpenAI утверждает, что новые правила гарантируют: когда разговор скатывается в опасную область, ассистент предложит более безопасные альтернативы, установит жёсткие границы и посоветует подростку обратиться к надёжному взрослому. Если ситуация выглядит как непосредственная чрезвычайная, система должна направить их к кризисным горячим линиям или экстренным службам.

Unsplash

Для родителей это даёт некоторое успокоение. OpenAI связывает эти новые принципы со своей Программой безопасности подростков (Teen Safety Blueprint) и с существующими родительскими контролями. Защита также расширяется и охватывает новые функции, такие как групповые чаты, браузер ChatGPT Atlas и приложение Sora, а также встроенные напоминания сделать перерыв, чтобы дети не были прикованы к экрану.

Смотря вперёд, OpenAI начинает внедрять инструмент для определения возраста в личных аккаунтах ChatGPT. Эта система будет пытаться угадать, является ли пользователь несовершеннолетним, и автоматически включать эти подростковые меры безопасности.

Если система не уверена, по умолчанию она переключится на более безопасный опыт U18 на всякий случай. Компания говорит, что это не разовое решение; они планируют продолжать корректировать эти меры защиты на основе новых исследований и отзывов, ясно давая понять, что безопасность подростков будет долгосрочным проектом.

OpenAI ha aggiornato le regole di ChatGPT per proteggere meglio gli adolescenti, introducendo misure di protezione più rigorose, confini più chiari e indicazioni che incoraggiano a cercare supporto nel mondo reale quando le conversazioni diventano delicate.

OpenAI только что обновила свою «Model Spec» — фактически свод правил для своей ИИ — добавив специальный набор принципов для лиц младше 18 лет (U18), призванных изменить то, как ChatGPT общается с подростками в возрасте от 13 до 17 лет. Этот шаг — явное признание того, что подростки — не просто «мини‑взрослые»: у них другие эмоциональные и развивающие потребности, которые требуют более строгих ограничений, особенно когда разговоры становятся тяжёлыми или рискованными.

Новая система взаимодействия ИИ, ориентированная на подростков

Это обновление подробно описывает, как именно ChatGPT должен работать с подростками, при этом соблюдая общие правила, применимые ко всем остальным. OpenAI говорит, что цель — создать опыт, который ощущается более безопасным и соответствующим возрасту, с упором на профилактику и прозрачность.

Airam Dato-on / Pexels

Это не просто случайные правила; принципы U18 основаны на науке о развитии и были проверены внешними экспертами, включая Американскую психологическую ассоциацию.

Рамочная система строится на четырёх основных обещаниях: ставить безопасность подростков превыше всего (даже если это сделает ИИ в данный момент менее «полезным»), направлять подростков к реальной поддержке вместо того, чтобы позволять им полагаться на чат‑бота, относиться к ним как к реальным подросткам, а не к маленьким детям или взрослым, и быть честными в отношении ограничений ИИ.

Эти принципы формализуют то, как ChatGPT должен действовать с повышенной осторожностью, когда поднимаются такие темы, как самоповреждение, сексуальные ролевые игры, опасные челленджи, употребление психоактивных веществ, проблемы с образом тела или просьбы сохранять в секрете небезопасное поведение.

Что это значит для семей и что будет дальше

Это важно, потому что ИИ быстро превращается в стандартный инструмент для того, как молодые люди учатся и ищут ответы. Без чётких границ существует реальная опасность, что подростки могут обращаться к ИИ в моменты, когда им на самом деле нужен родитель, врач или консультант.

OpenAI утверждает, что новые правила гарантируют: когда разговор скатывается в опасную область, ассистент предложит более безопасные альтернативы, установит жёсткие границы и посоветует подростку обратиться к надёжному взрослому. Если ситуация выглядит как непосредственная чрезвычайная, система должна направить их к кризисным горячим линиям или экстренным службам.

Unsplash

Для родителей это даёт некоторое успокоение. OpenAI связывает эти новые принципы со своей Программой безопасности подростков (Teen Safety Blueprint) и с существующими родительскими контролями. Защита также расширяется и охватывает новые функции, такие как групповые чаты, браузер ChatGPT Atlas и приложение Sora, а также встроенные напоминания сделать перерыв, чтобы дети не были прикованы к экрану.

Смотря вперёд, OpenAI начинает внедрять инструмент для определения возраста в личных аккаунтах ChatGPT. Эта система будет пытаться угадать, является ли пользователь несовершеннолетним, и автоматически включать эти подростковые меры безопасности.

Если система не уверена, по умолчанию она переключится на более безопасный опыт U18 на всякий случай. Компания говорит, что это не разовое решение; они планируют продолжать корректировать эти меры защиты на основе новых исследований и отзывов, ясно давая понять, что безопасность подростков будет долгосрочным проектом.

OpenAI ha aggiornato le regole di ChatGPT per proteggere meglio gli adolescenti, introducendo misure di protezione più rigorose, confini più chiari e indicazioni che incoraggiano a cercare supporto nel mondo reale quando le conversazioni diventano delicate.

-pensati-per-cambiare-il-modo-in-cui-ChatGPT.jpg) Lanciare il mio primo podcast generato dall'IA con NotebookLM mi ha insegnato una cosa che devi evitare

NotebookLM può fare un podcast? Sì, può. Il podcast suonerà come persone reali? Non proprio.

Lanciare il mio primo podcast generato dall'IA con NotebookLM mi ha insegnato una cosa che devi evitare

NotebookLM può fare un podcast? Sì, può. Il podcast suonerà come persone reali? Non proprio.

Il confronto dell'ingegneria con la realtà dell'IA

La maggior parte dei responsabili dell'ingegneria non sa rispondere all'unica domanda che il loro CFO sta per porre: «Puoi dimostrare che questa spesa per l'IA sta cambiando i risultati, e non solo l'attività?» Ogni dicembre le roadmap vengono finalizzate, i budget vengono approvati e le presentazioni per il consiglio di amministrazione vengono perfezionate.

Il confronto dell'ingegneria con la realtà dell'IA

La maggior parte dei responsabili dell'ingegneria non sa rispondere all'unica domanda che il loro CFO sta per porre: «Puoi dimostrare che questa spesa per l'IA sta cambiando i risultati, e non solo l'attività?» Ogni dicembre le roadmap vengono finalizzate, i budget vengono approvati e le presentazioni per il consiglio di amministrazione vengono perfezionate.

Il telefono pieghevole di Apple potrebbe arrivare nel 2026, ma non sarà ancora in vendita.

Apple ha in programma di svelare il suo iPhone pieghevole nel 2026, ma problemi di produzione potrebbero limitarne l'offerta, spostando la disponibilità effettiva e l'accesso più ampio al 2027.

Il telefono pieghevole di Apple potrebbe arrivare nel 2026, ma non sarà ancora in vendita.

Apple ha in programma di svelare il suo iPhone pieghevole nel 2026, ma problemi di produzione potrebbero limitarne l'offerta, spostando la disponibilità effettiva e l'accesso più ampio al 2027.

Elon Musk condivide un video dei robot umanoidi Unitree G1 che eseguono salti mortali all'indietro durante un concerto

Oggi il CEO di Tesla, Elon Musk, ha ripubblicato sulla piattaforma social X un video di un'esibizione a un concerto cinese, commentandolo con "Impressionante", una mossa che rapidamente