Meta congela el trabajo de datos de IA después de que una violación pone en riesgo los secretos de entrenamiento

En resumen: Meta ha suspendido su colaboración con Mercor, una startup de datos de IA valorada en $10 mil millones, después de que un ataque a la cadena de suministro expusiera lo que podría ser uno de los secretos mejor guardados de la industria de la IA: no solo datos personales, sino también las metodologías de entrenamiento que alimentan los modelos de lenguaje de gran tamaño más destacados del mundo. La violación, llevada a cabo a través de una versión envenenada de la biblioteca de código abierto LiteLLM, ha desencadenado investigaciones en OpenAI y Anthropic, y ha resultado en una demanda colectiva que afecta a más de 40,000 personas.

Cuando los hackers envenenaron una biblioteca de código abierto ampliamente utilizada el mes pasado, no solo robaron datos personales. Según informes de Wired, pueden haber salido con los planos de cómo se construyen algunos de los modelos de IA más poderosos del mundo.

Meta ha pausado su trabajo con Mercor, una empresa de datos de IA con sede en San Francisco que genera conjuntos de datos de entrenamiento personalizados para los nombres más grandes en inteligencia artificial, después de que un ciberataque expusiera información sensible sobre cómo la empresa, y potencialmente varios de sus otros clientes, realmente entrena sus modelos. La pausa es indefinida, y el incidente ha enviado una ola de ansiedad a través de una industria que ha gastado miles de millones desarrollando los métodos propietarios que contaba con mantener en secreto.

La startup detrás de la cortina

Mercor no es un nombre conocido, pero se encuentra en un punto crítico de la economía de la IA. Fundada en 2023 por Brendan Foody, Adarsh Hiremath y Surya Midha, tres amigos de la escuela secundaria del área de la Bahía que compitieron juntos en el equipo de Oratoria y Debate del Bellarmine College Preparatory, la empresa recluta redes de contratistas humanos, ingenieros, abogados, médicos, banqueros y periodistas, para producir datos de entrenamiento de alta calidad y propietarios para laboratorios de IA. Sus clientes han incluido a Meta, OpenAI, Anthropic y Google.

El ascenso de la startup ha sido extraordinario incluso para los estándares de Silicon Valley. En octubre de 2025, Mercor cerró una ronda de financiación Serie C de $350 millones que la valoró en $10 mil millones, convirtiendo a los tres fundadores en los multimillonarios más jóvenes del mundo a la edad de 22 años. Para septiembre de 2025, la empresa había alcanzado $500 millones en ingresos anuales, frente a $100 millones solo seis meses antes. Su modelo de negocio, generando datos de ajuste fino y aprendizaje por refuerzo de los que dependen los laboratorios de IA pero que rara vez discuten públicamente, la convirtió en una de las empresas privadas más valiosas en la cadena de suministro de IA.

Esa misma posición es ahora la fuente de su vulnerabilidad.

Un paquete envenenado, una cascada de exposición

El ataque que alcanzó a Mercor se originó varios pasos río arriba. Según el análisis de Wiz, Snyk y Datadog Security Labs, un grupo de actores de amenazas conocido como TeamPCP comprometió la tubería CI/CD de LiteLLM, una biblioteca de Python de código abierto utilizada por millones de desarrolladores para conectar aplicaciones a servicios de IA, con 97 millones de descargas mensuales y una presencia en aproximadamente el 36% de los entornos en la nube.

TeamPCP había utilizado anteriormente un ataque a la cadena de suministro en Trivy, un escáner de seguridad ampliamente utilizado, para obtener credenciales pertenecientes a un mantenedor de LiteLLM. El 27 de marzo de 2026, el grupo utilizó esas credenciales para publicar dos versiones maliciosas del paquete LiteLLM, 1.82.7 y 1.82.8, directamente en PyPI, el repositorio de paquetes de Python. Los paquetes contaminados estuvieron disponibles durante aproximadamente 40 minutos antes de ser identificados y eliminados.

La carga útil era sofisticada. La versión 1.82.7 incrustó malware codificado en base64 directamente en el código del servidor proxy de la biblioteca, ejecutándose al importarse. La versión 1.82.8 utilizó un archivo de configuración de ruta malicioso que se activaba automáticamente en cada inicio de proceso de Python. Ambas variantes estaban diseñadas para cosechar variables de entorno, claves API, claves SSH, credenciales en la nube a través de AWS, Google Cloud y Azure, configuraciones de Kubernetes, secretos de CI/CD y credenciales de bases de datos, exfiltrando todo a un servidor en models.litellm[.]cloud.

Mercor, que confirmó que era "una de miles de empresas" afectadas por el ataque, encontró posteriormente que la violación había expuesto aproximadamente cuatro terabytes de datos. Según documentos judiciales y reclamos realizados por los grupos de hackers involucrados, el caché robado incluye 939 gigabytes de código fuente de la plataforma, una base de datos de usuarios de 211 gigabytes y aproximadamente tres terabytes de grabaciones de entrevistas en video y documentos de verificación de identidad. La información expuesta puede incluir los nombres completos y números de Seguro Social de más de 40,000 contratistas y clientes actuales y anteriores de Mercor.

Los secretos que más importan

La exposición de datos personales sería lo suficientemente preocupante. Pero lo que ha alarmado a Meta y atraído la atención de otros laboratorios de IA es una categoría de información completamente diferente.

Debido a que Mercor se encuentra dentro de las tuberías de datos de múltiples empresas de IA simultáneamente, la violación puede haber expuesto detalles sobre criterios de selección de datos, protocolos de etiquetado y estrategias de entrenamiento que las empresas han pasado años y miles de millones de dólares desarrollando. Los competidores pueden replicar un conjunto de datos; replicar una metodología de entrenamiento es más difícil, y representa un verdadero foso competitivo. El informe de Wired señala que la magnitud de esa posible exposición ha llevado a múltiples laboratorios de IA a investigar qué, precisamente, puede haber salido de su órbita.

OpenAI, que también utiliza los servicios de Mercor, ha dicho que está investigando el incidente pero no ha pausado sus proyectos actuales con la empresa. Anthropic, que recaudó $3 mil millones a principios de 2026 y ha estado expandiendo su infraestructura de investigación de manera agresiva, no ha comentado públicamente sobre su exposición. Google, que opera relaciones de proveedores de datos competidores de un tipo similar, también se entiende que está evaluando el alcance de la violación.

El incidente ilustra un riesgo estructural que la industria de la IA rara vez ha tenido que enfrentar: cuando múltiples competidores dependen del mismo proveedor de datos de terceros, una sola violación puede exponer los secretos competitivos de todos ellos a la vez.

Extorsión y consecuencias legales

El grupo de amenazas Lapsus$, que anteriormente ha sido vinculado a ataques de alto perfil a grandes corporaciones, posteriormente reclamó la responsabilidad por la violación de Mercor y comenzó a subastar los datos robados en foros de la dark web. Los investigadores de seguridad creen que Lapsus$ está actuando en colaboración con TeamPCP, que ha surgido como una amenaza sistemática en todo el ecosistema de IA y software empresarial. Se cree que el mismo grupo es responsable de una ola de compromisos de la cadena de suministro que afecta a más de 1,000 entornos SaaS empresariales a través del ataque anterior a Trivy, incluida una violación de la Comisión Europea atribuida por CERT-EU a la misma campaña.

El 1 de abril de 2026, la demandante Lisa Gill, residente de Wahiawa, Hawái, presentó una demanda colectiva contra Mercor.io Corp. en el Tribunal de Distrito de EE. UU. para el Distrito Norte de California. La demanda alega que Mercor no mantuvo protecciones adecuadas de ciberseguridad, dejando a más de 40,000 personas expuestas al robo de identidad y fraude. La queja establece que el incidente de LiteLLM del 27 de marzo fue el punto de entrada y que la dependencia de Mercor de una dependencia de código abierto comprometida sin suficiente monitoreo creó las condiciones para la violación.

Meta, mientras tanto, no ha dicho nada públicamente, un silencio que dice mucho. La empresa firmó un acuerdo de infraestructura de IA de $27 mil millones con Nebius Group en marzo de 2026 y ha pronosticado gastos de capital de entre $115 mil millones y $135 mil millones para el año, convirtiendo su tubería de entrenamiento de IA en uno de sus activos más estratégicamente sensibles. Pausar una relación con un proveedor de datos, incluso una importante, es el tipo de decisión que se toma solo cuando el riesgo para la metodología propietaria supera el costo operativo de detener el trabajo.

Una historia de advertencia para la cadena de suministro de IA

La violación de Mercor es, en cierto sentido, un ataque convencional a la cadena de suministro: un actor de amenazas encontró un eslabón débil en una dependencia de código abierto y lo explotó para el robo de credenciales y la exfiltración de datos. En otro sentido, es algo más nuevo y perturbador. La industria de la IA ha construido su propiedad intelectual más valiosa sobre una red interconectada de proveedores de datos, herramientas

Otros artículos

Windows 11 está a punto de ofrecer retroalimentación háptica para un montón de tareas.

Windows 11 está añadiendo retroalimentación háptica para acciones como ajustar y cambiar el tamaño de las ventanas, aportando respuestas táctiles a los trackpads y dispositivos de entrada compatibles.

Windows 11 está a punto de ofrecer retroalimentación háptica para un montón de tareas.

Windows 11 está añadiendo retroalimentación háptica para acciones como ajustar y cambiar el tamaño de las ventanas, aportando respuestas táctiles a los trackpads y dispositivos de entrada compatibles.

WHOOP recauda $575 millones a una valoración de $10.1 mil millones, señala una próxima OPI.

WHOOP recauda $575 millones en su Serie G, triplicando su valoración de 2021 a $10.1 mil millones. Respaldada por Mayo Clinic, Abbott y Cristiano Ronaldo, la empresa de dispositivos de salud portátil afirma que una oferta pública inicial es lo siguiente.

WHOOP recauda $575 millones a una valoración de $10.1 mil millones, señala una próxima OPI.

WHOOP recauda $575 millones en su Serie G, triplicando su valoración de 2021 a $10.1 mil millones. Respaldada por Mayo Clinic, Abbott y Cristiano Ronaldo, la empresa de dispositivos de salud portátil afirma que una oferta pública inicial es lo siguiente.

Aiper Experts Duo: Este dúo de limpieza de piscinas impulsado por IA hace que la propiedad de piscinas sin preocupaciones las 24 horas del día, los 7 días de la semana, sea una realidad.

El mantenimiento de piscinas ha existido durante mucho tiempo en un estado fragmentado, donde diferentes herramientas resuelven diferentes problemas pero rara vez trabajan juntas de manera significativa. Limpiar el fondo, despejar la superficie y mantener la calidad del agua han requerido tradicionalmente intervenciones separadas, a menudo en diferentes momentos. Lo que ha faltado es un sistema que no solo automatice estas tareas […]

Aiper Experts Duo: Este dúo de limpieza de piscinas impulsado por IA hace que la propiedad de piscinas sin preocupaciones las 24 horas del día, los 7 días de la semana, sea una realidad.

El mantenimiento de piscinas ha existido durante mucho tiempo en un estado fragmentado, donde diferentes herramientas resuelven diferentes problemas pero rara vez trabajan juntas de manera significativa. Limpiar el fondo, despejar la superficie y mantener la calidad del agua han requerido tradicionalmente intervenciones separadas, a menudo en diferentes momentos. Lo que ha faltado es un sistema que no solo automatice estas tareas […]

Las bombas de la demanda de privacidad de Perplexity te harán sudar sobre el uso de la herramienta de IA.

Perplexity enfrenta una demanda que alega que su modo incógnito compartió datos de usuarios con Google y Meta, lo que plantea serias preocupaciones sobre la privacidad del chat de IA.

Las bombas de la demanda de privacidad de Perplexity te harán sudar sobre el uso de la herramienta de IA.

Perplexity enfrenta una demanda que alega que su modo incógnito compartió datos de usuarios con Google y Meta, lo que plantea serias preocupaciones sobre la privacidad del chat de IA.

Claude AI ahora puede acceder a correos electrónicos, archivos e incluso ejecutar tareas en tu PC.

Dos anuncios, una dirección clara: Anthropic quiere que Claude esté integrado en cómo trabajas. Los conectores de Microsoft 365 llegan a todos los planes, y el uso de computadoras finalmente llega a los usuarios de Windows esta semana.

Claude AI ahora puede acceder a correos electrónicos, archivos e incluso ejecutar tareas en tu PC.

Dos anuncios, una dirección clara: Anthropic quiere que Claude esté integrado en cómo trabajas. Los conectores de Microsoft 365 llegan a todos los planes, y el uso de computadoras finalmente llega a los usuarios de Windows esta semana.

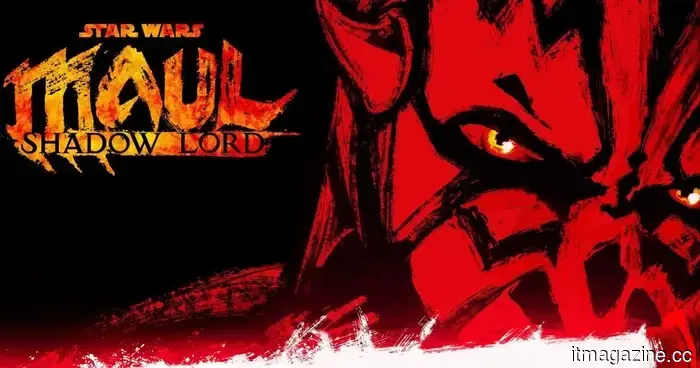

Maul – Shadow Lord regresa para una segunda temporada para expandir la historia de Star Wars.

Star Wars: Maul – Shadow Lord ha sido renovada para la Temporada 2 antes de que la Temporada 1 se estrene, con Dave Filoni confirmando la continuación en Lucasfilm Animation antes del debut en Disney+ el 6 de abril.

Maul – Shadow Lord regresa para una segunda temporada para expandir la historia de Star Wars.

Star Wars: Maul – Shadow Lord ha sido renovada para la Temporada 2 antes de que la Temporada 1 se estrene, con Dave Filoni confirmando la continuación en Lucasfilm Animation antes del debut en Disney+ el 6 de abril.

Meta congela el trabajo de datos de IA después de que una violación pone en riesgo los secretos de entrenamiento

Meta ha pausado indefinidamente el trabajo con la startup de datos de IA de $10 mil millones, Mercor, después de que un ataque a la cadena de suministro de LiteLLM expusiera las metodologías de entrenamiento utilizadas por Meta, OpenAI y Anthropic.