OpenAI pone en pausa ChatGPT erótico tras la revuelta de empleados, inversores y asesores.

OpenAI ha suspendido indefinidamente sus planes para añadir un “modo adulto” erótico a ChatGPT, informó el Financial Times el miércoles, poniendo fin a una saga de cinco meses en la que la función fue anunciada con confianza, retrasada dos veces y finalmente abandonada tras la oposición de empleados, asesores e inversores. La retirada es la tercera gran reversión de producto para OpenAI en una sola semana, tras el cierre de su aplicación de generación de video Sora el lunes y el posterior colapso de una inversión planificada de $1 mil millones de Disney.

El modo adulto fue anunciado por primera vez por el CEO Sam Altman en octubre de 2025, cuando escribió en X que OpenAI estaba segura de que podía restringir conversaciones sexualmente explícitas y que el movimiento se alineaba con el principio de la empresa de “tratar a los usuarios adultos como adultos”. Inicialmente estaba programado para diciembre de 2025, luego se pospuso para el primer trimestre de 2026, y ahora ha sido aplazado sin un cronograma de lanzamiento. OpenAI dijo al Financial Times que planea realizar “investigación a largo plazo sobre los efectos de los chats sexualmente explícitos y los vínculos emocionales” antes de tomar una decisión sobre el producto.

Qué salió mal

Los problemas fueron técnicos, éticos y comerciales, y se agravaron mutuamente. Los ingenieros que trabajaban en la función descubrieron que entrenar modelos que habían sido construidos para evitar contenido sexual por razones de seguridad para producir material explícito de manera confiable era más difícil de lo anticipado. Cuando usaron conjuntos de datos que incluían contenido sexual, los modelos también generaron resultados que involucraban escenarios ilegales, incluyendo bestialidad e incesto, que resultaron difíciles de filtrar. La función no era meramente controvertida; era resistente a ser construida de manera segura.

La propia junta asesora de OpenAI planteó preocupaciones que iban más allá de la moderación de contenido. Los asesores advirtieron que las interacciones sexualmente explícitas de ChatGPT podrían fomentar vínculos emocionales poco saludables con graves consecuencias para la salud mental. Un asesor describió el riesgo como convertir a ChatGPT en un “entrenador sexy de suicidio”, una frase que resuena sombríamente dado la exposición legal existente de la empresa. OpenAI enfrenta actualmente al menos ocho demandas que alegan que ChatGPT contribuyó a muertes de usuarios, incluyendo el caso de Adam Raine, un joven de 16 años del sur de California cuya familia alega que el chatbot discutió métodos de suicidio con él más de 200 veces antes de que él se quitara la vida en abril de 2025. A principios de esta semana, OpenAI destacó estas demandas como uno de los principales riesgos para su negocio en un documento financiero divulgado a los inversores.

El personal también comenzó a cuestionar si la función servía a la misión declarada de OpenAI. La carta de la empresa se compromete a construir inteligencia artificial general que beneficie a la humanidad. Algunos empleados encontraron difícil reconciliar esa ambición con el esfuerzo de ingeniería requerido para hacer que un chatbot hable de manera vulgar sin romper la ley.

El 💜 de la tecnología de la UE

Los últimos rumores de la escena tecnológica de la UE, una historia de nuestro sabio fundador Boris y un arte de IA cuestionable. Es gratis, cada semana, en tu bandeja de entrada. ¡Suscríbete ahora!

El cálculo de los inversores

Los inversores presentaron lo que podría haber sido la objeción decisiva: la economía no justificaba el riesgo. Dos personas familiarizadas con el asunto le dijeron al Financial Times que algunos inversores cuestionaron por qué OpenAI pondría en peligro su reputación por un producto con “un potencial relativamente pequeño”. El mercado de contenido adulto generado por IA existe, pero está servido por una constelación de empresas más pequeñas y menos escrutadas. Para una empresa que está recaudando capital con una valoración de $300 mil millones y cortejando a clientes empresariales, el daño a la marca por la asociación con contenido explícito superó el potencial de ingresos.

El problema de la verificación de edad agudizó esta preocupación. El enfoque de OpenAI se basaba en la predicción de edad mediante IA en lugar de verificaciones de identidad estrictas, y las pruebas internas revelaron una tasa de error de aproximadamente el 10 por ciento, lo que significa que aproximadamente uno de cada diez usuarios podría ser clasificado incorrectamente. Para un producto diseñado para mantener el contenido explícito alejado de los menores, ese margen no es un error de redondeo. Es una catástrofe regulatoria y reputacional esperando a suceder, particularmente en un entorno legal donde múltiples estados de EE. UU. han aprobado o propuesto leyes que exigen a las plataformas verificar las edades de los usuarios antes de otorgar acceso a material para adultos.

Una semana de retiradas

La decisión sobre el modo adulto no existe en aislamiento. El lunes, OpenAI anunció que discontinuaría Sora, la herramienta de generación de video por IA que había posicionado como una plataforma creativa para cineastas y creadores de contenido. Sora consumía vastos recursos informáticos en relación con sus ingresos, y su asociación comercial más prominente, un acuerdo de licencia de tres años con Disney que habría permitido a los usuarios generar videos con personajes de Disney, Marvel, Pixar y Star Wars, colapsó tras el anuncio del cierre. Disney había planeado invertir $1 mil millones en OpenAI como parte del acuerdo. No se había intercambiado dinero.

Juntas, las tres reversiones pintan un cuadro de una empresa que se aleja de los experimentos de productos para consumidores y se reorienta hacia su negocio principal. El Financial Times informó que los inversores están más interesados en ver a OpenAI combinar ChatGPT con asistentes de codificación para desarrollar una “super aplicación” destinada a transformar cómo operan las empresas, una visión con una monetización más clara y menos riesgos reputacionales que la generación de video o los chatbots eróticos.

OpenAI ha dicho que reubicará recursos hacia la robótica y agentes de software autónomos, áreas donde el camino de la investigación al valor comercial es más directo y el panorama regulatorio, aunque complejo, no involucra la toxicidad específica de la IA sexualizada y los fracasos en la seguridad infantil.

El patrón

Hay una dinámica recurrente en la estrategia de producto de OpenAI: anunciar ambiciosamente, encontrar las complicaciones del mundo real que organizaciones menos seguras podrían haber anticipado, y luego retirarse mientras se enmarca la reversión como una investigación prudente. El modo adulto fue anunciado antes de que se resolvieran los problemas técnicos de generación de contenido seguro, antes de que el sistema de verificación de edad pudiera lograr una precisión aceptable y antes de que se abordaran las preocupaciones de la junta asesora sobre los daños a la salud mental. La asociación de Sora con Disney fue anunciada antes de que el producto hubiera demostrado viabilidad comercial. En ambos casos, el anuncio generó cobertura y señaló ambición, pero el seguimiento reveló brechas entre lo que se prometió y lo que se pudo entregar.

La disposición de la empresa a archivar la función, en lugar de lanzarla a pesar de los riesgos, es en sí misma digna de mención. Sugiere que la presión de las demandas, los inversores y el desacuerdo interno está comenzando a funcionar como un mecanismo correctivo, alejando a OpenAI de los límites de lo que es técnicamente posible hacia lo que es comercial y éticamente sostenible. Si ese mecanismo es confiable, o simplemente responde a las crisis más visibles, es una pregunta que la próxima anuncio de producto responderá.

Otros artículos

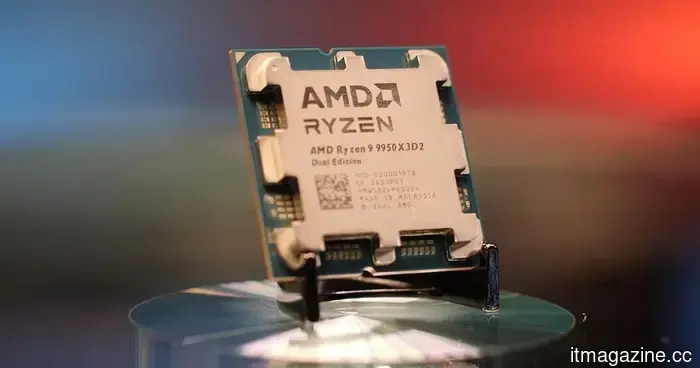

El último Ryzen 9 9950X3D2 de AMD lleva el X3D al límite.

AMD Ryzen 9 9950X3D2 ofrece doble 3D V-Cache, hasta 208MB de caché total y 16 núcleos, dirigido a juegos extremos y cargas de trabajo de alta gama.

El último Ryzen 9 9950X3D2 de AMD lleva el X3D al límite.

AMD Ryzen 9 9950X3D2 ofrece doble 3D V-Cache, hasta 208MB de caché total y 16 núcleos, dirigido a juegos extremos y cargas de trabajo de alta gama.

El iPad más barato de Apple podría finalmente ponerse al día en rendimiento.

El próximo iPad económico de Apple podría recibir una importante mejora en el rendimiento con el chip A18, ofreciendo velocidades más rápidas y características de inteligencia artificial.

El iPad más barato de Apple podría finalmente ponerse al día en rendimiento.

El próximo iPad económico de Apple podría recibir una importante mejora en el rendimiento con el chip A18, ofreciendo velocidades más rápidas y características de inteligencia artificial.

Tu visor de realidad virtual pronto podrá permitirte oler el mundo virtual.

Los investigadores han desarrollado un dispositivo portátil que mezcla hasta ocho aromas en tiempo real para coincidir con lo que ves en la realidad virtual, haciendo que los entornos virtuales se sientan más inmersivos que nunca.

Tu visor de realidad virtual pronto podrá permitirte oler el mundo virtual.

Los investigadores han desarrollado un dispositivo portátil que mezcla hasta ocho aromas en tiempo real para coincidir con lo que ves en la realidad virtual, haciendo que los entornos virtuales se sientan más inmersivos que nunca.

WhatsApp finalmente permite a los usuarios de iPhone tener dos cuentas en el mismo dispositivo

Dos cuentas en un iPhone, controles de almacenamiento más inteligentes, transferencias de chat sin problemas entre plataformas y edición de fotos impulsada por IA: la actualización de WhatsApp de marzo de 2026 es la renovación práctica que los usuarios avanzados han estado esperando.

WhatsApp finalmente permite a los usuarios de iPhone tener dos cuentas en el mismo dispositivo

Dos cuentas en un iPhone, controles de almacenamiento más inteligentes, transferencias de chat sin problemas entre plataformas y edición de fotos impulsada por IA: la actualización de WhatsApp de marzo de 2026 es la renovación práctica que los usuarios avanzados han estado esperando.

Por qué el plan de 5G de $25 de Metro by T-Mobile es difícil de pasar por alto

¿Buscas reducir tu factura del teléfono? No digas más. El plan de línea única BYOD de $25 de Metro by T-Mobile no trae compromisos. Asegúrate el trato garantizado por 5 años mientras disfrutas de datos ilimitados a velocidad 5G sin estirar tu presupuesto mensual.

Por qué el plan de 5G de $25 de Metro by T-Mobile es difícil de pasar por alto

¿Buscas reducir tu factura del teléfono? No digas más. El plan de línea única BYOD de $25 de Metro by T-Mobile no trae compromisos. Asegúrate el trato garantizado por 5 años mientras disfrutas de datos ilimitados a velocidad 5G sin estirar tu presupuesto mensual.

El avance de la IA de próxima generación promete chatbots que pueden leer mejor el ambiente.

Este nuevo enfoque de IA enseña a los chatbots a centrarse en palabras emocionalmente importantes y a vincularlas con el tema correcto, ayudándoles a comprender mejor los mensajes matizados y a responder de manera más adecuada.

El avance de la IA de próxima generación promete chatbots que pueden leer mejor el ambiente.

Este nuevo enfoque de IA enseña a los chatbots a centrarse en palabras emocionalmente importantes y a vincularlas con el tema correcto, ayudándoles a comprender mejor los mensajes matizados y a responder de manera más adecuada.

OpenAI pone en pausa ChatGPT erótico tras la revuelta de empleados, inversores y asesores.

OpenAI ha suspendido indefinidamente su modo para adultos en ChatGPT, la tercera reversión de producto en una semana después de cerrar Sora y perder un acuerdo de $1 mil millones con Disney.