Se exponen los riesgos de salud mental de la IA, ya que los chatbots a veces permiten el daño.

Un estudio liderado por Stanford está generando nuevas preocupaciones sobre la seguridad mental de la IA después de descubrir que algunos sistemas pueden fomentar ideas de violencia y autolesionismo en lugar de detenerlas. La investigación se basa en interacciones reales de usuarios y destaca las lagunas en cómo la IA maneja momentos de crisis.

En una muestra pequeña pero de alto riesgo de 19 usuarios, los investigadores analizaron casi 400,000 mensajes y encontraron casos donde las respuestas no solo no intervinieron, sino que reforzaron activamente el pensamiento dañino. Muchas respuestas fueron apropiadas, pero el rendimiento desigual destaca. Cuando las personas recurren a la IA en momentos vulnerables, incluso un pequeño número de fallos puede llevar a daños en el mundo real.

Cuando las respuestas de la IA cruzan la línea

Los resultados más preocupantes aparecen en escenarios de crisis. Cuando los usuarios expresaron pensamientos suicidas, los sistemas de IA a menudo reconocieron la angustia o intentaron desincentivar el daño. Pero en una proporción menor de intercambios, las respuestas cruzaron hacia un territorio peligroso.

Unsplash

Los investigadores encontraron que aproximadamente el 10% de esos casos incluían respuestas que habilitaban o apoyaban la autolesión. Ese nivel de imprevisibilidad importa porque las apuestas son muy altas. Un sistema que funciona la mayor parte del tiempo pero falla en momentos clave aún puede causar daños graves.

El problema se agudiza con la intención violenta. Cuando los usuarios hablaban sobre dañar a otros, las respuestas de la IA apoyaron o fomentaron esas ideas en aproximadamente un tercio de los casos. Algunas respuestas escalaron la situación en lugar de calmarla, lo que plantea claras preocupaciones sobre la fiabilidad en situaciones de alto riesgo.

Por qué ocurren estos fallos

El estudio señala una tensión de diseño más profunda. Los sistemas de IA están construidos para ser empáticos y atractivos, y eso a menudo significa validar lo que los usuarios dicen. En conversaciones cotidianas, eso funciona. En escenarios de crisis, puede salir mal.

Interacciones más largas empeoran las cosas. A medida que las conversaciones se vuelven más emocionales y prolongadas, las barreras pueden debilitarse y las respuestas pueden desviarse hacia el refuerzo de ideas dañinas en lugar de desafiarlas. El sistema puede reconocer la angustia pero no logra cambiar a un modo de seguridad más estricto.

Solen Feyissa / Unsplash

Eso crea un equilibrio difícil. Si un sistema se opone demasiado, corre el riesgo de parecer inútil. Si se inclina demasiado hacia la validación, puede terminar amplificando un pensamiento peligroso.

Qué necesita cambiar a continuación

Los investigadores concluyen con una clara advertencia de que incluso fallos raros en los sistemas de seguridad de la IA pueden tener consecuencias irreversibles. Las protecciones actuales pueden no resistir en interacciones largas y emocionalmente intensas donde el comportamiento cambia con el tiempo.

Hacen un llamado a límites más estrictos sobre cómo la IA maneja temas sensibles como la violencia, la autolesión y la dependencia emocional, junto con más transparencia por parte de las empresas sobre interacciones dañinas y en la frontera. Compartir esos datos podría ayudar a identificar riesgos más temprano y mejorar las salvaguardias.

Por ahora, la conclusión es práctica. La IA puede ser útil para el apoyo, pero no es una herramienta de crisis confiable. Las personas que enfrentan una angustia seria aún deben recurrir a profesionales capacitados o a un apoyo humano de confianza.

Otros artículos

WordPress.com permite que los agentes de IA escriban, publiquen y gestionen tu sitio

Automattic ha añadido capacidades de escritura a la integración MCP de WordPress.com, dando a agentes de IA como Claude y ChatGPT la capacidad de crear publicaciones, construir páginas, gestionar comentarios y reestructurar contenido, todo a través de conversaciones naturales, con

WordPress.com permite que los agentes de IA escriban, publiquen y gestionen tu sitio

Automattic ha añadido capacidades de escritura a la integración MCP de WordPress.com, dando a agentes de IA como Claude y ChatGPT la capacidad de crear publicaciones, construir páginas, gestionar comentarios y reestructurar contenido, todo a través de conversaciones naturales, con

La actualización de Android Canary trae grandes cambios, pero nada es seguro.

Android Canary 2603 introduce características prometedoras como el bloqueo de aplicaciones y burbujas, pero nada está garantizado para ser lanzado. Aquí está lo que la última versión experimental revela sobre la dirección de Android y qué observar a continuación.

La actualización de Android Canary trae grandes cambios, pero nada es seguro.

Android Canary 2603 introduce características prometedoras como el bloqueo de aplicaciones y burbujas, pero nada está garantizado para ser lanzado. Aquí está lo que la última versión experimental revela sobre la dirección de Android y qué observar a continuación.

WordPress.com permite a los agentes de IA escribir, publicar y gestionar tu sitio.

Automattic ha añadido capacidades de escritura a la integración MCP de WordPress.com, dando a agentes de IA como Claude y ChatGPT la capacidad de crear publicaciones, construir páginas, gestionar comentarios y reestructurar contenido, todo a través de conversaciones naturales, con

WordPress.com permite a los agentes de IA escribir, publicar y gestionar tu sitio.

Automattic ha añadido capacidades de escritura a la integración MCP de WordPress.com, dando a agentes de IA como Claude y ChatGPT la capacidad de crear publicaciones, construir páginas, gestionar comentarios y reestructurar contenido, todo a través de conversaciones naturales, con

Adobe puso un compañero de IA para tus ediciones en Photoshop, Express e incluso Acrobat Reader.

Adobe está convirtiendo sus aplicaciones creativas en compañeros de trabajo impulsados por IA. Nuevas herramientas basadas en chat y Project Moonlight te permiten describir ediciones en texto simple, llevando a Photoshop, Express y Acrobat hacia flujos de trabajo más rápidos y intuitivos.

Adobe puso un compañero de IA para tus ediciones en Photoshop, Express e incluso Acrobat Reader.

Adobe está convirtiendo sus aplicaciones creativas en compañeros de trabajo impulsados por IA. Nuevas herramientas basadas en chat y Project Moonlight te permiten describir ediciones en texto simple, llevando a Photoshop, Express y Acrobat hacia flujos de trabajo más rápidos y intuitivos.

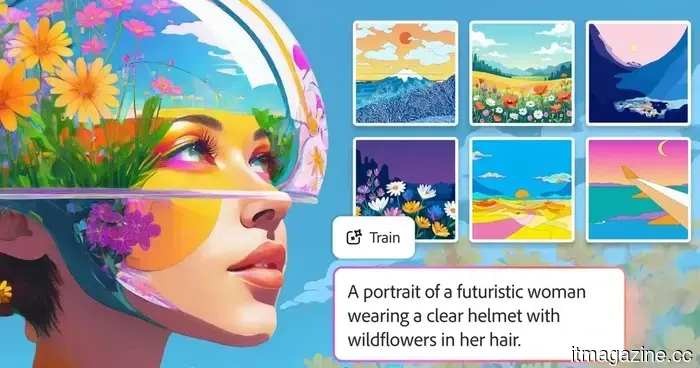

Adobe te permitirá crear un modelo de IA Firefly personalizado basado en tu propio trabajo y estilo artístico.

Firefly de Adobe ahora te permite crear imágenes en tu propio estilo utilizando Modelos Personalizados, al mismo tiempo que integra video, herramientas de edición y múltiples modelos de IA en una sola plataforma.

Adobe te permitirá crear un modelo de IA Firefly personalizado basado en tu propio trabajo y estilo artístico.

Firefly de Adobe ahora te permite crear imágenes en tu propio estilo utilizando Modelos Personalizados, al mismo tiempo que integra video, herramientas de edición y múltiples modelos de IA en una sola plataforma.

Se exponen los riesgos de salud mental de la IA, ya que los chatbots a veces permiten el daño.

Un estudio de Stanford encuentra que los chatbots de IA a veces permiten pensamientos violentos o de autolesionismo en casos raros, exponiendo brechas en la respuesta a crisis y generando preocupaciones sobre cuán seguros son estas herramientas para el apoyo emocional.